Clear Sky Science · fr

Une nouvelle approche basée sur l’apprentissage par renforcement pour la prévision à court terme de la charge et des prix sur les marchés de l’énergie

Pourquoi il est important de prévoir la consommation de demain

Chaque fois que vous actionnez un interrupteur, un vaste réseau de centrales électriques, de marchés et d’ordinateurs travaille en coulisses pour maintenir l’électricité disponible et abordable. Si les opérateurs de réseau peuvent prédire avec précision la quantité d’électricité que les gens consommeront et l’évolution des prix dans les heures à venir, ils peuvent éviter les pannes, réduire le gaspillage et faire économiser de l’argent à tous. Cet article explore une nouvelle manière d’effectuer ces prévisions à court terme en utilisant des techniques développées à l’origine pour apprendre à jouer et à contrôler des robots.

Des estimations plus intelligentes pour un monde énergétique en mutation

La demande d’électricité et les prix peuvent varier fortement d’une heure à l’autre. Les vagues de chaleur, les épisodes de grand froid, les jours fériés et le coût des combustibles poussent tous le système dans des directions différentes. Les outils de prévision traditionnels, comme de simples tendances ou même des modèles de machine learning classiques, traitent souvent le problème comme un simple ajustement aux données passées. Ils peinent lorsque les conditions changent rapidement ou lorsque de nombreux facteurs interagissent de façon complexe. Les auteurs soutiennent que les réseaux électriques modernes, en particulier ceux où la part des énergies renouvelables augmente, ont besoin d’outils de prévision capables de s’adapter en continu et d’apprendre directement de leurs succès et de leurs erreurs.

Un agent apprenant sur le marché de l’électricité

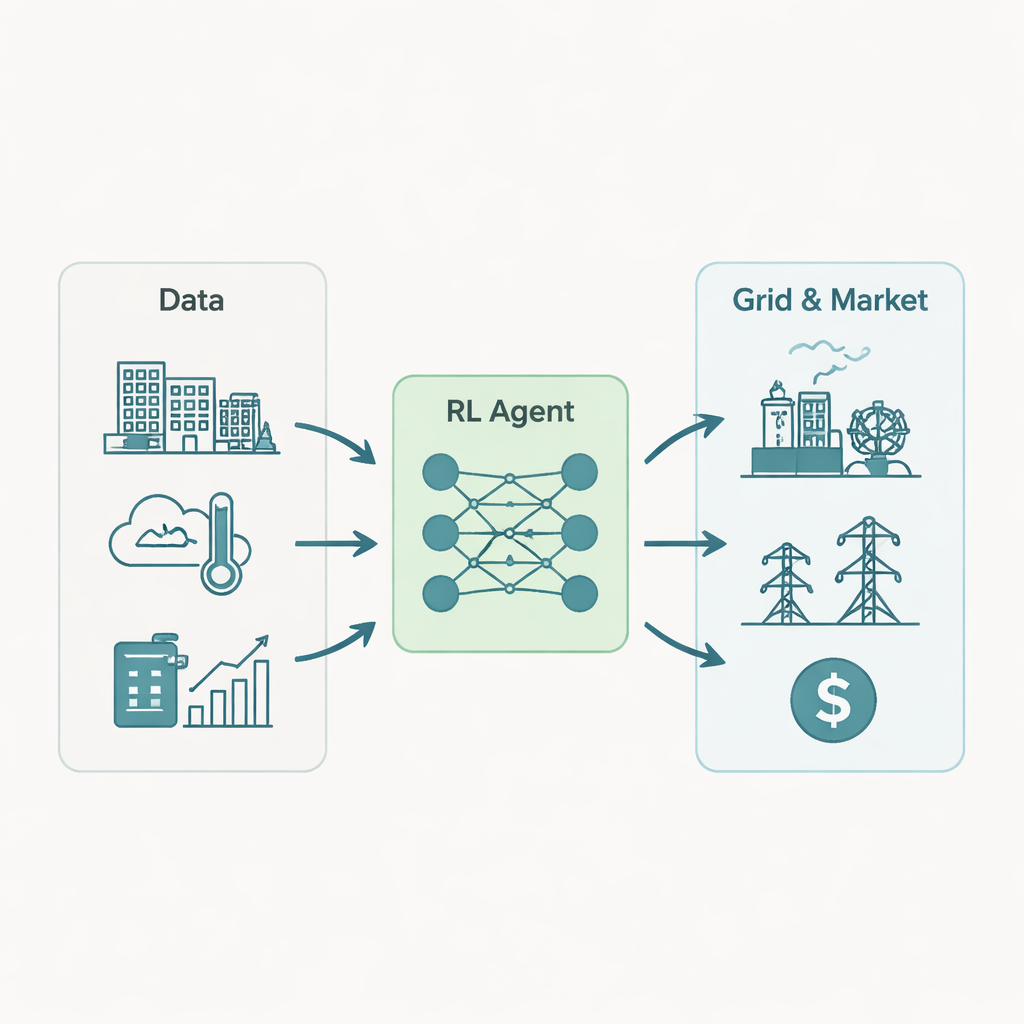

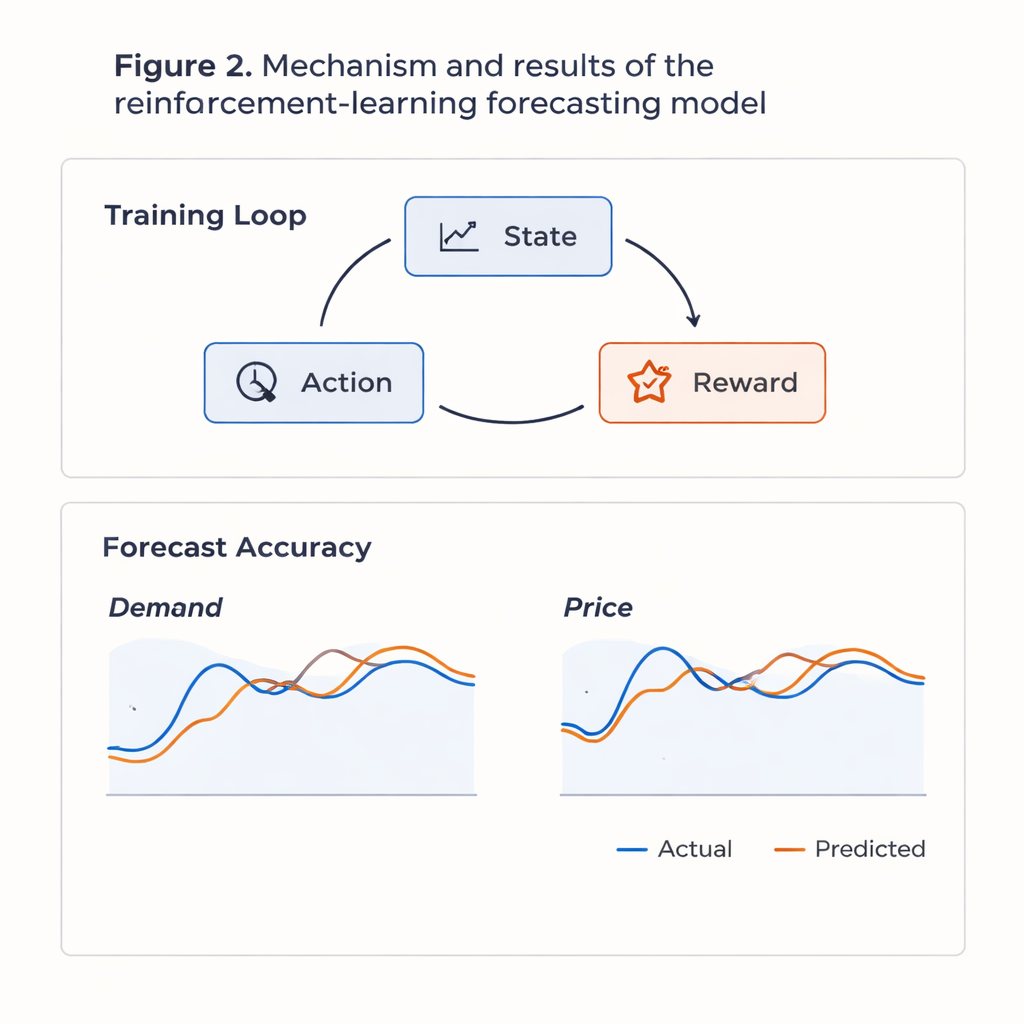

Les chercheurs ont requalifié la prévision en un jeu de prise de décision. À chaque heure, un « agent » informatique observe la situation actuelle : la demande d’électricité récente, les prix passés, la température, l’humidité, le jour de la semaine, les jours fériés et le coût des carburants. Il choisit ensuite une action : sa meilleure estimation de la demande et du prix de l’électricité pour l’heure suivante. Une fois les valeurs réelles connues, l’agent reçoit un score en fonction de son erreur — les grandes erreurs sont pénalisées, les petites erreurs sont récompensées. Au fil du temps, le système cherche une stratégie qui maximise son score à long terme, et pas seulement la précision d’une seule prédiction. Pour gérer la multiplicité des entrées, les auteurs utilisent une architecture d’apprentissage par renforcement profond fondée sur un Deep Q‑Network, un type de réseau de neurones qui estime la qualité de chaque action possible dans chaque situation.

Des données brutes à des prévisions fiables

Pour tester leur approche, l’équipe s’est appuyée sur des données réelles de la PJM Interconnection, un grand marché électrique américain couvrant des parties du Midwest et de la côte Est. Ils ont utilisé environ trois ans d’enregistrements horaires (2021–2023), incluant les prix du marché, la demande d’électricité, les observations météorologiques et des indices de prix des carburants. Avant l’entraînement, ils ont nettoyé les données, comblé les rares valeurs manquantes, supprimé les valeurs aberrantes inhabituelles et mis tout à l’échelle dans des plages comparables. Ils ont aussi eu recours à des techniques statistiques pour compresser le grand nombre de variables d’entrée tout en conservant la majeure partie de la variation utile. L’agent d’apprentissage a ensuite été entraîné en passant à plusieurs reprises sur cet historique, passant progressivement d’essais aléatoires à l’exploitation des motifs découverts.

Performance de l’agent apprenant

Face à des méthodes de prévision couramment utilisées — notamment ARIMA (un modèle temporel traditionnel), les réseaux LSTM et l’algorithme populaire XGBoost — le système d’apprentissage par renforcement s’est imposé. Sur des données de test réservées que le modèle n’avait jamais vues, il a réduit les erreurs en pourcentage moyennes sur la demande et le prix d’environ 15 à 20 % par rapport à ces références. Les prévisions reproduisaient de près les cycles journaliers d’hiver et d’été et suivaient les variations générales des prix, même si le modèle éprouvait encore des difficultés face aux pics de prix les plus nets et aux comportements inhabituels lors des jours fériés. L’analyse de la stratégie apprise a montré que l’agent avait implicitement découvert un comportement économiquement cohérent : après avoir observé des prix très élevés, il avait tendance à anticiper une demande légèrement plus faible l’heure suivante, imitant une réponse à la demande réelle sans en avoir été explicitement informé.

Ce que cela implique pour la consommation d’énergie au quotidien

Pour les non‑spécialistes, le message clé est que cette approche basée sur l’apprentissage peut aider les opérateurs de réseau à faire fonctionner les systèmes électriques de façon plus fluide et moins coûteuse. Des prévisions à court terme plus précises permettent aux producteurs et aux gestionnaires de marché de programmer les centrales plus efficacement, d’intégrer les sources renouvelables avec moins de surprises et de réduire le risque de hausses de prix soudaines ou de pénuries. Bien que la méthode nécessite beaucoup de données et de puissance de calcul, et doive encore être améliorée pour les événements extrêmes, elle ouvre la voie à un futur où les marchés de l’électricité sont guidés par des outils adaptatifs et auto‑améliorants qui apprennent en continu du comportement toujours changeant des consommateurs, du temps et des coûts des carburants.

Citation: Wu, Y., Ma, Y. & Aliev, H. A novel reinforcement learning-based approach for short-term load and price forecasting in energy markets. Sci Rep 16, 5141 (2026). https://doi.org/10.1038/s41598-026-37366-5

Mots-clés: prévision du réseau intelligent, prévision du prix de l’électricité, apprentissage par renforcement, prévision de la demande d’énergie, deep Q-network