Clear Sky Science · fr

Rôle médiateur de l’exposition à l’intelligence artificielle dans les expériences adverses de l’enfance : risques de santé mentale liés chez les étudiants universitaires

Pourquoi l’enfance et les outils intelligents comptent

De nombreux étudiants universitaires portent des cicatrices invisibles d’enfances difficiles — comme des violences, de la négligence ou grandir dans un foyer perturbé. Parallèlement, ils figurent parmi les plus gros utilisateurs d’intelligence artificielle, des chatbots pour l’aide aux devoirs aux compagnons IA pour des conversations nocturnes. Cette étude pose une question d’actualité : lorsque des étudiants ayant vécu des expériences précoces douloureuses se tournent vers l’IA, cela allège‑t‑il leur fardeau ou s’ajoute‑t‑il discrètement à leur souffrance mentale ?

Grandir dans l’adversité

Les chercheurs se sont intéressés aux « expériences adverses de l’enfance », ou EAE — des événements tels que la violence, la négligence émotionnelle ou physique, et des problèmes familiaux graves avant 18 ans. Des travaux antérieurs montrent que plus une personne cumule ces événements, plus son risque d’anxiété, de dépression, et même de tentatives de suicide à l’âge adulte augmente. Dans les enquêtes mondiales, une part importante d’adultes, et une part encore plus élevée d’adolescents, déclarent au moins une de ces difficultés. En Chine, où l’étude a été menée, des recherches précédentes suggèrent que plus de la moitié des étudiants universitaires ont vécu au moins une EAE. Ce ne sont pas des exceptions rares mais un arrière‑plan courant du début de l’âge adulte.

Étudiants, questionnaires et temps d’écran

Pour explorer la place de l’IA dans ce tableau, l’équipe a enquêté auprès de 2 736 étudiants de trois universités de la province du Jiangxi, en Chine, en 2025. Les étudiants ont répondu à des questions détaillées sur leurs expériences d’enfance, leurs niveaux actuels de stress, d’anxiété, de dépression, de solitude, la qualité du sommeil et les pensées suicidaires. Ils ont aussi indiqué le temps quotidien passé à utiliser l’IA pour trois finalités : apprentissage ou travail (rédaction de travaux, aide en programmation), interaction sociale (discuter ou chercher de la compagnie auprès d’une IA), et divertissement (jeux ou création avec l’IA). Les chercheurs ont ensuite utilisé des techniques statistiques pour comparer équitablement les étudiants avec et sans EAE, rendant les deux groupes similaires en âge, sexe, filière et autres facteurs de contexte.

Lourds fardeaux et coping numérique

Les résultats confirment un schéma préoccupant : les étudiants ayant vécu des adversités infantiles présentent des niveaux plus élevés de solitude, stress, anxiété, dépression et pensées suicidaires, et dorment moins bien que leurs pairs. Mais l’étude va plus loin en examinant le rôle de l’IA. Elle montre que l’usage de l’IA à des fins sociales — et non pour les études — est associé à une moins bonne santé mentale. Les étudiants qui passaient plus de temps à discuter avec une IA ou à en chercher la compagnie virtuelle avaient tendance à se sentir plus déprimés, plus anxieux, plus stressés, plus seuls, et à déclarer davantage de pensées suicidaires. L’IA utilisée principalement pour l’apprentissage ou le travail n’a montré aucun lien net avec la santé mentale, et l’IA de divertissement n’était associée qu’à l’anxiété, pas aux autres problèmes.

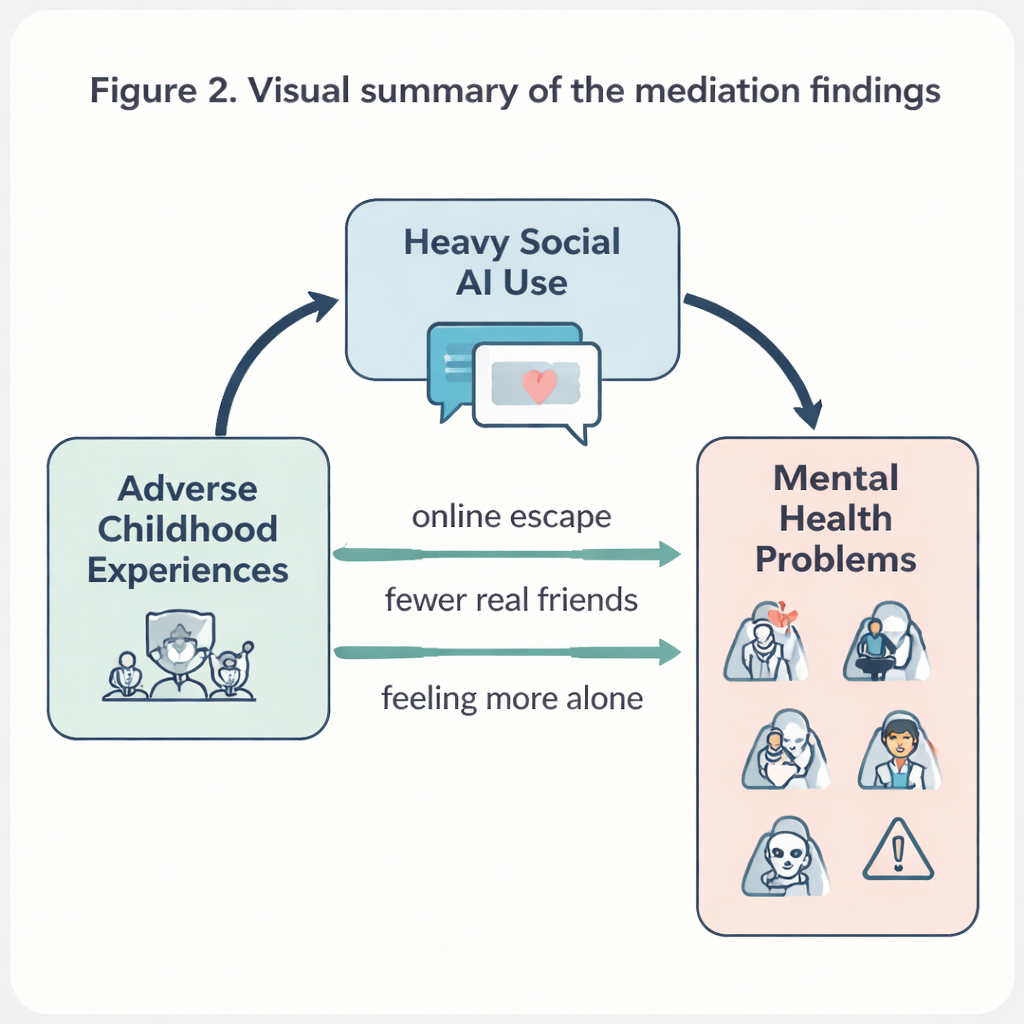

Quand le réconfort en ligne aggrave la douleur

À l’aide d’une méthode appelée analyse de médiation, les chercheurs ont testé si l’usage social de l’IA fonctionne comme une sorte de pont, transmettant une partie de l’impact des traumatismes précoces vers la santé mentale actuelle. Ils ont trouvé que c’est le cas — mais seulement partiellement. Pour les étudiants ayant des EAE, un usage social plus intensif de l’IA expliquait une petite mais significative portion de leur plus grande solitude, stress, anxiété, dépression et pensées suicidaires. Autrement dit, les traumatismes infantiles exerçaient encore un effet direct important sur la santé mentale, mais certains étudiants semblaient aussi faire face en se tournant vers la compagnie IA qui, au lieu de guérir leurs blessures, était associée à un mal‑être accru. Le schéma suggère un cycle : le préjudice précoce complique la vie sociale, les étudiants se replient dans des conversations sécurisées basées sur l’IA, et cette échappée numérique peut accroître l’isolement plutôt que le réduire.

Ce que cela signifie pour les étudiants et les aidants

Pour le lecteur général, la leçon n’est pas que l’IA est « mauvaise », mais que la façon dont on l’utilise importe, surtout pour les jeunes déjà à risque. Dans cette étude, près de trois étudiants sur dix ont déclaré des expériences adverses dans l’enfance, et ces étudiants étaient plus susceptibles de rencontrer des difficultés émotionnelles. L’usage social de l’IA semblait amplifier légèrement leurs problèmes plutôt que de les soulager. Les auteurs soutiennent que les programmes de santé mentale devraient prêter attention aux modes d’utilisation de l’IA, aider les étudiants à renforcer un soutien réel et les orienter vers des usages numériques plus sains. Conçue avec soin, une IA thérapeutique pourrait encore offrir des bénéfices. Mais les chatbots du quotidien, utilisés en substitution de la connexion humaine, peuvent discrètement approfondir la solitude et la détresse chez les personnes déjà le plus blessées.

Citation: Wang, Y., Lv, M., Huang, R. et al. Mediation role of artificial intelligence exposure in adverse childhood experiences: related mental health risks among college students. Sci Rep 16, 6278 (2026). https://doi.org/10.1038/s41598-026-37352-x

Mots-clés: expériences adverses de l’enfance, santé mentale des étudiants universitaires, usage social de l’IA, solitude et anxiété, coping numérique