Clear Sky Science · fr

RiemannInfer : améliorer l’inférence des transformers via la géométrie riemannienne

Pourquoi cela compte pour les utilisateurs d’IA au quotidien

Les chatbots et assistants IA modernes peuvent résoudre des problèmes mathématiques, rédiger des essais et même expliquer des sujets médicaux, mais nous ne savons toujours pas vraiment comment ils arrivent à leurs conclusions — ni comment rendre leur raisonnement plus fiable. Cet article présente « RiemannInfer », une nouvelle façon d’examiner les grands modèles de langage (LLM) en traitant leur activité interne comme un mouvement sur une surface géométrique courbée. Cette perspective offre non seulement une image plus intuitive de la façon dont ces systèmes « pensent », mais rend aussi leur raisonnement plus rapide et plus précis.

Transformer la pensée de l’IA en voyage géométrique

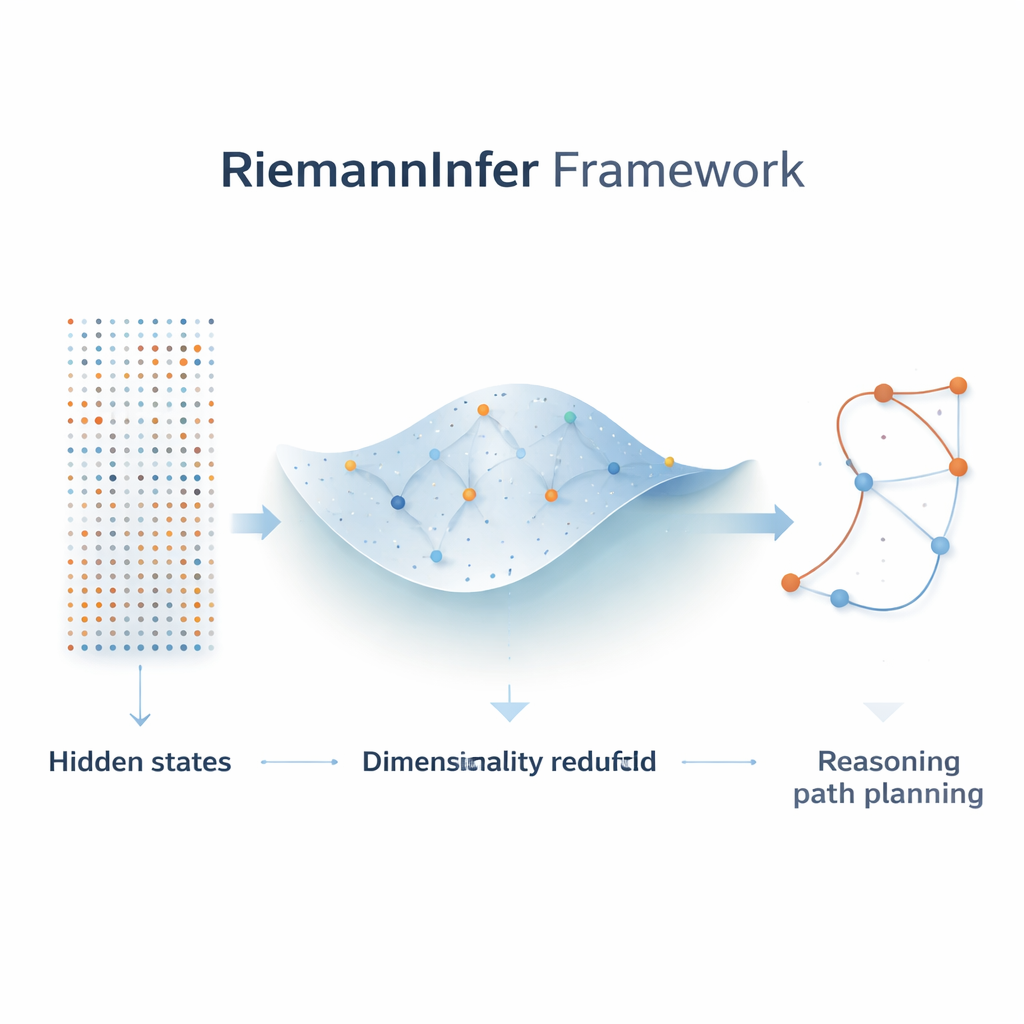

À l’intérieur d’un LLM comme GPT‑4 ou Llama, chaque mot d’une phrase est représenté par un vecteur de haute dimension, et des couches d’« attention » déterminent l’influence qu’ont les mots entre eux. Les auteurs observent que ces états cachés peuvent être vus comme des points dans un vaste espace dont la forme globale encode la compréhension du langage par le modèle. Plutôt que de considérer le raisonnement comme une suite de calculs de probabilité sur des textes, ils le réinterprètent comme un problème de recherche de trajectoire : le modèle se déplace d’un état initial (la question) à un état final (la réponse) le long d’un itinéraire dans cet espace. En utilisant des outils de la géométrie riemannienne — les mathématiques des surfaces courbées — ils construisent une variété courbée qui capture la façon dont les patrons d’attention plient et étirent ce paysage interne.

Compresser la complexité sans perdre la vue d’ensemble

Parce que l’espace interne brut d’un LLM est énorme, la première étape de RiemannInfer consiste à le réduire tout en préservant sa structure essentielle. Les auteurs combinent des techniques de topologie, qui étudient la façon dont les points se connectent, avec un algorithme populaire de réduction de dimension appelé UMAP. Avant de réduire le nombre de dimensions, ils analysent la « forme » du nuage d’états cachés pour s’assurer que les principaux motifs de connectivité survivent à la compression. Le résultat est un espace de dimension inférieure où les relations importantes entre les tokens — par exemple quels mots s’accordent une forte attention — sont en grande partie conservées. Cette carte géométrique compacte rend possible des calculs précis de distances, de plus courts chemins et de courbure.

Construire une carte courbée à partir de l’attention

L’innovation centrale consiste à traduire les poids d’attention en une mesure géométrique de distance. Quand le modèle accorde une forte attention entre deux tokens, RiemannInfer les traite comme proches sur la variété ; une faible attention les place plus éloignés. À partir de ces relations, les auteurs définissent une métrique — une règle mathématique qui détermine longueurs et angles — et l’utilisent pour calculer des géodésiques, l’équivalent courbé des lignes droites, ainsi que la courbure, qui mesure à quel point l’espace se plie. L’attention multi‑tête devient naturellement un mélange de plusieurs métriques, chacune capturant un aspect différent de la structure linguistique, comme la grammaire ou le sens. Avec cette construction, les décisions du modèle peuvent s’interpréter comme le choix de trajectoires particulières à travers un paysage dont les crêtes et les vallées reflètent où l’information est dense ou rare.

Planifier des chemins de raisonnement à faible effort

Une fois la variété construite, les auteurs reformulent le raisonnement comme la recherche d’un chemin « facile » de la question à la réponse — un chemin qui minimise le travail total effectué en cours de route. Ils empruntent une analogie à l’alpinisme : gravir un itinéraire raide et accidenté demande plus d’énergie que suivre une arête plus douce jusqu’au même sommet. Dans le contexte du LLM, la courbure joue le rôle de la raideur, et le travail de raisonnement du modèle correspond à la réduction de son incertitude interne le long d’un trajet. En utilisant des formules approximatives pour les géodésiques et la courbure, combinées à un algorithme de recherche de graphes efficace (l’algorithme de Dijkstra), RiemannInfer identifie rapidement les routes qui minimisent ce travail, guidant ainsi le modèle vers des chaînes de pensée plus efficaces.

Ce que montrent les expériences sur des modèles réels

Les auteurs testent RiemannInfer sur plusieurs LLMs de pointe, dont GPT‑4o, Llama‑3‑405B et DeepSeek‑V2‑400B, sur des bancs d’essai exigeants en mathématiques et en raisonnement tels que GSM8K, MATH500, StrategyQA et AGIEval. Dans tous les cas, l’encapsulation de ces modèles par le cadre RiemannInfer augmente leur précision de quelques points de pourcentage — de petits gains qui restent significatifs à la pointe de la performance — tout en conservant ou en améliorant légèrement la vitesse. Une comparaison avec une méthode purement linéaire et plus simple montre qu’ignorer la géométrie courbée des états cachés nuit dramatiquement aux performances, soulignant l’importance de la vue en variété.

Vue d’ensemble : donner au raisonnement de l’IA une sensation physique

Pour un lecteur non spécialiste, le principal enseignement est que les auteurs ont transformé le fonctionnement opaque des grands modèles de langage en quelque chose de plus tangible : un voyage à travers un paysage courbé où un bon raisonnement correspond à suivre des sentiers lisses et à faible effort. En ancrant les patrons d’attention et les étapes de raisonnement dans des concepts géométriques et physiques — distance, courbure et travail — RiemannInfer offre à la fois un moyen pratique d’améliorer les résultats et un pont conceptuel entre l’IA et la physique des espaces continus. Bien que les méthodes actuelles soient approximatives et que de nombreux détails restent à affiner, ce cadre ouvre la voie à des systèmes d’IA futurs dont les processus de pensée pourront être analysés, optimisés, et peut‑être même conçus en utilisant le langage de la géométrie et de la physique.

Citation: Mao, R., Zhang, Z., Yang, M. et al. RiemannInfer: improving transformer inference through Riemannian geometry. Sci Rep 16, 6636 (2026). https://doi.org/10.1038/s41598-026-37328-x

Mots-clés: grands modèles de langage, apprentissage profond géométrique, variété riemannienne, mécanismes d’attention, efficacité du raisonnement