Clear Sky Science · fr

Quand les LLM parlent ZigBee : explorer des modèles à faible latence et de raisonnement pour la génération de trafic réseau

Les maisons connectées ont besoin de répétitions crédibles

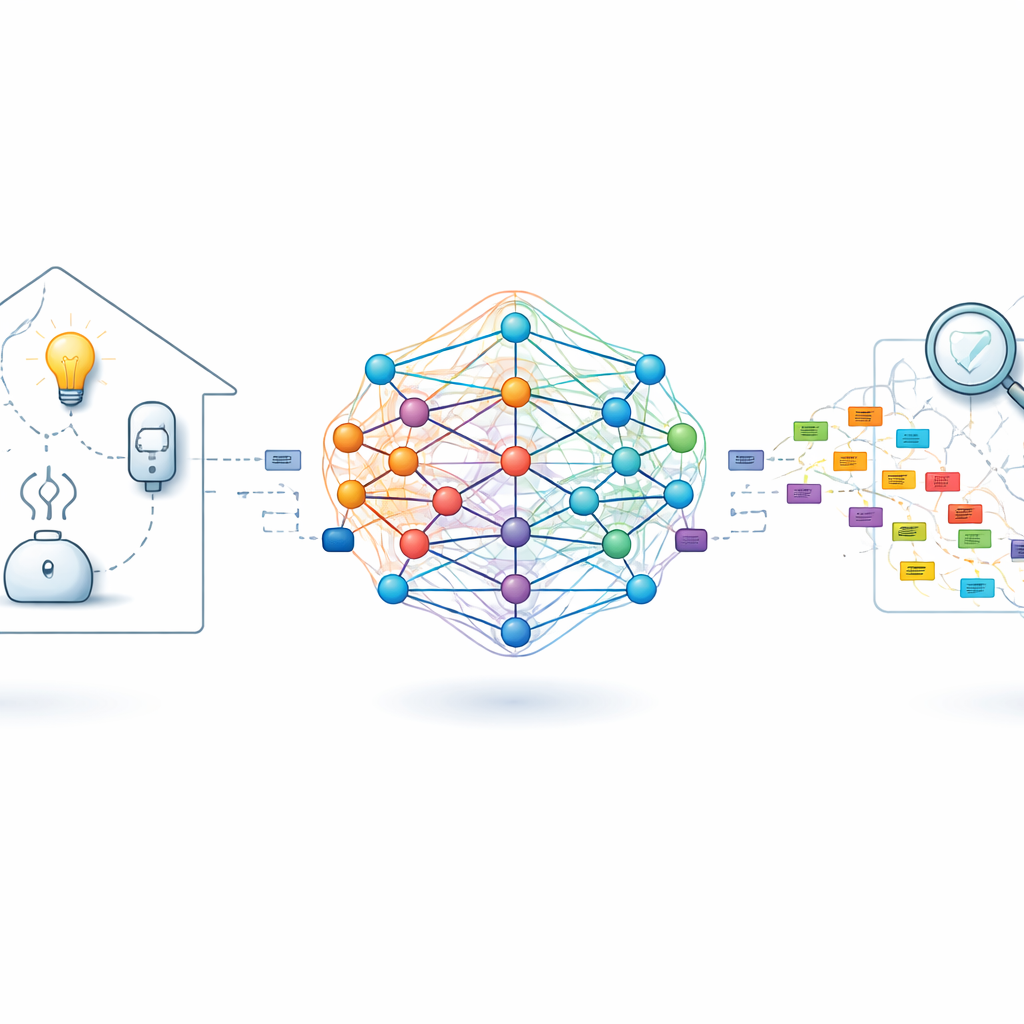

À mesure que nos logements se remplissent d’ampoules, de prises et de capteurs intelligents, les échanges invisibles entre ces appareils deviennent à la fois une source de confort et un point faible potentiel. Les ingénieurs qui conçoivent et sécurisent ces systèmes ont besoin de moyens sûrs pour « répéter » le comportement des réseaux dans des conditions réelles, y compris des anomalies rares et des cyberattaques. Cet article explore si les modèles d’IA modernes — les mêmes que ceux utilisés pour les chatbots — peuvent être réorientés pour générer un trafic réseau de maison intelligente réaliste, offrant aux chercheurs un banc d’essai puissant sans avoir à enregistrer tous les scénarios possibles à partir de maisons réelles.

Du langage humain aux conversations des appareils

L’étude se concentre sur ZigBee, une norme sans fil populaire utilisée pour les ampoules connectées, les prises et les détecteurs de mouvement. Plutôt que de générer du texte ordinaire, les auteurs fournissent aux grands modèles de langage (LLM) d’OpenAI, en particulier GPT‑4.1 et GPT‑5, des paquets ZigBee d’exemple — des enregistrements horodatés de qui communique avec qui, et quels champs de protocole sont utilisés. Ces modèles traitent chaque paquet comme une « phrase » structurée et apprennent les motifs dans la façon dont les appareils et le hub central communiquent dans le temps. L’objectif n’est pas seulement d’imiter des statistiques basiques comme la taille moyenne des paquets, mais de produire un nouveau trafic qui respecte les règles strictes de ZigBee, utilise des adresses d’appareil valides et conserve des schémas de temporisation et de requêtes‑réponses réalistes.

Deux expériences : émission unidirectionnelle et dialogue complet

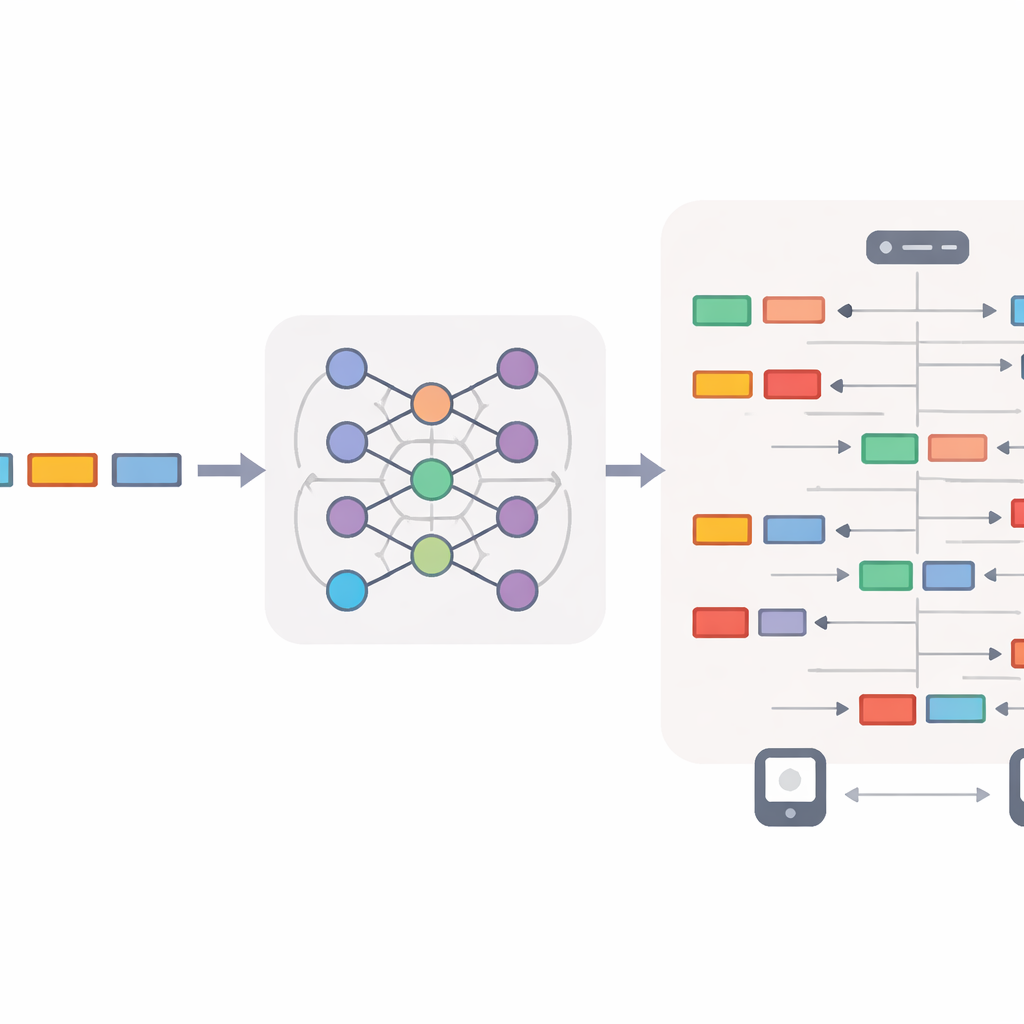

Pour tester cette idée, les chercheurs conçoivent deux expériences principales en utilisant un grand jeu de données réel de maison connectée appelé ZigBeeNet, qui contient environ 25 millions de paquets collectés depuis 15 appareils sur 20 jours. Dans la première expérience, ils étudient la communication unidirectionnelle d’une ampoule intelligente vers le hub, en n’apprenant au LLM que les dix premières minutes de trafic réel comme exemples. Dans la seconde, ils passent à un scénario plus réaliste où l’ampoule et le hub échangent des messages dans les deux sens, y compris des diffusions émises par le hub. Dans les deux cas, un petit ensemble de paquets d’exemple est présenté au modèle dans l’invite (few‑shot learning), et le modèle doit produire de plus longues séquences entièrement nouvelles qui peuvent être reconverties en fichiers standard de capture de paquets et analysées avec des outils réseau courants.

Guider le modèle avec des règles et des contrôles humains

Parce qu’un champ mal placé ou un horodatage hors séquence peut briser l’illusion de réalisme, l’équipe construit un dispositif soigné d’invite et de rétroaction. D’abord, ils filtrent et exportent les paquets réels, puis rédigent des invites qui précisent les adresses d’appareils autorisées, les types de messages et les formats temporels. Dans une phase initiale, un expert humain examine la sortie du modèle, recherchant des problèmes tels que des adresses invalides, des numéros de séquence impossibles ou des trous dans la chronologie. Plutôt que de corriger manuellement les paquets, ils traduisent ces constats en règles plus strictes pour l’invite — par exemple, interdire à un appareil d’envoyer à lui‑même ou exiger que le nombre de paquets reste dans une fourchette réaliste. Une fois les règles stabilisées, les invites sont « figées » et réutilisées sans modification afin que les expériences ultérieures soient entièrement automatiques et reproductibles.

Opposer les LLM à des générateurs plus anciens

Pour vérifier si les LLM apportent réellement une valeur ajoutée, les auteurs comparent GPT‑4.1 et GPT‑5 à deux approches classiques de deep learning : les réseaux neuronaux récurrents (RNN) et les réseaux antagonistes génératifs (GAN), tous deux adaptés pour générer des séquences de type ZigBee. Ils évaluent tous les modèles selon de nombreuses dimensions : la proximité des temps d’inter‑arrivée avec le trafic réel, la décodabilité des paquets dans des outils standards, le respect des règles de protocole et des rôles des appareils, la fréquence de répétition des paquets et la propension à recopier exactement des exemples d’entraînement. Les résultats montrent que les deux modèles GPT produisent un trafic presque parfaitement décodable et conforme au protocole avec une faible divergence par rapport aux schémas temporels réels, tandis que les RNN peinent sur l’ordre à long terme et que les GAN génèrent souvent un trafic irréaliste, trop dense ou sémantiquement invalide, en particulier pour la communication bidirectionnelle et sur de longues durées.

Quand plus de « réflexion » n’aide pas

L’étude explore aussi une question surprenante : donner à GPT‑5, orienté vers le raisonnement, plus de « temps de réflexion » interne améliore‑t‑il le réalisme du trafic réseau ? En modulant l’effort de raisonnement caché de GPT‑5 de bas à élevé, les auteurs constatent qu’un effort plus important rend le modèle plus lent et plus verbeux, mais n’améliore pas — et nuit parfois — à la proximité du trafic généré avec la réalité. GPT‑4.1, un modèle non orienté raisonnement mais plus rapide, égal ou surpasse systématiquement GPT‑5 sur les métriques de qualité clés tout en consommant moins de ressources computationnelles. Sur des simulations prolongées de 30 minutes, les deux LLM conservent un comportement ZigBee correct, tandis que les baselines classiques RNN et GAN dévient fortement en termes de temporisation et de conformité au protocole.

Ce que cela signifie pour des maisons connectées plus sûres

Pour les non‑spécialistes, le message principal est que les modèles de langage modernes peuvent apprendre non seulement les conversations humaines mais aussi le « langage » des appareils de maison intelligente, générant à la demande un trafic crédible et conforme aux règles. Le travail montre qu’un modèle relativement rapide et à faible latence comme GPT‑4.1 peut déjà servir de générateur de trafic haute fidélité pour les tests et l’évaluation de sécurité, réduisant potentiellement le besoin de capturer des données sensibles du monde réel. Il souligne aussi que le raisonnement plus complexe et coûteux n’est pas toujours préférable : pour des tâches techniques fortement structurées, des modèles plus simples et efficaces peuvent être le meilleur choix. À mesure que les auteurs publient leur code et leurs données, cette approche pourrait aider les chercheurs du monde entier à tester la résistance des systèmes domotiques, améliorer la détection d’intrusions et explorer de nouvelles architectures réseau dans un terrain d’essai synthétique et sûr.

Citation: Keleşoğlu, N., Sobczak, Ł. & Domańska, J. When LLMs speak ZigBee: exploring low-latency and reasoning models for network traffic generation. Sci Rep 16, 8036 (2026). https://doi.org/10.1038/s41598-026-37246-y

Mots-clés: domotique IoT, génération de trafic ZigBee, grands modèles de langage, tests de sécurité réseau, données réseau synthétiques