Clear Sky Science · fr

Un cadre de fusion hiérarchique pour la gestion de l’énergie véhicule‑vers‑réseau utilisant l’intelligence prédictive et une tarification basée sur l’apprentissage

Pourquoi votre voiture pourrait aider à maintenir l’électricité

La plupart des gens considèrent une voiture électrique comme un moyen plus propre d’aller d’un point A à un point B. Cet article explore une idée plus vaste : et si des millions de véhicules électriques (VE) stationnés pouvaient discrètement aider à gérer le réseau électrique ? En programmant le moment des recharges et en autorisant éventuellement le renvoi d’énergie vers le réseau, les auteurs montrent comment un logiciel intelligent peut réduire les coûts d’électricité, alléger la pression sur le réseau et mieux exploiter l’énergie solaire et éolienne.

Voitures, prises et une rue à double sens

Le point de départ est un concept appelé véhicule‑vers‑réseau, ou V2G. Au lieu de simplement consommer de l’électricité, un VE peut aussi agir comme une petite batterie pour le réseau, se charger quand l’électricité est bon marché et abondante et décharger quand la demande est élevée. Cela paraît simple, mais en pratique c’est un exercice d’équilibriste : les conducteurs ont besoin de leur voiture prête, les prix évoluent heure par heure, et la production solaire et éolienne fluctue avec la météo. Aujourd’hui, la plupart des systèmes traitent ces aspects séparément, ce qui conduit à des économies manquées et à une tension inutile sur les lignes électriques.

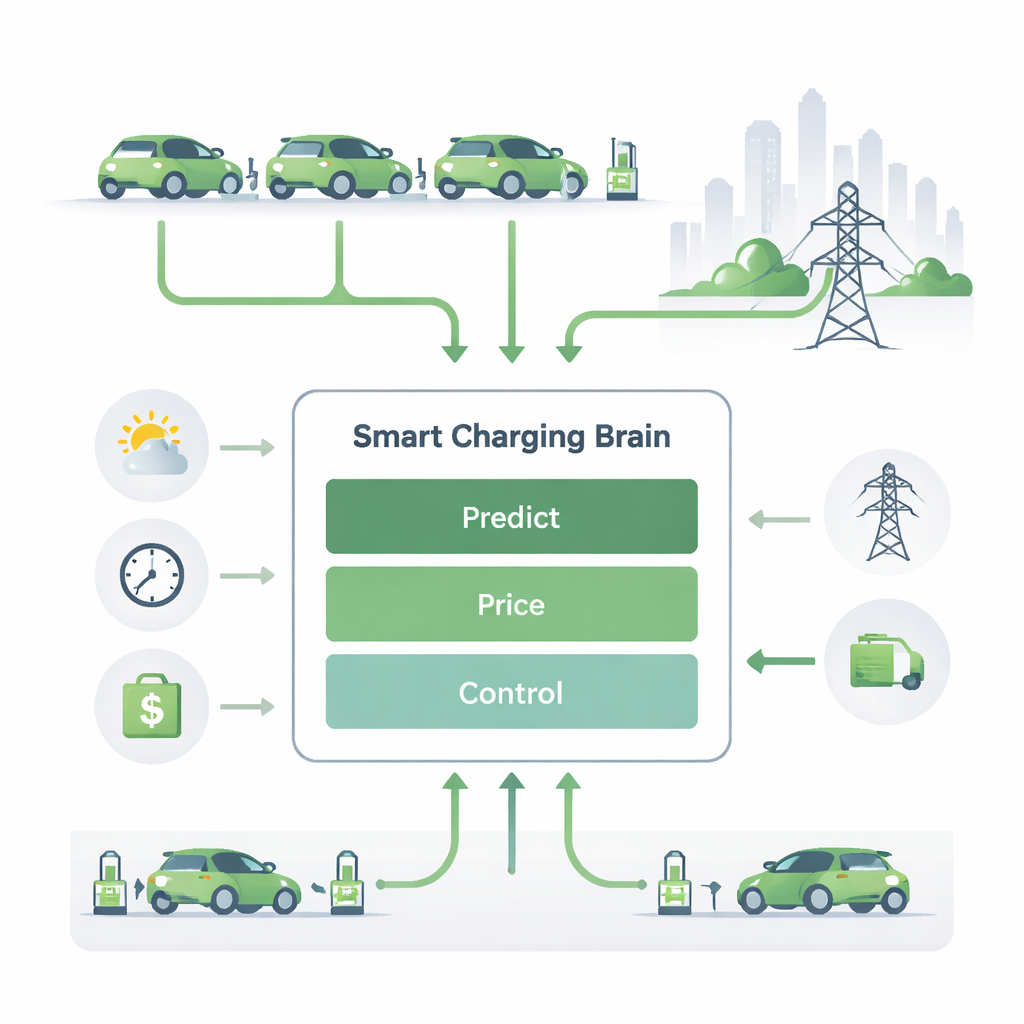

Laisser les machines anticiper

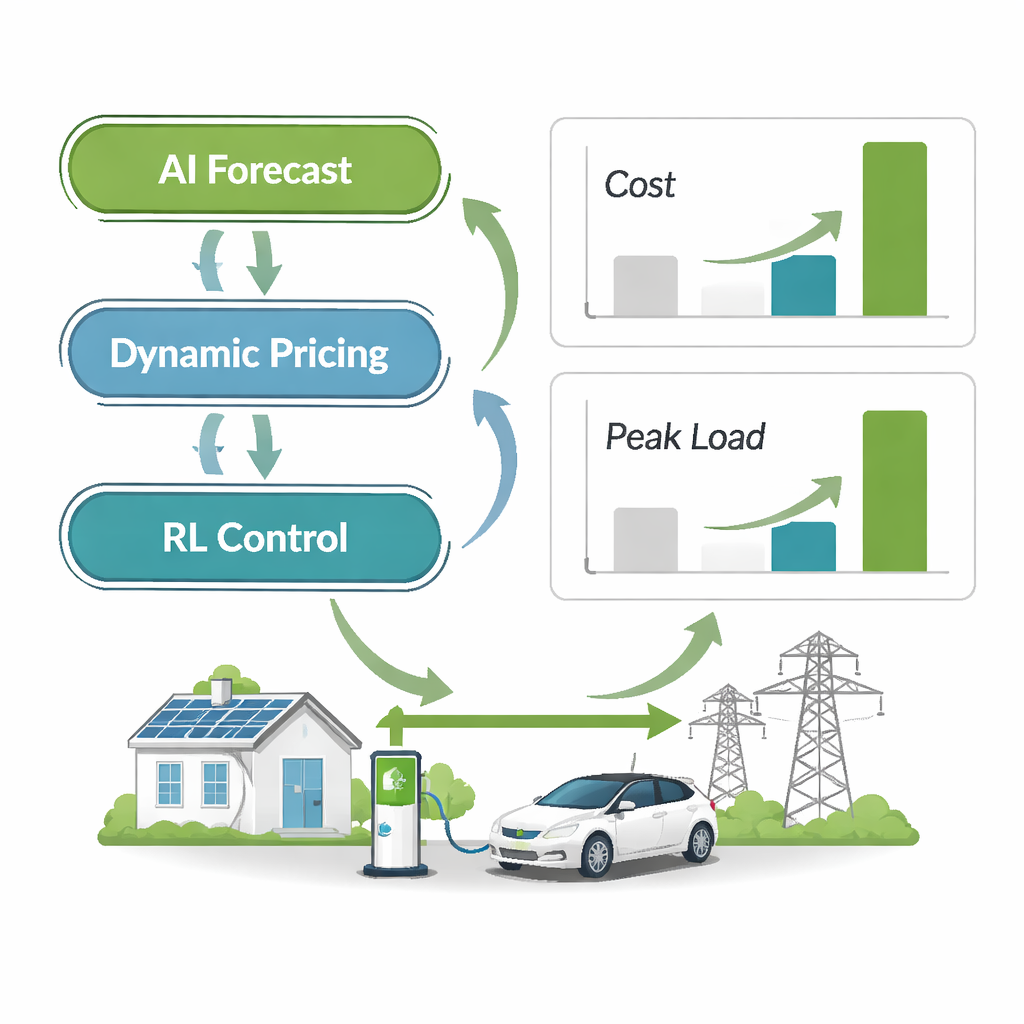

Le premier bloc du cadre proposé est un module d’intelligence artificielle qui regarde le proche avenir. Il apprend des schémas passés de la demande du réseau, de la météo, de la production renouvelable, des prix de l’électricité et des habitudes des conducteurs pour prédire quand l’énergie sera bon marché ou chère et quand les voitures seront probablement branchées. À partir de ces prévisions, il élabore un plan de recharge : remplir les batteries pendant les heures de faible demande et de bas prix, renvoyer de l’énergie lorsque la demande et les prix culminent, et laisser la voiture inactive le reste du temps. Dans les simulations, cette approche prédictive lisse les pics de recharge, réduit la contrainte sur les équipements et permet malgré tout d’avoir les batteries chargées à temps.

Transformer les prix en signaux, pas en surprises

La deuxième composante puise dans l’économie pour fixer des prix qui incitent chacun à aller dans une direction utile. Ici, les propriétaires de VE, les opérateurs de réseau et le marché de l’électricité sont traités comme des acteurs d’un jeu. Chaque voiture peut soumettre une « enchère » simple pour le moment où elle souhaite charger ou vendre de l’énergie, en fonction du niveau de la batterie et des prix en vigueur. La couche de tarification ajuste ensuite les tarifs en temps réel de sorte que, lorsque le réseau est sous pression, vendre de l’énergie depuis les voitures devienne plus attrayant, et lorsque le réseau est détendu, la recharge devienne bon marché. Cette méthode récompense la flexibilité des conducteurs, décourage les recharges massives simultanées et maintient la demande globale dans des limites sûres.

Apprendre en pratiquant

La troisième couche est un contrôleur d’apprentissage par renforcement, une branche de l’intelligence artificielle utilisée également pour des robots joueurs de jeu. Le contrôleur « voit » l’état actuel de chaque voiture et du réseau — niveau de batterie, demande, prix et heure — et doit choisir de charger, décharger ou attendre. Il reçoit des récompenses pour des choix utiles, comme charger quand l’énergie est bon marché ou décharger en cas de pénurie, et des pénalités pour des actions gaspillantes. Au fil de nombreux jours simulés, il découvre des stratégies qui permettent d’économiser de l’argent et de soutenir le réseau, même lorsque les conditions changent de façon inattendue, par exemple lors d’une chute soudaine de la production éolienne.

Empiler des cerveaux plutôt que n’en choisir qu’un

L’avancée clé de ce travail est que ces trois méthodes ne fonctionnent pas isolément. La couche de prévision influence les prix que le module de théorie des jeux est autorisé à fixer, de sorte que les tarifs restent réalistes. Ces prix deviennent, à leur tour, une partie de l’information utilisée par le contrôleur d’apprentissage pour décider de son action suivante. Cette « fusion hiérarchique » crée un pipeline de décision unique et coordonné au lieu de trois systèmes concurrents. Testé face à d’autres approches populaires — y compris la prévision avancée seule, l’apprentissage multi‑agent et les techniques d’optimisation standard — le système fusionné a systématiquement offert des coûts de recharge plus faibles et des charges sur le réseau plus lisses, tout en maintenant des temps d’attente des conducteurs courts.

Ce que cela signifie pour les conducteurs et le réseau

Pour le grand public, la conclusion est simple : avec le bon logiciel, les voitures électriques stationnées peuvent discrètement gagner de l’argent et aider à stabiliser le réseau, sans que les conducteurs n’aient à y penser. L’étude montre que la combinaison de la prédiction, d’une tarification intelligente et d’un contrôle adaptatif peut réduire les factures, atténuer les pics de consommation et mieux exploiter l’énergie propre. Bien que les résultats reposent sur des simulations et que des essais réels et des études sur l’usure des batteries soient encore nécessaires, le cadre dessine un avenir où votre voiture n’est pas seulement un moyen de transport — elle est aussi une petite centrale électrique intelligente qui coopère avec des millions d’autres pour soutenir un système énergétique plus fiable et durable.

Citation: Nandagopal, V., Bhaskar, K., Periakaruppan, S. et al. A hierarchical fusion framework for vehicle to grid energy management using predictive intelligence and learning based pricing. Sci Rep 16, 6019 (2026). https://doi.org/10.1038/s41598-026-37243-1

Mots-clés: vehicle-to-grid, smart charging, electric vehicles, dynamic pricing, reinforcement learning