Clear Sky Science · fr

Dérive d'interprétation dans l'IA explicable sous bruit d'étiquettes

Pourquoi les explications de l'IA peuvent silencieusement dérailler

Beaucoup de personnes s'appuient désormais sur l'intelligence artificielle non seulement pour obtenir des réponses, mais aussi des raisons : pourquoi un prêt a-t-il été refusé ? Pourquoi un système a-t-il signalé un patient comme à haut risque ? Cette étude montre que même quand la précision d'un modèle d'IA semble rassurante et stable, le récit qu'il donne sur pourquoi il a pris une décision peut dériver de façon spectaculaire si les données d'entraînement comportent des erreurs. Ce changement caché dans les explications — que les auteurs appellent « dérive d'interprétation » — pourrait induire en erreur les professionnels qui comptent sur l'IA pour justifier des décisions importantes.

Quand des données propres rencontrent des étiquettes brouillonnes

La plupart des systèmes d'IA modernes sont des « boîtes noires », fournissant des prédictions sans raisons claires. Pour rendre l'IA plus transparente, de nombreuses applications recourent à des modèles basés sur des règles qui ressemblent au raisonnement humain du type si–alors : par exemple, « si la tension artérielle est élevée et l'âge est supérieur à 60 ans, alors le risque est élevé ». Ces ensembles de règles sont particulièrement attractifs dans des domaines sensibles comme la santé, le droit et la finance, où les utilisateurs doivent pouvoir inspecter et faire confiance à la logique. Mais les données du monde réel sont rarement parfaites. Un problème courant est le bruit d'étiquettes — des cas où la « bonne réponse » dans les données d'entraînement est erronée, comme un diagnostic mal enregistré ou un résultat client mal étiqueté. Si l'on sait que le bruit d'étiquettes affecte la qualité des prédictions, son impact sur la stabilité des explications de l'IA n'avait pas été étudié systématiquement.

Tester la résistance des explications au bruit

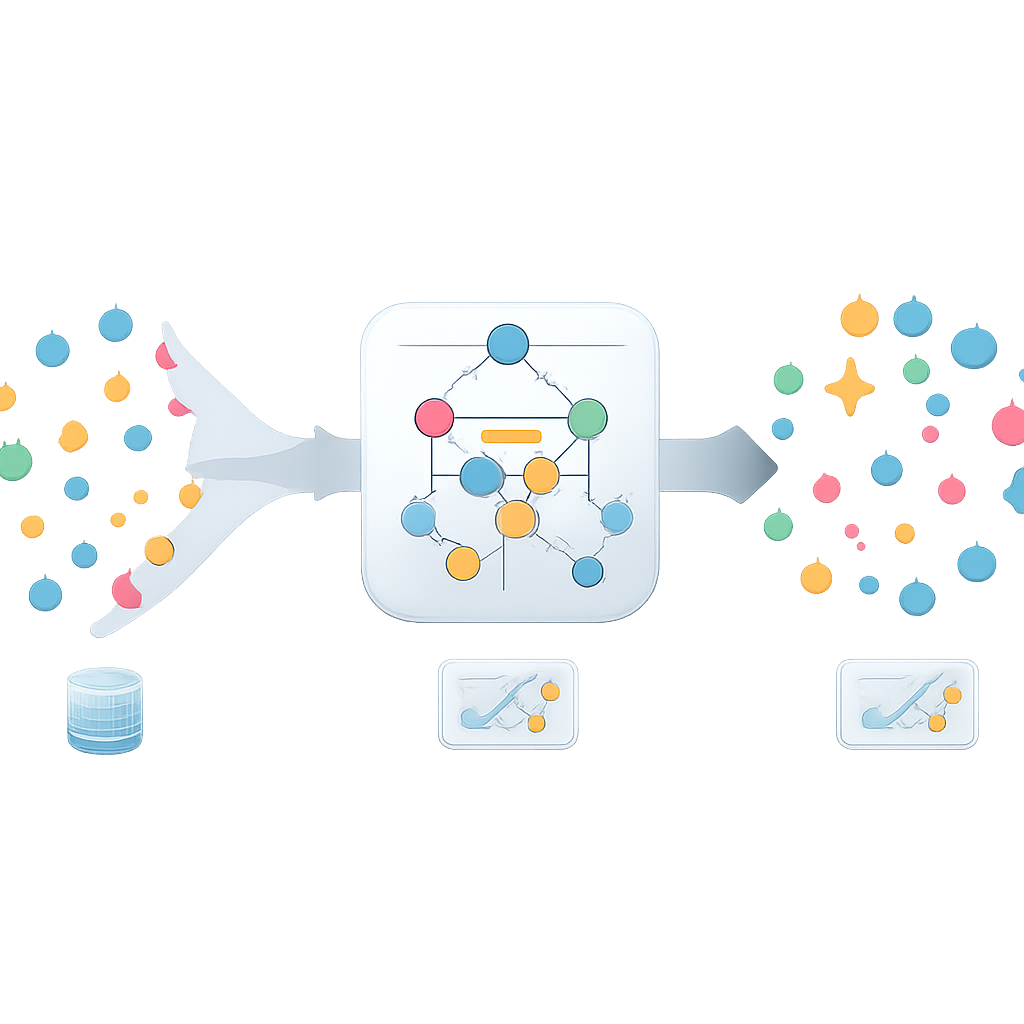

Les auteurs ont évalué la robustesse des explications fondées sur des règles lorsque les étiquettes sont progressivement corrompues. Ils ont utilisé quatre jeux de données différents issus de la santé, de la banque, des maladies du foie et même de la théorie des nombres, tous organisés comme des tâches de prédiction oui–non. Trois méthodes d'apprentissage de règles ont été comparées : deux algorithmes populaires et rapides (IREP et RIPPER) et une approche plus coûteuse en calcul appelée Human Knowledge Models (HKM), qui vise explicitement à produire des ensembles de règles très simples et de type humain. Pour chaque méthode, les chercheurs ont entraîné les modèles à plusieurs reprises en inversant aléatoirement une fraction croissante des étiquettes d'entraînement — depuis des données presque parfaitement propres jusqu'à des étiquettes presque complètement erronées. Ils ont suivi deux éléments en parallèle : la qualité des prédictions sur un jeu de test propre et l'ampleur des changements dans les règles apprises par rapport à celles obtenues sans bruit.

Précision stable, logique en mouvement

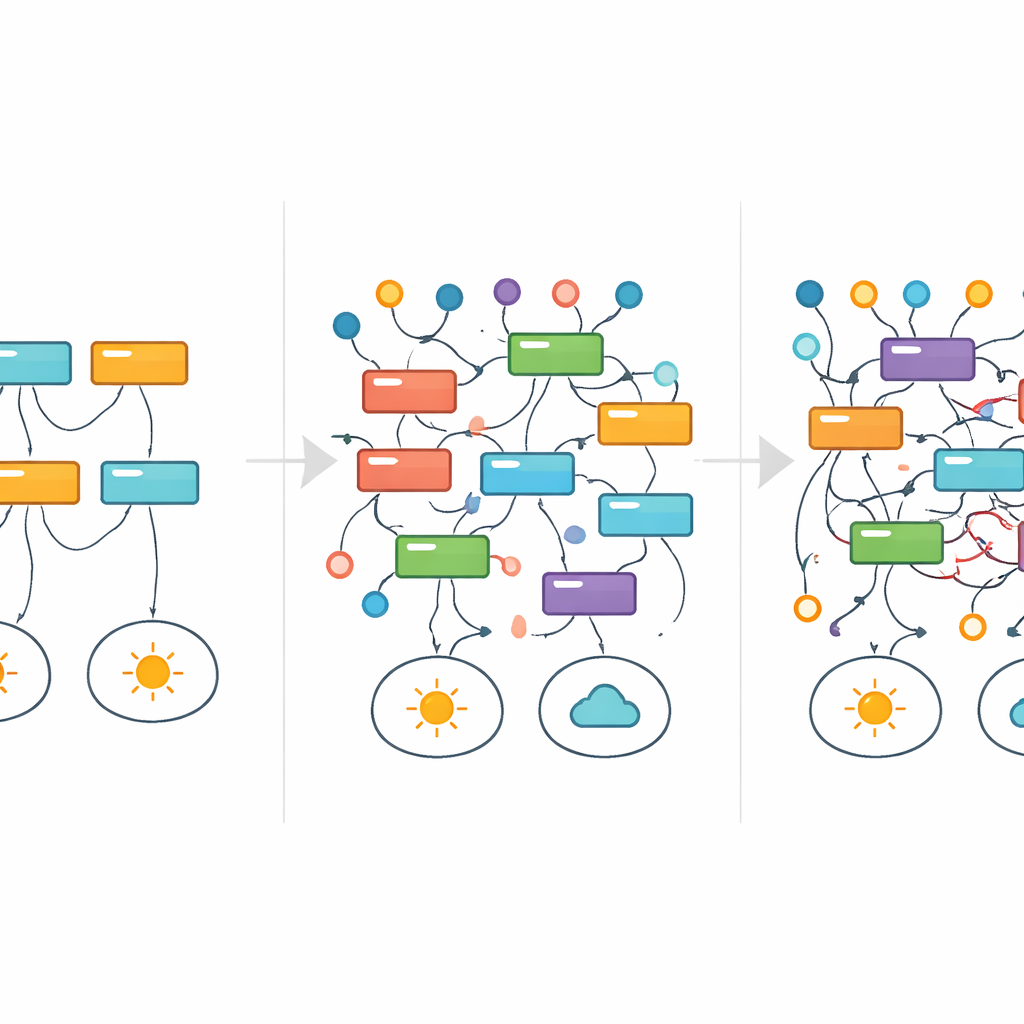

En surface, les résultats peuvent donner aux utilisateurs un faux sentiment de sécurité. Pour des niveaux de bruit modérés, en particulier avec la méthode HKM, la performance prédictive semblait relativement stable lorsqu'elle était mesurée par le score F1 courant. Mais un examen plus attentif des ensembles de règles donnait une image différente. En utilisant une mesure de similarité comparant des collections de règles, les auteurs ont constaté que même des quantités modestes de bruit d'étiquettes érodaient rapidement le recoupement entre les explications initiales et celles issues des données bruitées. Autrement dit, le modèle peut encore être correct sur de nombreux cas, mais pour des raisons de plus en plus différentes. Les ensembles de règles plus complexes se sont révélés particulièrement fragiles : à mesure que le nombre de conditions dans une règle augmentait, de petits changements dans les données fracturaient ou remplaçaient plus facilement ces règles, accélérant la perte de stabilité de l'interprétabilité.

Suivre les règles qui apparaissent et disparaissent

Pour visualiser comment des explications individuelles survivent ou échouent à mesure que le bruit augmente, les chercheurs ont emprunté un outil à la médecine : l'analyse de survie. Plutôt que de suivre la survie des patients au fil du temps, ils ont suivi combien de temps une règle particulière continuait d'apparaître parmi les meilleurs modèles à mesure que le bruit d'étiquettes augmentait. Plutôt que de s'estomper en douceur, de nombreuses règles clignotaient — un signe que des explications entièrement différentes pouvaient dominer à différents niveaux de bruit, même pour la même tâche de base. Dans un jeu de données simple sur la divisibilité des nombres, par exemple, des règles propres et mathématiquement correctes ont été progressivement remplacées par des approximations plus larges puis, finalement, par des schémas alambiqués et apparemment arbitraires qui correspondaient néanmoins aux étiquettes corrompues. Pendant une grande partie de ce processus, les métriques de performance habituelles ne signalèrent pas clairement qu'il y avait un problème.

Ce que cela signifie pour les personnes qui s'appuient sur l'IA

Le message central est que l'IA « digne de confiance » ne peut pas être jugée sur la seule base de la précision. Même les modèles qui présentent leur logique sous forme de règles lisibles par des humains peuvent changer silencieusement leur raisonnement quand les étiquettes dont ils apprennent sont imparfaites — ce qui est précisément la situation dans la plupart des bases de données réelles. Les auteurs soutiennent que les développeurs et les régulateurs devraient considérer la stabilité des explications comme une exigence de premier ordre, au même titre que la précision et l'équité. De nouvelles métriques mesurant directement la cohérence des explications sous bruit, ainsi que des outils qui alertent les utilisateurs de la dérive d'interprétation, seront essentiels si l'on veut des systèmes d'IA dont les récits sur le monde soient aussi fiables que leurs prédictions.

Citation: Raikovskaia, A., Rakhimzhanov, N. & Pianykh, O.S. Interpretation drift in explainable AI under label noise. Sci Rep 16, 8528 (2026). https://doi.org/10.1038/s41598-026-37070-4

Mots-clés: IA explicable, bruit d'étiquettes, interprétabilité des modèles, modèles basés sur des règles, dérive d'interprétation