Clear Sky Science · fr

Évaluer les vulnérabilités des systèmes de marche via des attaques adversariales générées par PPO et GAN

Pourquoi tromper un motif de marche compte

La plupart d’entre nous reconnaissent amis et membres de la famille à leur façon de marcher, même à distance. Les ordinateurs peuvent aujourd’hui faire quelque chose de similaire : les systèmes de « reconnaissance de la démarche » analysent le style de marche d’une personne pour l’identifier sans empreintes digitales ni scan du visage. Ces outils sont de plus en plus utilisés en sécurité et en surveillance. Cette étude pose une question perturbante : est‑il facile de tromper ces systèmes à l’aide de petits changements soigneusement conçus que l’œil humain ne remarque pas — mais que les machines détectent ? La réponse a de grandes conséquences pour la vie privée, la sécurité et le degré de confiance qu’on peut accorder à l’intelligence artificielle dans des contextes à forts enjeux.

Comment les ordinateurs lisent notre façon de marcher

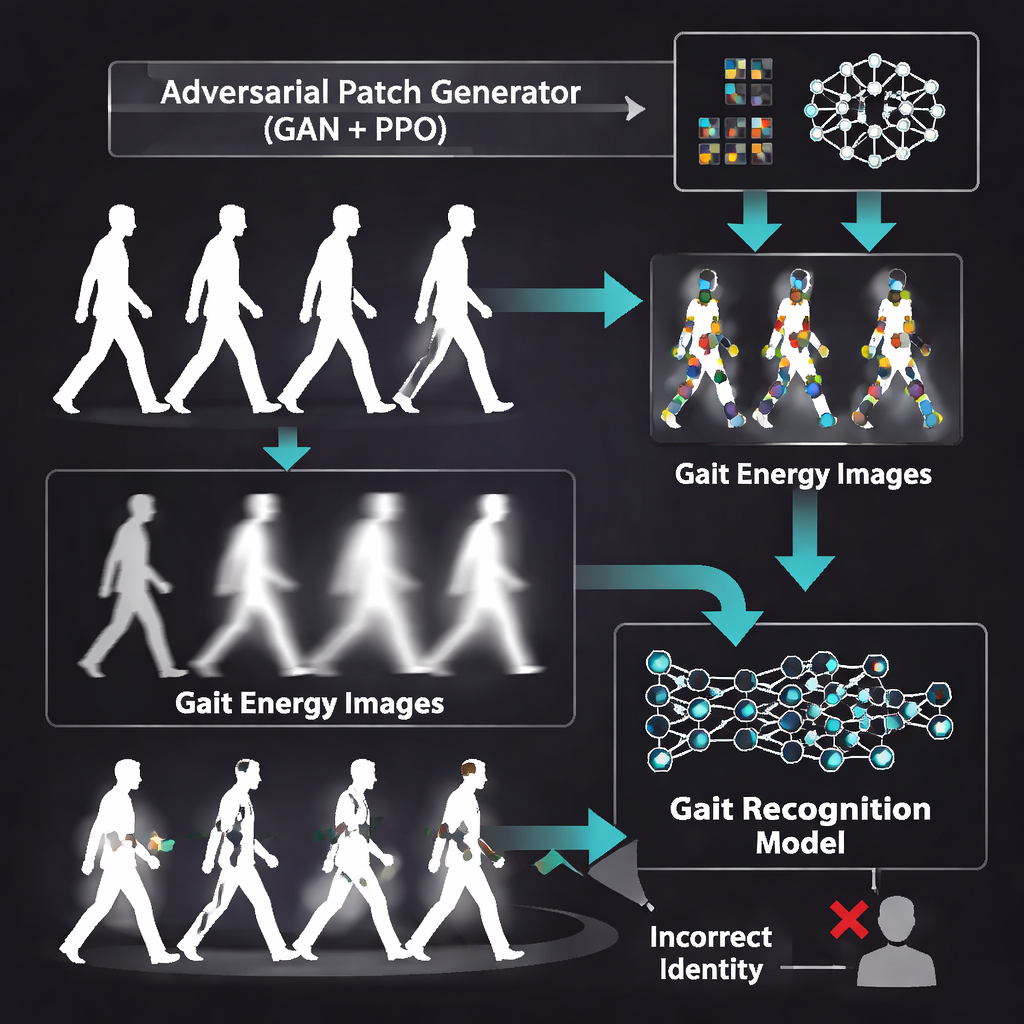

La reconnaissance moderne de la démarche repose sur l’apprentissage profond, la même famille de techniques que ceux utilisés pour la reconnaissance faciale ou les voitures autonomes. Plutôt que d’examiner un instantané, ces systèmes combinent de nombreuses images d’une personne en marche pour former une « image d’énergie de la démarche », une sorte de silhouette floue qui capture le mouvement des parties du corps sur un cycle complet de pas. Un réseau de neurones spécialement conçu apprend ensuite à distinguer la démarche d’une personne de celle d’une autre, même lorsque les vêtements ou les objets portés changent. Lors d’essais sur deux grandes collections de vidéos de marche (les ensembles CASIA‑B et OU‑ISIR), le modèle de référence des auteurs a correctement identifié les personnes dans plus de 97 % des cas — une performance élevée qui pourrait laisser penser que la technologie est prête pour un déploiement réel.

Les autocollants invisibles qui trompent les caméras intelligentes

Le cœur de l’article n’est pas de construire un meilleur système d’identification, mais de le briser intentionnellement pour exposer ses faiblesses. Les chercheurs génèrent de petites « pastilles adversariales » — des régions carrées de pixels modifiés qui paraissent inoffensives, mais sont mathématiquement ajustées pour perturber le réseau de neurones. Pour créer ces pastilles, ils utilisent un réseau antagoniste génératif (GAN), un type d’IA qui apprend à produire des images réalistes en se confrontant à un critique interne. Le GAN est entraîné directement sur les images d’énergie de la démarche de sorte que sa production se fonde naturellement dans les silhouettes fantomatiques. Ces pastilles sont conçues pour être suffisamment subtiles pour qu’un observateur humain ne remarque probablement rien d’anormal en regardant la démarche.

Laisser un agent apprenant trouver les points faibles

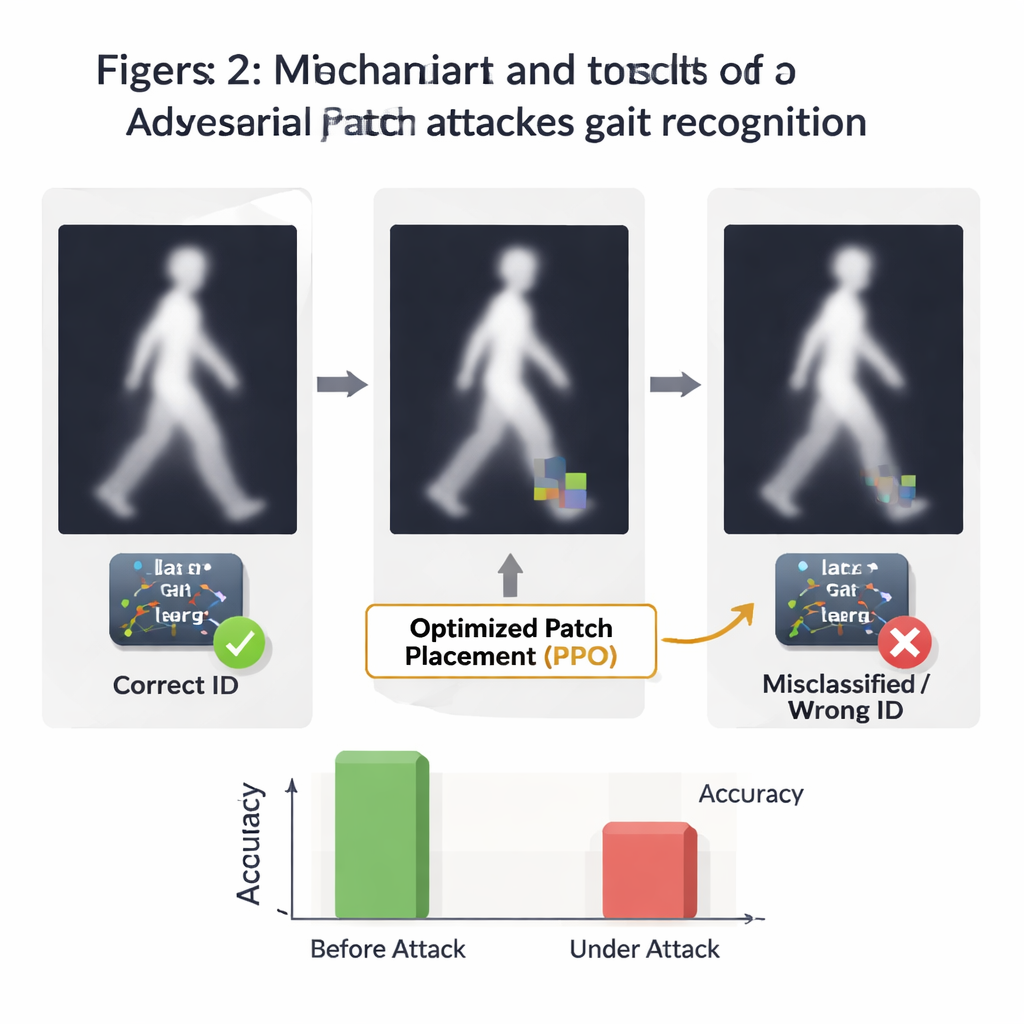

L’emplacement d’une pastille peut importer autant que son apparence. Pour découvrir les emplacements les plus dommageables, les auteurs recourent à une méthode d’apprentissage par renforcement appelée Proximal Policy Optimization (PPO). Ils traitent chaque image de démarche comme un environnement en forme de grille et laissent un « agent » logiciel déplacer la pastille — vers le haut, le bas, la gauche ou la droite — tout en observant de combien la confiance du système de reconnaissance diminue. Lorsqu’une position entraîne une mauvaise identification de la personne, l’agent est récompensé ; lorsqu’elle échoue, il est pénalisé. Au fil de nombreux épisodes, l’agent apprend une stratégie de placement des pastilles dans des régions particulièrement vulnérables de l’image de démarche, souvent près des parties du corps en mouvement sur lesquelles le modèle s’appuie le plus.

Que se passe‑t‑il lorsque l’attaque est lancée

Après avoir entraîné à la fois le générateur de pastilles et la stratégie de placement, l’équipe attaque son propre système de reconnaissance de la démarche performant. Dans des conditions normales, le système affiche une excellente précision, peu de fausses alertes et une forte séparation entre correspondances correctes et incorrectes. Une fois les pastilles adversariales ajoutées, cependant, les performances chutent fortement. Selon l’amplitude de déplacement autorisée de la pastille sur l’image, les taux de succès des attaques dépassent 60 %, et la proportion de personnes correctement identifiées peut tomber à presque un tiers de son niveau initial. Des courbes qui montraient autrefois une discrimination quasi‑parfaite entre utilisateurs légitimes et imposteurs s’affaissent vers la ligne du hasard, révélant à quel point il est facile de pousser le modèle hors de sa trajectoire sans distorsions visibles.

Ce que cela signifie pour la sécurité quotidienne

Pour les non‑spécialistes, la conclusion est claire : un système de reconnaissance de la démarche qui semble très précis en laboratoire peut s’avérer étonnamment fragile face à des manipulations astucieuses conçues par des machines. L’étude montre que la combinaison d’outils génératifs d’image et d’un apprentissage par essais‑erreurs peut produire de petites modifications presque invisibles qui entraînent des erreurs d’identification graves. Plutôt que de fournir un mode d’emploi pour un usage abusif réel, le travail se veut un signal d’alarme et un cadre de test. Il offre aux concepteurs de systèmes un moyen de sonder et de mesurer la vulnérabilité de leurs modèles, et souligne la nécessité de construire des défenses contre de telles attaques avant que la reconnaissance de la démarche ne soit largement utilisée pour la surveillance, le contrôle d’accès ou d’autres applications critiques.

Citation: Saoudi, E.M., Jaafari, J. & Jai Andaloussi, S. Evaluating gait system vulnerabilities through PPO and GAN-generated adversarial attacks. Sci Rep 16, 6039 (2026). https://doi.org/10.1038/s41598-026-37011-1

Mots-clés: reconnaissance de la démarche, sécurité biométrique, attaques adversariales, apprentissage profond, apprentissage par renforcement