Clear Sky Science · fr

Évaluation comparative des modèles de reconnaissance d’actions pour la détection d’automutilation sur des jeux de données en studio et en conditions réelles

Surveiller les patients avec des yeux numériques

Dans les hôpitaux psychiatriques, les infirmiers et infirmières travaillent sans relâche pour protéger les patients, en particulier ceux qui risquent de se faire du mal. Pourtant, même le personnel le plus dévoué ne peut surveiller chaque chambre à chaque instant. Cette étude examine si l’intelligence artificielle (IA) peut aider en analysant automatiquement les flux vidéo des caméras de service pour repérer précocement des signes d’automutilation — offrant une couche de protection supplémentaire sans remplacer le soin humain.

Pourquoi l’automutilation est si difficile à détecter

L’automutilation — toute blessure intentionnelle qu’une personne s’inflige — survient souvent lors de moments brefs et cachés : une griffure rapide sous une couverture, ou un petit objet utilisé hors de vue. Les services psychiatriques comptent sur des rondes régulières et la surveillance vidéo, mais les angles morts, la fatigue du personnel et des effectifs limités la nuit ou les jours fériés rendent la vigilance permanente impossible. Parallèlement, l’enregistrement et le partage de vidéos réelles de patients soulèvent de lourdes questions de confidentialité et d’éthique. En conséquence, les chercheurs disposaient de très peu de séquences réalistes pour entraîner des systèmes d’IA susceptibles de détecter en temps réel des comportements dangereux.

Construire des bancs d’essai plus sûrs pour l’IA

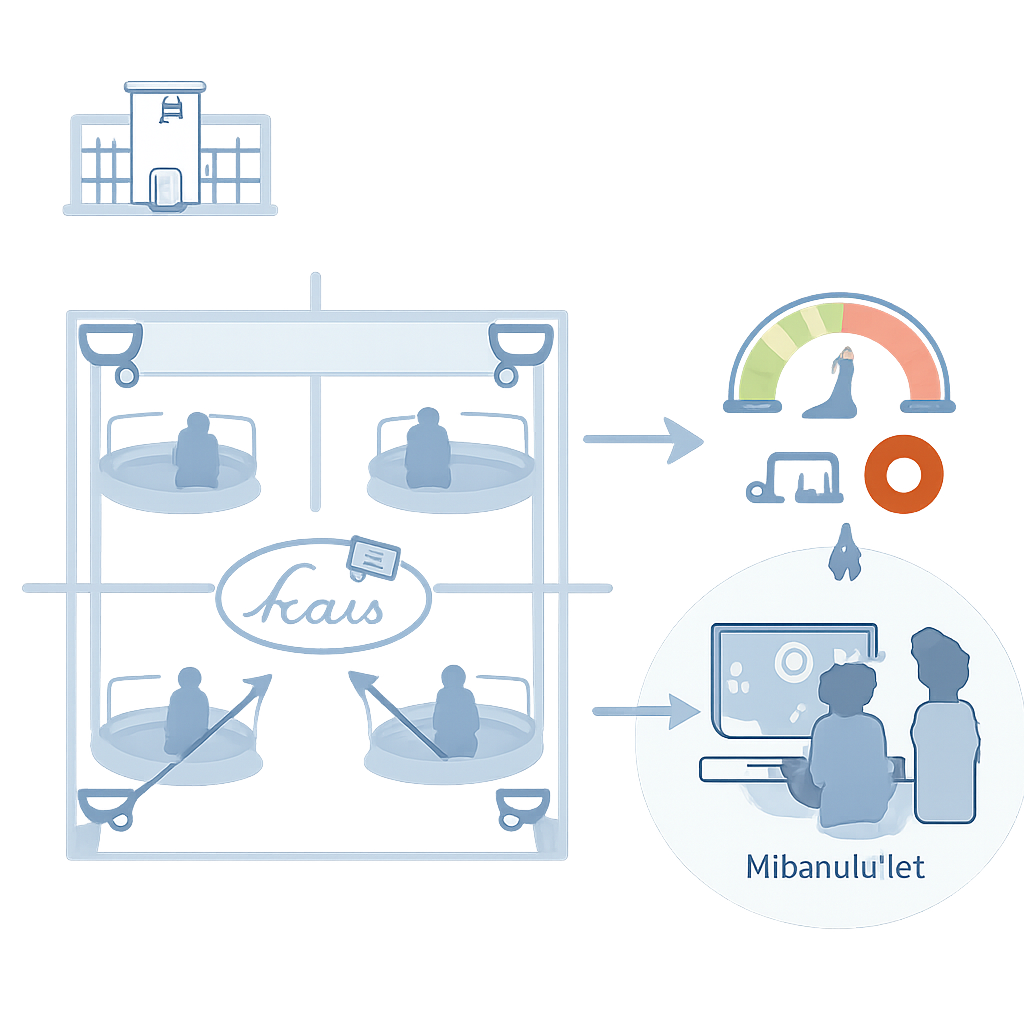

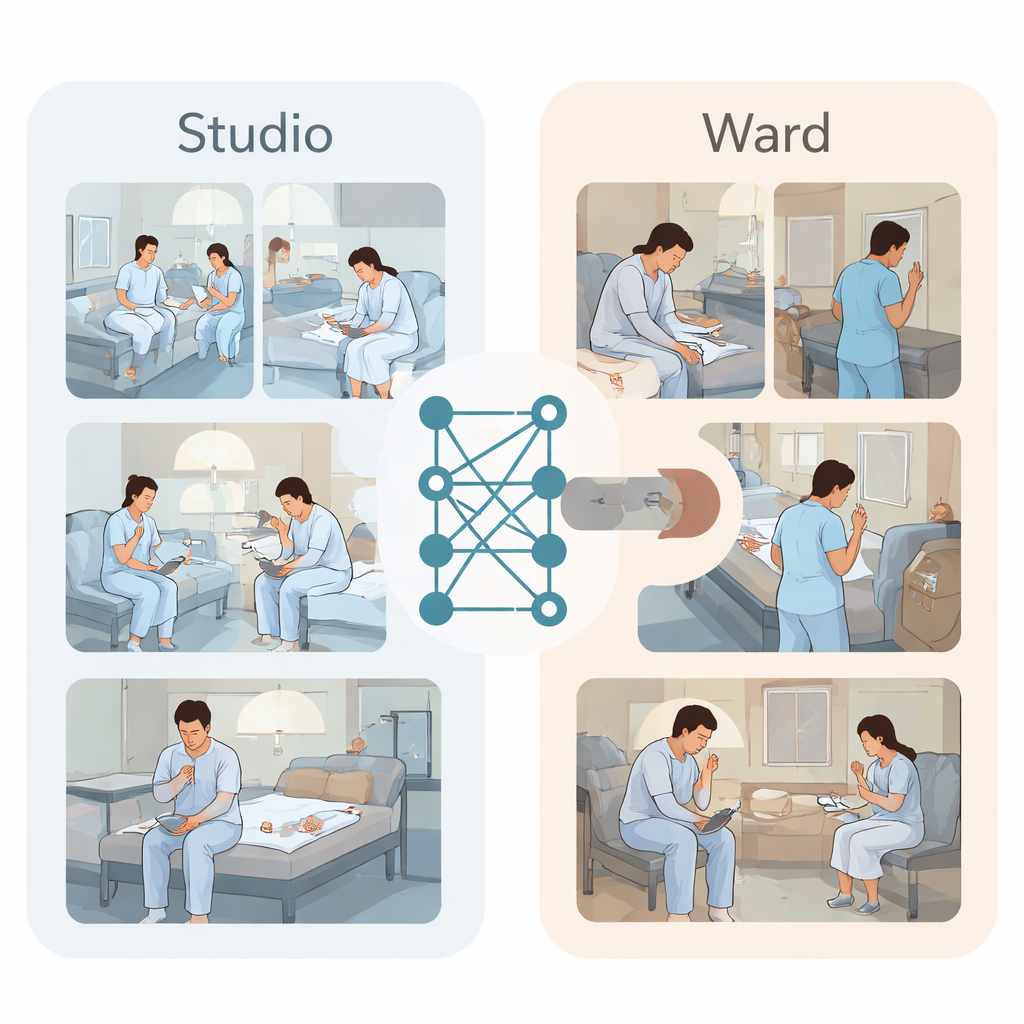

Pour débloquer la situation, les chercheurs ont créé deux types de jeux de données vidéo. D’abord, dans un studio reproduisant une chambre psychiatrique à quatre lits, sept jeunes acteurs en tenue de patient ont joué des scènes soigneusement planifiées. Ils ont cherché des objets du quotidien comme des bouchons en plastique, des tubes de baume à lèvres ou de petits clous, puis simulé de courtes séquences de gestes auto-agressifs au poignet, à l’avant-bras ou à la cuisse, avec des caméras placées en hauteur filmant depuis tous les angles. Des experts ont annoté chaque segment vidéo comme comportement normal ou automutilation, constituant une collection propre et équilibrée de 1120 clips. Ensuite, l’équipe a rassemblé des séquences de vidéosurveillance réelles issues d’unités psychiatriques sécurisées sur dix mois. Les cliniciens ont recherché dans les dossiers médicaux des mentions de comportements tels que se gratter, se curer ou se couper, puis localisé les vidéos correspondantes. Après floutage des visages et suppression des éléments identifiants, ils ont constitué 59 clips montrant des automutilations réelles et 59 clips normaux pour comparaison.

Mettre à l’épreuve les meilleures IA vidéo actuelles

Avec ces jeux de données, l’équipe a évalué des systèmes de reconnaissance d’actions de pointe — des programmes capables de comprendre ce que font les personnes dans une vidéo. Certains reposaient sur d’anciennes architectures convolutionnelles, qui analysent de courtes séquences d’images, tandis que des modèles plus récents basés sur des transformeurs utilisent des mécanismes d’attention pour relier des motifs dans l’espace et le temps. Tous les modèles ont été entraînés uniquement sur les vidéos de studio pour décider si un clip montrait une automutilation ou un comportement normal. Fait important, les chercheurs ont appliqué un protocole de test strict : à chaque itération, tous les clips d’un même acteur étaient exclus comme données de test entièrement nouvelles, empêchant les algorithmes de se contenter de mémoriser des personnes individuelles.

Quand des vidéos propres de studio rencontrent la réalité désordonnée

Sur les séquences soignées du studio, le modèle de transformeur le plus avancé, appelé VideoMAEv2, s’est distingué. Il a mieux équilibré détections manquées et fausses alertes que les autres, atteignant un score F1 (mesure combinée de précision et rappel) d’environ 0,65, tandis que des méthodes plus simples restaient proches du hasard. Des explications visuelles ont montré que ce modèle se focalisait précisément sur l’endroit où un outil touchait la peau, plutôt que d’être distrait par des mouvements de fond. Mais une fois les mêmes systèmes entraînés appliqués aux enregistrements réels des services — sans aucun réentraînement — leurs performances ont chuté. VideoMAEv2 a tout de même dépassé le hasard, avec un F1 autour de 0,61, mais il a particulièrement peiné avec des comportements subtils comme le curage et le grattage absents des données simulées, ainsi qu’avec des patients de petite taille, éloignés de la caméra ou partiellement cachés.

Ce que cela signifie pour la sécurité des patients

Ensemble, les résultats dévoilent un net fossé « simulation-vers-réalité ». Des systèmes d’IA prometteurs sur des vidéos mises en scène peuvent défaillir face au désordre, aux angles improbables et à la variété des comportements de la vie hospitalière réelle. La contribution principale de l’étude n’est pas un produit de sécurité achevé mais un point de départ : un jeu de données de studio public et bien annoté, un jeu de test réel soigneusement collecté, et une banc d’essai transparent montrant où les méthodes actuelles échouent. Pour les non-spécialistes, le message est simple : l’IA peut déjà aider à signaler des moments suspects dans les flux vidéo des services, mais elle ne peut pas encore être considérée comme un protecteur autonome. Combler ce fossé exigera des données d’entraînement plus riches et diversifiées et des modèles plus intelligents, développés en plaçant la confidentialité, l’équité et le jugement clinique au premier plan.

Citation: Lee, K., Lee, D., Ham, HS. et al. Benchmarking action recognition models for self-harm detection in studio and real-world datasets. Sci Rep 16, 6850 (2026). https://doi.org/10.1038/s41598-026-36999-w

Mots-clés: détection d’automutilation, services psychiatriques, reconnaissance d’actions vidéo, intelligence artificielle en santé, sécurité des patients