Clear Sky Science · fr

Exploration de la reconnaissance des émotions des étudiants et du feedback pédagogique des enseignants en cours de langue étrangère à l'université basé sur le modèle AFCNN

Pourquoi votre enseignant pourrait bientôt « lire la salle » grâce à l'IA

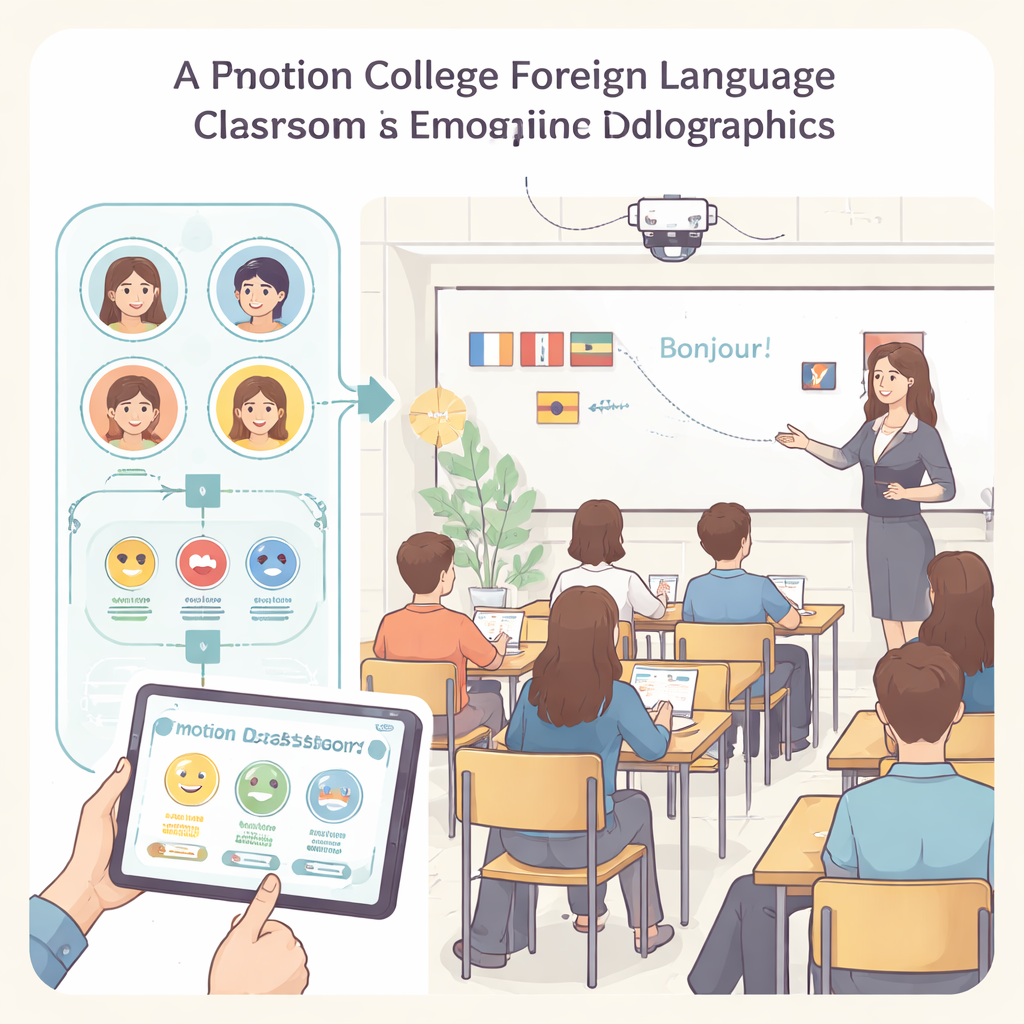

Quiconque a assisté à un cours ennuyeux sait que l'ennui peut discrètement tuer l'apprentissage. Pourtant, les enseignants n'ont souvent que leur intuition pour deviner ce que ressentent les étudiants sur le moment. Cette étude explore une nouvelle manière d'offrir aux enseignants de langues étrangères à l'université une sorte de « tableau de bord émotionnel » alimenté par l'intelligence artificielle (IA). En lisant en temps réel les expressions faciales des étudiants, le système aide les enseignants à ajuster leur pédagogie sur le vif et, à plus long terme, soutient leur développement professionnel.

Les émotions comptent autant que la grammaire

Les cours de langue étrangère ne se réduisent pas à des listes de vocabulaire et des règles de grammaire. Ce sont des espaces sociaux où la confiance, l'anxiété, la curiosité et l'ennui influencent tous la qualité de l'apprentissage. Des recherches antérieures ont montré que la formation des enseignants se concentre généralement sur les méthodes et les connaissances disciplinaires, en accordant moins d'attention aux émotions en classe. Les outils traditionnels, comme les enquêtes de fin de semestre ou les discussions après le cours, arrivent trop tard pour rattraper une séance en difficulté. Les auteurs soutiennent que si les enseignants pouvaient voir comment les émotions évoluent minute par minute, ils pourraient réagir plus rapidement—accélérer, ralentir ou changer d'activité avant que les étudiants ne décrochent mentalement.

Transformer les visages en signaux utiles

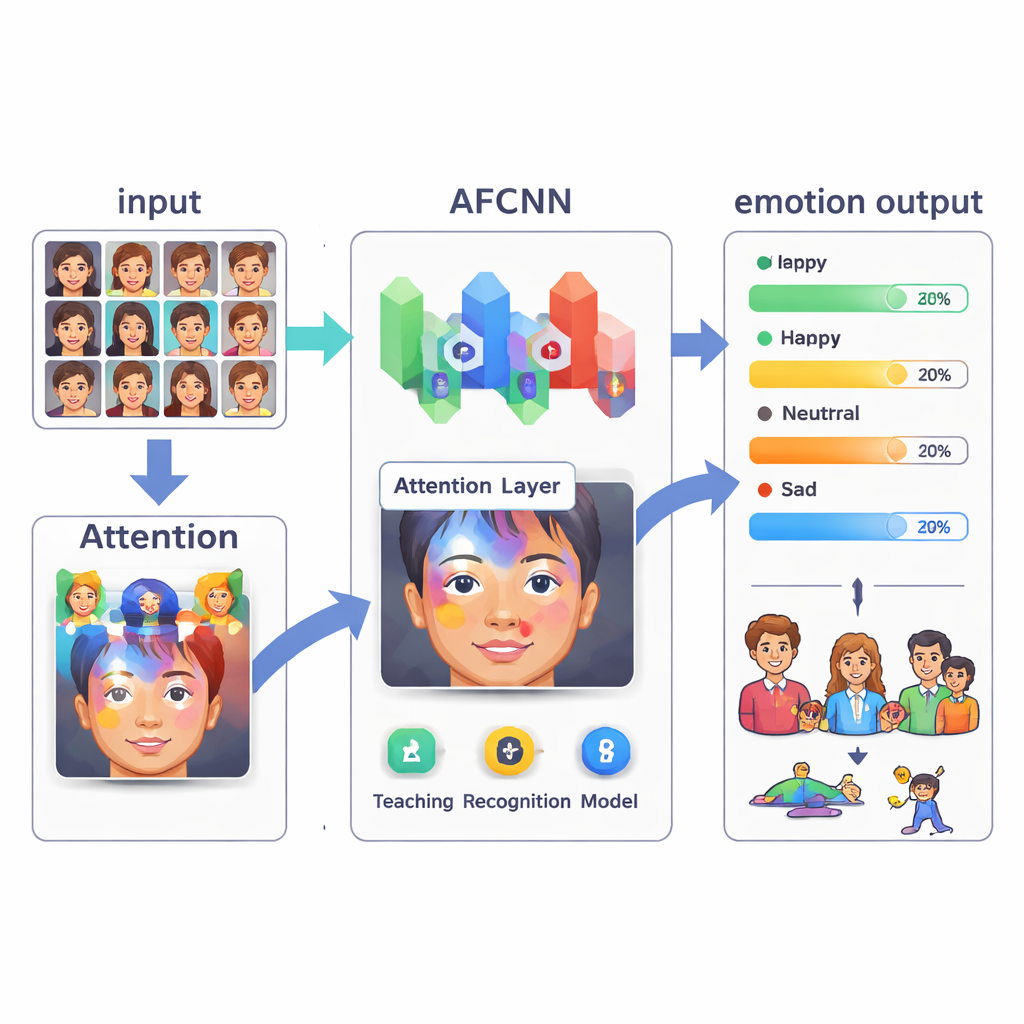

Le cœur de l'étude est un modèle d'apprentissage profond appelé Attention Feature Convolutional Neural Network, ou AFCNN. En termes simples, une caméra dans la salle de classe capture les visages des étudiants pendant l'apprentissage. Le modèle suit ensuite trois étapes : il détecte chaque visage, extrait des caractéristiques liées aux expressions, puis les classe dans l'une des sept émotions de base, comme la joie, la tristesse, la peur ou un état neutre. Un mécanisme d'« attention » spécifique aide l'IA à se concentrer sur les parties les plus informatives du visage—comme les yeux ou la bouche—tout en ignorant les distractions. Contrairement aux approches plus anciennes qui fonctionnent mieux avec des photos nettes et de face, ce système est conçu pour gérer des conditions plus réalistes, telles que des vues partielles, des mains sur le visage ou des étudiants regardant de côté.

Quelle est l'efficacité réelle du système

Pour tester l'AFCNN, les chercheurs l'ont entraîné sur une collection bien connue d'images faciales étiquetées par catégorie émotionnelle et ont étendu les données par des ajustements simples comme la rotation et les variations de luminosité. Ils ont ensuite comparé ses performances à celles de deux modèles d'imagerie établis, VGG16 et ResNet18. Dans des conditions claires sans obstruction, le nouveau modèle identifiait correctement les émotions environ 81 % du temps et était particulièrement performant pour reconnaître les expressions de joie et les états neutres, atteignant environ le milieu des années 80 en précision. Lorsque les visages étaient partiellement masqués—par des cheveux, des mains ou des chapeaux—la précision diminuait pour tous les systèmes, mais l'AFCNN surpassait encore les autres et affichait des résultats plus équilibrés selon les émotions, ce qui laisse penser qu'il est plus robuste pour les classes réelles.

Des relevés émotionnels à de meilleures séances

L'étude va au-delà de la simple précision et s'interroge sur l'impact réel de cette technologie sur l'enseignement. Lors d'un essai d'un mois impliquant 200 enseignants de langues étrangères à l'université, la moitié a utilisé le système de reconnaissance émotionnelle et l'autre moitié a enseigné comme d'habitude. Les enseignants ayant accès à un retour émotionnel en temps réel ont modifié leurs plans de cours plus de deux fois plus souvent pendant une séance, ont déclaré une plus grande satisfaction dans leur enseignement et ont constaté une participation et des interactions étudiantes accrues. Les chercheurs ont également conçu une correspondance simple entre les profils émotionnels et des réponses suggérées—par exemple, passer à une discussion ou à une révision lorsque des signes de confusion ou de frustration apparaissent—faisant passer le système de l'observation des émotions à l'orientation active du comportement.

Ce que cela implique pour les classes de demain

Concrètement, cette recherche suggère que les classes du futur pourraient disposer d'un assistant discret observant les visages des étudiants et signalant à voix basse à l'enseignant quand l'énergie de la salle diminue ou quand beaucoup d'étudiants semblent perplexes. Le système AFCNN n'est pas parfait—il a encore du mal avec des émotions subtiles comme le dégoût ou la peur, et il dépend d'images étiquetées de haute qualité—mais il montre que l'IA peut repérer de manière fiable des tendances émotionnelles et que les enseignants peuvent utiliser ces informations pour enseigner de manière plus réactive. Pour les étudiants, cela pourrait signifier des cours plus engageants et plus bienveillants ; pour les enseignants, cela offre un nouvel outil de développement professionnel qui mixe psychologie, éducation et IA en faveur d'un environnement d'apprentissage plus intelligent et plus attentif à l'humain.

Citation: Shi, L. Exploring students’ emotion recognition and teachers’ teaching feedback in college foreign language classroom based on AFCNN model. Sci Rep 16, 5657 (2026). https://doi.org/10.1038/s41598-026-36747-0

Mots-clés: reconnaissance des émotions en classe, IA dans l'éducation, enseignement des langues étrangères, développement professionnel des enseignants, modèles d'apprentissage profond