Clear Sky Science · fr

Migration adaptive de services en edge computing mobile tenant compte de la latence et de l’énergie

Pourquoi rapprocher les applications de l’utilisateur est important

Chaque fois que vous jouez en ligne dans votre voiture, que vous suivez des indications AR sur votre téléphone ou qu’un capteur dans une ville intelligente envoie des données, ces tâches numériques doivent être traitées quelque part. Le Mobile Edge Computing (MEC) déplace ce travail depuis des centres de données éloignés vers de petits serveurs situés près des antennes cellulaires, réduisant les délais et rendant les applications plus réactives. Mais garder ces services proches d’utilisateurs en mouvement implique de « déplacer » (migrer) fréquemment l’application en cours d’exécution entre serveurs edge voisins. Trop de migrations gaspillent de l’énergie et de l’argent ; trop peu crée de la latence et de la frustration. Cette étude explore comment trouver un équilibre intelligent en utilisant des méthodes avancées d’apprentissage automatique.

Équilibrer rapidité et consommation électrique

La plupart des travaux antérieurs sur la migration de services en MEC se concentraient principalement sur un objectif : maintenir la latence perçue par l’utilisateur aussi faible que possible. Cela revient généralement à suivre l’utilisateur lorsqu’il se déplace et à déplacer son application vers le serveur le plus proche. Or chaque migration consomme de l’énergie de communication supplémentaire et induit sa propre latence. Beaucoup de méthodes précédentes supposaient aussi une capacité serveur abondante et des conditions stables, en ignorant que les serveurs edge ont des ressources limitées, se partagent entre de nombreux utilisateurs et subissent des variations rapides de charge et de qualité radio. Les auteurs soutiennent que l’énergie de migration doit être traitée comme un objectif à part entière, au même titre que la latence, et que les politiques de migration doivent s’adapter en ligne aux déplacements des utilisateurs, à la charge des serveurs et aux fluctuations du réseau.

Du problème mathématique à l’agent d’apprentissage

Les chercheurs construisent d’abord un modèle mathématique détaillé d’un système MEC avec plusieurs stations de base, des serveurs edge co‑localisés et des utilisateurs mobiles. Chaque utilisateur délègue des tâches de calcul à des serveurs proches via des liaisons sans fil. La latence totale de service est décomposée en trois parties : le temps d’envoi de la tâche vers la station de base, le temps de calcul sur le serveur et le temps supplémentaire si le service est déplacé entre serveurs via le backhaul filaire. L’énergie de migration est modélisée principalement en fonction du volume de données à transférer lorsqu’un service migre. L’objectif global est de minimiser à la fois la latence et l’énergie de migration tout en respectant les limites de capacité de calcul de chaque serveur et les délais impartis à chaque service. Résoudre exactement ce problème mixte, entier et non linéaire en temps réel est inabordable, si bien que l’équipe se tourne vers l’apprentissage profond par renforcement, où un agent apprend de bonnes décisions en interagissant avec un environnement simulé.

Comment fonctionne le cerveau adaptatif de migration

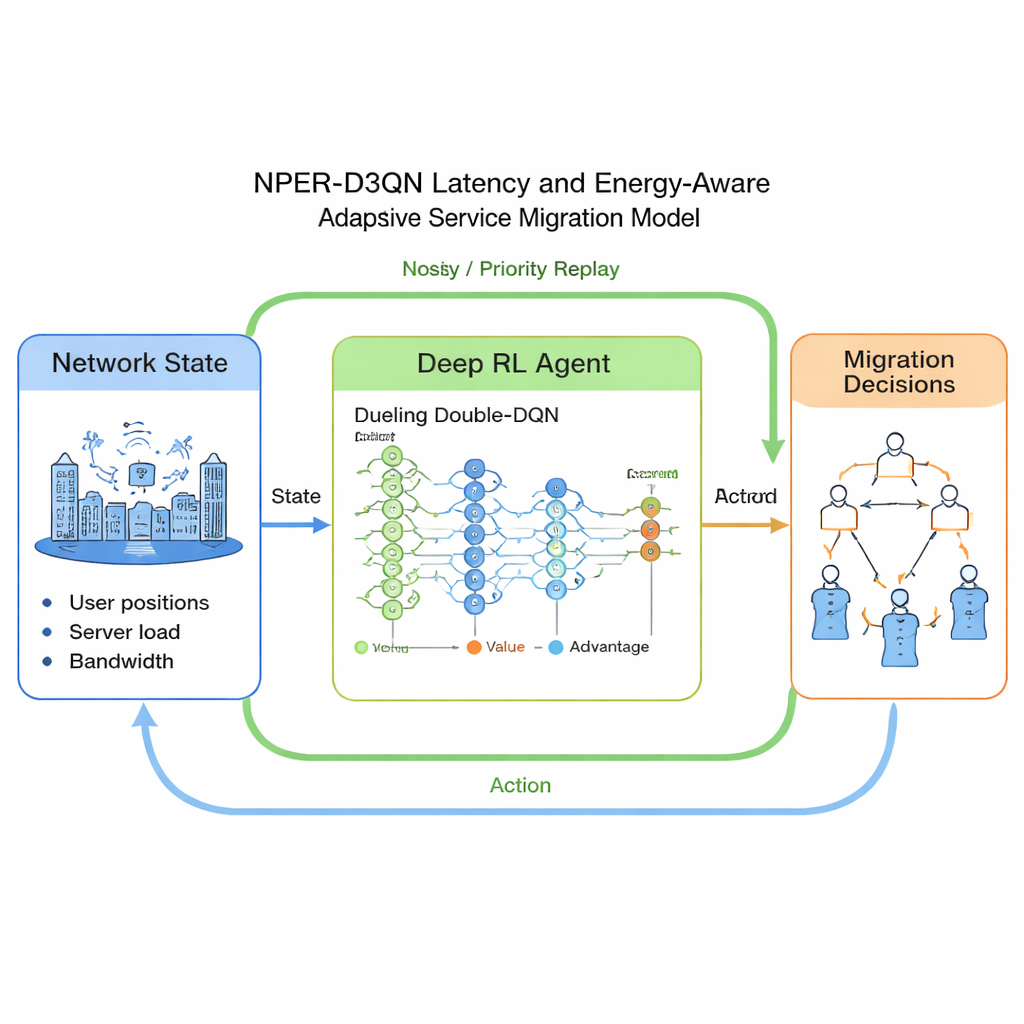

La méthode proposée, nommée NPER‑D3QN, est une variante sophistiquée des Deep Q‑Networks (DQN). L’état d’entrée de l’agent résume la position des utilisateurs, leur distance par rapport à la station qui les dessert, la charge de chaque serveur edge, la capacité de calcul disponible, les débits sans fil et la taille et l’exigence en calcul de chaque service. Ses actions consistent à choisir quel serveur edge hébergera le service de chaque utilisateur au créneau suivant. La fonction de récompense encourage une faible latence par rapport au délai imparti à chaque service tout en pénalisant l’énergie de migration, poussant l’agent à arbitrer entre rapidité et consommation électrique. Techniquement, le modèle combine trois idées : un réseau dueling qui estime séparément la valeur d’un état et l’avantage de chaque action, une structure de double Q‑learning qui réduit les estimations trop optimistes, et deux aides à l’exploration — des réseaux bruyants et le replay d’expérience priorisé — qui lui permettent d’apprendre plus vite et plus fiablement dans des conditions complexes et changeantes.

Mise à l’épreuve de l’approche

Pour évaluer les performances de NPER‑D3QN, les auteurs simulent une grille urbaine avec des dizaines de stations de base et jusqu’à des centaines d’utilisateurs mobiles se déplaçant aléatoirement et envoyant des tâches de tailles variées. Les serveurs edge ont une puissance de calcul limitée et ne peuvent héberger qu’un nombre fixe de machines virtuelles, générant des files d’attente et de la concurrence réalistes. Ils comparent leur méthode à six références récentes, incluant le DQN classique, des variantes double‑dueling améliorées et des stratégies qui poursuivent systématiquement le serveur le plus proche ou qui visent uniquement à minimiser la latence. Dans une variété de scénarios, NPER‑D3QN converge plus vite vers de bonnes stratégies et atteint de manière constante une latence moyenne de service plus faible, une consommation d’énergie liée à la migration réduite et moins de migrations rejetées lorsque les serveurs sont pleins. Dans un test à grande échelle avec 720 utilisateurs et 96 serveurs, il réduit la latence d’environ deux tiers et l’énergie de migration de plus de 90 % par rapport à certaines alternatives, tout en maintenant un temps de calcul par décision dans des limites pratiques.

Ce que cela implique pour les services connectés de demain

Pour les non‑spécialistes, le message est que rapprocher simplement les applications des utilisateurs ne suffit pas : il faut aussi un contrôle intelligent du moment et du lieu des migrations de services en cours d’exécution. Ce travail montre qu’un contrôleur basé sur l’apprentissage peut « jongler » entre les objectifs concurrents de réactivité, d’économie d’énergie et de capacité edge limitée sans règles manuelles conçues à la main. Si des systèmes similaires sont déployés dans des réseaux réels, ils pourraient aider les opérateurs à offrir des expériences plus fluides pour des applications comme la conduite autonome, la RA immersive et l’IoT industriel, tout en maîtrisant les factures d’électricité et la pression sur l’infrastructure. Les auteurs notent que leur étude est basée sur des simulations et omet certains détails du monde réel, comme la consommation électrique complète des serveurs et la surveillance imparfaite, mais elle constitue une étape prometteuse vers un edge computing plus vert et plus adaptable.

Citation: Li, L., Lv, J., Wang, S. et al. Latency and energy-aware adaptive service migration in mobile edge computing. Sci Rep 16, 6178 (2026). https://doi.org/10.1038/s41598-026-36711-y

Mots-clés: edge computing mobile, migration de services, apprentissage profond par renforcement, optimisation de la latence, efficacité énergétique