Clear Sky Science · fr

Algorithme d’optimisation Secante pour une optimisation globale efficace

Recherche plus intelligente pour des problèmes difficiles

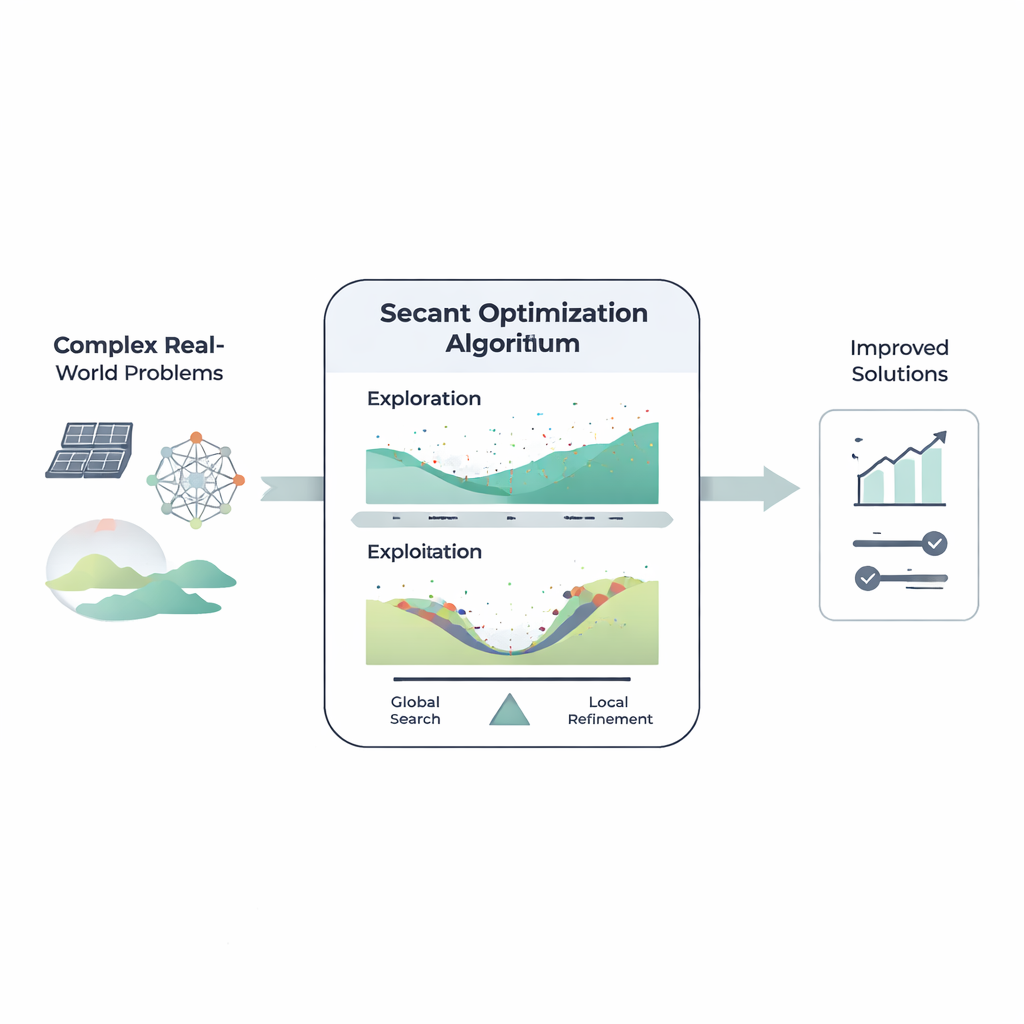

Qu’il s’agisse de concevoir des panneaux solaires plus propres ou d’entraîner des systèmes de reconnaissance d’images performants, de nombreux défis contemporains se ramènent à la même tâche : fouiller un espace énorme de possibilités pour trouver une bonne solution. Cet article présente l’algorithme d’optimisation Secante (SOA), une nouvelle manière d’effectuer cette recherche de façon plus efficace. Inspiré d’une idée classique du calcul différentiel mais conçu pour des données réelles et bruitées, le SOA vise à être à la fois rapide et fiable lorsque les méthodes traditionnelles montrent leurs limites.

Pourquoi l’optimisation a besoin de nouvelles idées

Les problèmes modernes en ingénierie et en science des données impliquent souvent des dizaines ou des centaines de réglages possibles, des objectifs multiples et des relations complexes difficiles à exprimer par des formules simples. Les techniques classiques fondées sur des gradients exacts, comme la descente la plus raide, peuvent échouer quand le paysage est rugueux, truffé de minima locaux, ou quand les dérivées sont difficiles voire impossibles à calculer. En réponse, les chercheurs ont développé des algorithmes « métaheuristiques » qui imitent la nature, la physique ou des principes mathématiques pour explorer ces paysages difficiles. Ces méthodes, telles que les algorithmes génétiques ou les optimiseurs de type essaim, se sont montrées remarquablement polyvalentes mais doivent encore composer avec un compromis entre exploration large et localisation précise.

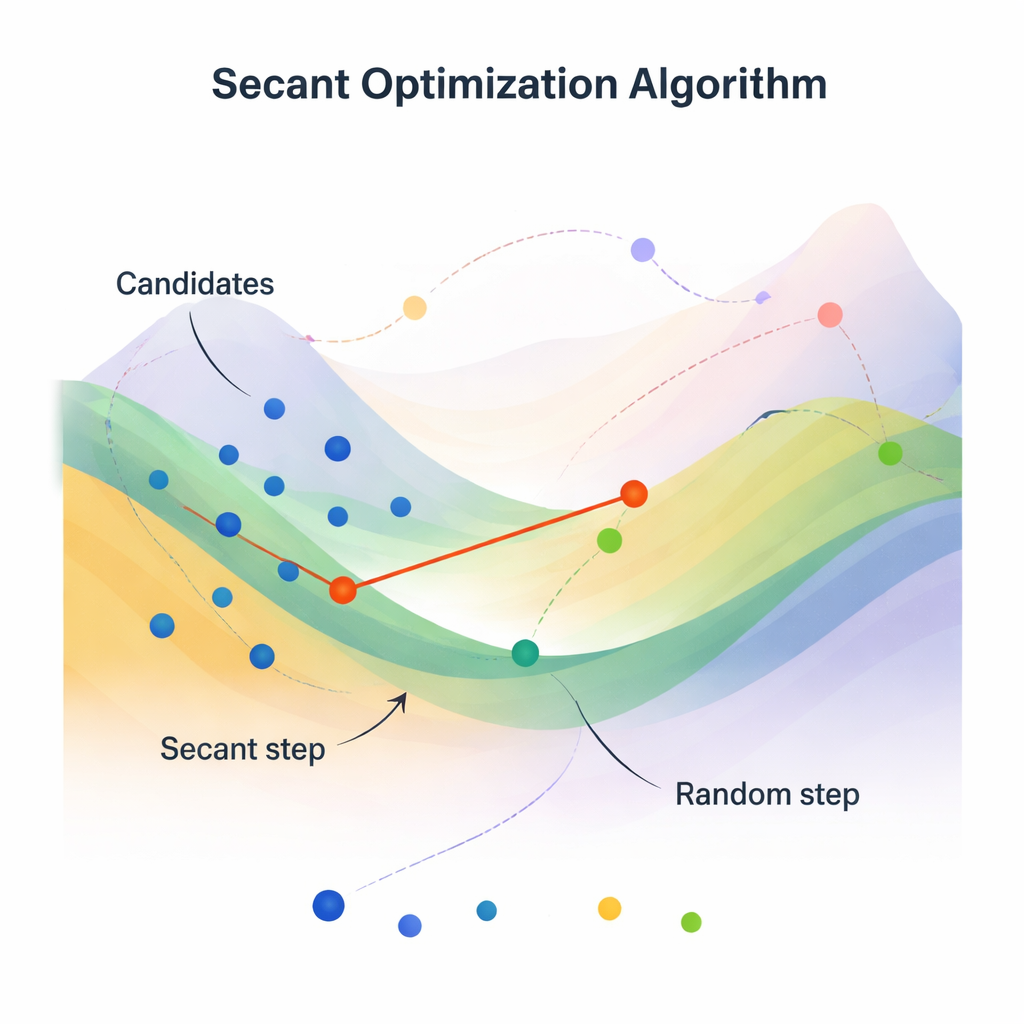

Transformer un tour de manuel en moteur de recherche

Le cœur du SOA est la méthode de la sécante, une astuce numérique ancienne pour trouver où une courbe s’annule sans avoir besoin des dérivées exactes. Plutôt que d’utiliser une pente calculée par le calcul différentiel, la méthode de la sécante trace une droite entre deux points voisins de la courbe et utilise cette droite comme pente approchée. Le SOA généralise cette idée à plusieurs dimensions et à plusieurs solutions candidates simultanément. Il maintient une population de vecteurs (réponses possibles) et les met à jour de façon répétée par des pas de type sécante qui approchent la tendance de la fonction objectif, mais uniquement à partir de valeurs de la fonction. Cela rend la méthode attrayante dans les contextes où les gradients sont bruités, coûteux ou indéfinis, comme pour l’ajustement des hyperparamètres d’un réseau de neurones à partir de l’erreur de validation.

Équilibrer exploration large et mise au point précise

Le design du SOA sépare explicitement ses mécanismes d’exploration et d’affinage. Durant la phase d’exploration, chaque candidat est ajusté selon une règle inspirée de la sécante qui combine des informations issues de la meilleure solution actuelle, du vecteur courant et d’un pair choisi aléatoirement. Cela oriente la recherche vers des directions qui semblent prometteuses, sans être purement aléatoire. Durant la phase d’exploitation, le SOA introduit un « facteur d’expansion » et une randomisation contrôlée. Il pousse les solutions vers le meilleur, la moyenne, le point le plus proche et même le plus éloigné de la population, tout en mêlant des marches aléatoires. Une règle simple de mutation conserve occasionnellement une ancienne position au lieu de la nouvelle, préservant ainsi la diversité. Ensemble, ces mécanismes aident le SOA à échapper aux pièges locaux tout en se focalisant sur des réponses de haute qualité.

Tests sur benchmarks et dispositifs réels

Pour vérifier que le SOA n’est pas qu’une idée élégante sur le papier, les auteurs le testent sur des familles de benchmarks largement utilisées, connues sous les noms CEC2021 et CEC2020. Ces fonctions sont conçues pour être exigeantes : certaines ont de faibles dimensions mais foisonnent de faux minima ; d’autres s’étendent jusqu’à 50 ou 100 dimensions. À travers ces tests, le SOA est comparé à deux groupes d’algorithmes concurrents, incluant 11 méthodes d’inspiration mathématique et 9 optimiseurs récents ou variantes. En utilisant des statistiques telles que l’erreur moyenne, la variabilité, les courbes de convergence et des tests basés sur les rangs, le SOA se montre régulièrement à la hauteur ou supérieur à la plupart des rivaux, en particulier pour atteindre rapidement et de manière fiable de bonnes solutions. Les auteurs vont ensuite au-delà des tests synthétiques pour s’attaquer à deux tâches réelles exigeantes : l’estimation de paramètres clés de modèles photovoltaïques (PV) et l’optimisation automatique des hyperparamètres de réseaux de neurones convolutionnels sur plusieurs jeux d’images.

Des panneaux solaires aux réseaux neuronaux

En énergie solaire, des modèles précis des cellules et modules PV sont essentiels pour prédire la production et optimiser le fonctionnement. L’équipe applique le SOA à plusieurs modèles PV standards, incluant les descriptions à diode unique, double diode et les modèles complets de modules. À partir de données mesurées courant–tension, le SOA ajuste les paramètres des modèles pour minimiser l’erreur et montre qu’il atteint des erreurs quadratiques moyennes (RMSE) inférieures ou comparables à celles d’un éventail d’optimiseurs établis. Dans les expériences de machine learning, le SOA est utilisé pour régler l’architecture et les paramètres d’entraînement d’un réseau convolutionnel sur MNIST et des jeux d’images connexes. Là encore, l’algorithme trouve des combinaisons d’hyperparamètres produisant des précisions de classification compétitives ou supérieures par rapport à d’autres stratégies de recherche automatisée.

Ce que cela signifie en pratique

Pour les non-spécialistes, le message principal est que le SOA offre un nouveau « moteur de recherche » pratique pour les problèmes d’optimisation difficiles où le paysage est rugueux et où les gradients ne sont pas disponibles. En empruntant la géométrie de la méthode des sécantes et en l’intégrant dans une recherche populationnelle avec une randomisation bien calibrée, l’algorithme converge souvent plus vite et plus précisément que de nombreuses alternatives actuelles. Parce qu’il est relativement simple, sans dérivées et peu sensible aux réglages, le SOA peut être intégré à une variété d’applications — de la conception de systèmes solaires plus efficaces à la configuration de modèles d’apprentissage profond — ce qui en fait un ajout prometteur à la boîte à outils des ingénieurs et des data scientists.

Citation: Ibrahim, M.Q., Qaraad, M., Hussein, N.K. et al. Secant Optimization Algorithm for efficient global optimization. Sci Rep 16, 6659 (2026). https://doi.org/10.1038/s41598-026-36691-z

Mots-clés: optimisation globale, algorithmes métaheuristiques, algorithme d’optimisation secante, modélisation photovoltaïque, optimisation d’hyperparamètres