Clear Sky Science · fr

Détection en temps réel du feu et de la fumée utilisant des vision transformers et l’apprentissage spatiotemporel

Pourquoi des alertes incendie plus rapides comptent

Les incendies dans les habitations, les usines et les forêts peuvent devenir mortels en quelques minutes. Aujourd’hui, de nombreux détecteurs reposent encore sur des capteurs de chaleur ou de fumée qui ne réagissent qu’une fois les flammes bien établies. Cet article décrit un nouveau système de vision par ordinateur capable de repérer les signes de feu et de fumée dans des flux vidéo de caméras presque instantanément, même dans des conditions difficiles comme la faible luminosité ou la forte brume. En combinant plusieurs techniques avancées d’intelligence artificielle dans un modèle unique, les chercheurs visent à fournir aux pompiers, urbanistes et agences environnementales un signal d’alerte beaucoup plus précoce—pouvant potentiellement sauver des vies, des biens et des écosystèmes.

Le défi croissant de la détection des flammes

Les villes modernes et les forêts sont de plus en plus surveillées par des caméras, mais apprendre aux ordinateurs à reconnaître de manière fiable le feu et la fumée dans ces images et vidéos est complexe. Les approches classiques utilisent des réseaux neuronaux performants sur des images fixes ou des courts extraits, mais qui peinent souvent dans des scènes réelles encombrées. Un simple instantané peut montrer quelque chose qui ressemble à de la fumée mais qui n’est que du brouillard ou des émissions. Les systèmes orientés vidéo peuvent suivre le mouvement des formes au fil du temps, mais ils ont tendance à être lents et exigeants en ressources matérielles. En conséquence, les modèles antérieurs déclenchent fréquemment de fausses alertes ou manquent des signes subtils et rapides de danger—surtout en faible éclairage, dans une fumée dense ou sur des arrière-plans chargés.

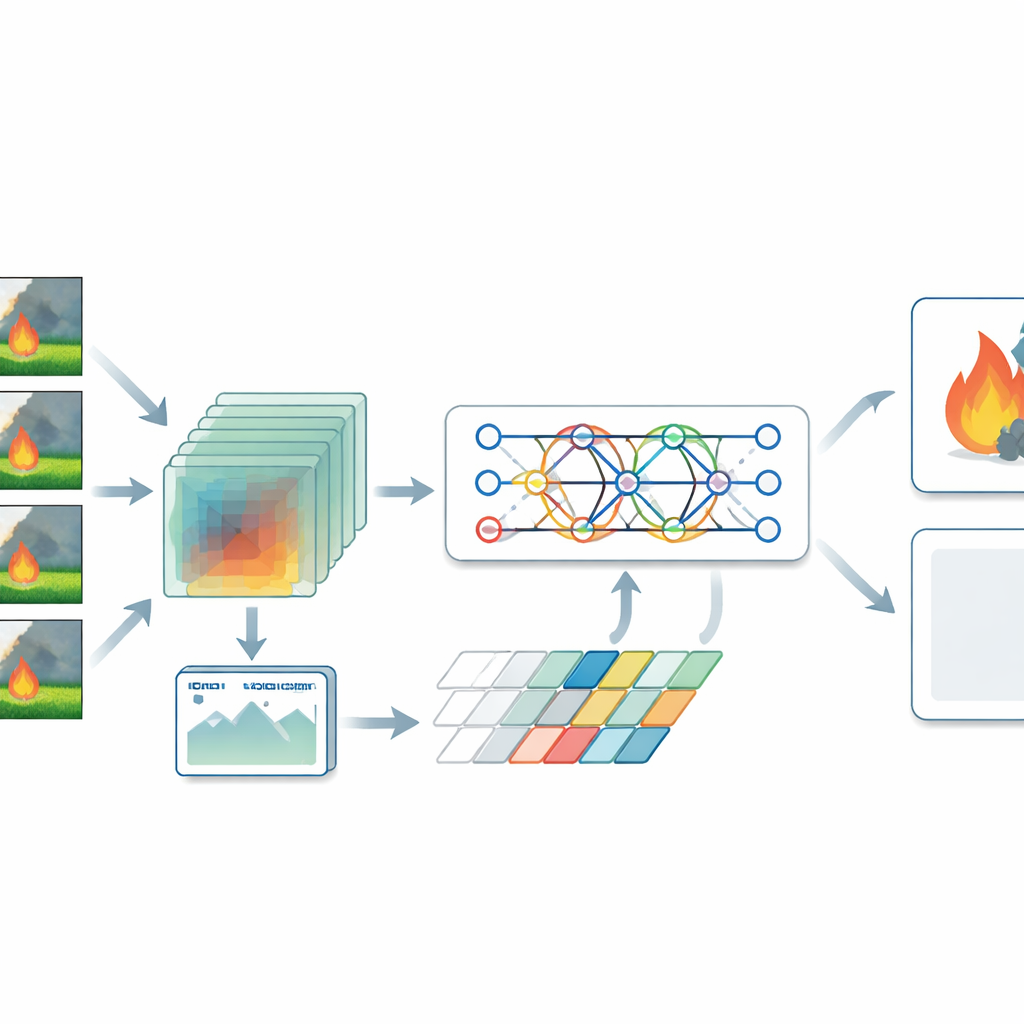

Un « observateur » IA hybride pour images et vidéo

Les auteurs proposent un modèle hybride qui traite la détection d’incendie comme un problème à la fois spatial et temporel. Pour les images fixes, ils utilisent un type de réseau appelé vision transformer, qui considère une image comme un patchwork de régions et apprend comment des zones éloignées se relient entre elles. Cela l’aide à repérer des motifs étendus, comme des volutes de fumée s’étendant sur une vallée ou des flammes éparpillées dans une forêt. Pour la vidéo, le système s’appuie sur un réseau de convolution tridimensionnel qui traite des piles d’images simultanément, capturant la façon dont la fumée et le feu évoluent dans le temps. Un encodeur transformer examine ensuite ces motifs changeants et focalise l’attention sur les instants et les régions les plus susceptibles d’indiquer un danger, plutôt que de pondérer chaque image de la même manière.

Mêler les indices et équilibrer les données

Une étape clé du système est une couche de fusion qui combine les indices détaillés issus des images fixes avec les motifs de mouvement tirés de la vidéo. En réunissant ces vues complémentaires, le modèle peut mieux distinguer les incendies réels des faux positifs tels que l’éblouissement du coucher de soleil, le brouillard ou les nuages. Les chercheurs ont aussi constaté que de nombreux jeux de données publics contiennent bien plus d’exemples d’incendie que de non-incendie, ce qui peut biaiser un modèle vers une surdéclaration des flammes. Pour contrer cela, ils ont généré une grande variété de scènes non incendiaires réalistes via une augmentation de données soigneuse—modification de la luminosité, recadrage et retournement des images, et simulation de situations comme des matins brumeux ou des intérieurs sombres. Ils ont ensuite entraîné le modèle avec une fonction de perte qui équilibre explicitement les erreurs sur les cas incendie et non-incendie, améliorant ainsi la fiabilité en usage courant.

Évaluer le système

Pour mesurer l’efficacité de leur approche, les auteurs l’ont testée sur deux jeux de données largement utilisés : l’un rassemblant près d’un millier d’images fixes provenant du NASA Space Apps Challenge, et un autre constitué de vidéos liées aux incendies issues de Kaggle. Après prétraitement et équilibrage, ils ont entraîné et évalué leur modèle hybride aux côtés de références bien connues telles que ResNet, VGG, LSTM, des réseaux de convolution 3D purs et plusieurs appariements hybrides de ces méthodes plus anciennes. Le nouveau système a atteint environ 99,2 % de précision sur les images NASA et 98,3 % sur le jeu de vidéos, surpassant nettement les modèles traditionnels qui se situaient typiquement dans une fourchette des mi‑80 % aux mi‑90 %. Il fonctionnait aussi assez rapidement—des dizaines de millisecondes par image—et avec une taille de modèle modeste, le rendant adapté à un déploiement sur des dispositifs en périphérie comme de petits GPU et des cartes embarquées.

Ce que cela signifie pour la sécurité quotidienne

En termes pratiques, cette recherche montre qu’une IA bien conçue peut surveiller des flux de caméras en temps réel et répondre de façon fiable à une question simple mais vitale : « Y a‑t‑il du feu ou de la fumée dangereuse ici, maintenant ? » En combinant un contexte visuel large, le mouvement au fil du temps et une attention ciblée sur les détails les plus révélateurs, le modèle hybride réduit nettement à la fois les incendies manqués et les fausses alertes. Avec des réglages supplémentaires et une exposition à des scènes encore plus variées—comme les centres urbains densément peuplés, les espaces souterrains et les conditions météorologiques extrêmes—il pourrait devenir l’épine dorsale pratique de systèmes d’alarme plus intelligents, de réseaux de surveillance des feux de forêt et d’outils de sécurité industrielle réagissant plus vite et plus précisément que bon nombre de solutions actuelles.

Citation: Lilhore, U.K., Sharma, Y.K., Venkatachari, K. et al. Real time fire and smoke detection using vision transformers and spatiotemporal learning. Sci Rep 16, 8928 (2026). https://doi.org/10.1038/s41598-026-36687-9

Mots-clés: détection d’incendie, détection de fumée, vision par ordinateur, modèles transformer, surveillance en temps réel