Clear Sky Science · fr

Traitement des données de cristallographie femtoseconde en série au centre national de données scientifiques GSDC de KISTI

Pourquoi de tout petits cristaux ont besoin de puissants ordinateurs

Les lasers X modernes peuvent réaliser des « films moléculaires » de protéines et d’autres molécules en tirant des impulsions ultra‑courtes et extrêmement intenses sur d’innombrables petits cristaux. Cette approche, appelée cristallographie femtoseconde en série, produit un flot d’images qui révèlent l’aspect et le mouvement des molécules à température ambiante. Mais il y a un revers : une seule expérience peut générer des téraoctets de données, bien plus qu’un poste de laboratoire classique ne peut traiter rapidement. Cet article explique comment le centre national de données GSDC à KISTI a été conçu et testé pour traiter efficacement ces immenses jeux de données, et quelles leçons pratiques les scientifiques peuvent en tirer pour passer des images brutes aux structures 3D sans longs délais.

Des éclairs laser aux instantanés de structure

En cristallographie femtoseconde en série, un laser à électrons libres X (XFEL) envoie des impulsions rapides sur des flux ou des réseaux de cristaux microscopiques. Chaque cristal est frappé une seule fois, produisant un unique motif de diffraction « instantané » avant d’être détruit. Pour reconstruire la structure tridimensionnelle complète de la molécule, les chercheurs doivent combiner des centaines de milliers à des millions de ces instantanés. De nombreuses images sont inutiles : certaines ne contiennent aucun signal, d’autres montrent plusieurs cristaux qui se chevauchent. Les images utiles (« hits ») doivent être détectées, triées et converties en données d’intensité qui peuvent être fusionnées en une structure de haute qualité. Réaliser cela à peu près en temps réel exige du calcul haute performance, particulièrement lorsque le laser fonctionne à plusieurs dizaines d’impulsions par seconde.

Un centre national de données pour les expériences aux rayons X

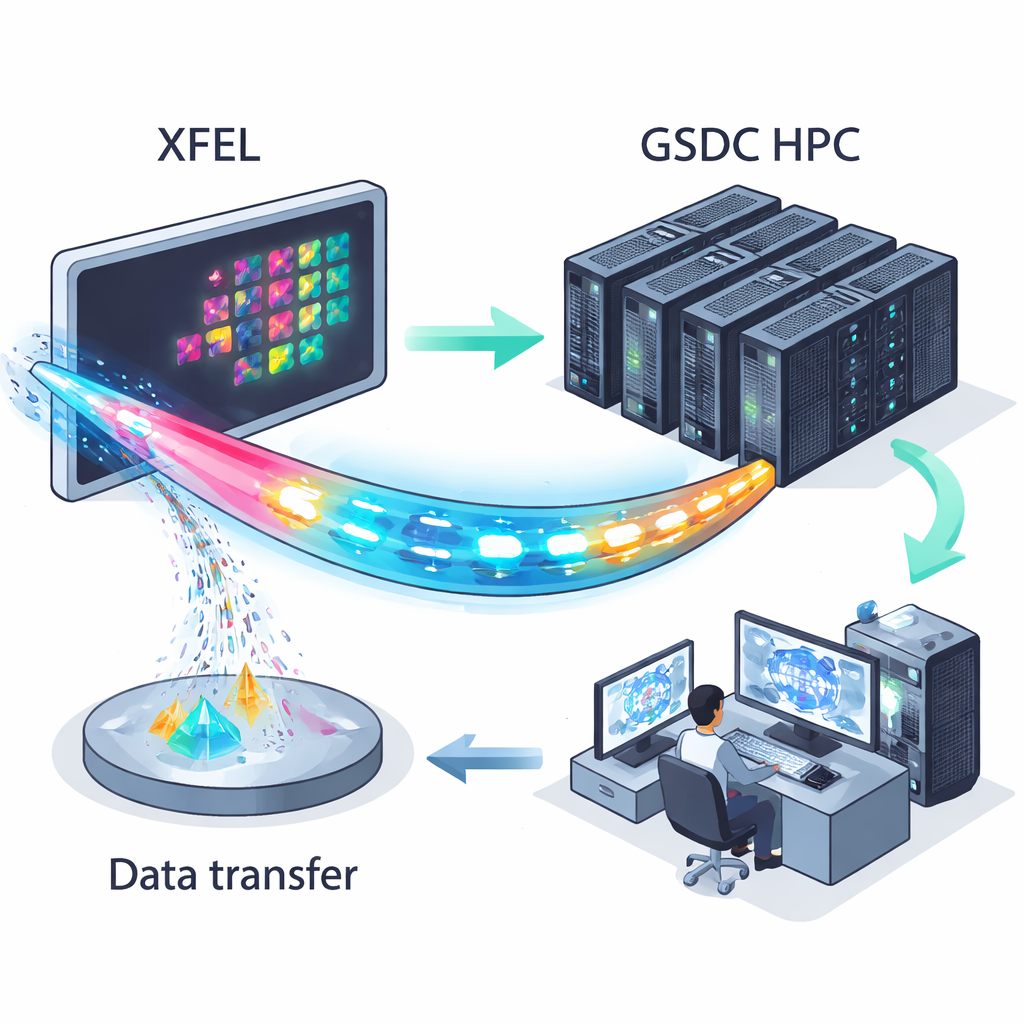

Le Global Science Data hub Center (GSDC) de KISTI a été créé comme une installation à l’échelle nationale pour servir les sciences génératrices de grandes quantités de données, de la physique des particules à la génomique. Pour la cristallographie en série au XFEL du Pohang Accelerator Laboratory (PAL‑XFEL), le GSDC exploite trois serveurs dédiés équipés de dizaines de cœurs CPU, de centaines de gigaoctets de mémoire et d’un système de stockage parallèle à haute vitesse. Lors des expériences à la station de nanocristallographie du PAL‑XFEL, les images de diffraction sont acquises par un détecteur X rapide et transmises au GSDC via une liaison à 10 gigabits par seconde. Une expérience unique de 12 à 24 heures peut générer de quelques téraoctets à près de dix téraoctets de données. Au GSDC, les utilisateurs se connectent à distance, filtrent les images non utiles et lancent des logiciels spécialisés — tels que CrystFEL et ses programmes d’indexation associés — pour transformer les images brutes en données structurales affinées.

Combien de processeurs aident, et quand

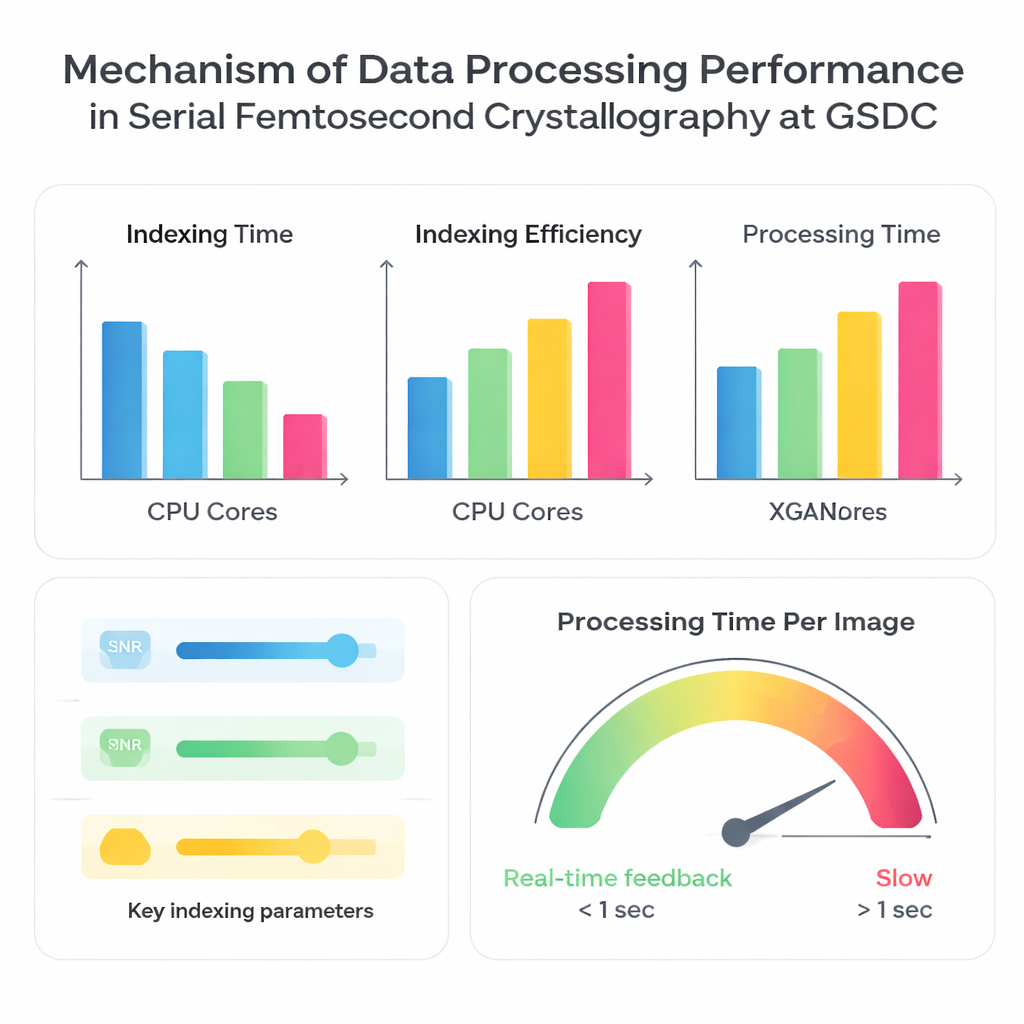

Les auteurs ont mis le système GSDC à l’épreuve en utilisant trois ensembles de données recueillis auparavant sur différentes protéines. D’abord, ils ont évalué l’amélioration de la vitesse de traitement quand davantage de cœurs CPU sont utilisés en parallèle. Comme prévu, l’emploi de plus de processeurs a réduit le temps total nécessaire pour indexer les images, mais pas de façon parfaitement proportionnelle. Passer de 10 à environ 30–40 cœurs CPU a apporté des gains marqués, après quoi les bénéfices se sont atténués. Au‑delà, des cœurs supplémentaires ajoutaient de la surcharge et étaient limités par des goulots tels que la bande passante mémoire, la vitesse d’entrée/sortie lors de la lecture de nombreux petits fichiers, et la coordination entre de nombreuses tâches parallèles. Cela montre clairement que « plus de cœurs » n’est pas toujours mieux ; il existe un point optimal où le matériel est utilisé efficacement sans être bridé.

Le compromis entre rapidité et exhaustivité

Ensuite, l’équipe a comparé quatre algorithmes d’indexation largement utilisés — XDS, DirAx, MOSFLM et XGANDALF — sur la même plateforme de calcul. Certaines méthodes, comme XDS et DirAx, étaient globalement plus rapides mais identifiaient une fraction plus faible d’images pouvant être converties en motifs de diffraction exploitables. D’autres, telles que MOSFLM et XGANDALF, étaient plus lentes mais convertissaient davantage d’images en données utilisables et produisaient en général une meilleure qualité statistique dans le jeu de données final fusionné. Les auteurs ont également étudié comment de simples choix d’entrée influencent à la fois la vitesse et le taux de réussite : augmenter le seuil signal/bruit ou désactiver l’indexation multi‑cristal rendait le traitement plus rapide mais réduisait le nombre d’images utilisables ; abaisser le seuil ou activer la gestion multi‑cristal produisait l’effet inverse. De façon cruciale, même de petites erreurs dans la géométrie du détecteur — comme la distance entre détecteur et échantillon — provoquaient davantage d’échecs d’indexation et ralentissaient considérablement le traitement, car le logiciel continuait d’essayer et rejetait des solutions incorrectes.

Ce que cela signifie pour les expériences à venir

En mesurant systématiquement comment les choix matériels, les algorithmes logiciels et les réglages contrôlés par l’utilisateur affectent les performances, cette étude transforme un défi complexe de gestion des données en un ensemble de recommandations pratiques. Pour les chercheurs planifiant des expériences au PAL‑XFEL, elle indique quand le traitement parallèle est le plus efficace, quels programmes d’indexation sont préférables pour un retour d’information rapide versus une qualité de données maximale, et pourquoi la calibration précise de la géométrie du détecteur est si importante. Les auteurs concluent que le GSDC permet déjà un traitement efficace et, dans certains cas, un retour en temps réel pendant la collecte des données, mais qu’une extension des ressources informatiques sera nécessaire à mesure que les taux de répétition et la taille des jeux de données continueront d’augmenter. Pour les non‑spécialistes, le message clé est que réaliser des « films » de molécules n’est pas seulement un triomphe des lasers et des détecteurs avancés — cela dépend aussi de centres de calcul bien conçus capables de suivre le déluge de données.

Citation: Nam, K.H., Na, SH. Serial femtosecond crystallography data processing at the global science data hub center at KISTI. Sci Rep 16, 6786 (2026). https://doi.org/10.1038/s41598-026-36540-z

Mots-clés: cristallographie femtoseconde en série, laser à électrons libres X, calcul haute performance, traitement de données, structure des protéines