Clear Sky Science · fr

Rapports scientifiques : transformeur graphique à double attention multi-relationnelle pour l’analyse des sentiments fine

Pourquoi les indices minuscules dans les avis comptent

Les avis en ligne regorgent de sentiments mêlés : un restaurant peut avoir « une excellente cuisine mais un service lent », ou un téléphone présenter « un bel écran mais une autonomie catastrophique ». Les entreprises et les chercheurs veulent que les ordinateurs comprennent ce type d’opinion détaillée, pas seulement si un avis global est positif ou négatif. Cet article présente un nouveau modèle d’intelligence artificielle qui zoome sur des parties spécifiques d’une phrase — comme « service » ou « autonomie » — et détermine exactement ce que ressentent les gens à propos de chacune, même lorsque les indices sont dispersés et subtils.

Dépassement d’une analyse du sentiment uniforme

L’analyse de sentiment traditionnelle traite une phrase ou un avis comme une masse de texte unique et juge si, globalement, il est positif ou négatif. Cela fonctionne pour des commentaires simples, mais échoue lorsque l’on loue un aspect et que l’on critique un autre dans la même phrase. Le domaine de l’analyse des sentiments basée sur les aspects (Aspect-Based Sentiment Analysis) s’attache à répondre à la question : quel est le sentiment envers chaque cible spécifique, comme « service », « ambiance » ou « personnel » dans un avis de restaurant. Les méthodes antérieures s’appuyaient sur des règles manuelles ou des apprentissages simples fondés sur le comptage de mots, puis sont passées à des réseaux neuronaux qui lisent le texte en séquence, comme de gauche à droite. Ces modèles séquentiels ont amélioré la précision mais manquaient encore les liens à longue distance et les signaux subtils, en particulier lorsque les mots importants sont éloignés ou reliés par des mots de contraste comme « mais » et « bien que ».

Transformer les phrases en cartes connectées

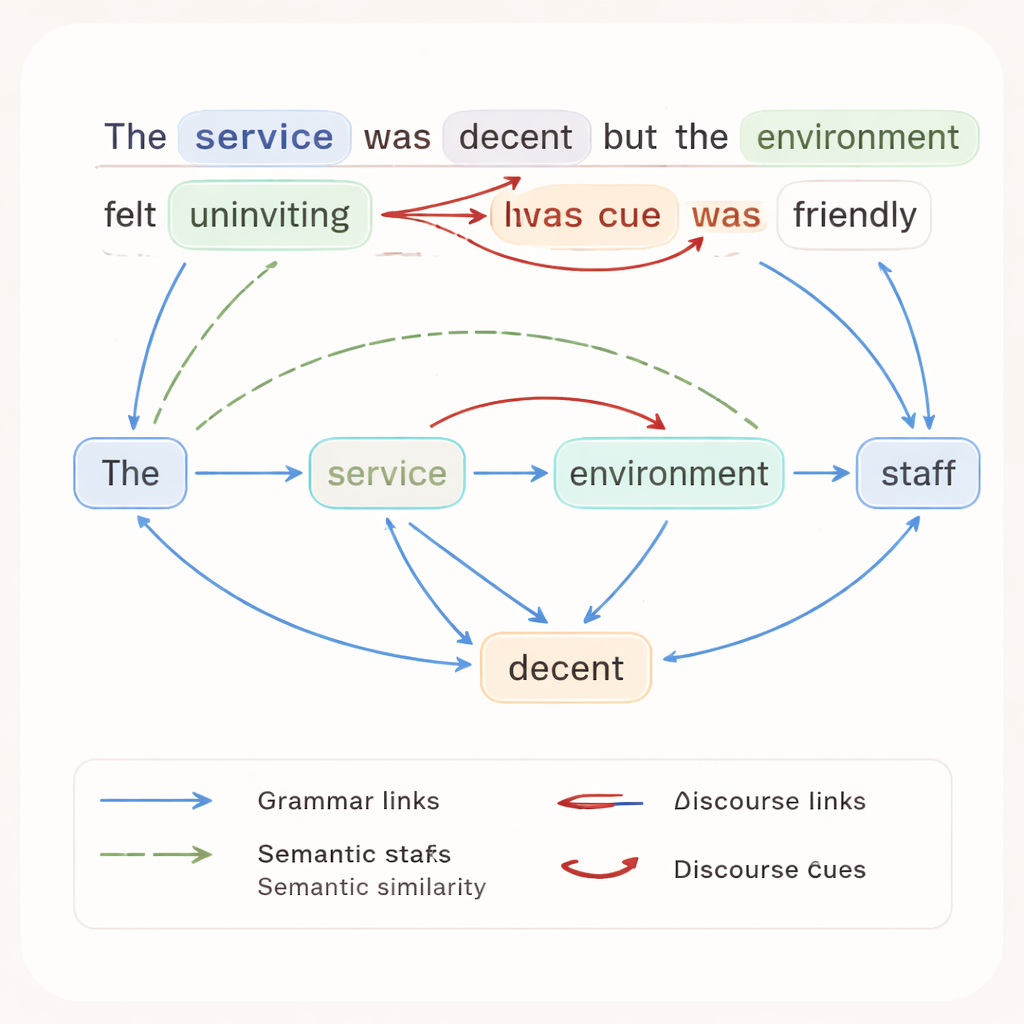

Les auteurs soutiennent que pour vraiment comprendre les opinions fines, un ordinateur devrait voir une phrase comme un réseau plutôt que comme une ligne droite. Dans leur approche, chaque mot devient un nœud dans un graphe, et différents types de relations deviennent des arêtes. Un ensemble d’arêtes capture la grammaire, par exemple quel mot est sujet ou objet. Un autre relie des mots de sens similaire, même s’ils ne sont pas voisins. Un troisième identifie les indices discursifs — des mots comme « mais », « cependant » ou « bien que » qui signalent souvent un changement de sentiment. Dans une phrase comme « Le service était correct mais l’ambiance donnait une impression de froideur bien que le personnel fût sympathique », ce graphe montre comment louanges et critiques s’entrelacent autour de différents aspects.

Un double projecteur sur le contexte et les cibles

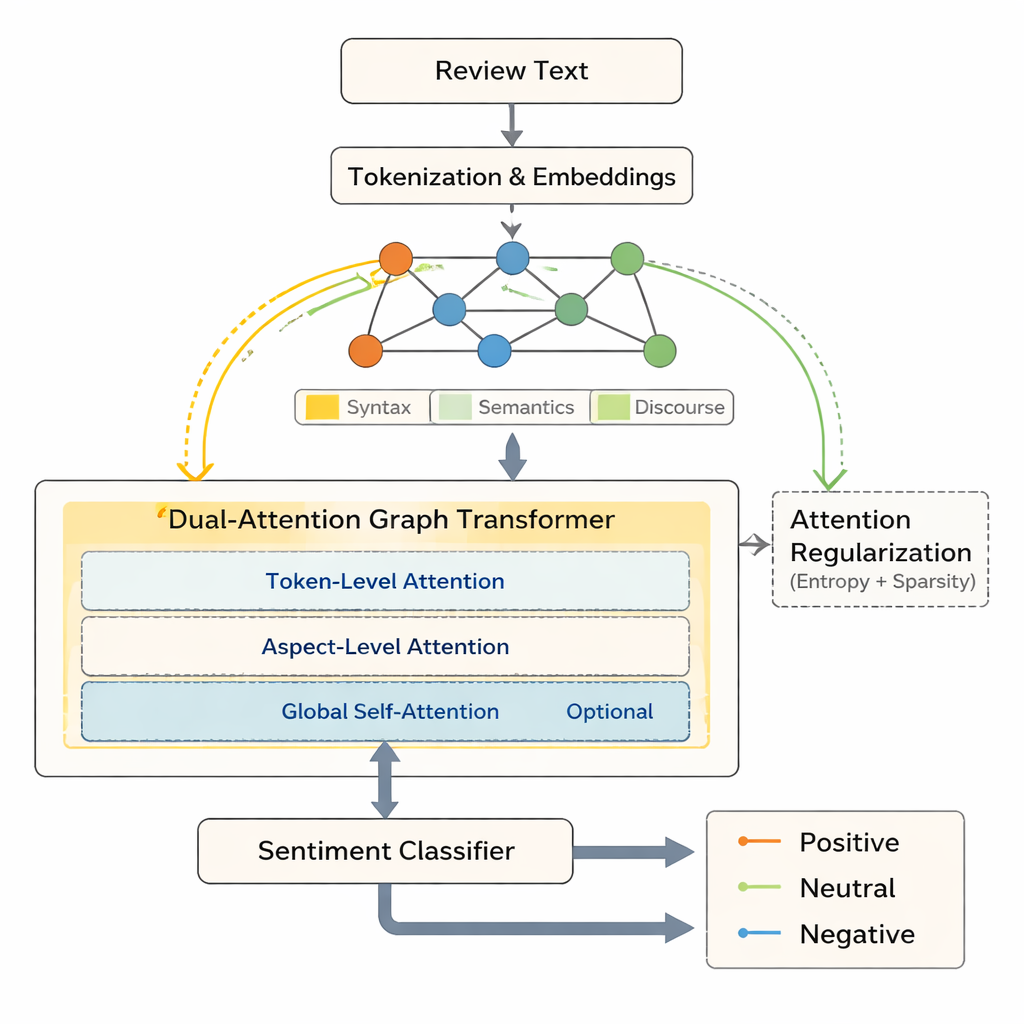

S’appuyant sur cette vision en graphe, l’article présente le Multi-Relational Dual-Attention Graph Transformer (MRDAGT). Ce modèle utilise un mécanisme d’attention de type Transformer adapté aux graphes. Une tête d’attention regarde largement comment tous les mots de la phrase se relient entre eux, récoltant un contexte local utile. Une seconde tête d’attention se concentre spécifiquement sur l’aspect considéré — par exemple « service » ou « ambiance » — et augmente l’influence des mots qui façonnent l’opinion sur cette cible, comme « correct » ou « peu accueillant ». Quand plusieurs aspects coexistent dans une même phrase, une couche d’attention globale optionnelle aide le modèle à évaluer leurs interactions. En pratique, le système déploie deux projecteurs coordonnés : l’un sur la structure générale de la phrase, l’autre directement sur l’aspect dont il cherche à juger le sentiment.

Rendre l’attention des machines plus sélective et explicable

Une préoccupation majeure avec l’IA moderne est que les poids d’attention — les nombres qui indiquent sur quels mots le modèle s’est focalisé — peuvent être trop diffus, rendant les décisions difficiles à interpréter. MRDAGT répond à cela par deux forces de régularisation. Une pénalité d’entropie décourage une attention trop plate, incitant le modèle à se concentrer plus nettement sur quelques mots importants. Simultanément, un terme de parcimonie L1 pousse de nombreux liens d’attention vers zéro, élaguant les connexions faibles et bruitées. Ensemble, ces forces créent une « parcimonie focalisée » : le modèle a tendance à attribuer des poids clairs et élevés aux paires mot–aspect réellement pertinentes tout en ignorant les distractions. Des expériences sur trois jeux de données de référence — avis formels sur des ordinateurs portables, avis complexes multi-phrases et messages informels sur Twitter — montrent que MRDAGT dépasse systématiquement des systèmes solides existants d’environ un à deux points de pourcentage en précision, tout en produisant des cartes d’attention plus nettes et plus interprétables.

Ce que cela signifie pour l’extraction d’opinions en pratique

Pour le grand public, l’essentiel est que ce modèle offre une manière plus précise et plus fiable d’extraire des opinions à partir de textes réels et désordonnés. Plutôt que de se contenter de dire qu’un avis est « plutôt positif », MRDAGT peut indiquer séparément que les clients apprécient la rapidité d’un appareil mais détestent sa batterie, ou que des clients aiment le personnel d’un café tout en se plaignant du bruit. Parce que ses schémas d’attention correspondent à l’intuition humaine — en se concentrant sur les mots de contraste, les adjectifs de sentiment et les termes d’aspect — il est plus facile pour les analystes de comprendre pourquoi le modèle a rendu un jugement particulier. Les auteurs suggèrent que cette approche peut soutenir de meilleures décisions de conception produit, une surveillance des réseaux sociaux plus pointue, et des extensions futures à de nombreuses langues et même à des données multimodales comme l’audio et les images, tout en conservant un processus de raisonnement relativement transparent.

Citation: Anilkumar, A.P., Kim, SK. & Yoon, YC. Scientific reports multi relational dual attention graph transformer for fine grained sentiment analysis. Sci Rep 16, 7236 (2026). https://doi.org/10.1038/s41598-026-36490-6

Mots-clés: analyse des sentiments basée sur les aspects, réseaux de neurones graphiques, attention de type transformer, extraction d’opinions, traitement automatique du langage naturel