Clear Sky Science · fr

Un réseau collaboratif à multi-attention pour la détection en temps réel de petits objets dans les images UAV

Pourquoi détecter de minuscules détails depuis le ciel est important

À mesure que les drones deviennent des outils courants pour la surveillance du trafic, la réponse aux catastrophes et la sécurité, ils doivent repérer de manière fiable des objets très petits — comme des voitures, des vélos ou des personnes — vus d'une grande hauteur. Dans ces vues aériennes, les cibles ne font que quelques pixels de large et peuvent facilement se perdre dans les ombres, les reflets et des arrière-plans encombrés. Cet article présente un nouveau système de vision par ordinateur, appelé Collaborative Multi-Attention Network (CMA-Net), conçu pour détecter rapidement et avec précision ces petits objets dans les images de drone, suffisamment pour un usage en temps réel.

Les défis de l’observation des petits objets depuis les airs

La détection de petits objets dans les images de drone est plus difficile que dans les photos de rue ordinaires. Parce que les drones volent haut et observent les scènes sous de nombreux angles, véhicules et personnes apparaissent minuscules et flous, et l’éclairage peut varier rapidement. Les détecteurs traditionnels en deux étapes peuvent être très précis mais sont souvent trop lents pour un usage en temps réel sur des plateformes volantes avec des capacités de calcul et une bande passante limitées. Les méthodes plus rapides en une étape fonctionnent en temps réel mais ont tendance à manquer les petites cibles car leurs détails s’estompent progressivement au fur et à mesure que les images sont traitées couche après couche. Les auteurs soutiennent qu’une meilleure détection des petits objets nécessite des façons plus intelligentes de combiner l’information entre les échelles et de concentrer l’attention computationnelle sur les parties les plus informatives d’une image.

Construire une échelle de caractéristiques plus intelligente

CMA-Net part d’un backbone de traitement d’images largement utilisé, ResNet-50, puis ajoute un Efficient Bi-directional Feature Pyramid Network (E-BiFPN). Cette structure construit une sorte d’échelle de cartes de caractéristiques à différentes tailles, permettant au système de mêler des détails fins des premières couches avec un contexte plus abstrait des couches profondes. Contrairement aux conceptions antérieures, l’E-BiFPN supprime les couches de haut niveau inutiles et ajoute un bloc de traitement léger spécial qui utilise des convolutions partielles pour réduire le coût de calcul. Un schéma de fusion pondéré apprend ensuite à quel point il faut faire confiance aux caractéristiques superficielles versus profondes à chaque échelle, de sorte que l’information fragile sur de petites voitures ou piétons soit renforcée tandis que le bruit de l’arrière-plan est réduit.

Apprendre au réseau où regarder

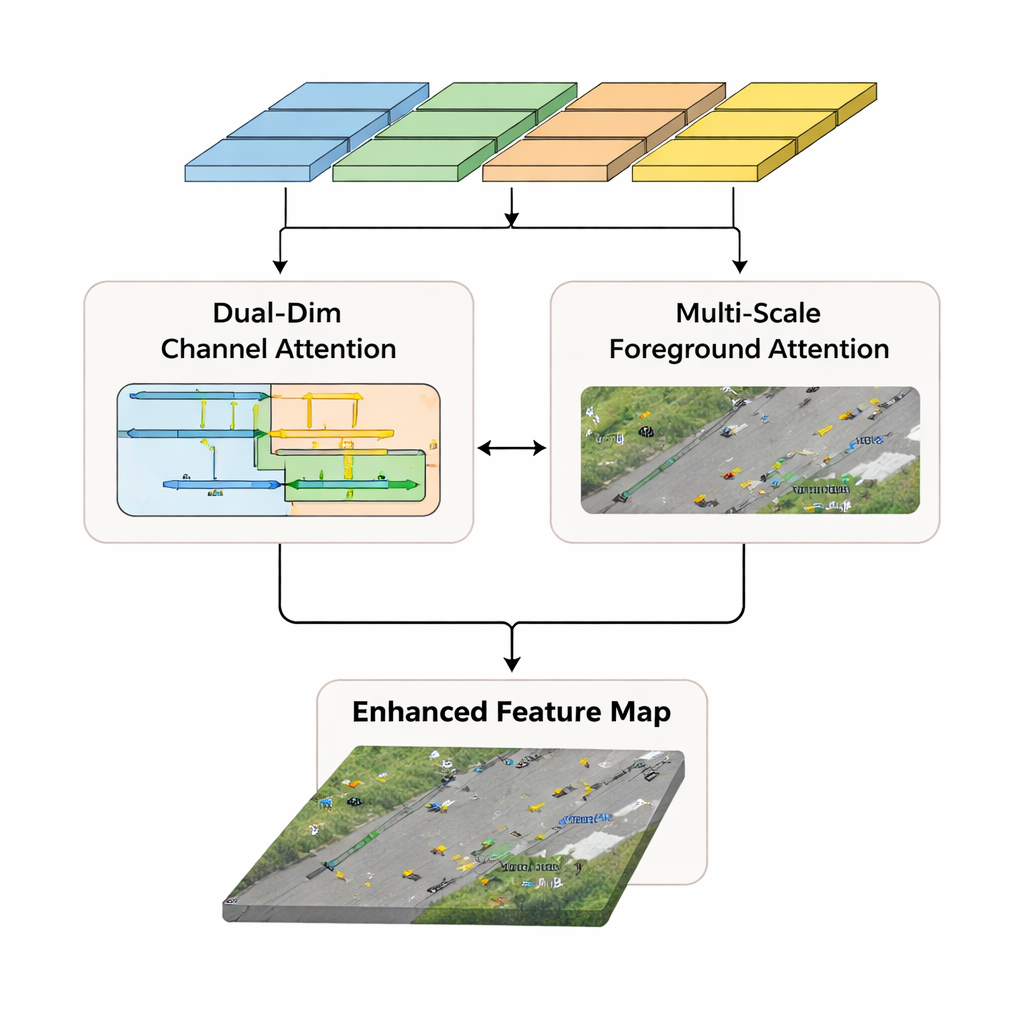

Au-delà de la réorganisation des caractéristiques, CMA-Net utilise des mécanismes d’attention qui imitent la façon dont les humains se concentrent sur les parties pertinentes d’une scène. Un module d’attention de canal à double dimension (Dual-Dimensional Channel Attention, DDCA) analyse les caractéristiques séparément le long de la largeur et de la hauteur de l’image, plutôt que de tout compresser en un résumé global unique. Cette conception aide le réseau à capturer des motifs à longue portée dans les directions horizontale et verticale, en préservant des indices de localisation cruciaux lorsque de petits objets se fondent dans des environnements complexes. En parallèle, un module d’attention premier-plan multi-échelle (Multi-Scale Foreground Attention, MSFA) relie les objets volumineux et facilement reconnaissables des couches profondes aux plus petits présents dans les couches superficielles. En échantillonnant et en fusionnant des informations sur trois échelles, le MSFA apprend à mettre en évidence les régions de premier plan où les véhicules sont susceptibles d’apparaître et à supprimer les textures d’arrière-plan confuses.

Des caractéristiques améliorées à des décisions rapides

Les sorties des branches DDCA et MSFA sont fusionnées en cartes de caractéristiques riches, adaptées aux petits objets, qui sont transmises à une tête de détection « sans ancrage ». Plutôt que de s’appuyer sur une grille dense de boîtes préétablies, cette tête prédit directement à la fois la catégorie et la position des objets, simplifiant les calculs et rendant l’entraînement plus flexible. Les auteurs ont évalué CMA-Net sur deux jeux de données publics exigeants pour drones, UAVDT et Stanford Drone, qui incluent des routes encombrées, des conditions météorologiques variées et des situations jour–nuit. CMA-Net a atteint des scores de précision de 67,2 % et 62,0 % sur ces jeux de données tout en tournant à 64 images par seconde, ce qui signifie qu’il peut traiter la vidéo en temps réel tout en surpassant de nombreux détecteurs populaires, y compris certains membres de la famille YOLO et des modèles plus complexes basés sur des transformers.

Ce que cela signifie pour l’usage réel des drones

Pour les non-spécialistes, la conclusion clé est que CMA-Net améliore significativement la capacité d’un drone à remarquer des objets petits et difficiles à voir sans le ralentir. En fusionnant soigneusement l’information à travers plusieurs échelles et en orientant l’attention du réseau à la fois à travers les canaux d’image et entre premier-plan et arrière-plan, la méthode empêche que de minuscules véhicules et personnes soient négligés. Cette combinaison de précision et de rapidité rend l’approche prometteuse pour des applications pratiques telles que la surveillance intelligente du trafic, l’observation de foules et la réponse d’urgence, là où manquer un petit objet ou réagir trop lentement pourrait avoir des conséquences graves.

Citation: Yang, J., Yue, X. & Wu, L. A collaborative multi-attention network for real-time small object detection in UAV imagery. Sci Rep 16, 5852 (2026). https://doi.org/10.1038/s41598-026-36440-2

Mots-clés: vision par drone, détection de petits objets, surveillance en temps réel, réseaux d'attention, surveillance du trafic