Clear Sky Science · fr

Fusion coopérative réciproque par gating de SqueezeNet et ShuffleNetV2 pour la détection du cancer du sein dans les images histopathologiques

Une aide plus intelligente pour le diagnostic du cancer du sein

Lorsqu’une masse est détectée au sein, les médecins s’appuient souvent sur de fines coupes de tissu, colorées et observées au microscope, pour décider si les cellules sont bénignes ou cancéreuses. Cette inspection attentive reste la référence pour le diagnostic, mais elle est lente, pénible et peut varier d’un spécialiste à l’autre. L’étude présentée ici décrit un outil informatique qui analyse ces images microscopiques à l’aide de l’intelligence artificielle, visant à fournir aux pathologistes des seconds avis rapides, cohérents et très précis, tout en maintenant des coûts de calcul suffisamment bas pour une utilisation quotidienne en milieu hospitalier.

Le défi de la lecture des images tissulaires

Le cancer du sein est l’un des cancers les plus fréquents dans le monde et cause des centaines de milliers de décès chaque année. L’amélioration des résultats passe par la détection et la caractérisation précoces des tumeurs, ce qui dépend toujours principalement de l’histopathologie : l’examen de coupes de tissu colorées au microscope. Or, de nombreux motifs tissulaires se ressemblent de manière trompeuse. Des échantillons normaux et bénins (non dangereux) peuvent partager des structures proches, tandis que les stades précoces et les cancers invasifs peuvent se confondre. À cela s’ajoutent les variations de colorants, d’éclairage et de contraste d’une salle de laboratoire à l’autre, qui peuvent faire paraître une même maladie très différente. Les programmes informatiques traditionnels peinent avec ces subtilités, et beaucoup de systèmes modernes d’apprentissage profond qui s’en sortent mieux sont si volumineux et énergivores qu’ils sont difficiles à déployer en dehors des grands centres de recherche.

Deux réseaux compacts qui travaillent en équipe

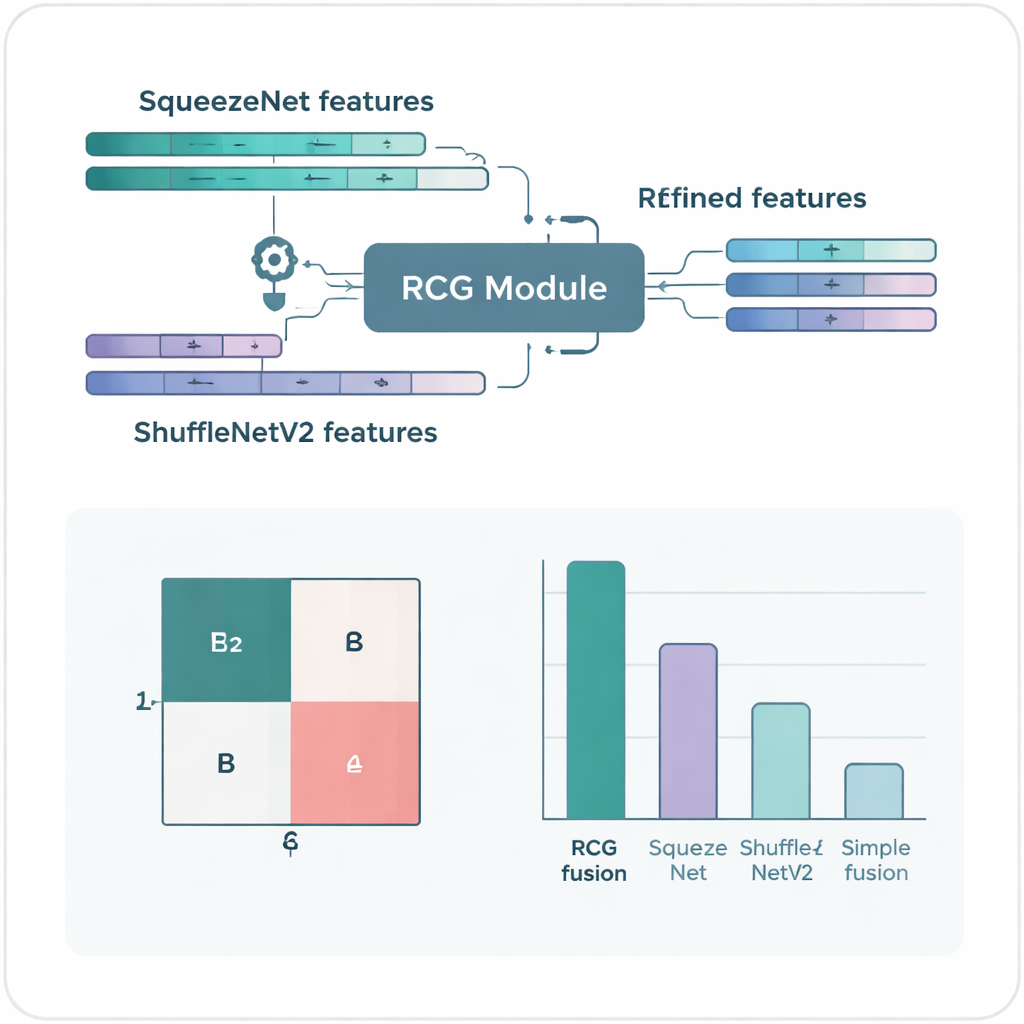

Pour relever ce défi, les auteurs combinent deux réseaux neuronaux compacts existants, connus sous les noms de SqueezeNet et ShuffleNetV2. Ces modèles ont été conçus à l’origine pour reconnaître des objets du quotidien sur des photos tout en utilisant beaucoup moins de calculs que des architectures lourdes comme les Transformers ou des réseaux très profonds. Dans ce travail, ils sont réentraînés pour reconnaître des motifs dans des images de tissu mammaire. Chaque réseau examine la même image microscopique et apprend à détecter différents indices visuels — variations subtiles de la forme cellulaire, textures tissulaires et agencements de couleur. Pris isolément, chaque modèle donne de bonnes performances, mais l’innovation réelle réside dans la manière dont leurs forces sont fusionnées.

Un mécanisme de gating qui filtre le bruit

L’idée centrale de l’étude est un nouveau module de « gating coopératif réciproque » qui permet aux deux réseaux de communiquer et de décider quelles parties de leurs signaux internes sont vraiment utiles. Plutôt que d’empiler ou de moyenniser simplement leurs sorties, le système de gating évalue la quantité d’information portée par chaque canal et son redondance par rapport à ce que le réseau partenaire a déjà capté. Les canaux qui apportent un détail nouveau et utile sont amplifiés, tandis que ceux qui répètent l’information ou ajoutent du bruit sont atténués. Cet ajustement aller‑retour s’opère dans les deux sens : SqueezeNet affine les caractéristiques de ShuffleNetV2 et réciproquement. Le résultat est une représentation fusionnée de chaque image, plus riche, plus nette et mieux centrée sur les différences minimes qui séparent un diagnostic d’un autre.

Haute précision avec un calcul léger

Testé sur deux jeux d’images mammaires largement utilisés, ICIAR‑2018 et BreakHis, le système fusionné affiche des performances remarquables. Sur la tâche à quatre classes — distinguer tissu normal, modifications bénignes, cancer in situ précoce et cancer invasif — il classe correctement 97 % des images. Quand la tâche est simplifiée en séparation tumeur / non‑tumeur, la précision monte à 99 % sur ICIAR‑2018 et environ 99,7 % sur BreakHis. Ces scores dépassent ceux de nombreuses méthodes plus complexes rapportées dans la littérature, malgré l’emploi d’un modèle relativement parcimonieux en paramètres et en puissance de calcul, ce qui se traduit par des prédictions plus rapides et des exigences matérielles plus modestes.

Ce que cela signifie pour les patientes et les cliniques

Concrètement, les auteurs ont développé un assistant compact mais puissant capable d’examiner des images microscopiques de tissu mammaire et de les étiqueter avec une fiabilité proche de celle d’un expert. Grâce à une conception efficace, il se prête mieux aux environnements réels comme les hôpitaux régionaux ou les centres de dépistage qui ne disposent pas de serveurs haut de gamme. Si le système ne remplace pas les pathologistes, il peut mettre en évidence des régions suspectes, fournir des seconds avis cohérents et potentiellement accélérer le diagnostic. Ce travail illustre aussi une tendance plus large : en combinant astucieusement de plus petits modèles d’IA et en leur apprenant à coopérer plutôt qu’à se concurrencer, il est possible d’obtenir une précision de premier ordre sans le coût et la complexité qui freinent souvent l’adoption de l’IA médicale en pratique.

Citation: Khati, B., Mukherjee, S., Sinitca, A. et al. Reciprocal cooperative gating fusion of SqueezeNet and ShuffleNetV2 for breast cancer detection in histopathology images. Sci Rep 16, 5904 (2026). https://doi.org/10.1038/s41598-026-36375-8

Mots-clés: cancer du sein, histopathologie, IA en imagerie médicale, CNN léger, diagnostic assisté par ordinateur