Clear Sky Science · fr

Exploiter les modèles d’analyse de sujets pour explorer les dimensions psychologiques dans les données des réseaux sociaux

Pourquoi nos mots en ligne comptent

Des millions de personnes parlent de leurs émotions sur les réseaux sociaux chaque jour, souvent plus ouvertement que dans la vie réelle. Cachés dans cet océan de commentaires informels se trouvent des indices précieux sur la santé mentale, notamment des signes de dépression ou d’automutilation. Cette étude pose une question simple aux implications importantes : l’intelligence artificielle moderne peut‑elle trier le bruit des échanges en ligne, repérer des thèmes significatifs et aider les professionnels à mieux comprendre les risques psychologiques — sans lire chaque publication une par une ?

Transformer le chaos en thèmes

Les chercheurs se sont concentrés sur un vaste corpus de messages Reddit issu de l’initiative eRisk, qui comprend des personnes ayant déclaré un diagnostic de dépression et un groupe témoin sans diagnostics connus. Leur objectif n’était pas de diagnostiquer des individus, mais de vérifier si l’analyse de sujets — des techniques qui regroupent les textes par thèmes communs — pouvait révéler des motifs pertinents pour la santé mentale. Comme le langage des réseaux sociaux est désordonné, rempli d’argot, de fautes de frappe et de changements brusques de sujet, il constitue un banc d’essai réaliste mais très exigeant pour ces méthodes.

Trois façons de découvrir de quoi parlent les gens

L’étude a comparé trois familles de modèles de sujets. Le premier, Latent Dirichlet Allocation (LDA), est une méthode classique qui s’appuie sur la fréquence d’apparition conjointe des mots dans les documents. Le deuxième, BERTopic, utilise de puissants modèles de langage modernes pour transformer chaque message en une représentation numérique riche, puis regroupe les messages similaires et extrait des mots-clés pour chaque groupe. Le troisième, TopClus, repose lui aussi sur des réseaux neuronaux, combinant des mécanismes d’attention et du clustering dans un espace mathématique partagé. Les trois ont été exécutés avec des paramètres standards pour produire chacune 50 thèmes, reproduisant l’usage courant par de nombreux chercheurs en mode « prêt à l’emploi ».

Demander aux humains, pas seulement aux formules

Pour juger de la portée réelle des thèmes, l’équipe ne s’est pas fiée aux seuls scores automatiques. Six annotateurs formés ont examiné 150 thèmes, chacun représenté par ses mots principaux et quelques publications centrales. Pour chaque thème, ils ont évalué la cohérence de la liste de mots, la cohérence des exemples de publications et la correspondance entre mots et publications. Ils ont également tenté, quand c’était possible, de donner un nom court et intuitif à chaque thème. Cette approche centrée sur l’humain a révélé une constatation clé : les métriques numériques de « cohérence », populaires en recherche, divergent souvent du jugement humain, notamment sur des textes désordonnés issus des réseaux sociaux.

Le grand gagnant et ce qu’il a révélé

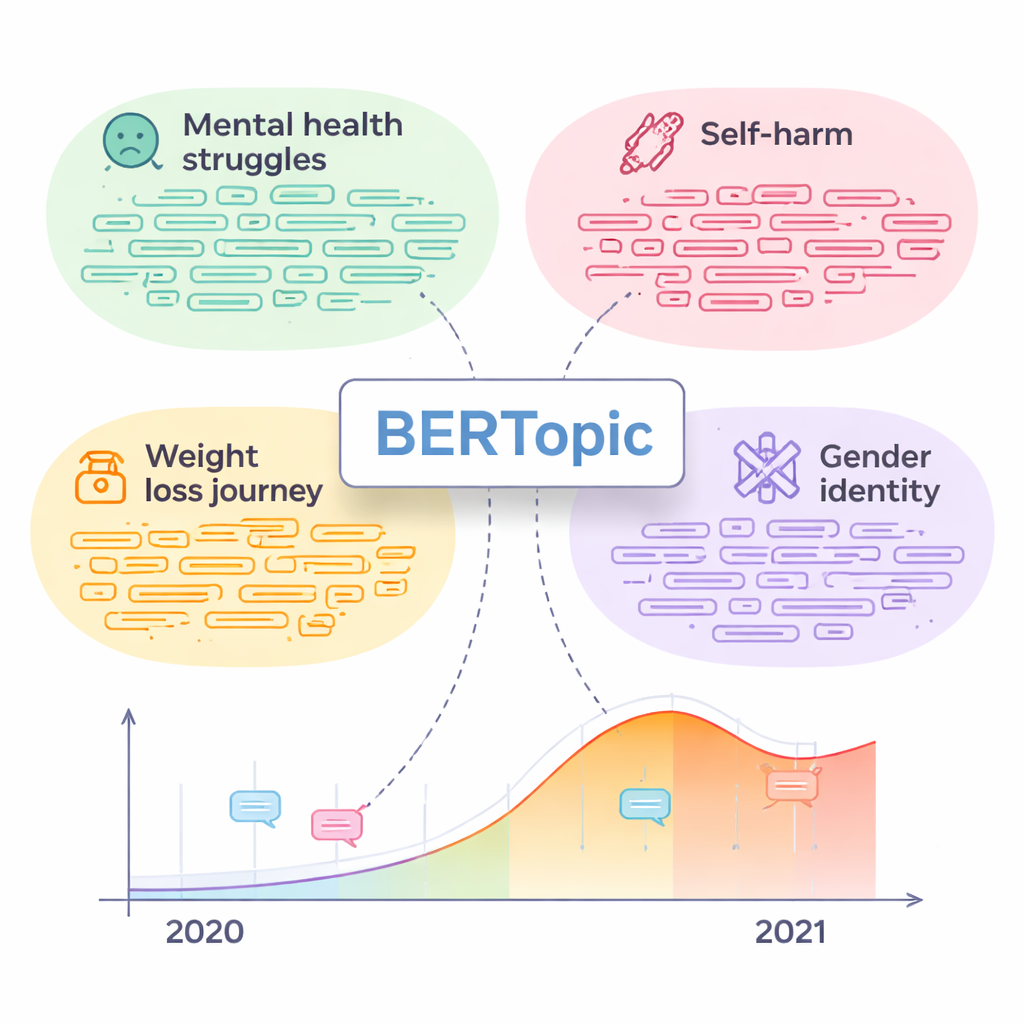

Sur l’ensemble des évaluations humaines, BERTopic a clairement produit les thèmes les plus compréhensibles et spécifiques. Les annotateurs ont pu nommer ses thèmes bien plus souvent que ceux des autres modèles, et leur accord mutuel était solide, à un niveau modéré. LDA, en revanche, regroupait souvent des mots et des publications sans lien apparent, donnant une impression presque aléatoire aux réviseurs. Une fois les meilleurs thèmes sélectionnés, les chercheurs ont analysé ce dont parlaient réellement les gens. Certains thèmes, comme « Luttes de santé mentale » et « Automutilation », étaient fortement corrélés aux utilisateurs souffrant de dépression et contenaient de nombreux messages exprimant de la détresse. D’autres, moins manifestement cliniques — tels que « Parcours de perte de poids », « Identité de genre », « Rêves sexuels » et « Étiquette de consommation d’alcool en société » — se sont révélés contenir une proportion élevée de messages d’utilisateurs dépressifs et de nombreux signes de souffrance émotionnelle. Une analyse temporelle simple a montré que l’activité sur certains de ces thèmes sensibles a fortement augmenté pendant la pandémie de COVID‑19, reflétant des rapports plus larges sur la détérioration de la santé mentale.

Des schémas en ligne à l’aide concrète

Pour mieux estimer la gravité potentielle de certains messages, les auteurs ont utilisé un modèle de langage distinct pour mapper approximativement le contenu sur des items d’un questionnaire de dépression bien connu (l’inventaire de dépression de Beck). Cette étape exploratoire a suggéré que certains thèmes, en particulier autour des luttes mentales, de l’automutilation, de l’image corporelle et de l’identité de genre, contiennent fréquemment un langage associé à des symptômes dépressifs modérés à sévères. Les auteurs soulignent que ces lectures automatisées ne sont pas des diagnostics cliniques, mais qu’elles peuvent aider à mettre en évidence les endroits où l’attention d’experts est la plus urgente.

Ce que cela signifie pour la santé mentale et la technologie

Concrètement, l’étude montre que les modèles de sujets les plus avancés aujourd’hui, en particulier BERTopic, peuvent transformer des conversations chaotiques sur les réseaux sociaux en thèmes clairs qui correspondent à des préoccupations psychologiques réelles. Elle montre aussi qu’il est risqué de faire une confiance aveugle aux scores automatiques ; la relecture humaine reste essentielle lorsque l’objectif est de soutenir des décisions liées à la santé mentale. À l’avenir, des outils similaires pourraient aider cliniciens, organismes publics et chercheurs à surveiller les tendances générales, repérer les risques émergents et concevoir de meilleures actions de prévention — tout en laissant le jugement final et la prise en charge aux professionnels humains.

Citation: Couto, M., Parapar, J. & Losada, D.E. Exploiting topic analysis models to explore psychological dimensions in social media data. Sci Rep 16, 6047 (2026). https://doi.org/10.1038/s41598-026-36339-y

Mots-clés: réseaux sociaux et dépression, modélisation de sujets, schémas de santé mentale, signaux d’automutilation en ligne, modèles de langage en psychologie