Clear Sky Science · fr

ADAT : nouvelle architecture adaptative de transformeur sensible aux séries temporelles pour la traduction de la langue des signes

Combler le fossé de communication

Pour des millions de personnes sourdes ou malentendantes, des tâches quotidiennes comme consulter un médecin ou regarder un bulletin météo peuvent être plus difficiles qu’elles ne devraient l’être, simplement parce que les interprètes qualifiés en langue des signes sont rares. Cet article présente un nouveau système d’intelligence artificielle, nommé ADAT, qui transforme les vidéos en langue des signes en phrases écrites de manière plus précise et plus efficace que de nombreux systèmes existants, nous rapprochant d’une traduction en temps réel, largement disponible sur téléphones, tablettes et ordinateurs hospitaliers.

Pourquoi la langue des signes est difficile pour les ordinateurs

Les langues des signes sont riches et complexes, avec leur propre grammaire, et elles reposent sur bien plus que le mouvement des mains. Les expressions faciales, la posture du corps et le rythme subtil modifient tous le sens d’une phrase signée. Les systèmes de traduction modernes utilisent souvent une architecture performante appelée transformeur, très bonne pour comprendre de longues phrases parlées ou écrites. Mais pour la vidéo à haute vitesse — 30 à 60 images par seconde — ces systèmes peuvent devenir lents et peinent à repérer les mouvements rapides et fins qui distinguent un signe d’un autre. Ils demandent aussi beaucoup de puissance de calcul et de temps d’entraînement, ce qui complique leur mise à jour au fur et à mesure que les langues des signes évoluent.

Une manière plus intelligente d’interpréter la signature

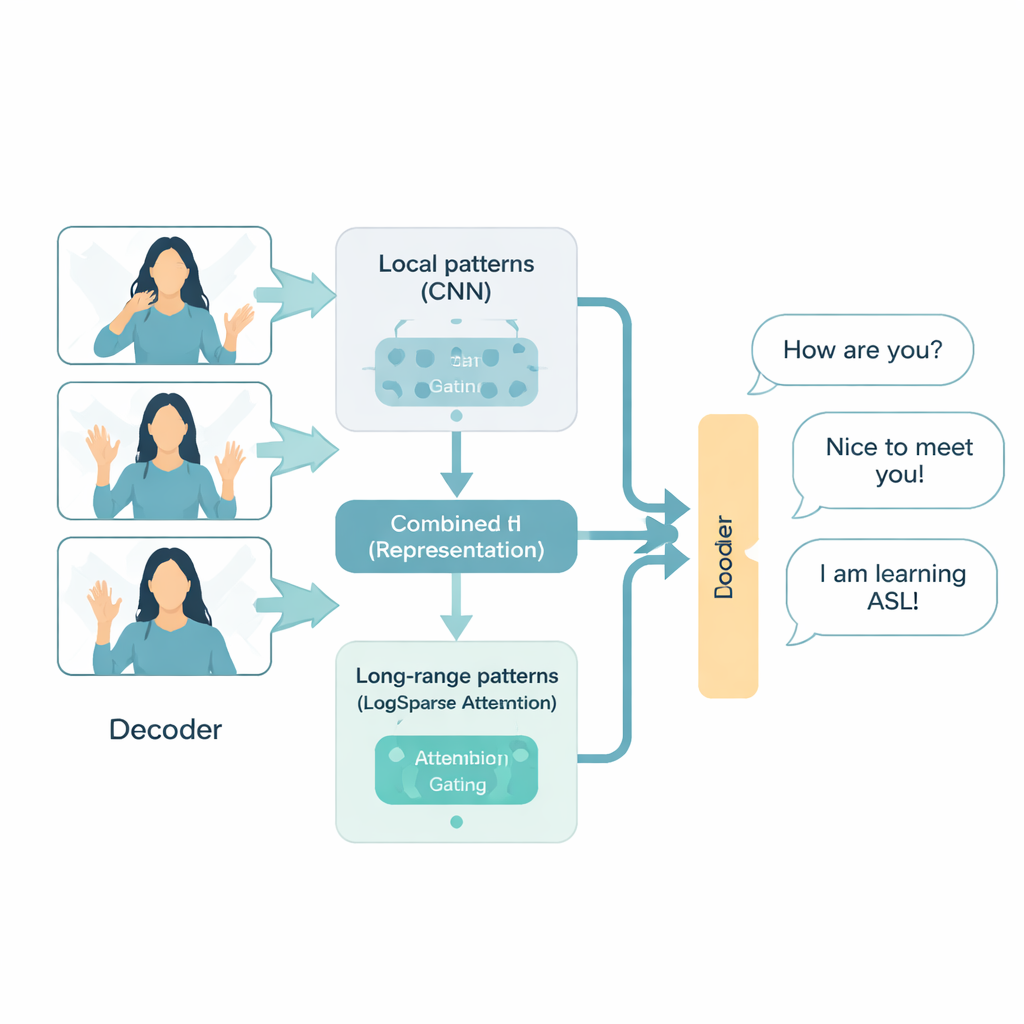

L’architecture ADAT est conçue spécifiquement pour la vidéo en langue des signes, la traitant comme une série temporelle : un flux rapide d’événements visuels se déroulant dans le temps. Elle combine trois idées. Premièrement, elle utilise des réseaux de neurones convolutionnels, une technique éprouvée en imagerie, pour zoomer sur des motifs locaux comme la forme des mains et les indices faciaux. Deuxièmement, elle emploie une forme d’attention plus efficace, qui revient sélectivement sur des moments clés de la vidéo plutôt que de comparer chaque image à toutes les autres. Troisièmement, une « porte » adaptative apprend à fusionner l’information détaillée à court terme avec le contexte plus large à long terme, décidant en temps réel de ce qui importe le plus pour chaque partie d’une phrase. Ensemble, ces composants permettent à ADAT de saisir à la fois le mouvement rapide d’un doigt et la structure globale d’une conversation sans gaspiller de calculs.

Des signes aux mots par deux voies

La traduction en langue des signes peut être organisée en deux étapes principales : d’abord reconnaître les unités de base du signe, appelées glosses, puis transformer ces glosses en texte parlé ou écrit. C’est la démarche signe→glosse→texte. Alternativement, un système peut tenter d’aller directement de la vidéo au texte en une seule passe, appelée signe→texte. Les auteurs testent ADAT sur ces deux approches. Ils le comparent à plusieurs solides modèles basés sur des transformeurs, dont un système bien connu appelé SLTUNET, sur trois jeux de données : un large corpus allemand de bulletins météo, une collection d’Indian Sign Language, et un nouveau jeu de données médico‑ASL (American Sign Language) créé par les auteurs pour refléter des conversations réalistes médecin–patient.

Entraînement plus rapide et traductions plus nettes

Sur ces tests, ADAT égalise ou dépasse les meilleurs modèles concurrents en qualité de traduction, mesurée par les scores BLEU standards, tout en s’entraînant sensiblement plus vite. Dans la configuration en deux étapes signe→glosse→texte, il fournit des scores similaires ou légèrement supérieurs à ceux d’un transformeur classique tout en réduisant le temps d’entraînement d’environ un cinquième en moyenne. Dans la configuration directe signe→texte, plus exigeante, ADAT surpasse clairement les baselines à encodeur seul, décodeur seul et transformeur unifié, améliorant souvent la précision d’environ un point de pourcentage ou plus, toujours avec à peu près 20 % d’entraînement en moins. L’analyse détaillée des fondements mathématiques montre que l’attention plus sélective et la conception à double voie d’ADAT réduisent substantiellement le nombre d’opérations requises, surtout pour les vidéos longues ou à fort nombre d’images par seconde.

De nouvelles données pour des conversations cruciales

Pour s’assurer que ces méthodes s’appliquent au‑delà des environnements de laboratoire, les auteurs présentent MedASL, le premier jeu de données en American Sign Language axé sur la communication médicale. Il se compose de 500 phrases uniques, soigneusement conçues, qui simulent des interactions réelles entre patients et professionnels de santé et inclut à la fois des annotations en glosses et en texte. Cet accent sur le domaine médical est important parce que les malentendus à l’hôpital ou en clinique peuvent avoir des conséquences graves, et les jeux de données existants couvrent rarement ce domaine. ADAT donne de bonnes performances sur MedASL, bien que les résultats montrent aussi à quel point il est difficile pour tout système de se généraliser parfaitement à de nouvelles phrases issues du monde réel.

Ce que cela signifie pour la vie quotidienne

En termes simples, l’étude montre que l’on peut construire des systèmes de traduction de la langue des signes à la fois plus intelligents et plus économes : ils nécessitent moins de temps et de puissance de calcul pour l’entraînement, tout en capturant mieux les subtilités du signe. ADAT n’est pas encore un interprète clé en main pour toutes les langues des signes en toutes circonstances, et il reste derrière des systèmes reposant sur de très grands modèles préentraînés. Mais en se concentrant sur les motifs vidéo sensibles au temps et sur l’efficacité, il indique la voie vers des outils pratiques qui pourraient un jour fonctionner sur des appareils courants, prendre en charge plusieurs langues des signes et aider les utilisateurs sourds à communiquer plus facilement dans des contextes cruciaux tels que la santé, les interventions d’urgence et les services publics.

Citation: Shahin, N., Ismail, L. ADAT novel time-series-aware adaptive transformer architecture for sign language translation. Sci Rep 16, 6551 (2026). https://doi.org/10.1038/s41598-026-36293-9

Mots-clés: traduction de la langue des signes, transformeur adaptatif, attention pour séries temporelles, ASL médical, IA accessible