Clear Sky Science · fr

Décision hiérarchique NBV basée sur l'information mutuelle pour le SLAM visuel sémantique actif en environnements dynamiques

Des robots capables d’anticiper

À mesure que les robots sortent des usines pour investir les maisons, hôpitaux et bureaux, ils doivent évoluer dans des espaces remplis de personnes et d’autres objets en mouvement. Cet article présente une nouvelle manière pour un robot de « penser à l’avance » où regarder et comment se déplacer afin de construire une carte fiable de son environnement — même lorsque cet environnement refuse de rester immobile. Ce travail intéressera quiconque souhaite des robots de service plus sûrs, des robots de livraison plus intelligents ou de futurs assistants domestiques qui doivent partager l’espace avec des humains plutôt qu’avec des couloirs vides.

Pourquoi les personnes en mouvement déconcertent les robots

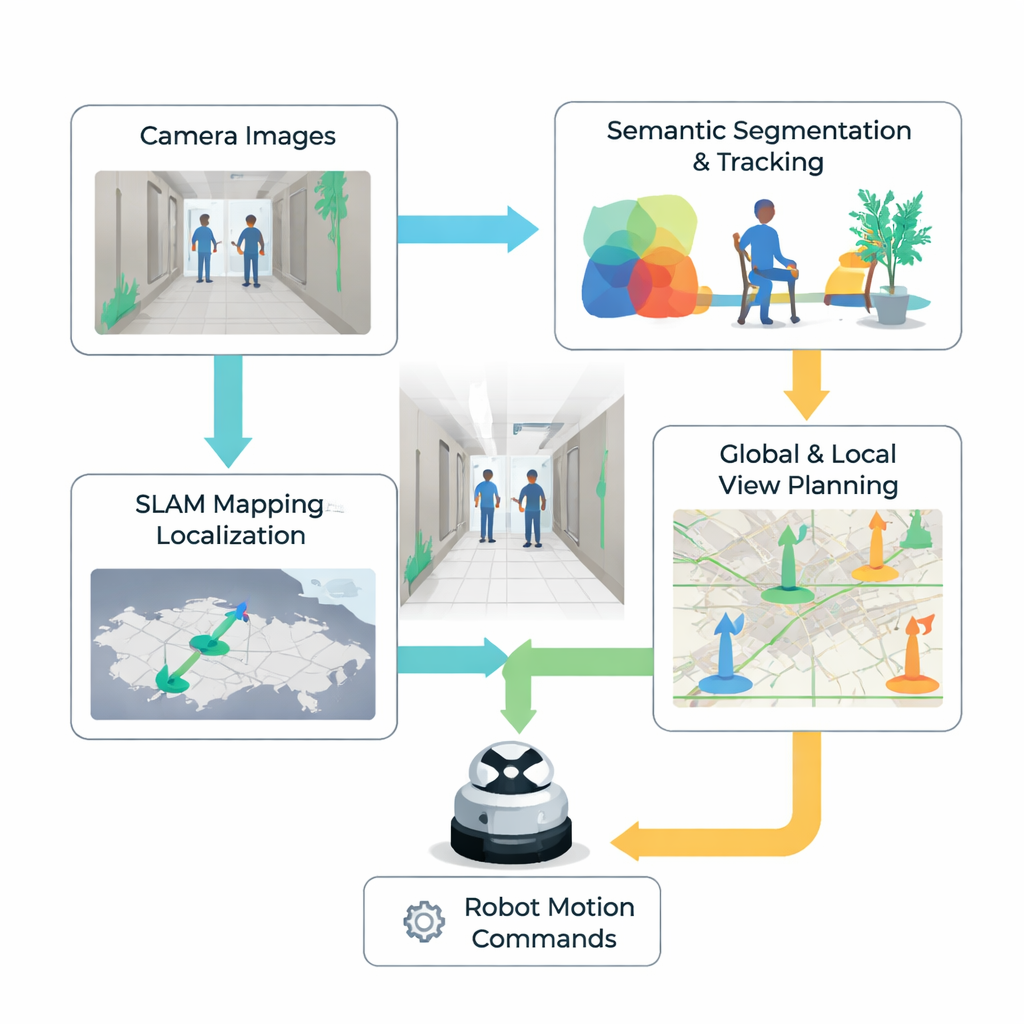

Pour se déplacer de façon autonome, de nombreux robots utilisent une technique appelée SLAM visuel, dans laquelle une caméra aide à construire une carte tout en estimant la position du robot en même temps. Cela fonctionne bien dans des environnements statiques mais se dégrade rapidement quand des personnes passent, obstruent la vue ou portent des objets. Une solution courante consiste à utiliser une vision « sémantique » pour que le robot reconnaisse les personnes, voitures et chaises et les ignore lors de la construction de la carte. Cependant, cela crée un nouveau problème pour les robots actifs qui choisissent leur propre trajectoire : s’ils éliminent trop d’indices visuels, ils risquent de perdre complètement leur localisation. Le champ de vision limité de la caméra aggrave la difficulté, car une seule personne passant tout près peut masquer la plupart du décor utile aux yeux du robot.

Une stratégie à deux niveaux pour choisir où regarder ensuite

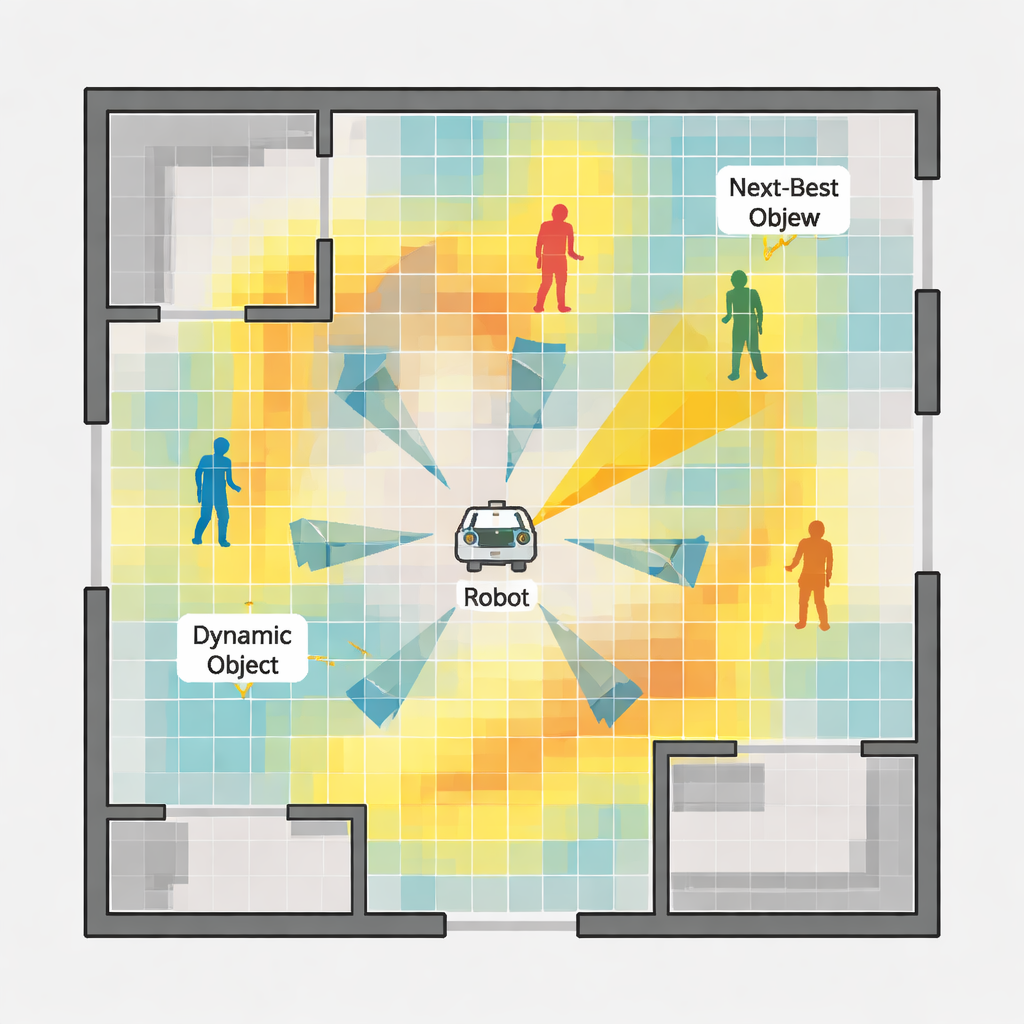

Les auteurs proposent un système de décision hiérarchique qui aide le robot à choisir ses prochains points de vue de manière plus éclairée. Au niveau supérieur, le robot maintient une carte en vue aérienne en grille des zones libres, occupées et inconnues. Il évalue des points de vue potentiels lointains en estimant combien chacun réduirait l’incertitude sur cette carte, concept emprunté à la théorie de l’information. Le robot préfère les emplacements qui révèlent de grandes régions inexplorées tout en prenant en compte la distance à parcourir et l’effort de rotation de la caméra. Une fois une zone prometteuse choisie, un processus de bas niveau prend le relais pour affiner précisément comment le robot doit se déplacer et s’orienter dans ce voisinage afin de réellement voir suffisamment de détails utiles avec sa vue étroite.

Voir ce qui est stable et éviter ce qui ne l’est pas

Au cœur du processus décisionnel local se trouve une « carte de probabilité de caractéristiques » construite à partir de chaque image de la caméra. D’abord, le système détecte des repères visuels — coins et motifs de la scène — susceptibles de rester stables dans le temps et utiles pour le suivi du déplacement. Il utilise ensuite un détecteur d’objets moderne pour repérer les objets potentiellement mobiles, comme les personnes, et les suivre entre les images. En analysant le mouvement de ces objets, le système estime non seulement où ils se trouvent maintenant, mais aussi où ils sont susceptibles d’être dans un proche avenir. Ces deux sources d’information sont fusionnées en une carte de chaleur sur l’image : les régions lumineuses indiquent une forte probabilité d’observer des repères fiables, tandis que les régions plus sombres marquent des zones pauvres en caractéristiques ou probablement masquées par des objets en mouvement. Le robot utilise cette carte pour juger quel petit mouvement — tourner à gauche, à droite ou avancer — lui offrira la vue la plus claire et la plus stable ensuite.

Tests dans des mondes virtuels et dans le monde réel

Les chercheurs ont testé leur approche dans deux espaces intérieurs simulés de tailles et de complexité différentes, chacun peuplé de piétons virtuels errants, puis sur un robot physique circulant dans un environnement intérieur réel. Ils ont comparé leur méthode à plusieurs stratégies d’exploration établies qui visent principalement à couvrir l’espace ou à raccourcir la distance de déplacement. Dans les simulations, le nouveau système a produit des cartes moins déformées et obtenu une meilleure précision de position tout en explorant en gros en autant de temps ou moins. Il a aussi été moins susceptible de perdre sa position ou de se retrouver trop près de personnes en mouvement. Dans l’expérience réelle, la méthode a fonctionné en temps réel sur un ordinateur standard de robot, confirmant qu’elle est praticable pour un déploiement en dehors du laboratoire.

Ce que cela signifie pour les robots du quotidien

En termes simples, ce travail apprend au robot à être sélectif sur ce qu’il regarde et où il va quand des personnes sont présentes. En combinant la compréhension de la scène, la prédiction de mouvement et une mesure de gain d’information, le robot peut se diriger vers des vues à la fois informatives et sûres, plutôt que de simplement se rendre au coin inexploré le plus proche. Cela rend sa carte interne plus fiable et ses déplacements plus prévisibles, des éléments clés pour des robots qui doivent partager des espaces fréquentés avec des humains. Certains défis subsistent — comme des foules soudaines et denses bloquant la caméra — mais l’approche constitue un pas vers des robots domestiques et de service capables de gérer avec grâce la nature désordonnée et dynamique de la vie réelle.

Citation: Yang, Z., Sang, A.W.Y., Muthugala, M.A.V.J. et al. Mutual information-based hierarchical NBV decision for active semantic visual SLAM under dynamic environments. Sci Rep 16, 5847 (2026). https://doi.org/10.1038/s41598-026-36259-x

Mots-clés: SLAM actif, navigation robotique, environnements dynamiques, cartographie sémantique, prochaine meilleure vue