Clear Sky Science · fr

Synthèse d’images de type métalentille pour l’imagerie par métalentille via la traduction image-à-image

Des photos plus nettes avec des appareils plus fins

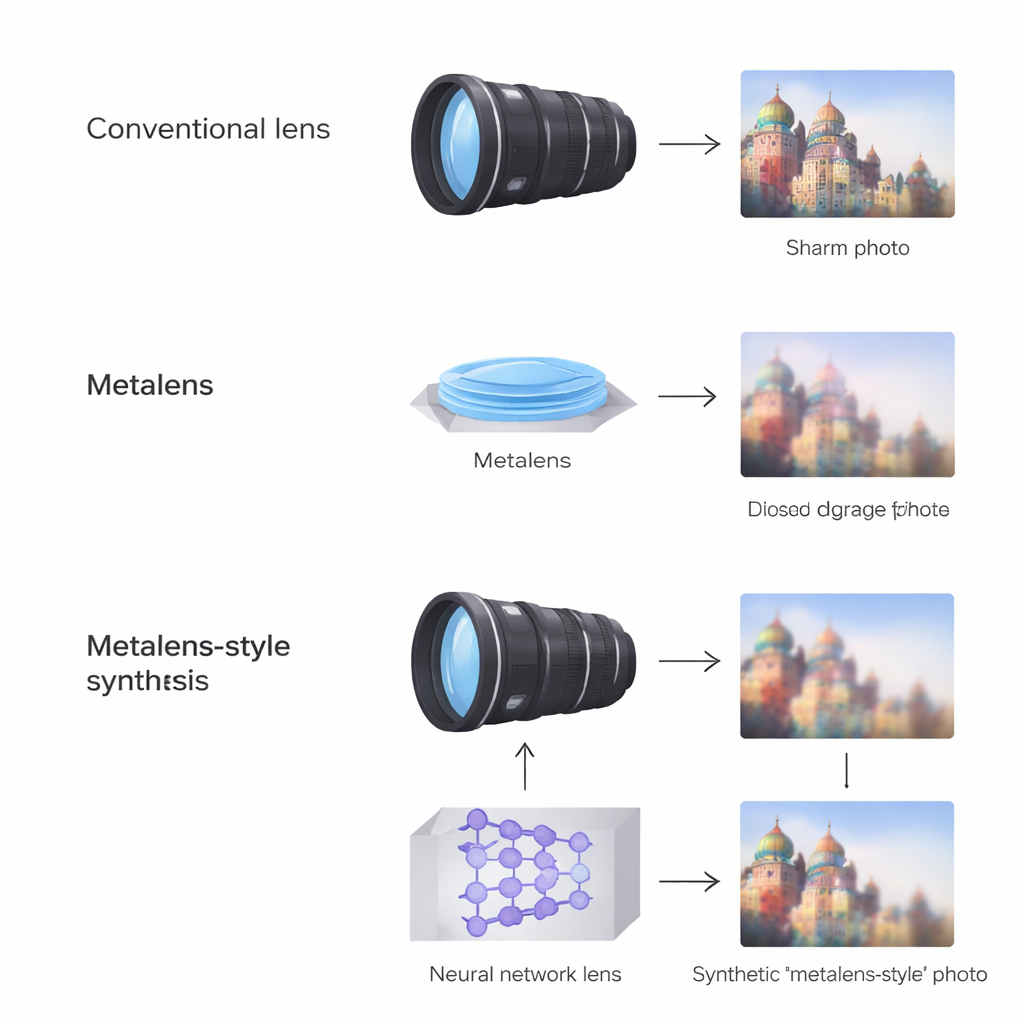

Les téléphones et objets connectés d’aujourd’hui regorgent d’appareils photo, et pourtant les lentilles en verre qui permettent d’obtenir des images nettes occupent encore un espace précieux. Une nouvelle catégorie de « métalentilles » ultra-fines promet des optiques d’une finesse extrême capables d’aplatir les modules photo jusqu’à l’épaisseur d’une carte de crédit. Mais ces lentilles plates introduisent des franges colorées et du flou étranges qui gâchent les photos du quotidien. Cet article montre comment l’intelligence artificielle peut apprendre à imiter ces défauts sur des images ordinaires, puis utiliser ces résultats pour apprendre aux appareils à corriger les images issues de métalentilles — sans passer des heures à prendre des clichés d’étalonnage.

Pourquoi les lentilles plates sont si difficiles à dompter

Les appareils traditionnels s’appuient sur des empilements d’éléments en verre courbés pour courber la lumière en douceur et corriger le flou et la distortion indésirables. Les métalentilles, en revanche, sont des surfaces plates couvertes de structures microscopiques plus petites que la longueur d’onde de la lumière qui dirigent la lumière de manière plus exotique. Cela les rend incroyablement minces et faciles à fabriquer sur des plaquettes, mais aussi très capricieuses : la netteté et la couleur peuvent varier rapidement à travers le cadre, et de petits changements de teinte, d’angle de vue ou de tolérances de fabrication peuvent provoquer des traînées, des halos et des détails brouillés. Pour les fabricants, le principal obstacle n’est pas de construire des métalentilles, mais de collecter les milliers d’exemples photographiques nécessaires pour entraîner un logiciel à annuler ces défauts pour chaque nouveau design.

Apprendre à un réseau à imiter une lentille imparfaite

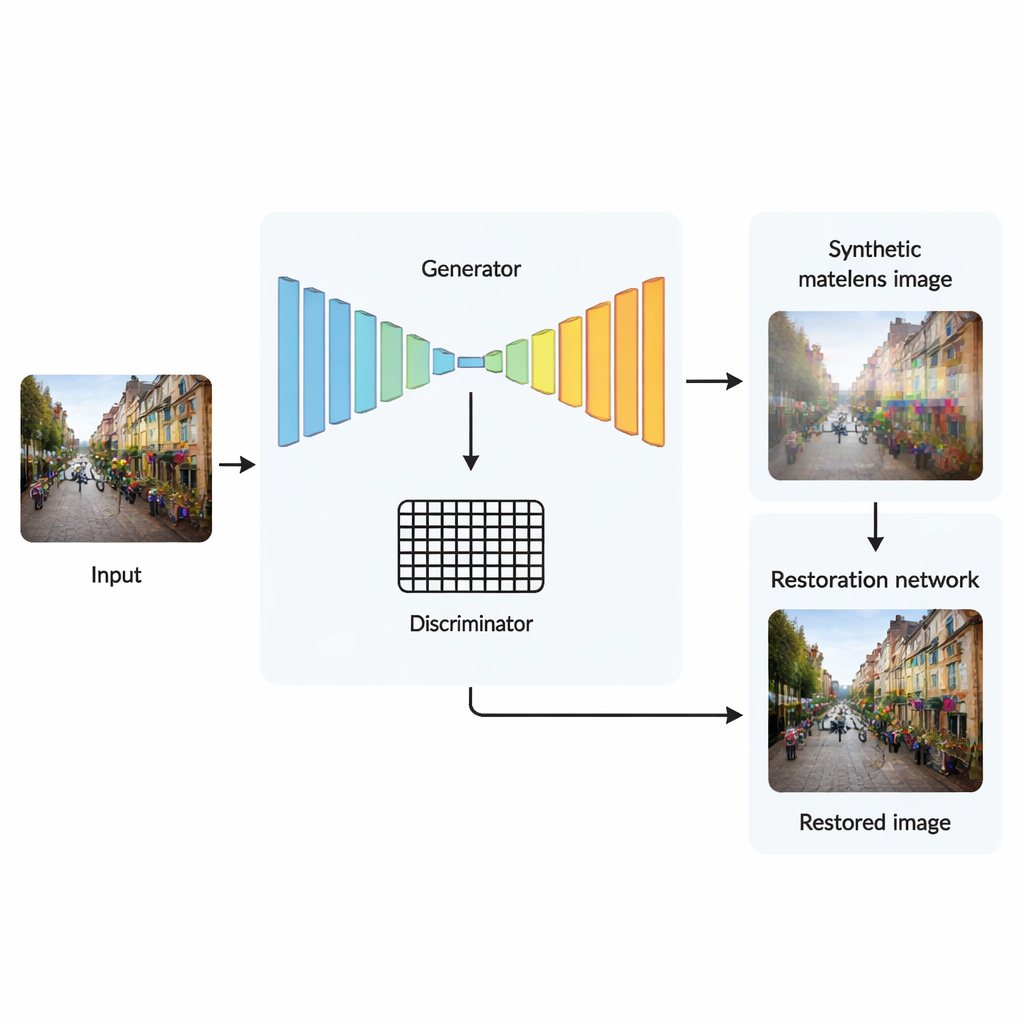

Plutôt que de partir de mauvaises photos de métalentille et d’essayer de les nettoyer, les auteurs inversent le problème. Ils commencent par des photos nettes prises avec une lentille conventionnelle et entraînent un réseau neuronal à faire en sorte que ces images paraissent avoir été capturées à travers une métalentille spécifique, avec ses franges colorées caractéristiques, son flou dépendant de la position et sa déformation près des bords. Ce réseau repose sur un traducteur image-à-image de type U-Net capable de reproduire les détails fins de l’entrée vers la sortie tout en ajoutant des distorsions réalistes. Un réseau discriminateur compagnon juge si la sortie ressemble à une vraie photo de métalentille ou à une contrefaçon, incitant le générateur à produire des imperfections crédibles. Avec seulement environ 600 paires réelles photo métalentille–photo conventionnelle pour l’étalonnage, le système entraîné peut ensuite transformer des centaines de photos ordinaires en images de type métalentille convaincantes en quelques secondes.

Vérifier le réalisme des images synthétiques

Pour savoir si ces images synthétiques se comportent vraiment comme des photos prises avec des métalentilles, l’équipe compare sa méthode à plusieurs modèles avancés de restauration d’image et de super-résolution, mais exécutés à l’envers : au lieu de nettoyer des images, les modèles concurrents doivent dégrader des photos nettes en images de type métalentille. En utilisant des mesures de qualité standard qui capturent à la fois la netteté et la similarité perçue par l’humain, leur traducteur reproduit le mieux les artefacts réels des métalentilles tout en évitant des textures artificielles. Visuellement, ses sorties montrent des franges colorées vives et des motifs de flou réalistes qui correspondent aux prises réelles mieux que celles produites par d’autres modèles, lesquels ont tendance à trop lisser ou déformer les détails fins.

Utiliser des données artificielles pour réparer des photos réelles

Le véritable bénéfice apparaît lorsque ces images synthétiques de type métalentille servent à entraîner un second réseau neuronal dont la tâche est de restaurer des photos de métalentille pour les ramener à une qualité impeccable. Ce restaurateur ne voit que des paires d’images nettes et leurs versions dégradées générées par l’IA, jamais de données réelles de métalentille. Pourtant, lorsqu’on le teste sur des photos réelles de métalentille qu’il n’a jamais vues, il récupère la structure générale et les couleurs plus fidèlement que des approches concurrentes entraînées sur les mêmes données purement synthétiques. Certaines zones en bordure restent plus douces que l’idéal, ce qui révèle que l’entraînement actuel ne capture pas complètement le flou le plus prononcé près des bords. Néanmoins, les résultats montrent que des données artificielles soigneusement construites peuvent remplacer de larges jeux de données réels et coûteux pour apprendre aux appareils à corriger les particularités des métalentilles.

Ce que cela change pour les appareils photo du futur

Pour un non-spécialiste, le message clé est que les concepteurs d’appareils photo n’auront peut-être plus à choisir entre des lentilles encombrantes et une mauvaise qualité d’image. En apprenant d’abord à imiter les défauts complexes des lentilles plates puis en utilisant ces imitations pour l’entraînement, l’approche proposée réduit le temps de collecte de données d’environ soixante fois tout en permettant un logiciel capable de nettoyer efficacement les photos de métalentille. En termes pratiques, ce type de synthèse d’images consciente de la physique pourrait aider à réduire des modules photo multi-éléments à une seule lentille plate accompagnée d’un algorithme de correction intelligent, ouvrant la voie à des téléphones plus fins, des objets portables plus légers et des instruments scientifiques compacts qui livrent malgré tout des images nettes et d’apparence conventionnelle.

Citation: Kang, C., Suk, H., Seo, J. et al. Metalens-style image synthesis for metalens imaging via image-to-image translation. Sci Rep 16, 5819 (2026). https://doi.org/10.1038/s41598-026-36150-9

Mots-clés: imagerie par métalentille, photographie computationnelle, apprentissage profond, restauration d’image, augmentation de données