Clear Sky Science · fr

Sécurité et efficacité des modèles préservant la confidentialité pour créer des résumés vulgarisés de comptes rendus d’IRM cérébrale

Pourquoi votre compte rendu d’examen peut sembler si déroutant

De plus en plus de patients peuvent consulter leurs résultats en ligne, y compris des comptes rendus de radiologie détaillés issus d’examens cérébraux. Mais ces documents sont rédigés pour des médecins, pas pour des patients, et regorgent de termes peu familiers qui peuvent alimenter l’inquiétude plutôt que d’apporter du réconfort. Cette étude se demande si des programmes d’intelligence artificielle (IA) modernes peuvent transformer en toute sécurité de vrais comptes rendus d’IRM cérébrale réalisés en urgence — rédigés en français pour des personnes souffrant de maux de tête — en résumés en langage clair que les patients peuvent réellement comprendre, sans envoyer de données médicales sensibles vers des serveurs commerciaux distants.

Transformer le langage médical en mots du quotidien

Les chercheurs se sont concentrés sur les « résumés vulgarisés » : des explications courtes qui conservent les faits médicaux tout en les traduisant dans un langage courant et en reliant directement les constatations aux symptômes du patient. Ils ont utilisé trois grands modèles de langage (LLM) — Llama 3.3, Athene V2 et Mistral Small — exécutés entièrement sur des ordinateurs d’un hôpital universitaire français, de sorte qu’aucun compte rendu n’a quitté le réseau sécurisé de l’hôpital. Chaque système d’IA a reçu la même consigne : rédiger un résumé en français de 4 à 6 phrases pour un patient, couvrant tous les points clés, expliquant les termes difficiles et reliant les conclusions de l’examen aux maux de tête du patient.

Comment les médecins ont évalué la précision et la sécurité

Parmi près de 600 comptes rendus d’IRM cérébrale rédigés en 2022 pour des patients admis en urgence pour céphalées, l’équipe a sélectionné au hasard 105 rapports. Trois neuroradiologues expérimentés ont lu chaque compte rendu original aux côtés des trois résumés anonymes générés par l’IA (un par modèle). Ils les ont notés sur la justesse médicale, l’exhaustivité, l’utilité pour expliquer aux patients et sur la question de savoir si le texte était suffisamment bon pour être présenté directement sur le portail en ligne d’un patient. En moyenne, les notes étaient élevées : les médecins ont jugé les résumés globalement précis et complets, et souvent adaptés à un usage clinique. Néanmoins, environ un résumé sur cinq contenait au moins un problème, comme une mauvaise explication d’une abréviation, une description anatomique légèrement inexacte, une tournure maladroite ou un détail inventé qui n’apparaissait pas dans le rapport original.

Ce que des non‑médecins ont effectivement compris

Pour vérifier si ces résumés aidaient réellement des lecteurs non spécialistes, les chercheurs ont recruté 11 non‑médecins travaillant en informatique de santé, qui manipulent régulièrement des données de santé mais ne sont pas formés comme médecins. Ce groupe a évalué 30 comptes rendus d’IRM, certains dans leur forme originale et d’autres accompagnés d’un résumé produit par l’IA. Ils ont noté leur compréhension perçue de chaque rapport, leur confiance à pouvoir expliquer les résultats à des proches et le niveau d’anxiété qu’ils ressentiraient si le rapport était le leur. Ils ont également répondu à des questions simples oui/non : y a‑t‑il une anomalie dans ce compte rendu, et existe‑t‑il un élément qui pourrait raisonnablement expliquer les maux de tête du patient ?

Des comptes rendus plus clairs, des gains de compréhension modestes mais réels

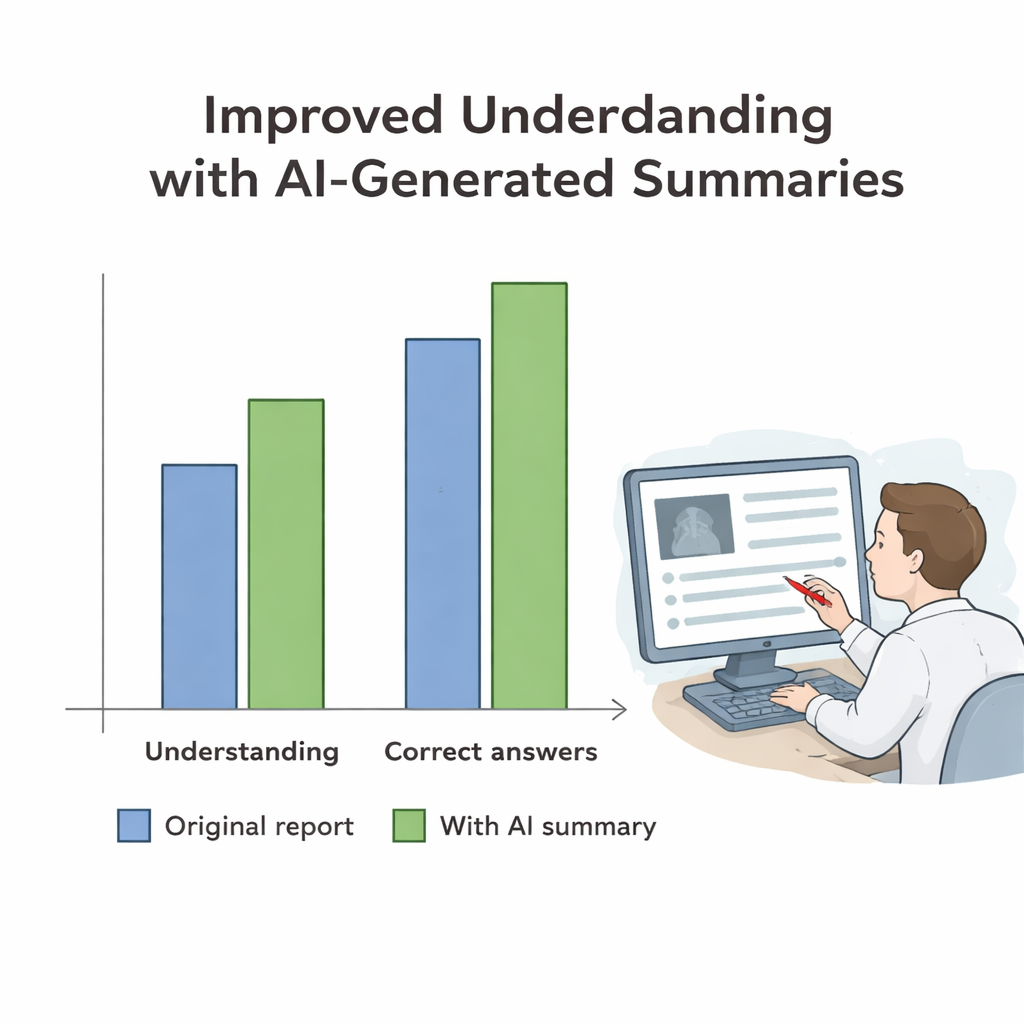

L’ajout de résumés générés par l’IA a considérablement augmenté la perception de compréhension des participants, faisant passer la note moyenne d’une compréhension « modérée » à un niveau « élevé ». Leur confiance à discuter des résultats avec d’autres a aussi augmenté, tandis que l’anxiété déclarée a légèrement diminué. En ce qui concerne la compréhension objective, l’effet était plus modeste mais néanmoins significatif. Les participants se sont améliorés pour détecter quand un examen était anormal et pour reconnaître des éléments qui pourraient effectivement causer la céphalée, avec des progrès concentrés sur les rapports présentant de véritables anomalies. Pour les examens normaux, les personnes reconnaissaient déjà presque parfaitement qu’aucune anomalie sérieuse n’avait été trouvée, si bien que les résumés n’apportaient que peu d’avantage supplémentaire.

Pourquoi la supervision humaine reste nécessaire

Bien que ces outils d’IA qui préservent la confidentialité aient nettement amélioré la clarté perçue et apporté de petits mais importants gains en compréhension factuelle, ils n’étaient pas parfaits. Environ 20 % des résumés contenaient des erreurs médicales ou linguistiques, souvent liées à des abréviations médicales délicates ou à l’intrusion de mots anglais ou chinois dans des phrases françaises. Parce que même de petites erreurs peuvent induire en erreur des patients, les auteurs préconisent d’utiliser l’IA dans une configuration « human‑in‑the‑loop » : le modèle rédige un résumé accessible au patient et un radiologue le vérifie et le corrige rapidement avant qu’il n’atteigne le patient. Utilisée de cette manière, l’étude suggère que l’IA sur site pourrait aider les hôpitaux à fournir des explications d’IRM cérébrale plus claires et rassurantes tout en maintenant les données de santé sensibles à l’intérieur de leurs murs.

Citation: Le Guellec, B., Bentegeac, R., Shorten, L. et al. Safety and efficacy of privacy-preserving models to create Lay summaries of brain MRI reports. Sci Rep 16, 6316 (2026). https://doi.org/10.1038/s41598-026-36081-5

Mots-clés: comptes rendus de radiologie, communication avec le patient, IRM cérébrale, grands modèles de langage, confidentialité médicale