Clear Sky Science · fr

M6 : bases de données de détection de musique générée par machine multi-générateurs, multi-domaines, multilingues et multiculturelles, multi-genres, multi-instruments

Pourquoi l’essor de la musique créée par l’IA est important

Les plateformes de streaming musical se remplissent discrètement de morceaux écrits non pas par des humains, mais par des algorithmes. Ces pistes générées par des machines peuvent être des outils utiles pour la thérapie, les bandes originales de films ou les playlists quotidiennes, mais elles estompent aussi la frontière entre créativité humaine et production automatisée. Cet article présente M6, une grande collection musicale conçue pour aider les chercheurs à distinguer la musique faite par des humains de celle fabriquée par l’IA, et pour comprendre ce qui les différencie. Son objectif est de permettre une reconnaissance équitable des artistes tout en laissant à l’IA un rôle constructif dans la création musicale.

Construire un vaste terrain d’essai musical

Les auteurs soutiennent que les progrès dans la détection de la musique générée par l’IA ont été freinés par un manque de données appropriées. Les collections existantes se concentrent soit sur d’autres tâches, comme l’appairage musique‑texte, soit ne couvrent qu’un éventail restreint de styles musicaux. M6 est conçu pour combler cette lacune. Il combine des milliers de pistes créées par des humains avec des milliers produites par plusieurs systèmes d’IA différents, empaquetées dans un format audio standard. L’ensemble de données est volontairement large : il couvre de nombreux instruments, langues, cultures, genres, durées de chansons, et comprend à la fois des chansons vocales et des pièces instrumentales de fond. Cette riche diversité permet aux scientifiques de tester si les méthodes de détection fonctionnent dans des contextes musicaux réalistes et en constante évolution.

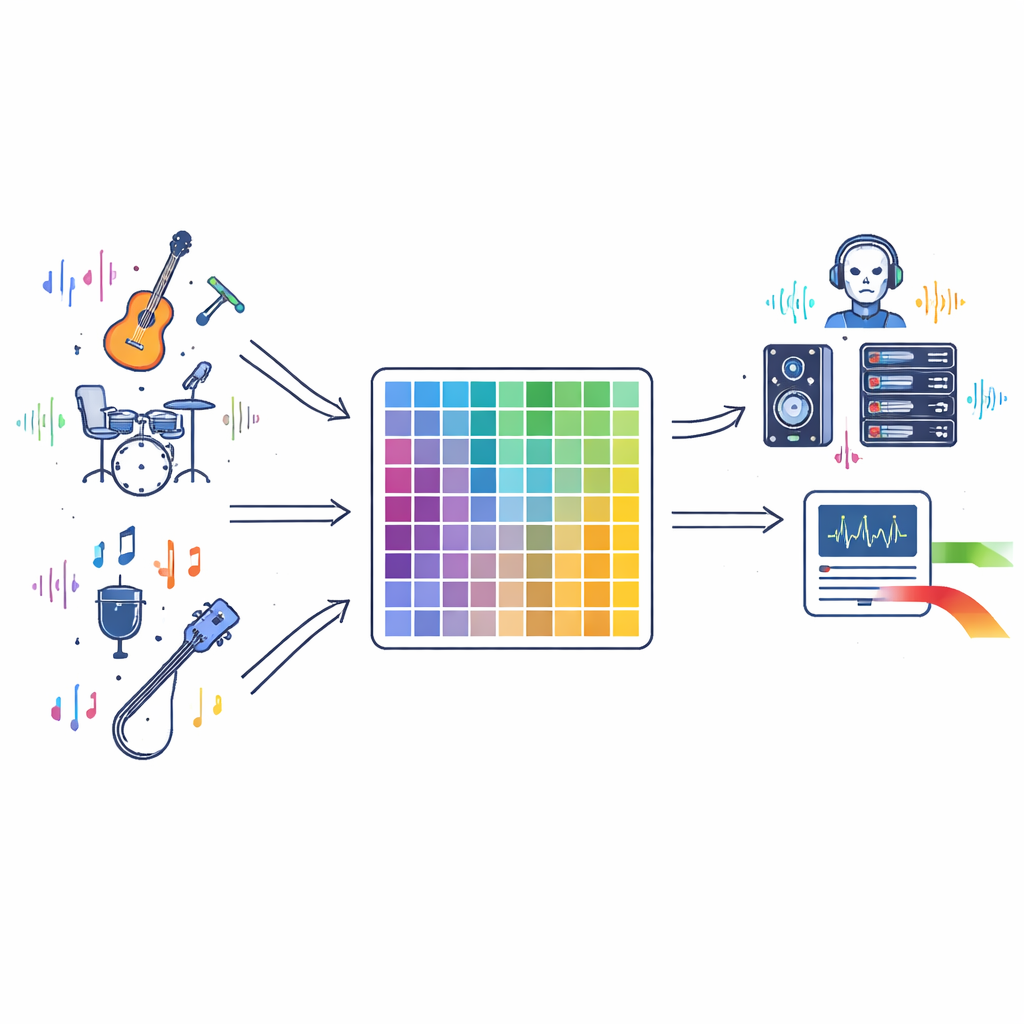

Rassembler des chansons d’humains et de machines

Pour constituer la partie humaine de M6, l’équipe s’est appuyée sur des collections ouvertes bien connues telles que GTZAN (pour les genres musicaux), le Free Music Archive, COSIAN (musique vocale japonaise) et un jeu de données de sons d’instruments individuels. Ils ont aussi échantillonné des chansons supplémentaires sur des plateformes de streaming lorsque les licences le permettaient, en choisissant des extraits qui mettent clairement en valeur l’idée musicale principale plutôt que de simples interludes. Du côté machine, ils ont généré de la musique nouvelle en utilisant plusieurs systèmes à la pointe, incluant des modèles de recherche open source et des outils commerciaux. Des instructions soigneusement conçues, certaines produites par un modèle de langage, ont demandé à ces systèmes de créer de la musique dans des styles, des tempos ou avec des instruments spécifiques, afin que les pistes d’IA reflètent la diversité de la musique humaine.

Contrôler la qualité et repérer des différences subtiles

Parce que les jugements de qualité musicale sont subjectifs, les auteurs ont combiné les avis d’auditeurs avec des mesures objectives. Ils ont calculé de simples descripteurs numériques pour chaque piste, capturant des aspects tels que la complexité rythmique, l’étendue mélodique, la brillance du spectre sonore et l’énergie du signal. En moyenne, les pièces générées par l’IA différaient des pièces humaines selon ces mesures — par exemple, elles présentaient souvent des tessitures légèrement plus étroites ou une énergie globale plus faible — mais ces différences étaient suffisamment petites pour que la plupart des auditeurs ne les remarquent pas sans comparaison attentive. Lors d’écoutes tests avec 50 volontaires, les participants ont correctement identifié si un extrait était humain ou généré par l’IA seulement dans environ la moitié des cas, soit grosso modo au hasard. Cela suggère que la musique d’IA a déjà atteint un niveau de finition capable de tromper facilement un auditeur occasionnel.

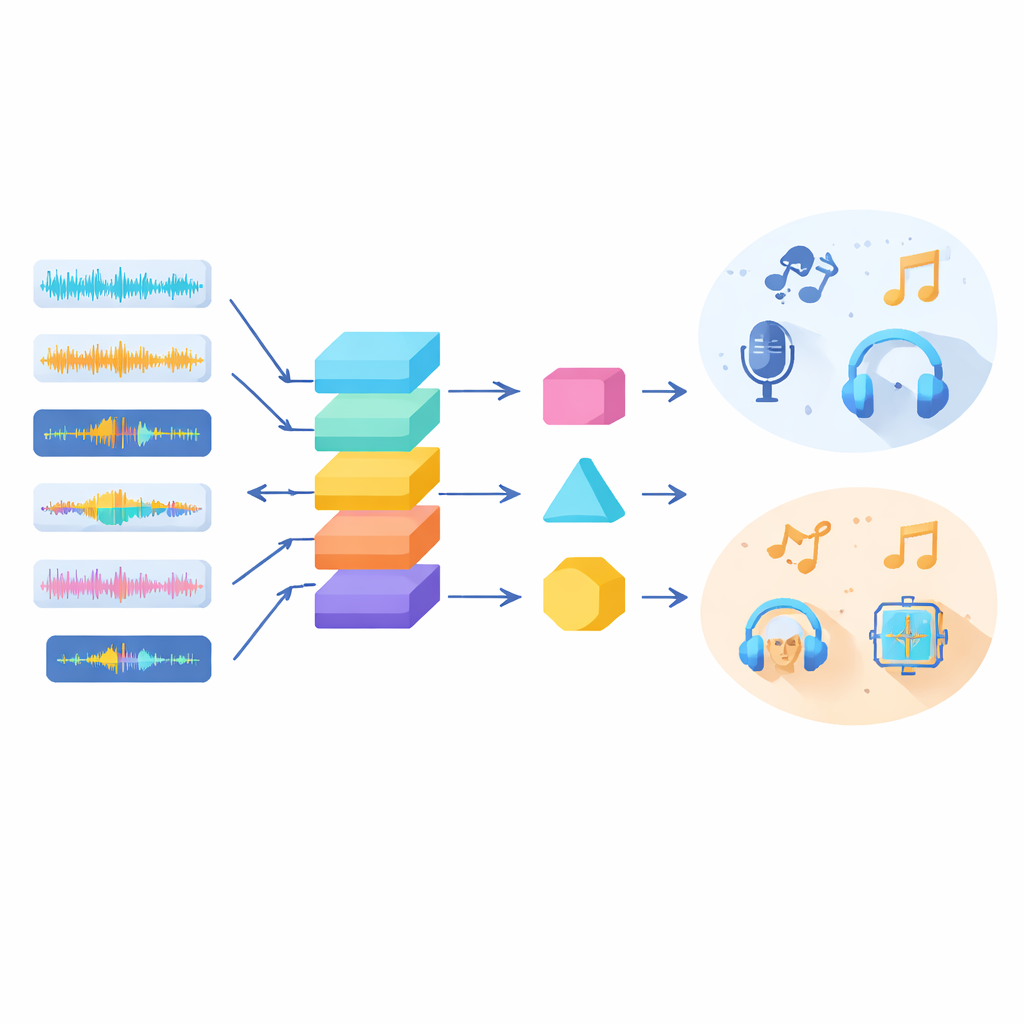

Mettre les méthodes de détection à l’épreuve

Avec M6, les chercheurs ont évalué une variété de modèles informatiques pour mesurer leur capacité à détecter la musique générée par l’IA. Ils ont testé des approches classiques d’apprentissage automatique, des réseaux de neurones de type image traitant des spectrogrammes, des modèles transformer et des systèmes audio modernes initialement conçus pour détecter les discours falsifiés. Lorsque les modèles étaient entraînés et testés sur des types de musique similaires, plusieurs atteignaient une grande précision, en particulier les réseaux convolutionnels qui analysent les motifs dans la représentation temps‑fréquence du son. Cependant, les performances chutaient fortement lorsque les modèles faisaient face à de la musique « hors domaine » — des styles, des langues ou des générateurs qu’ils n’avaient pas rencontrés auparavant. L’étude a aussi révélé que différents systèmes de génération musicale laissent des « empreintes » acoustiques distinctes, rendant certains générateurs plus faciles à repérer que d’autres et soulevant la crainte que les détecteurs ne se sur-ajustent à des outils particuliers plutôt qu’aux traits profonds de la musique produite par machine.

Ce que cela signifie pour la musique et l’IA

Le projet M6 montre que si les ordinateurs peuvent souvent repérer la musique générée par l’IA avec précision dans des contextes familiers, la détection robuste en conditions réelles reste un défi majeur. Les auditeurs humains ont déjà du mal à faire la différence, et les algorithmes actuels flanchent quand la musique change de genre, de langue, de durée ou de méthode de génération. En publiant un jeu de données vaste, divers et ouvert, les auteurs espèrent stimuler le développement d’outils de détection plus fiables et transparents. De tels outils pourraient, à leur tour, aider à maintenir la confiance dans les plateformes musicales numériques, soutenir la reconnaissance équitable des artistes humains et orienter les futurs systèmes d’IA vers la collaboration avec les musiciens plutôt que leur remplacement silencieux.

Citation: Li, Y., Li, H., Specia, L. et al. M6: multi-generator, multi-domain, multi-lingual and cultural, multi-genres, multi-instrument machine-generated music detection databases. Sci Rep 16, 9237 (2026). https://doi.org/10.1038/s41598-026-36044-w

Mots-clés: musique générée par IA, audio deepfake, détection de musique, apprentissage automatique, créativité numérique