Clear Sky Science · fr

Anxiété liée à l’IA et intention d’adoption dans l’enseignement supérieur basée sur un TAM-UTAUT étendu et une analyse PLS-SEM

Pourquoi les inquiétudes autour de l’IA comptent sur les campus

Les universités du monde entier s’efforcent d’intégrer l’intelligence artificielle générative (IA) dans l’enseignement et la recherche. Des outils qui rédigent des essais aux systèmes qui aident à concevoir des plans de cours, ces technologies promettent de gagner du temps et de stimuler la créativité. Pourtant, de nombreux étudiants et enseignants ressentent une gêne à l’idée de les utiliser. Cette étude examine cette gêne — « l’anxiété liée à l’IA » — pour comprendre comment différentes formes d’inquiétude peuvent soit bloquer, soit au contraire encourager l’adoption d’outils d’IA dans l’enseignement supérieur.

Trois types d’inquiétude à propos de l’IA

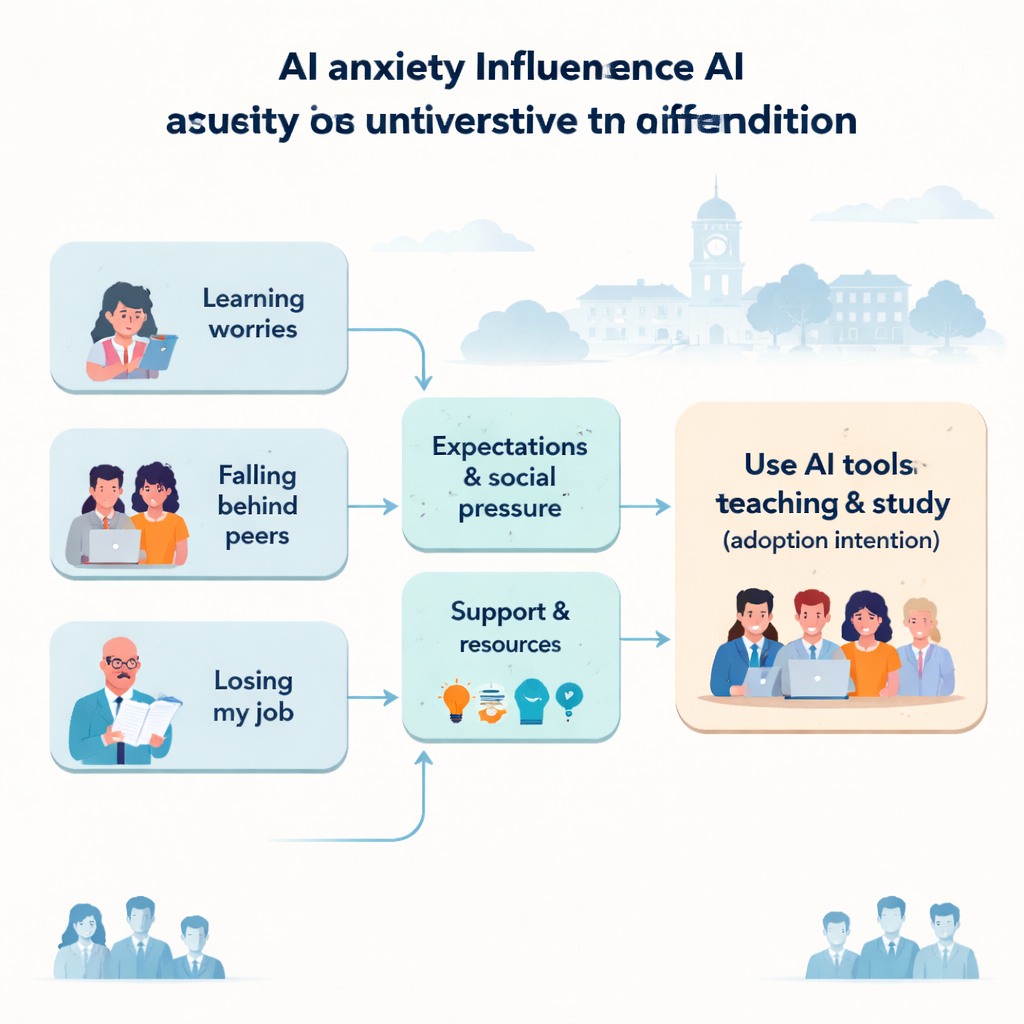

Les chercheur·e·s s’intéressent à trois formes distinctes d’anxiété liée à l’IA. La première est l’anxiété d’apprentissage : la peur de ne pas être capable de maîtriser des outils d’IA complexes ou de ne pas être « assez bon en technologie ». La deuxième est ce qu’ils appellent l’anxiété de cécité sociotechnique : la crainte de devenir la personne du département qui est laissée pour compte, hors des nouvelles pratiques et conversations numériques. La troisième est l’anxiété de perte d’emploi : la peur plus profonde que l’IA puisse remplacer des éléments clés de son rôle — rédaction, correction ou même conception de cours — et rendre certains postes académiques redondants. Plutôt que de traiter l’anxiété comme un sentiment unique et simple, les auteur·e·s soutiennent que chacune de ces formes a ses propres origines et conséquences.

Des sentiments aux décisions

Pour voir comment ces anxiétés influencent les choix réels, l’équipe a combiné deux théories bien établies de l’utilisation des technologies qui mettent habituellement l’accent sur des croyances rationnelles : l’utilité perçue d’un outil, la facilité d’utilisation ressentie, la pression sociale pour l’essayer et la disponibilité du soutien. Ils ont enquêté auprès de 407 étudiant·e·s et enseignant·e·s de trois universités de la province du Sichuan, en Chine, en leur demandant leurs inquiétudes liées à l’IA, leurs attentes vis‑à‑vis de l’IA générative et leur intention d’utiliser de tels outils dans leurs études ou leur enseignement. Grâce à une technique statistique appelée modélisation par équations structurelles, ils ont cartographié comment les réactions émotionnelles alimentent les attentes relatives à la performance, à l’effort, à l’influence sociale et au soutien — et, en fin de compte, la décision d’adopter l’IA.

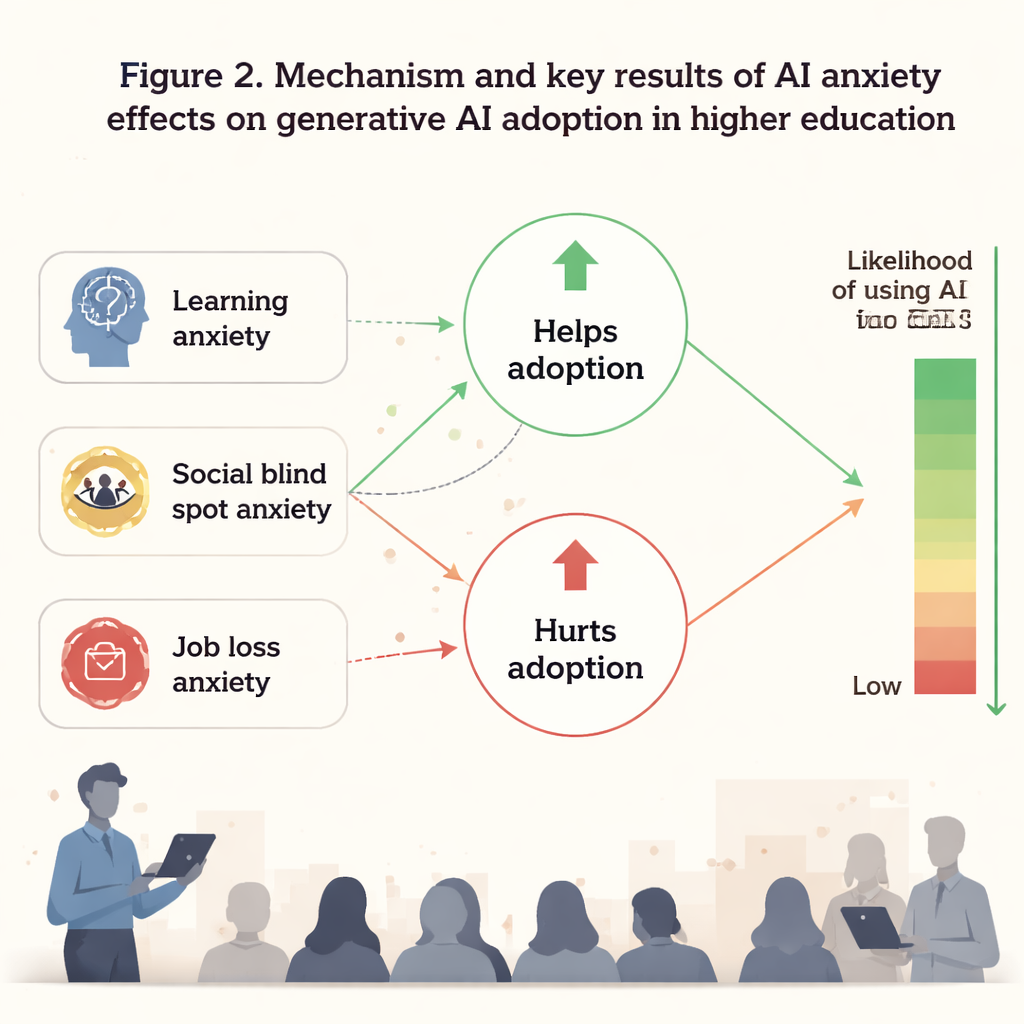

Quand la peur freine

L’anxiété de perte d’emploi s’est révélée la force la plus systématiquement nuisible. Les personnes craignant que l’IA n’érode leur valeur professionnelle avaient tendance à considérer l’IA comme moins utile, plus difficile à maîtriser, moins soutenue socialement et moins appuyée par des ressources institutionnelles. Cet ensemble de croyances négatives réduisait fortement leur intention d’utiliser des outils d’IA. L’anxiété d’apprentissage érodait également la confiance, rendant l’IA plus difficile et moins accessible, bien que ses effets furent plus faibles et dépendants d’autres facteurs. Dans ces cas, la peur conduit à une attitude défensive : au lieu de voir l’IA comme un assistant, les personnes anxieuses la perçoivent comme une menace et se retirent des opportunités d’expérimentation.

Quand la peur pousse à agir

L’anxiété de cécité sociotechnique a livré une histoire plus surprenante. Les personnes craignant de devenir le membre « illettré en IA » de leur communauté académique ont parfois réagi en s’engageant plutôt qu’en se retirant. Ce type de peur sociale était lié à des attentes plus fortes quant au fait qu’elles pouvaient et devaient fournir l’effort nécessaire pour apprendre l’IA, à une plus grande sensibilité à la façon dont les pairs percevaient l’usage de l’IA et, dans de nombreux cas, à une intention plus élevée d’adopter des outils génératifs. Dans le même temps, cela réduisait légèrement leur croyance que l’IA améliorerait réellement la performance. Autrement dit, la même anxiété sociale qui peut heurter le sentiment de compétence d’une personne peut aussi la pousser à se mettre à niveau, créant une « arme à double tranchant » qui à la fois affaiblit la confiance et stimule l’apprentissage.

Qui gère mieux l’anxiété liée à l’IA

L’étude montre aussi que le contexte compte. Les étudiant·e·s et enseignant·e·s des domaines scientifiques et de l’ingénierie étaient plus susceptibles de convertir l’anxiété d’apprentissage en volonté d’expérimenter l’IA, reflétant une culture déjà à l’aise avec le changement technologique rapide. En revanche, les personnes des sciences humaines et sociales, qui réfléchissent souvent de façon plus critique à l’éthique et au sens, étaient plus enclines à voir l’IA comme une menace pour des valeurs académiques centrales. Le sentiment d’auto‑efficacité face à l’IA d’une personne — la confiance qu’elle a de finalement maîtriser ces outils — jouait également un rôle majeur. Celles et ceux ayant une forte auto‑efficacité pouvaient réinterpréter une partie de l’anxiété comme un signal d’amélioration plutôt que comme une raison d’abandonner, et étaient meilleurs pour convertir le malaise en action constructive.

Ce que cela signifie pour les universités

Pour l’enseignement supérieur, le message est clair : l’anxiété liée à l’IA n’est pas simplement un frein à l’innovation, ni quelque chose à balayer d’un revers de main. Certaines inquiétudes, en particulier celles concernant la perte d’emploi, peuvent sérieusement saper la volonté d’adopter l’IA générative et méritent des réponses directes telles que des définitions claires des rôles, un soutien au développement de carrière et des politiques transparentes. D’autres inquiétudes, notamment la peur de prendre du retard par rapport aux pairs, peuvent être canalisées en motivation si les universités proposent des formations accessibles, des communautés d’apprentissage entre pairs et des outils qui paraissent gérables plutôt qu’écrasants. En reconnaissant et en travaillant avec ces différentes nuances d’anxiété — plutôt qu’en supposant que toute peur est mauvaise — les institutions peuvent encourager une utilisation de l’IA sur le campus qui soit réfléchie, responsable et plus équitable.

Citation: Kai, C., Ping, W. & Xiaomin, J. AI anxiety and adoption intention in higher education based on an extended TAM-UTAUT and PLS-SEM analysis. Sci Rep 16, 3672 (2026). https://doi.org/10.1038/s41598-026-35823-9

Mots-clés: Anxiété liée à l’IA, IA générative dans l’éducation, adoption des technologies, enseignement universitaire, attitudes des étudiants