Clear Sky Science · fr

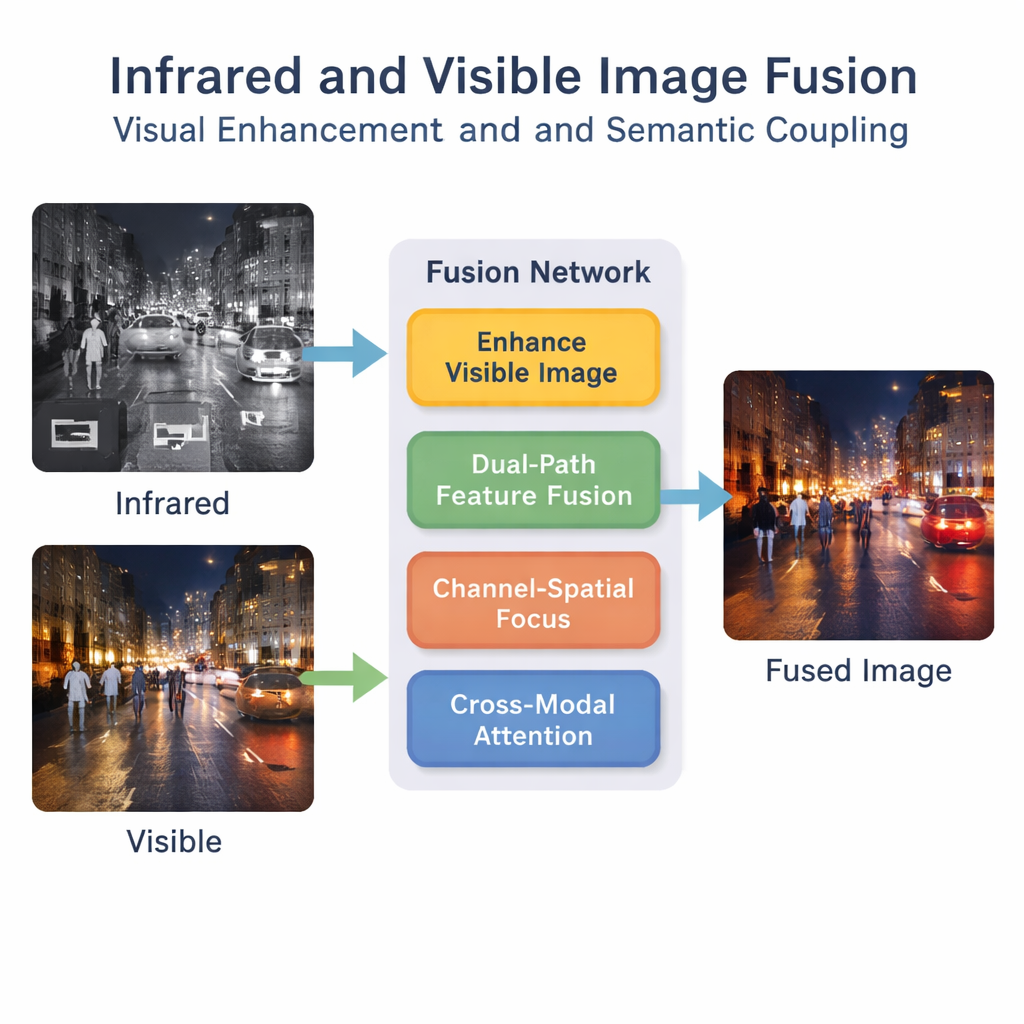

Fusion d'images infrarouges et visibles via amélioration visuelle et couplage sémantique

Une vision plus nette avec des caméras jour et nuit

Les voitures modernes, les drones et les systèmes de sécurité embarquent souvent deux types d'yeux : une caméra classique qui voit les couleurs et les textures, et une caméra infrarouge qui détecte la chaleur. Chacune présente des forces et des limites, et les combiner en une image unique et claire est étonnamment difficile. Cet article propose une nouvelle manière de fusionner ces deux vues en une seule image qui est non seulement plus agréable à regarder, mais aussi plus facile à interpréter par des programmes informatiques.

Pourquoi deux yeux valent mieux qu’un

Les caméras en lumière visible capturent des détails nets comme les marquages routiers, les contours des bâtiments et les vêtements, mais elles peinent la nuit, dans le brouillard ou lorsque les objets se confondent avec l'arrière‑plan. Les caméras infrarouges font l'inverse : elles mettent en évidence les objets chauds tels que les personnes et les véhicules même dans l'obscurité, mais leurs images paraissent floues et manquent de détails fins. Fusionner ces deux vues pour obtenir une image « le meilleur des deux mondes » peut aider pour des tâches allant de la détection de piétons dans l'aide à la conduite à la surveillance et aux opérations de recherche‑sauvetage. Cependant, de nombreuses méthodes de fusion existantes se concentrent uniquement sur les caractéristiques superficielles — points lumineux en infrarouge et textures en visible — en négligeant le sens plus profond à l'échelle de la scène qui importe pour les systèmes intelligents.

Une manière plus intelligente de mélanger les images

Les auteurs proposent un cadre d'apprentissage profond qui considère la fusion comme plus qu'un simple chevauchement. D'abord, une étape d'amélioration spéciale éclaircit et équilibre l'image visible, en particulier dans les scènes faiblement éclairées, afin que des détails précieux ne soient pas perdus avant même le début de la fusion. Ensuite, un réseau à double voie traite en parallèle les entrées infrarouges et visibles. Une voie se concentre sur les motifs locaux tels que les contours et les textures, tandis que l'autre examine le contexte plus large de la scène. En combinant ces voies, le système produit une description interne plus riche de ce qui se passe dans les images.

Apprendre au réseau sur quoi porter attention

Extraire de nombreuses caractéristiques ne suffit pas : le réseau doit apprendre lesquelles sont importantes. Un module « canal‑spatial » aide le modèle à mettre en avant les régions et types d'information critiques, comme les piétons ou les phares lumineux, tout en atténuant le bruit d'arrière‑plan moins utile. Par dessus cela, un mécanisme d'attention interactive bimodale encourage les flux infrarouge et visible à communiquer entre eux. Il apprend comment les signatures thermiques et les textures visuelles s'alignent dans la scène, capturant des concepts de niveau supérieur comme « cette tache lumineuse en infrarouge correspond à cette personne dans l'image visible ». Ce couplage sémantique permet à l'image fusionnée de rester cohérente sur le plan logique plutôt que d'être simplement mélangée visuellement.

Mettre la méthode à l'épreuve

Pour vérifier si les images fusionnées sont non seulement attrayantes mais aussi réalistes, les auteurs ajoutent un réseau discriminateur similaire à ceux utilisés dans les réseaux adverses génératifs. Ce réseau supplémentaire apprend à distinguer les images visibles réelles des images fusionnées, poussant le processus de fusion à produire des sorties qui paraissent naturelles tant pour les humains que pour les machines. La méthode est entraînée et testée sur trois collections difficiles de paires d'images infrarouges‑visibles, couvrant des routes de jour et de nuit ainsi que des scènes de type militaire. Sur une gamme de mesures de qualité standard, la nouvelle approche surpasse généralement dix techniques de fusion existantes, produisant des images aux contours plus nets, à meilleur contraste et au contenu plus informatif.

De meilleures images pour des machines plus sûres

Au‑delà de la qualité visuelle, les auteurs posent une question pratique : ces images fusionnées aident‑elles les ordinateurs à prendre de meilleures décisions ? En utilisant un système de détection d'objets populaire pour repérer les piétons, ils montrent que leurs images fusionnées améliorent la précision de détection par rapport aux images issues d'un seul capteur et aux méthodes de fusion antérieures. En termes concrets, la technique crée des images plus faciles à interpréter pour les humains comme pour les algorithmes, notamment dans des conditions difficiles comme la conduite de nuit. Si le système nécessite encore des ajustements pour une utilisation en temps réel sur des dispositifs aux ressources limitées, il constitue une étape prometteuse vers une vision plus sûre et plus fiable dans les véhicules automatisés, la surveillance et d'autres technologies qui doivent voir clairement quand cela compte le plus.

Citation: Yang, Y., Li, Y., Li, J. et al. Infrared and visible image fusion via visual enhancement and semantic coupling. Sci Rep 16, 5666 (2026). https://doi.org/10.1038/s41598-026-35763-4

Mots-clés: fusion d'images, imagerie infrarouge, vision en basse luminosité, apprentissage profond, détection d'objets