Clear Sky Science · fr

YOLO11-WLBS : un modèle efficace pour la détection des défauts de chaussée

Pourquoi des contrôles routiers améliorés comptent

Chaque fissure et nid‑de‑poule sur la route est plus qu’une simple nuisance visuelle : cela peut réduire la durée de vie du revêtement, endommager les véhicules et contribuer aux accidents. Aujourd’hui, de nombreuses routes sont encore inspectées par des personnes circulant lentement avec des carnets ou des caméras basiques, ce qui prend du temps, coûte cher et est source d’erreurs. Cette étude présente YOLO11‑WLBS, un système de vision par ordinateur plus intelligent et plus léger capable de repérer en temps réel différents types de détérioration des chaussées, même sur un smartphone ou un drone, offrant ainsi une maintenance plus rapide et plus sûre de nos réseaux routiers.

Des patrouilles lentes aux caméras intelligentes

Avec l’augmentation du trafic et l’expansion des réseaux routiers, des défauts comme les fissures transversales et longitudinales, le « alligator cracking », les fissures obliques, les nids‑de‑poule et les réparations ponctuelles deviennent plus fréquents. L’inspection traditionnelle — relevés à pied ou en véhicule, ou traitement d’image basique — repose fortement sur le jugement humain et peine en cas de faible éclairage ou de scènes encombrées. Au cours de la dernière décennie, l’apprentissage profond et, en particulier, la famille de réseaux YOLO pour la détection d’objets ont transformé l’analyse d’images en apprenant les motifs directement à partir des images brutes. Les premiers systèmes de détection de chaussée basés sur YOLO ont amélioré la précision mais se sont heurtés à un compromis fondamental : les modèles suffisamment précis étaient souvent trop volumineux et trop lents pour une utilisation en temps réel sur drones, véhicules ou appareils portables.

Un moteur ajusté construit sur YOLO11

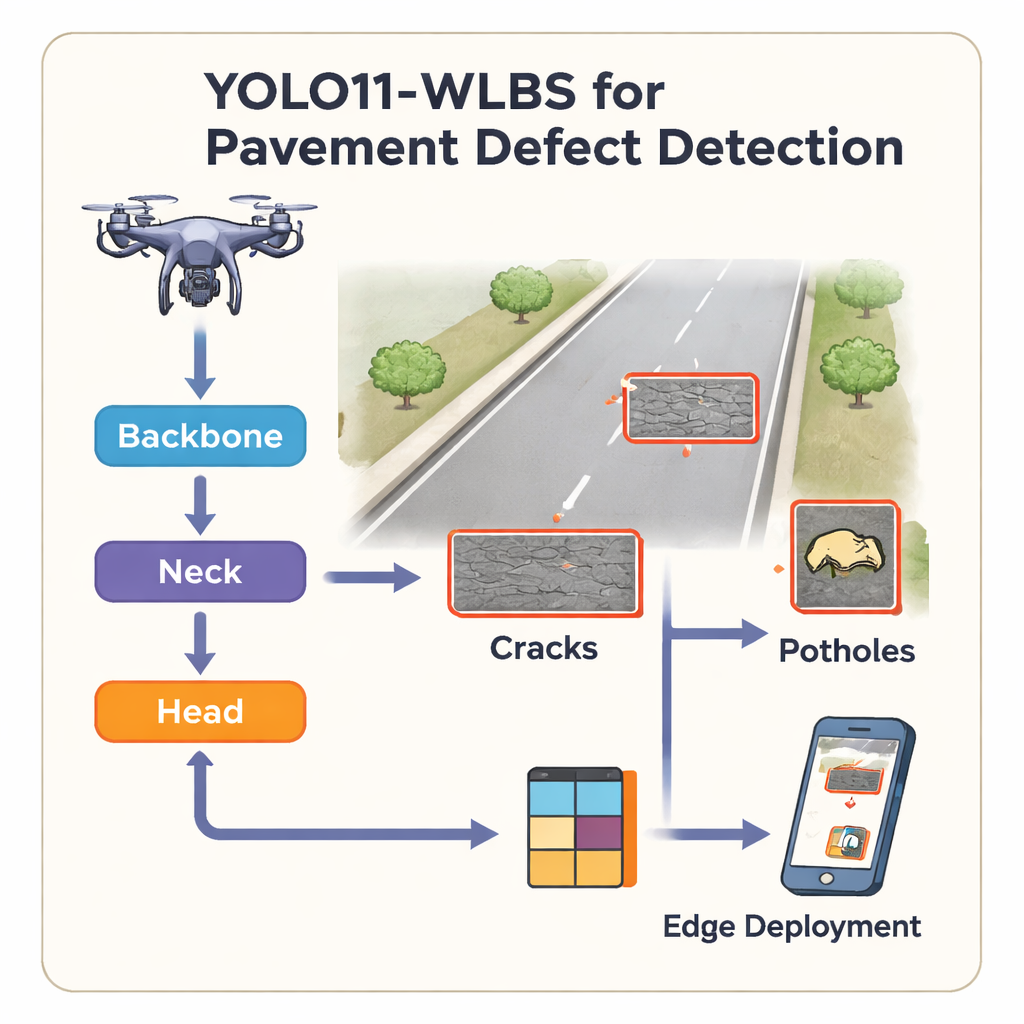

Les auteurs partent de YOLO11, un réseau moderne de détection d’objets qui équilibre déjà vitesse et précision, et l’adaptent aux défis spécifiques des surfaces routières. Leur modèle amélioré, baptisé YOLO11‑WLBS, conserve la conception habituelle en trois volets — « backbone » pour l’extraction des caractéristiques, « neck » pour combiner l’information à différentes échelles, et « head » pour tracer des boîtes et étiqueter les défauts — mais y ajoute quatre améliorations soigneusement choisies. Ensemble, ces ajouts affinent la sensibilité du modèle aux fissures fines, améliorent sa gestion des multiples tailles de défauts et réduisent les calculs superflus pour qu’il fonctionne efficacement sur des dispositifs en périphérie.

Quatre astuces intelligentes pour voir les fissures

La première amélioration utilise la convolution basée sur les ondelettes pour mettre en valeur les détails à haute fréquence — les changements brusques de luminosité qui délimitent les fissures et petits trous — sans alourdir le modèle. Cela aide le système à détecter des défauts faibles, fins ou irréguliers que des filtres standard pourraient manquer. Ensuite, une étape d’« extraction adaptative légère » réorganise les cartes de caractéristiques pour que le réseau concentre ses efforts sur les canaux les plus informatifs tout en réduisant le nombre total de paramètres d’environ un quart. Une pyramide de caractéristiques bidirectionnelle permet ensuite à l’information de circuler du grossier au fin et vice versa, améliorant la reconnaissance tant des fissures microscopiques que des motifs de fissures plus larges et connectés. Enfin, un mécanisme d’attention simple met en relief les régions les plus importantes de chaque carte de caractéristiques, guidant le détecteur vers les défauts réels et l’éloignant des distractions comme les marquages au sol, les ombres ou les taches.

Preuve d’efficacité en conditions réelles

Pour tester YOLO11‑WLBS, l’équipe l’a entraîné et évalué sur des images drone haute résolution de chaussées réelles, couvrant plus de dix mille défauts annotés répartis en six catégories. Par rapport au YOLO11 d’origine, le nouveau modèle augmente la précision de 0,853 à 0,947 et le rappel de 0,698 à 0,895, ce qui signifie qu’il déclenche moins de fausses alertes et manque beaucoup moins de défauts. Son score de détection global (mAP@0.5) augmente de 12,2 %, tandis que le nombre de paramètres diminue d’environ 25,5 %. Le système reste précis en conditions de faible ou forte luminosité et lorsque les images sont floues ou sous‑échantillonnées, et il se transpose bien à un jeu de données drone distinct avec des points de vue et une résolution plus faibles. Les auteurs ont même déployé une version entièrement quantifiée sur un smartphone Android, atteignant près de 30 images par seconde pour la détection en vidéo en direct de plusieurs types de fissures.

Ce que cela signifie pour les conducteurs et les villes

En termes simples, YOLO11‑WLBS est une paire d’yeux plus rapide et plus précise pour nos routes. En combinant une meilleure détection des contours, une utilisation plus intelligente de la capacité du modèle, une fusion multi‑échelle des caractéristiques et une attention légère, il repère davantage de défauts tout en fonctionnant sur du matériel modeste comme les drones et les téléphones. Cela rend pratique le balayage fréquent de longues portions de chaussée, la détection précoce des problèmes et la planification plus efficace des réparations, le tout sans mobiliser d’importantes équipes dans la circulation. Bien que le modèle ait encore des difficultés avec certains défauts rares comme les nids‑de‑poule — principalement parce qu’il existe moins d’exemples pour l’apprentissage — il fournit une base solide pour des systèmes futurs qui non seulement détecteront où la route est endommagée mais estimeront aussi la gravité des dommages, orientant les villes vers une maintenance plus sûre et plus rentable.

Citation: Lin, J., Wang, P., Ruan, Y. et al. YOLO11-WLBS: an efficient model for pavement defect detection. Sci Rep 16, 5284 (2026). https://doi.org/10.1038/s41598-026-35743-8

Mots-clés: détection des défauts de chaussée, détection des fissures routières, YOLO11-WLBS, inspection par drone, edge AI