Clear Sky Science · fr

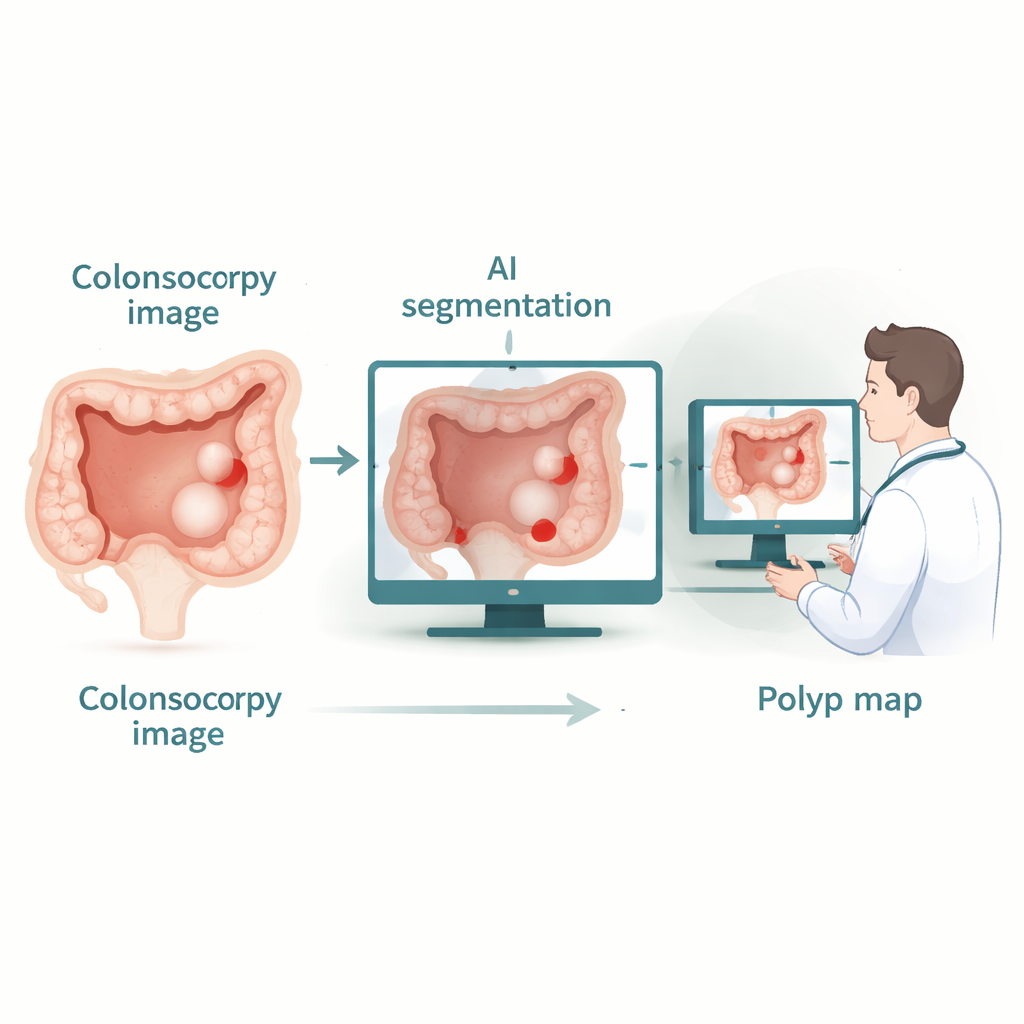

Agrégation hiérarchique d’informations contextuelles pour la segmentation des polypes

Pourquoi de petites excroissances dans le côlon comptent

Le cancer colorectal commence souvent par de petites excroissances apparemment bénignes, appelées polypes, qui se forment sur la paroi du gros intestin. Lors d’une coloscopie, les médecins cherchent à repérer et à retirer ces formations avant qu’elles ne deviennent dangereuses. Mais la fatigue, une visibilité imparfaite et les limites humaines font que jusqu’à un quart des polypes peuvent être manqués. Cet article présente un nouveau système d’intelligence artificielle (IA) conçu pour délimiter automatiquement les polypes dans les images de coloscopie avec une grande précision, dans le but de devenir un assistant fiable qui aide les médecins à voir davantage et à en manquer moins.

Voir la forêt et les arbres

Les outils d’IA modernes pour l’imagerie médicale appartiennent généralement à deux familles. L’une, fondée sur les réseaux de neurones convolutionnels classiques, excelle à reconnaître de fins détails locaux, comme des bords subtils ou des variations de texture, mais peine à saisir les relations entre des régions éloignées de l’image. L’autre, basée sur des modèles de type transformer, est très efficace pour capturer les relations à longue portée — voir la « vue d’ensemble » d’une image entière — mais peut perdre en netteté autour de petites structures comme les contours fins d’un polype, et être coûteuse en calcul. Des systèmes hybrides récents tentent de mêler les deux approches, mais favorisent souvent la composante convolutionnelle et n’exploitent pas pleinement les mécanismes d’attention, ce qui conduit à des bords flous et à un contexte insuffisamment pris en compte.

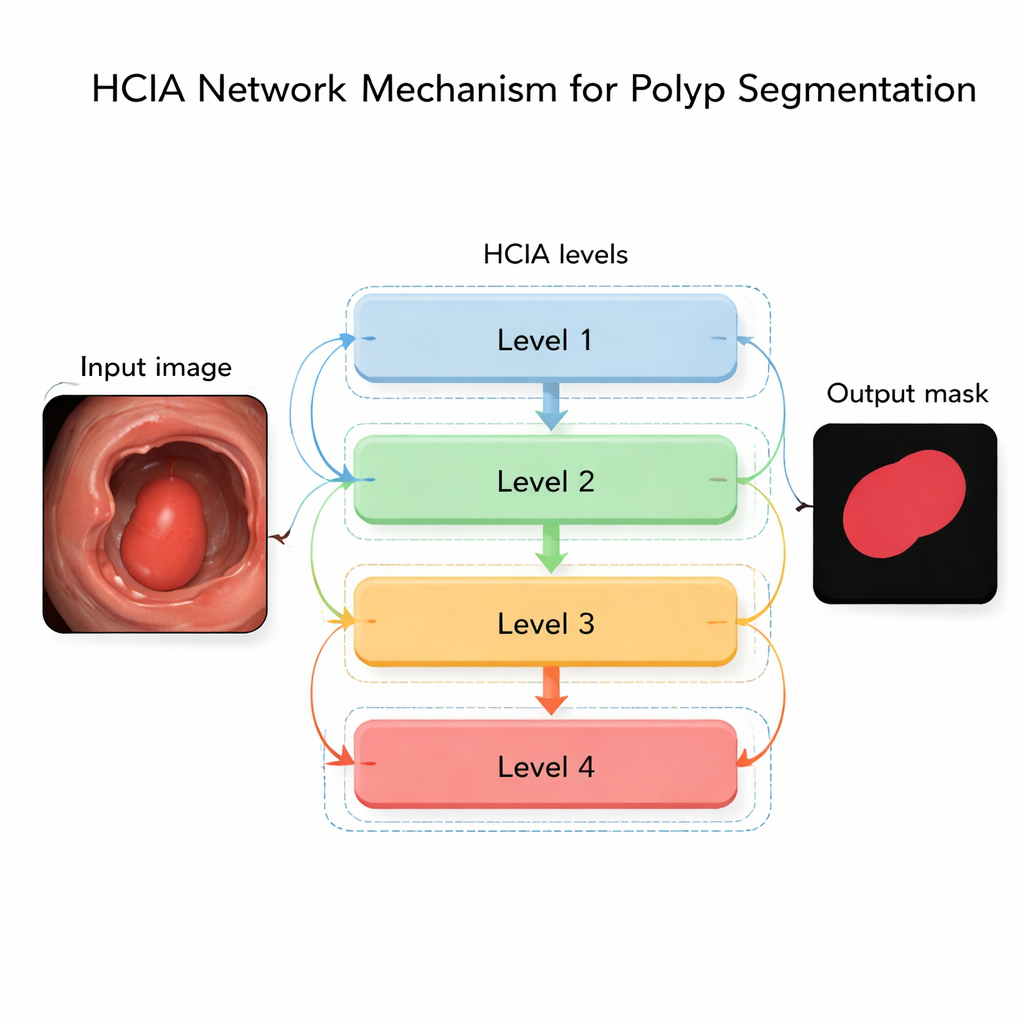

Une nouvelle façon de combiner les indices à différentes échelles

Les auteurs proposent un réseau nommé Hierarchical Contextual Information Aggregation (HCIA) pour surmonter ces limites. HCIA est conçu pour examiner une image de coloscopie à plusieurs niveaux de détail simultanément — des vues grossières et panoramiques aux vues très rapprochées — et pour permettre à ces niveaux d’échanger des informations de manière structurée. Un composant clé, le Hierarchical Aggregation Module (HAM), fusionne les informations provenant des niveaux voisins. En mêlant le contexte grossier avec des détails plus fins, HAM aide le système à distinguer les polypes du tissu environnant, qui varie en couleur, forme et taille, tout en affinant les frontières où le polype rencontre le tissu sain.

Une attention intelligente sans coût de calcul élevé

Le second élément crucial, l’Interconnected Attention Module (IAM), s’attaque au défi du contexte global. Plutôt que de calculer l’attention de la manière habituelle — qui compare chaque pixel à tous les autres et devient rapidement coûteuse en calcul — IAM utilise une « mémoire » partagée qui résume ce que le réseau a appris à travers tous les niveaux. Chaque niveau consulte cette mémoire pour décider quelles parties de ses caractéristiques méritent davantage d’attention. Cette conception permet à IAM d’établir des connexions à longue portée sur toute l’image tout en maîtrisant le coût de calcul. Fait important, la même mémoire est partagée entre les branches du réseau, offrant une forme de supervision globale et cohérente qui aide le modèle à rester focalisé sur les polypes, quelle que soit leur taille ou leur position.

Mettre le système à l’épreuve

Pour vérifier si la conception de HCIA a un impact en pratique, les auteurs l’ont testé sur trois collections d’images de polypes largement utilisées, chacune contenant de quelques centaines à un millier de vues de coloscopie avec des contours de polypes dessinés par des experts. Ils ont comparé HCIA à plus de vingt modèles d’IA de pointe, incluant à la fois des réseaux convolutionnels traditionnels et des hybrides récents basés sur des transformers. Sur presque toutes les mesures — recouvrement des régions polypodes prédites avec les annotations d’experts, précision de la forme capturée et alignement des structures — HCIA est arrivé en tête ou a égalé les meilleurs concurrents. Il s’est montré particulièrement robuste lors d’épreuves inter-jeux de données, un cadre exigeant qui reflète la manière dont un outil doit fonctionner dans des hôpitaux équipés différemment et soumis à des conditions d’imagerie variées. Des comparaisons visuelles détaillées ont montré que HCIA capturait de façon plus fiable les formes irrégulières des polypes et les frontières peu contrastées que les méthodes rivales.

Ce que cela signifie pour les patients et les cliniciens

Pour un public non spécialiste, l’essentiel est que HCIA est un système d’IA qui délimite plus précisément les excroissances potentiellement cancéreuses dans les images de coloscopie tout en étant suffisamment rapide pour une utilisation en temps réel. En combinant des détails locaux nets et une forte vision d’ensemble, et en le faisant de manière efficace, il réduit les risques que des polypes subtils ou de forme atypique passent inaperçus. Bien que le modèle nécessite encore des optimisations pour des appareils très légers et n’exploite pas encore l’information issue de séquences vidéo dans le temps, il représente une avancée significative vers une assistance informatique plus intelligente et plus fiable dans le dépistage du cancer colorectal — aidant les médecins à détecter davantage de formations dangereuses avant qu’elles ne mettent la vie en péril.

Citation: Li, L., Yang, H., Zhang, J. et al. Hierarchical contextual information aggregation for polyp segmentation. Sci Rep 16, 5959 (2026). https://doi.org/10.1038/s41598-026-35703-2

Mots-clés: polypes colorectaux, IA en coloscopie, segmentation d’images médicales, apprentissage profond, détection précoce du cancer