Clear Sky Science · fr

DermNet : architecture intégrative CNN‑ViT pour atténuation des biais en diagnostic dermatologique grâce à une segmentation non supervisée avancée des lésions

Pourquoi le diagnostic sur peaux claires et foncées compte

Les maladies de la peau touchent presque tout le monde à un moment donné — de l’acné et de l’eczéma à des affections plus graves. Pourtant, pour de nombreuses personnes à la peau brune ou foncée, ces problèmes sont plus difficiles à repérer et plus facilement mal diagnostiqués, tant en consultation qu’auprès des outils d’intelligence artificielle (IA). Cet article présente DermNet, un nouveau système d’IA conçu pour reconnaître les maladies cutanées de manière plus équitable entre les tons de peau en apprenant à l’ordinateur à se concentrer sur la zone réellement malade plutôt que sur la couleur de la peau environnante.

Le problème d’une IA « taille unique » pour la peau

La plupart des systèmes d’IA existants pour le diagnostic dermatologique sont entraînés sur des photos fortement biaisées en faveur des peaux claires. Lorsqu’on applique ces mêmes systèmes à des personnes à la peau plus foncée, leur précision chute de 8 à 12 %. Dans la pratique, cet écart peut signifier des signaux d’alerte précoces manqués et des traitements retardés. Constituer des ensembles de photos médicales équilibrés est aussi difficile : les images sont dispersées entre hôpitaux, certains pays tiennent peu de dossiers numériques, et l’annotation experte par des dermatologues prend du temps et coûte cher. En conséquence, l’IA apprend souvent des raccourcis, par exemple en associant certaines maladies principalement à des peaux pâles, au lieu de vraiment comprendre l’apparence d’une lésion.

Apprendre à l’ordinateur à ne voir que la zone lésée

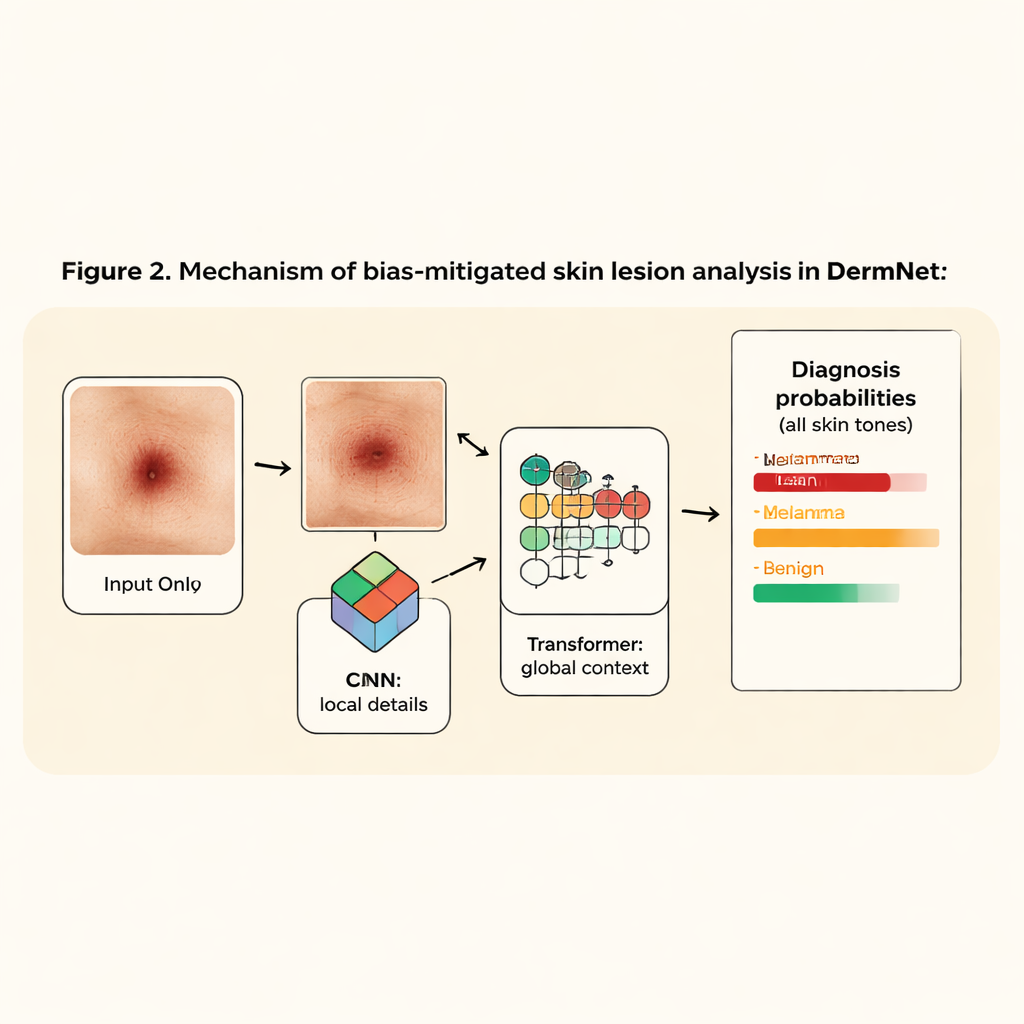

Les auteurs s’attaquent à ce biais à sa source : l’image elle‑même. Plutôt que d’alimenter l’IA avec des photos complètes de bras, visage ou jambes, ils découpent d’abord automatiquement uniquement la zone malade — la lésion — quelle que soit la couleur de la peau environnante. Pour cela, ils combinent un puissant outil open source appelé Segment Anything (qui peut délimiter des objets sans entraînement spécifique) avec des astuces classiques de traitement d’image qui font ressortir les différences de couleur et de luminosité. En changeant astucieusement d’espace colorimétrique et en appliquant un seuillage automatisé, ils produisent des « masques » noir et blanc séparant la lésion de la peau normale. Fait notable, ce pipeline non supervisé atteint environ 90 % de recouvrement avec des contours de lésion de qualité experte sur des peaux claires comme foncées, sans dépendre de masques dessinés manuellement pour l’entraînement.

Un réseau plus léger et plus intelligent pour les maladies cutanées

Une fois la lésion isolée, DermNet prend le relais. Ce classificateur mélange deux idées d’IA populaires : les réseaux convolutionnels (CNN), efficaces pour repérer bords et textures, et les vision transformers, capables de saisir des motifs à longue portée dans une image. DermNet utilise d’abord seulement deux couches CNN légères pour extraire les détails fins de la lésion recadrée, puis transmet ces motifs à un transformer qui apprend les relations entre les différentes parties de la lésion. Parce que le système n’a plus à analyser des photos de corps entiers, il peut rester compact — environ 2,5 millions de paramètres, moins de 10 mégaoctets — tout en surpassant des modèles d’image beaucoup plus volumineux et largement utilisés.

Construire en coulisses un jeu de données plus équitable

Pour entraîner et évaluer DermNet, l’équipe a fusionné deux collections annotées par des dermatologues dans ce qu’ils appellent le jeu de données SkinCon. Après avoir exigé au moins 20 images par maladie, ils ont obtenu 3 643 images couvrant 122 affections, avec à peu près un tiers provenant de peaux claires, brunes et foncées. Ils ont ensuite étendu ce corpus par des transformations simples, comme la rotation et des variations de luminosité, pour réduire le surapprentissage et améliorer la robustesse. En utilisant cet ensemble diversifié et soigné, ils ont constaté qu’un entraînement sur images complètes non segmentées menait à un apprentissage instable et à une précision de validation autour de 50–56 %. Lorsqu’ils sont passés à des entrées ne contenant que la lésion, les performances ont bondi : DermNet a atteint environ 81 % de précision en validation et l’a fait de manière plus constante sur les trois groupes de tons de peau.

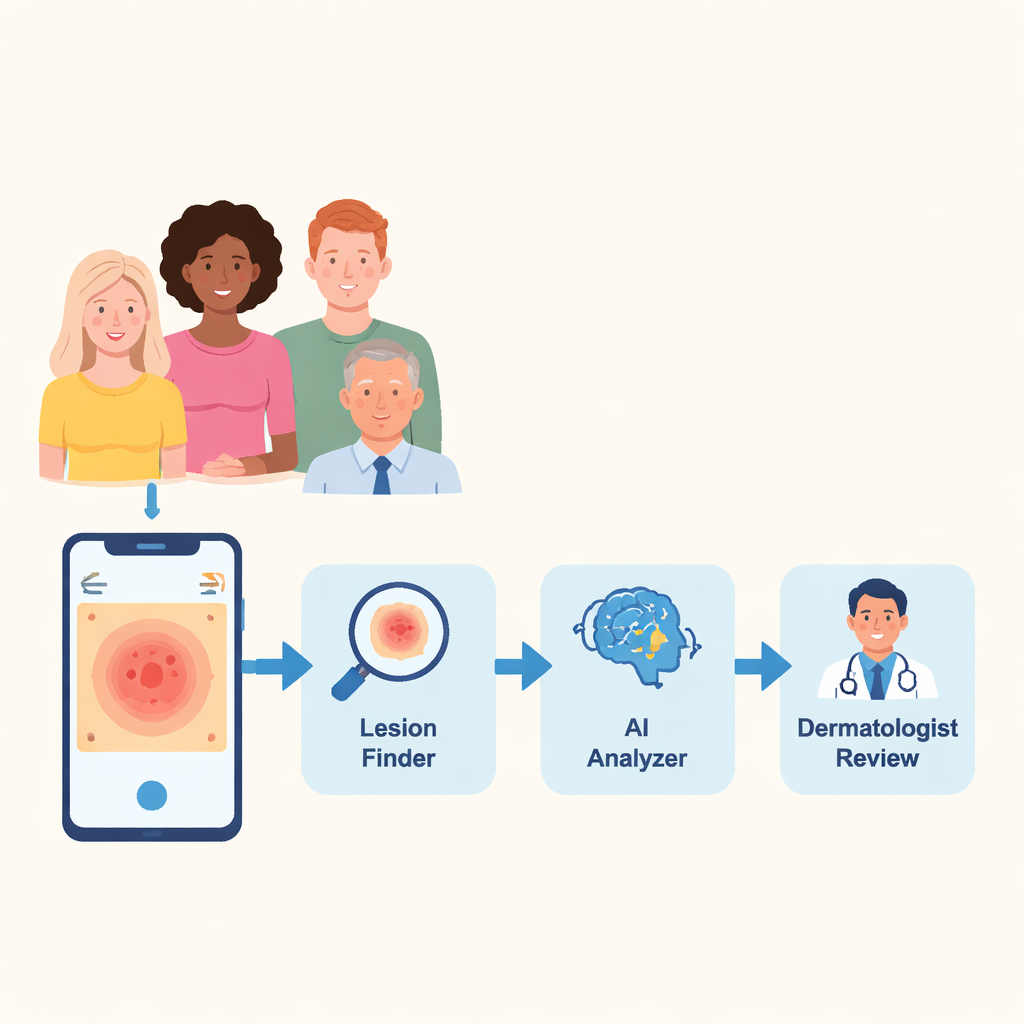

Du protocole de laboratoire à l’assistant de poche

Pour montrer comment cela pourrait fonctionner en pratique, les chercheurs ont développé une application mobile prototype. L’utilisateur prend ou téléverse une photo d’une zone cutanée suspecte ; le système segmente automatiquement la lésion, l’analyse avec DermNet et renvoie les trois diagnostics les plus probables avec leurs probabilités — en moins de 20 secondes — tout en laissant le jugement final au dermatologue. Bien que cela ne remplace pas un médecin, de tels outils pourraient signaler des maladies à un stade précoce, surtout dans des régions où les dermatologues sont rares, et aider à prioriser le temps limité des spécialistes sur les cas les plus urgents.

Ce que cela signifie pour les patients au quotidien

La principale conclusion pour le grand public est que l’IA n’a pas besoin d’être « daltonienne » de manière naïve ; elle peut plutôt être guidée pour regarder la bonne chose : la lésion elle‑même. En éliminant l’influence du ton de peau de l’arrière‑plan et en se concentrant sur la zone malade, cette étude montre qu’il est possible de construire un modèle léger et précis qui traite de manière plus équitable les images de peaux claires, brunes et foncées. DermNet constitue une première étape vers des applications et des systèmes diagnostiques en dermatologie qui fonctionnent de façon fiable pour tout le monde, et pas seulement pour ceux dont la peau correspond à la majorité des photos médicales existantes.

Citation: Imran, M.H., Shahid, M., Aazam, M. et al. DermNet: integrative CNN-ViT architecture for bias mitigation in dermatological diagnostics using advanced unsupervised lesion segmentation. Sci Rep 16, 5291 (2026). https://doi.org/10.1038/s41598-026-35697-x

Mots-clés: diagnostic des maladies de la peau, biais en IA médicale, segmentation de lésions, imagerie en dermatologie, transformer de vision