Clear Sky Science · fr

Synapses néo‑hebbiennes pour accélérer l’entraînement en ligne du matériel neuromorphique

Apprendre aux puces à tirer des leçons de l’expérience

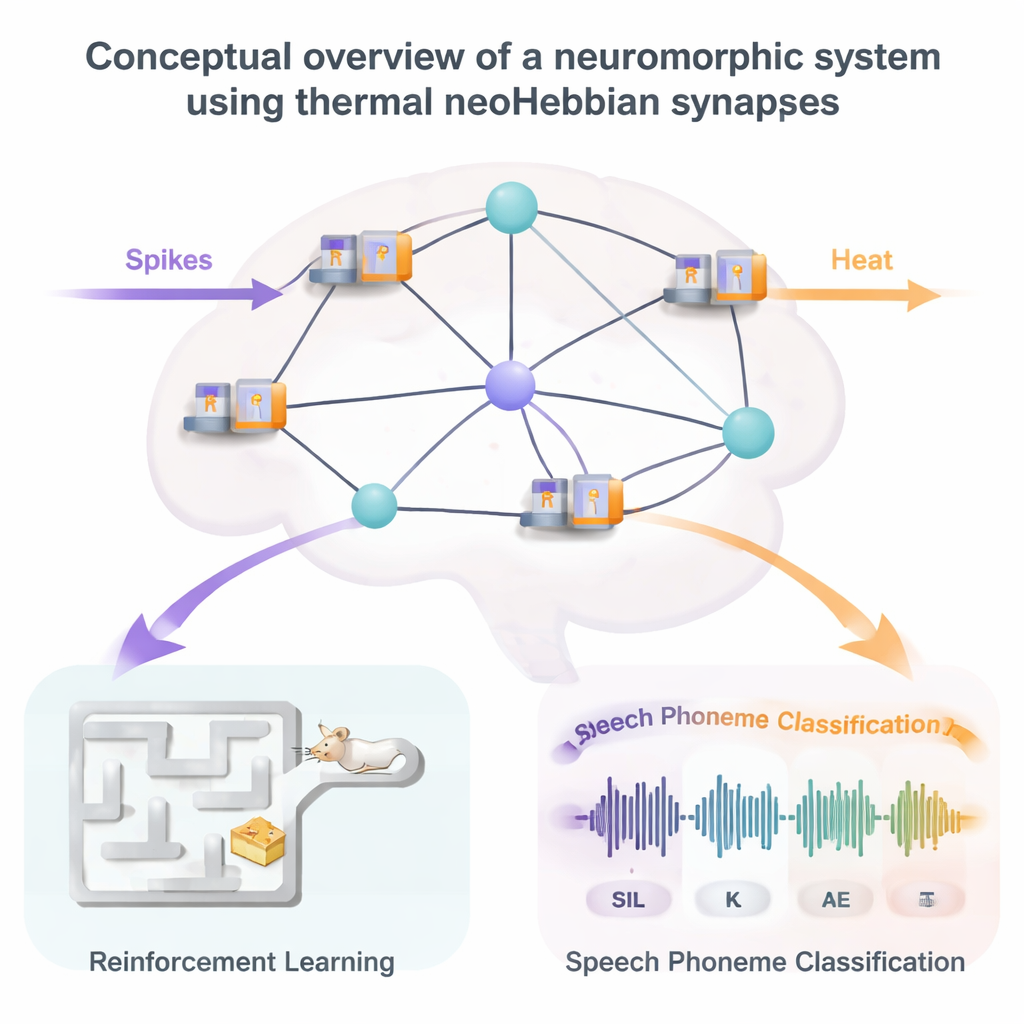

L’intelligence artificielle moderne est remarquablement puissante, mais reste loin d’égaler la capacité du cerveau à apprendre à partir de retours rares et différés — comme se rappeler quel raccourci en ville a réellement fait gagner du temps. Cet article présente un nouveau type de « synapse » artificielle, les connexions entre neurones artificiels, qui permet aux puces neuromorphiques d’apprendre de façon plus proche du cerveau, en ligne, tout en restant compactes et peu énergivores. Pour les lecteurs intéressés par l’avenir du matériel IA, il montre comment la chaleur elle‑même peut être transformée en un signal utile pour l’apprentissage au sein de petits dispositifs mémoire.

Pourquoi les cerveaux neuromorphiques ont besoin de meilleures synapses

L’informatique neuromorphique vise à imiter la façon dont le cerveau traite l’information : en utilisant des réseaux neuronaux à pointes, où de brèves impulsions électriques traversent d’immenses réseaux de synapses. Le matériel actuel peut déjà implémenter des synapses avec des composants mémristifs tels que la ReRAM, dont la conductance électrique peut être réglée pour stocker un poids. Cependant, les règles d’apprentissage « hebbiennes » simples — où les synapses se renforcent ou s’affaiblissent uniquement en fonction du timing local des pointes — peinent sur des tâches réalistes qui nécessitent d’associer des événements séparés dans le temps, comme la compréhension de la parole ou la résolution de problèmes de navigation. Les techniques de deep learning standard traitent cela par la rétropropagation à travers le temps, mais cette méthode demande trop de mémoire et d’énergie pour du matériel de type cérébral. La communauté s’est donc tournée vers des règles d’apprentissage à « trois facteurs » et des algorithmes comme l’eligibility propagation (e‑prop), qui introduisent une trace mémoire locale supplémentaire à chaque synapse afin qu’un signal de récompense global différé puisse quand même ajuster les connexions adéquates.

Stocker une mémoire éphémère dans la chaleur

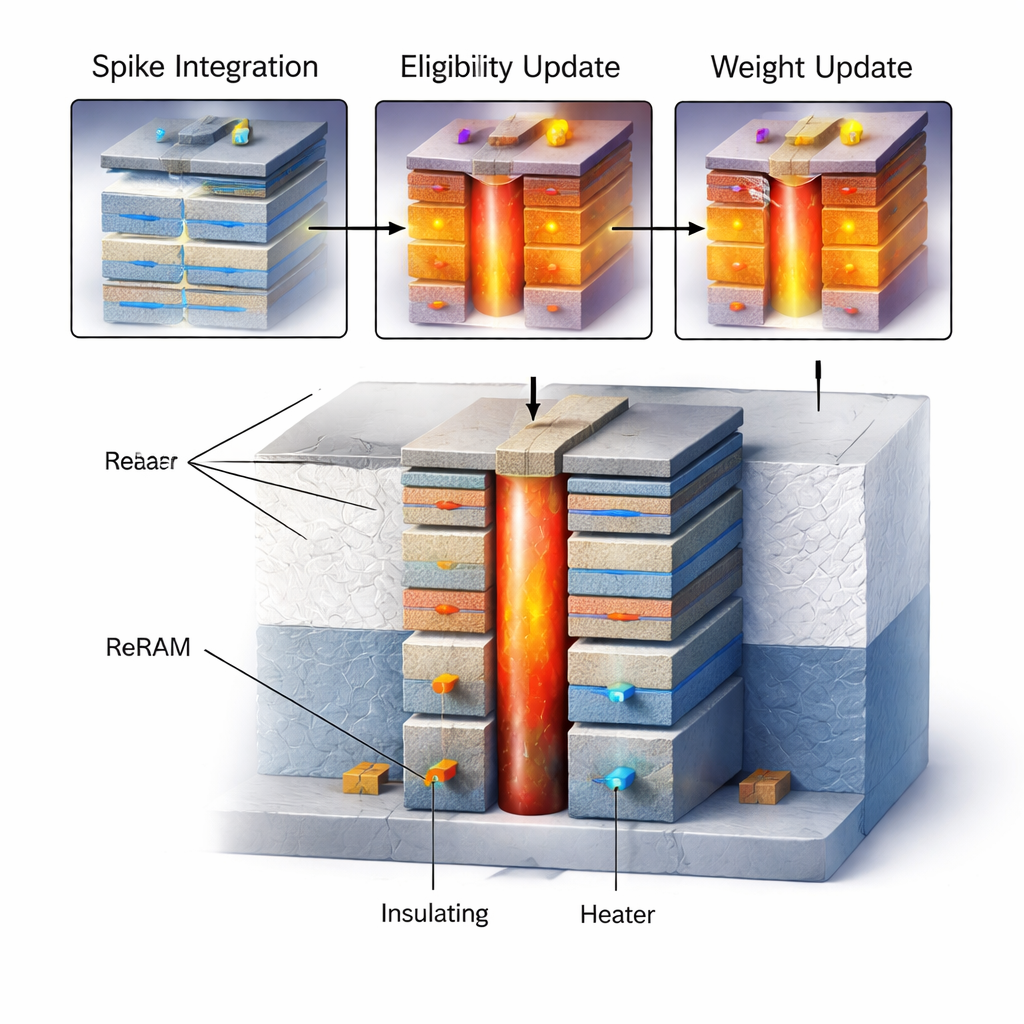

L’idée centrale de ce travail est une synapse « néo‑hebbienne » qui possède deux variables d’état internes : un poids de couplage à long terme et une trace d’éligibilité à court terme qui mémorise l’activité récente. Le poids est encodé, comme d’habitude, dans la conductance d’un dispositif ReRAM. La trace d’éligibilité, en revanche, est stockée dans la température locale de ce dispositif, contrôlée par un petit chauffage résistif à l’échelle nanométrique intégré directement au‑dessus ou à côté. Pendant le traitement normal des pointes, la ReRAM multiplie simplement les pointes entrantes par son poids stocké. Lors de l’apprentissage, des signaux générés par les neurones correspondant à « ce qui a déclenché avant » et « la sensibilité actuelle du neurone postsynaptique » font circuler du courant dans le micro‑chauffage. Parce que le chauffage et la ReRAM sont couplés thermiquement, cette puissance élève la température du dispositif en proportion du produit de ces deux signaux — soit la trace d’éligibilité mathématique requise par l’algorithme e‑prop.

Comment la chaleur modifie la mémoire

Une fois qu’une courte séquence d’entrée — appelée dataframe — a été traitée, l’élévation de température accumulée encode le degré d’« éligibilité » de cette synapse à changer. Une impulsion de programmation fixe est alors appliquée à travers la ReRAM. De façon cruciale, des expériences détaillées montrent que la variation de conductance résultante dépend fortement de la température : les dispositifs plus chauds se modifient davantage, et la direction et l’amplitude de ce changement dépendent de l’état initial de conductance et du sens (augmentation ou diminution) vers lequel on pousse la conductance. En choisissant judicieusement les amplitudes des impulsions et en exploitant cette sensibilité à la température, les auteurs obtiennent un changement de poids à peu près proportionnel à l’éligibilité stockée. Des modèles numériques du flux de chaleur dans une pile chauffante ReRAM 3D intégrée confirment que la température peut être élevée puis laissée décroître sur des échelles de temps ajustables, et que la structure peut être conçue pour renforcer l’auto‑chauffage souhaité tout en limitant le « diaphonie » thermique vers les synapses voisines.

Mettre les synapses thermiques à l’épreuve

Pour évaluer l’utilité réelle de cette synapse exotique, les auteurs simulent des systèmes neuromorphiques complets incluant des comportements de dispositif réalistes tels que la décroissance de température, la variabilité d’un dispositif à l’autre et la précision limitée. Dans une démonstration, un réseau à pointes contrôle une souris virtuelle qui doit apprendre à naviguer dans un labyrinthe en grille pour trouver du fromage tout en évitant des pièges. Ici, le refroidissement thermique naturel — qui érode lentement l’éligibilité stockée — joue le rôle du « facteur d’actualisation » familier de l’apprentissage par renforcement : les paires état‑action récentes comptent plus que les anciennes. Les simulations montrent que l’apprentissage est le plus rapide quand cette décroissance n’est ni trop rapide ni trop lente, et que la variabilité du comportement des ReRAM dégrade la performance seulement progressivement. Dans un second test plus exigeant, un réseau récurrent à pointes avec synapses néo‑hebbiennes thermiques est entraîné en ligne sur la base de données TIMIT pour la classification des phonèmes, une tâche standard de reconnaissance vocale. Avec une résolution de conductance suffisante (environ l’équivalent de 8 bits), le modèle conscient du matériel atteint une précision à quelques pourcents près d’une implémentation idéale en virgule flottante.

Ce que cela signifie pour le futur du matériel IA

Globalement, l’étude démontre que la température locale peut servir de mémoire interne pratique et contrôlable pour des règles d’apprentissage avancées, permettant un entraînement rapide sur puce sans une lourde surcharge numérique. La synapse proposée occupe à peu près la même empreinte qu’une cellule ReRAM conventionnelle, tout en implémentant à la fois un poids stable et une trace éphémère, et son coût énergétique par pas d’apprentissage se situe dans la gamme du picojoule. Si le recours à la chaleur soulève des défis réels — la température est difficile à mesurer directement et peut accélérer l’usure des dispositifs — le travail suggère qu’embrasser, plutôt que combattre, les effets électro‑thermiques pourrait débloquer de nouvelles classes de matériel d’apprentissage compact. Pour les non‑spécialistes, la conclusion est que les futures puces d’IA ne se contenteront peut‑être plus de transporter des électrons : elles pourraient aussi calculer avec des motifs de chaleur soigneusement conçus, rapprochant l’apprentissage machine de l’efficacité et de l’adaptabilité du cerveau humain.

Citation: Pande, S., Bezugam, S.S., Bhattacharya, T. et al. NeoHebbian synapses to accelerate online training of neuromorphic hardware. Sci Rep 16, 6836 (2026). https://doi.org/10.1038/s41598-026-35641-z

Mots-clés: informatique neuromorphique, réseaux neuronaux à pointes, synapse ReRAM, apprentissage en ligne, IA économe en matériel