Clear Sky Science · fr

CRFusion : un nouveau réseau de fusion LiDAR‑caméra pour la construction de cartes en vue de dessus (BEV)

Cartes numériques plus intelligentes pour les voitures autonomes

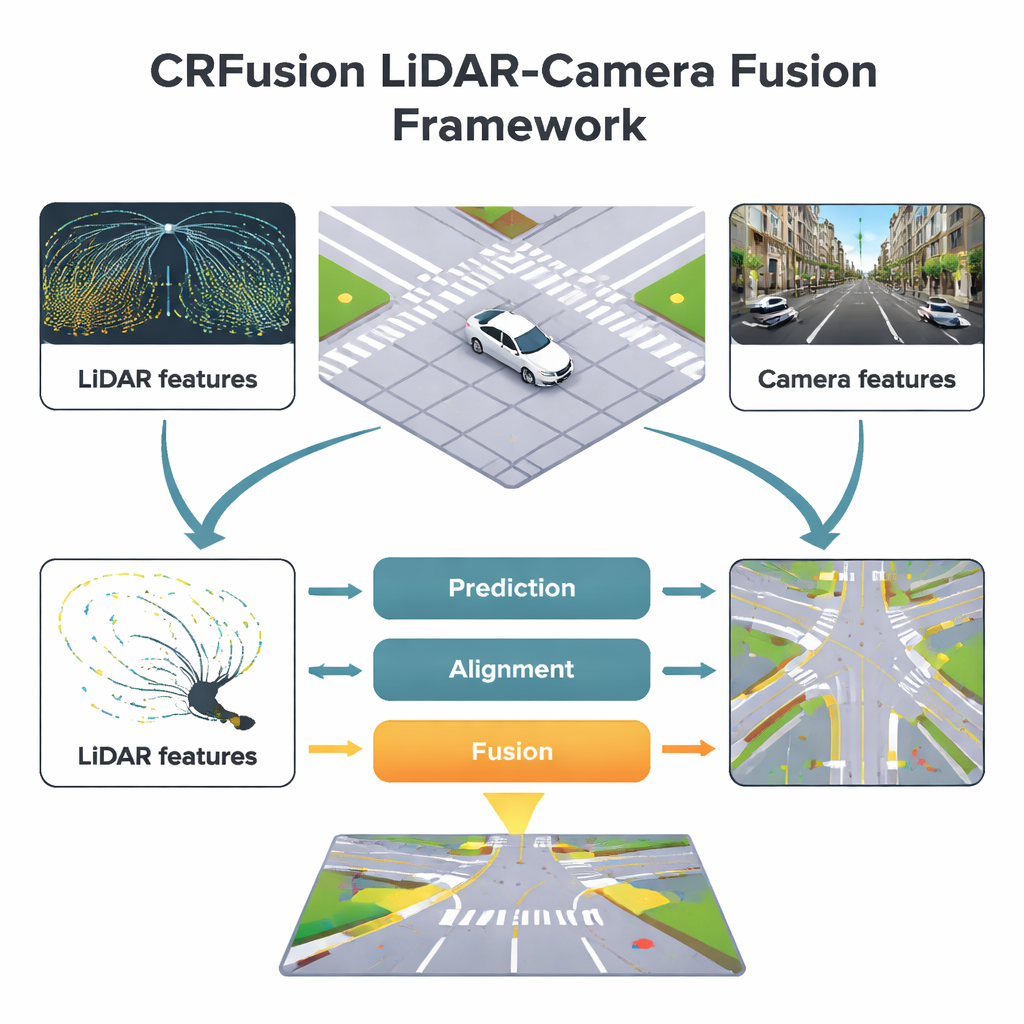

Pour une voiture autonome, comprendre la route qui s’annonce revient à lire une carte en perpétuelle évolution. Le véhicule doit savoir précisément où se trouvent les voies, les passages piétons et les bords de chaussée, même quand il fait sombre, qu’il pleut ou qu’un obstacle masque la vue. Cet article présente CRFusion, un nouveau système qui combine scanners laser et caméras pour construire des cartes aériennes de rues urbaines plus nettes et plus fiables, aidant les véhicules autonomes à rester dans leur voie et à éviter les piétons avec une plus grande assurance.

Pourquoi deux « yeux électroniques » valent mieux qu’un

Les voitures autonomes modernes s’appuient principalement sur deux capteurs. Les caméras capturent des images en couleur riches en informations, ce qui facilite la détection des peintures de voie, des panneaux et des passages pour piétons à distance. Les scanners laser, ou LiDAR, émettent des impulsions lumineuses et mesurent leur retour pour reconstruire une image 3D précise des distances et des formes autour du véhicule. Chacun a ses limites : les images caméra peuvent être trompées par un mauvais éclairage ou des intempéries, tandis que les mesures LiDAR deviennent clairsemées et incomplètes à mesure que la distance augmente. CRFusion vise à fusionner ces forces et faiblesses en une seule vue en plongée (BEV), une carte vue de dessus où chaque pixel représente une petite parcelle de sol étiquetée comme voie, séparateur ou passage piéton.

Combler les lacunes de la vision longue portée

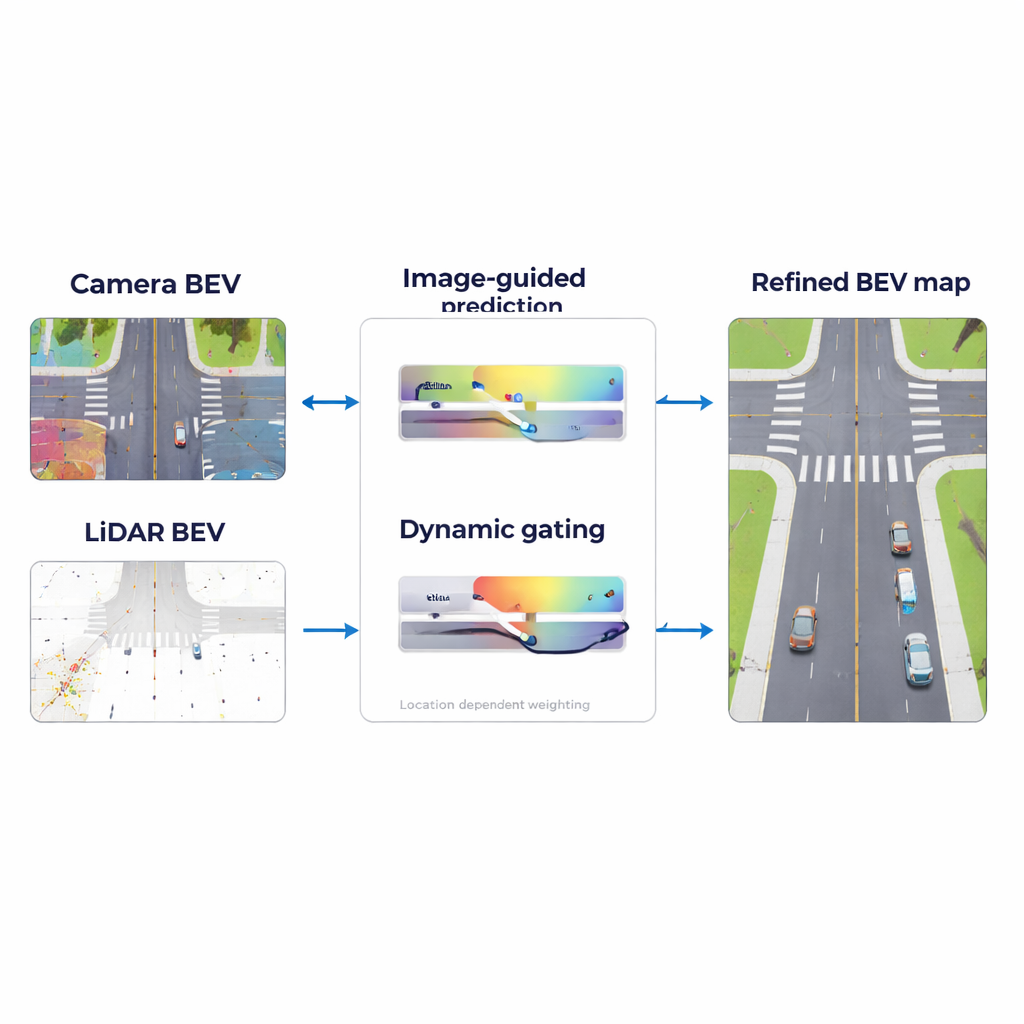

Un défi majeur en cartographie routière est que le LiDAR manque souvent de détails loin du véhicule, précisément là où la planification anticipée est la plus cruciale. CRFusion s’attaque à ce problème avec un « prédicteur de portée LiDAR ». Concrètement, le système analyse ce que la caméra voit au loin et utilise cette information pour estimer ce que le LiDAR aurait mesuré s’il avait été dense et complet. Un mécanisme dit d’attention aide le modèle à décider quelles parties de la vue caméra expliquent le mieux les zones vides ou incertaines de la carte LiDAR. Il affine ensuite cette prédiction en comparant les régions voisines de la carte, renforçant les motifs cohérents tels que des lignes de voie continues et réduisant le bruit aléatoire.

Faire converger les capteurs vers la même représentation

Même lorsque caméra et LiDAR fonctionnent, leurs relevés ne s’alignent pas parfaitement. De petites erreurs d’estimation de distance ou de positionnement des capteurs peuvent faire apparaître les marquages de voie vus par la caméra légèrement décalés par rapport aux mesures LiDAR. CRFusion introduit une étape d’alignement qui « déforme » en douceur les caractéristiques en vue de dessus issues de la caméra pour mieux correspondre à la vue LiDAR. Cela se fait à l’aide d’un réseau de correction léger qui prédit comment chaque point de la carte caméra doit être ajusté. En conséquence, les deux vues décrivent les mêmes positions physiques sur la route, rendant la fusion ultérieure beaucoup plus fiable.

S’adapter au jour, à la nuit et aux intempéries

Une fois les deux vues alignées, le système doit encore décider combien faire confiance à chacune à chaque emplacement. Une autoroute ensoleillée avec des peintures de voie nettes est très différente d’une nuit pluvieuse en centre-ville. CRFusion traite cela avec un module de « fusion à portes dynamiques » qui attribue des poids flexibles aux caractéristiques caméra et LiDAR sur la carte. Là où les retours LiDAR sont forts, par exemple pour les bords de route proches ou les objets solides, le système s’appuie davantage sur le LiDAR. Là où les indices visuels sont plus clairs, comme des bandes de passage piéton lumineuses au loin, il s’appuie davantage sur la caméra. Ces poids sont appris automatiquement à partir des données, permettant à la stratégie de fusion d’évoluer en douceur selon les conditions.

Preuves des bénéfices sur des données réelles

Les chercheurs ont testé CRFusion sur un jeu de données largement utilisé en conduite autonome, appelé NuScenes, qui contient de nombreuses scènes de conduite dans différentes villes, conditions météorologiques et moments de la journée. Par rapport aux méthodes de pointe précédentes, CRFusion a produit des délimitations de voies, des séparateurs et des passages piétons plus précis, en particulier à des distances moyennes et longues, jusqu’à 90 mètres. Il a amélioré les mesures standards de qualité tant pour le recouvrement avec les cartes de référence que pour la capacité à détecter des segments de voie individuels, et une étude d’ablation a montré que chaque composant majeur — la prédiction longue portée, le réseau d’alignement et la fusion dynamique — apportait des gains significatifs. Des exemples visuels ont révélé une continuité de voie plus lisse et des passages piétons plus nets, confirmant que les cartes produites ressemblent davantage à des plans routiers soigneusement dessinés.

Ce que cela change pour la conduite de tous les jours

Pour un public non spécialiste, l’idée principale est que CRFusion aide les voitures autonomes à construire des cartes de rue plus propres et plus fiables en permettant aux caméras et au LiDAR de « se parler » de manière plus intelligente. En prédisant les informations LiDAR manquantes à partir des vues caméra, en alignant les deux perspectives et en ajustant la confiance accordée à chacune selon la situation, le système réduit les angles morts et les approximations. Cela rapproche les véhicules autonomes d’une capacité à gérer des rues urbaines complexes et encombrées avec la même assurance qu’un conducteur humain attentif suivant des voies et des passages bien marqués.

Citation: Guan, Y., Wang, T., Cheng, Q. et al. CRFusion: a novel LiDAR-camera fusion network for BEV map construction. Sci Rep 16, 5169 (2026). https://doi.org/10.1038/s41598-026-35551-0

Mots-clés: conduite autonome, fusion LiDAR‑caméra, cartes sémantiques HD, perception en vue de dessus, cartographie routière urbaine