Clear Sky Science · fr

Le rôle de la diagnosticité dans l’évaluation de la compétence des robots

Pourquoi les erreurs des robots nous concernent tous

Les robots et les systèmes d’IA passent rapidement des laboratoires aux usines, aux hôpitaux et à nos rues. À mesure que nous commençons à dépendre d’eux, une question devient cruciale : comment les gens décident-ils si un robot est réellement compétent ? Cet article examine comment nous jugeons un robot qui fonctionne généralement bien mais commet parfois une erreur surprenante — ou réalise parfois un succès inattendu. Les résultats aident à comprendre pourquoi nos « impressions instinctives » à l’égard des machines peuvent différer de ce que nous exprimons explicitement, et pourquoi une seule erreur peut être minimisée ou changer durablement notre confiance.

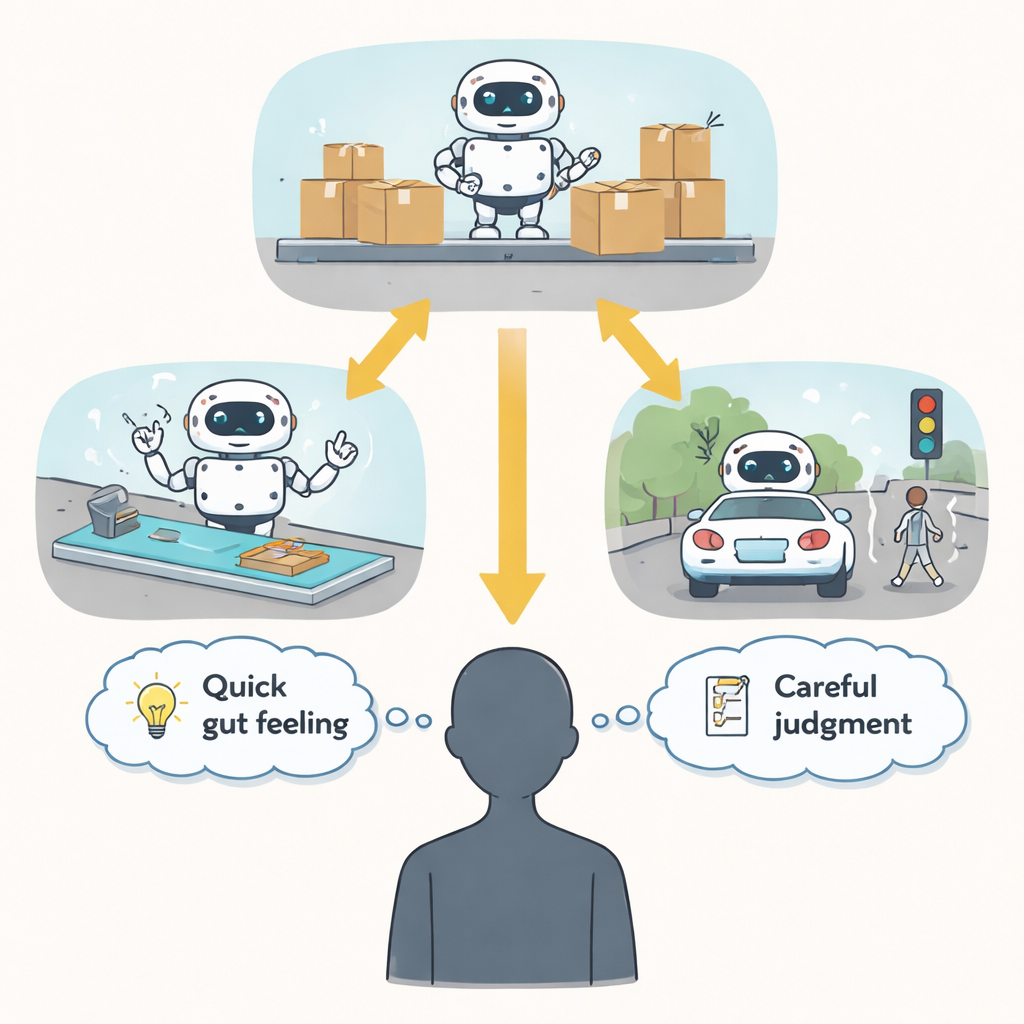

Deux manières dont notre esprit juge les machines

Les psychologues distinguent deux types d’impressions. Les impressions explicites sont les jugements que nous pouvons rapporter directement quand on nous le demande, comme noter un robot sur une échelle de compétence de 1 à 7. Les impressions implicites sont plus automatiques, reflétées dans des réponses rapides que les personnes donnent sans se concentrer sur l’évaluation. Des travaux antérieurs suggéraient que les impressions explicites changent rapidement face à un nouveau comportement, tandis que les impressions implicites évoluent plus lentement. Cette étude interroge si cet écart reflète vraiment des systèmes mentaux différents — ou s’il dépend de la mesure dans laquelle le nouveau comportement semble informatif, c’est-à-dire diagnostique, des véritables capacités du robot.

Des ateliers aux blocs opératoires et aux autoroutes

Dans neuf expériences en ligne rassemblant plus de 3 700 participants, les chercheurs ont montré différentes situations réalistes impliquant des robots : un robot industriel se déplaçant dans un entrepôt encombré, un robot chirurgical traçant des trajectoires précises, et une voiture autonome réagissant aux obstacles sur la route. Parfois, le robot était constamment performant ou constamment maladroit. Dans d’autres cas, il était majoritairement compétent mais commettait une erreur isolée et claire, ou majoritairement incompétent mais réalisait un succès remarquable. Après avoir vu de courtes séquences de ces performances, les impressions des participants ont été mesurées de deux façons : par des questions directes d’auto-évaluation et par des tâches indirectes captant des réactions rapides et automatiques.

Quand une performance inhabituelle prend une grande importance

Dans ces scénarios réalistes, les évaluations explicites des participants reflétaient à la fois le modèle global de performance et l’essai « bizarre » isolé. Une seule erreur au milieu de nombreux succès pouvait faire baisser notablement les notes explicites, et un seul succès isolé au milieu d’échecs pouvait les augmenter. Les impressions implicites, en revanche, racontaient une autre histoire. Elles répondaient fortement au comportement typique du robot — qu’il soit généralement compétent ou non — mais ignoraient en grande partie l’essai atypique. Cette dissociation est restée même lorsque les chercheurs ont soigneusement repensé leurs mesures pour que les tâches « explicites » et « implicites » paraissent et se ressentent aussi similaires que possible, ne différant principalement que par le fait que les participants étaient ou non invités à juger le robot volontairement.

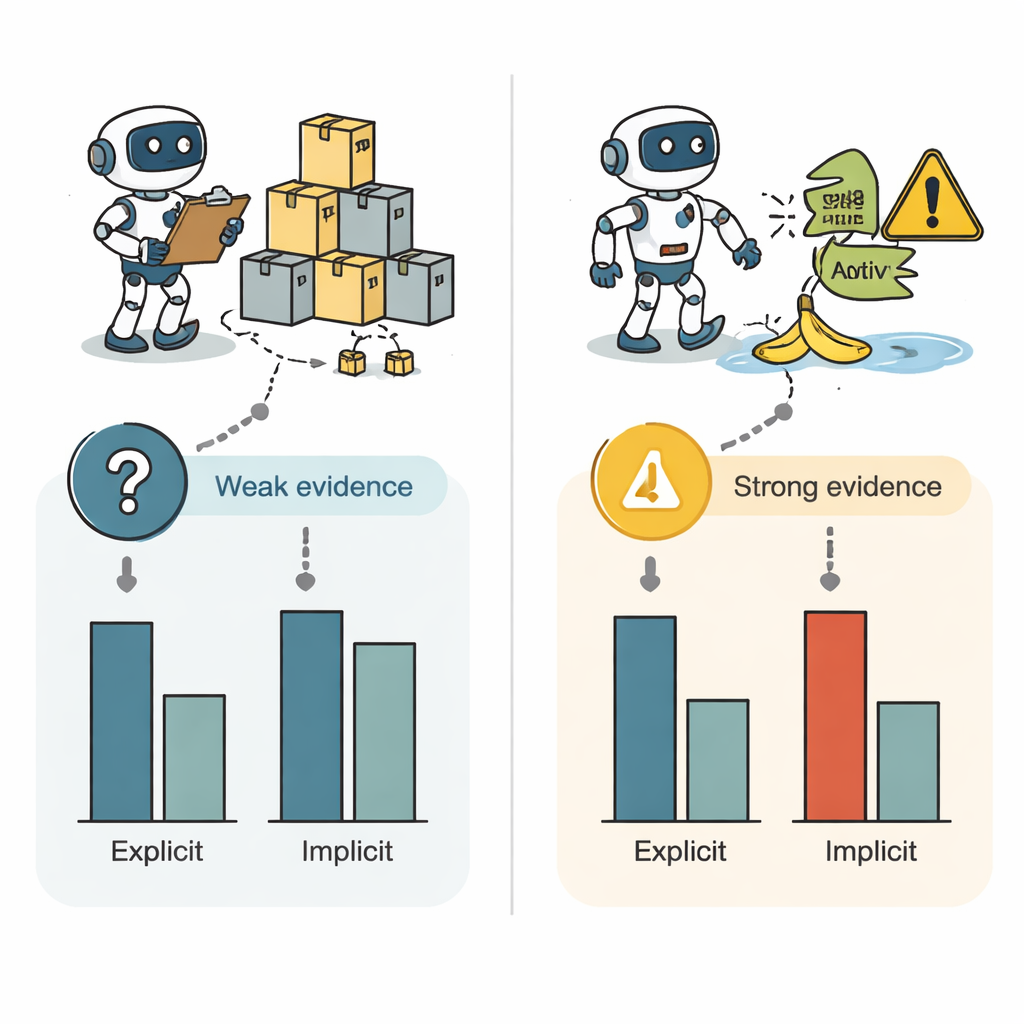

Ce qui rend une erreur vraiment révélatrice

L’équipe a ensuite testé une idée clé : le poids d’un événement atypique dépend de la diagnosticité — autrement dit, de la mesure dans laquelle les gens estiment qu’il révèle quelque chose de durable sur le robot. Dans de nouvelles études, les participants ont d’abord vu un robot effectuer plusieurs essais sans faute, puis voir par la suite une ou plusieurs défaillances. Lorsque ces échecs ultérieurs étaient présentés comme importants, récents, ou lorsque plusieurs échecs s’accumulaient au point d’égaler la quantité de succès antérieurs, aussi bien les impressions explicites qu’implicites changeaient. Crucialement, dans ces conditions de forte diagnosticité, une seule erreur suffisait à faire évoluer les impressions automatiques et implicites. Lorsque le même type de raté était décrit comme obsolète, peu important ou comme un accident isolé, les impressions implicites bougeaient à peine, alors que les évaluations explicites évoluaient toujours.

Pourquoi cela compte pour la confiance quotidienne dans l’IA

Pris ensemble, ces résultats suggèrent que nos impressions rapides et automatiques de la compétence des robots ne sont pas aveugles aux nouvelles informations, mais qu’elles exigent des preuves plus fortes ou plus clairement signifiantes pour changer. Nos évaluations verbales, en revanche, sont très réactives même face à des événements faibles ou ambigus, en partie parce que nous ressentons la pression d’utiliser toute information disponible lorsqu’on nous demande un jugement. Pour les concepteurs, ingénieurs et décideurs, cela signifie que gérer la confiance dans les robots ne se résume pas à réduire les erreurs, mais aussi à la manière dont ces erreurs sont cadrées et comprises. Un seul échec fortement révélateur — comme une voiture qui ne s’arrête pas alors qu’elle le devrait manifestement — peut remodeler à la fois nos impressions instinctives et nos opinions déclarées, avec des conséquences directes sur notre disposition à adopter et à nous fier aux machines intelligentes.

Citation: Surdel, N., Ferguson, M.J. The role of diagnosticity in judging robot competence. Sci Rep 16, 7578 (2026). https://doi.org/10.1038/s41598-026-35375-y

Mots-clés: compétence des robots, interaction humain-robot, biais implicite, confiance dans l’IA, information diagnostique