Clear Sky Science · fr

Une approche multimodale pour reconnaître les fake news et les nœuds influents qui les propagent en utilisant l’apprentissage profond et l’analyse de réseau

Pourquoi cela compte dans la vie quotidienne

Chaque jour, des millions de personnes font défiler les réseaux sociaux et voient des publications sur la santé, la politique, l’argent et bien d’autres sujets. Parmi les informations utiles se glissent des rumeurs et des fausses nouvelles qui peuvent provoquer peur, confusion, voire des dommages concrets. Cette étude présente une méthode puissante qui fait deux choses à la fois : d’une part, repérer automatiquement les publications fausses ou trompeuses, et d’autre part, cartographier qui est le plus responsable de leur propagation au sein d’une communauté en ligne. Le travail se concentre sur des messages Twitter concernant la Covid‑19, mais les idées pourraient aider les plateformes, les journalistes et le grand public à réagir plus rapidement et plus précisément face aux désinformations nuisibles dans de nombreux domaines.

Comment les rumeurs se propagent dans les foules en ligne

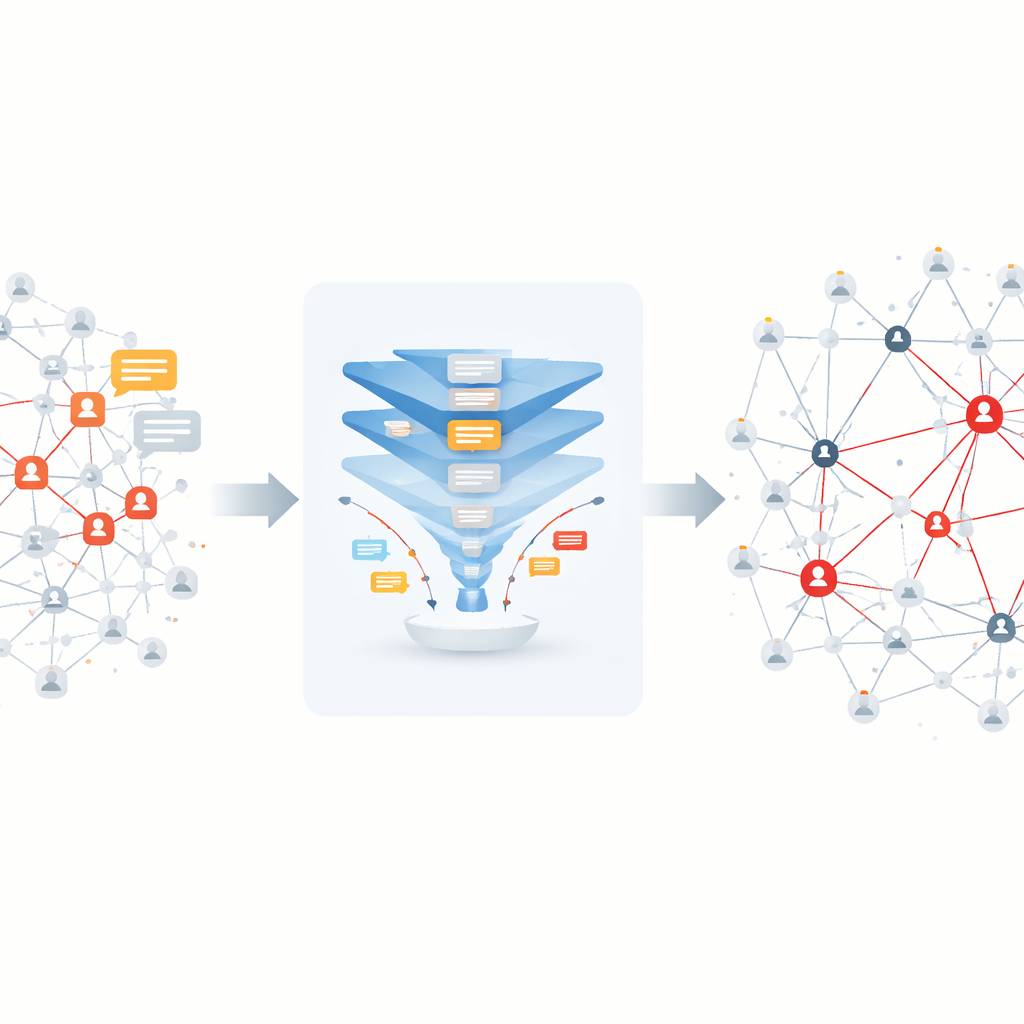

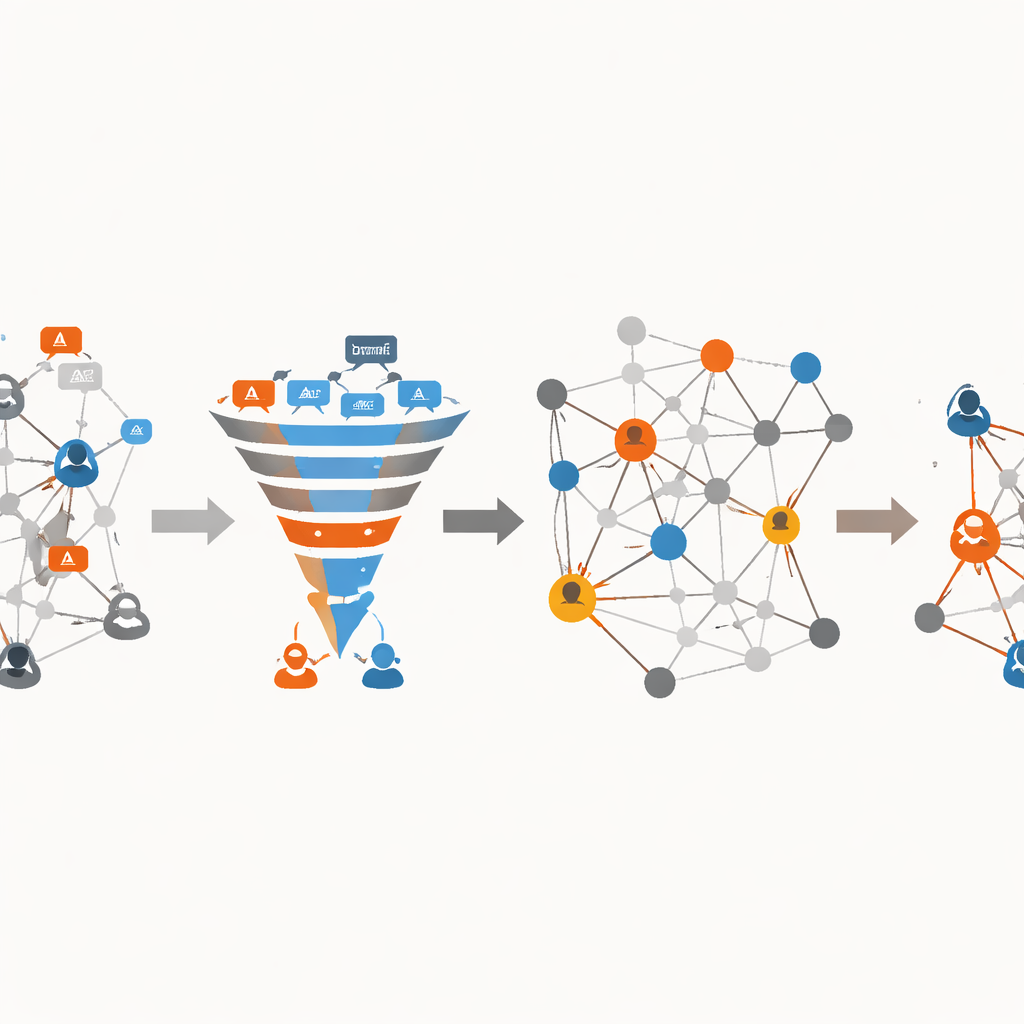

Les réseaux sociaux tels que Twitter, Facebook ou les applications de messagerie peuvent être vus comme d’immenses toiles de personnes (nœuds) reliées par leurs interactions (liens). Lorsqu’un utilisateur publie un message et que d’autres y répondent ou le partagent, l’information peut rapidement se propager à travers la toile. Les rumeurs — des affirmations non vérifiées ou fausses — se comportent comme des maladies contagieuses : elles sautent d’une personne à l’autre, croissent rapidement et sont difficiles à arrêter. Les recherches antérieures ont souvent traité deux questions séparément : comment déterminer si une publication est une rumeur, et comment identifier les “propagateurs” clés qui font atteindre la rumeur à de nombreux autres. Les auteurs soutiennent que traiter ces deux questions ensemble, tout en tenant compte de la structure du réseau et de l’évolution de l’activité dans le temps, donne une vision bien plus claire de la manière dont les fausses histoires circulent.

Apprendre à un ordinateur à lire et signaler les publications douteuses

La première partie de la méthode se concentre sur le contenu de chaque tweet. Les chercheurs traitent chaque tweet comme un court document et le nettoient en supprimant le bruit (symboles superflus), en remplaçant les liens web et adresses e‑mail par des balises simples et en éliminant les mots vides qui ont peu de portée sémantique. Ils traduisent ensuite chaque mot en un vecteur numérique à l’aide d’une technique largement utilisée appelée GloVe, qui capture la façon dont les mots tendent à apparaître ensemble dans de grands corpus. En moyennant ces vecteurs de mots, chaque tweet devient un résumé numérique compact de son sens. Ces résumés sont ensuite fournis à un réseau de neurones convolutionnel unidimensionnel — un type de modèle d’apprentissage profond capable de détecter des motifs subtils — pour décider si un tweet est authentique ou constitue une rumeur.

Identifier les propagateurs clés à l’intérieur du réseau

Une fois le système capable de séparer les tweets rumeurs des tweets réels, la deuxième partie de l’approche s’intéresse à la structure du réseau social lui‑même. Chaque utilisateur est un point dans un graphe orienté et pondéré, et chaque réponse ou retweet devient un lien dont la force reflète la fréquence à laquelle un utilisateur réagit aux messages d’un autre. À partir de ces informations, les auteurs regroupent d’abord les utilisateurs en communautés — des groupes qui interagissent davantage entre eux qu’avec l’extérieur — en construisant une représentation arborescente spéciale du réseau puis en fusionnant des sous‑groupes étroitement connectés selon la qualité de leur cohésion. Au sein de ces communautés, ils calculent la fréquence à laquelle chaque utilisateur se trouve sur les chemins les plus importants entre d’autres, une mesure connue sous le nom d’intermédiarité (betweenness). Les utilisateurs qui apparaissent de façon répétée sur des chemins à haute valeur sont considérés comme des propagateurs influents. Les poids des connexions sont ensuite mis à jour pour refléter à la fois la fréquence des interactions et le degré de centralité des utilisateurs connectés, révélant les itinéraires les plus probables que les rumeurs empruntent à travers le réseau au fil du temps.

Ce que l’étude de cas Covid‑19 a révélé

Pour tester leur cadre, les chercheurs l’ont appliqué à un jeu de données massif de Twitter sur la Covid‑19 : près de 100 millions de tweets impliquant plus de 150 000 utilisateurs, dont ils ont extrait plus de 14 000 messages uniques étiquetés comme informations authentiques ou rumeurs. Sur ces données, leur modèle d’apprentissage profond a correctement classé environ 99 % des tweets, surpassant plusieurs méthodes existantes, y compris d’autres détecteurs avancés de fake news. Dans la seconde étape, ils ont comparé leur liste d’utilisateurs influents avec un modèle mathématique bien connu de propagation de l’information et ont trouvé le plus fort accord parmi les méthodes testées. Ils ont également montré que lorsqu’ils analysaient des périodes temporelles plus longues — 120, 240 puis 360 jours — la capacité du modèle à repérer les propagateurs clés et les principaux itinéraires de rumeurs s’améliorait, tout en réduisant le temps de traitement par rapport à des techniques concurrentes basées sur le réseau.

Ce que cela signifie pour la lutte contre la désinformation

En résumé, l’étude montre qu’il est possible de construire un système qui non seulement repère les fausses informations probables avec une très grande précision, mais aussi retrace leur trajet et identifie ceux qui en sont le plus responsables. Plutôt que de traiter tous les utilisateurs et toutes les connexions comme équivalents, la méthode met en évidence un ensemble restreint de communautés et d’individus dont le comportement compte le plus pour contrôler les histoires nuisibles. Bien que le travail ait été mené sur des données Twitter anonymisées concernant la Covid‑19 et ne se généralise pas nécessairement à toutes les plateformes ou à tous les sujets, il dessine une voie vers des réponses plus ciblées et fondées sur les données — par exemple en orientant la vérification des faits, les avertissements ou les interventions de plateforme là où ils auront le plus d’impact — tout en respectant la vie privée des individus et les considérations éthiques d’usage.

Citation: Zhang, W., Qian, M. & Zhang, Q. A multi-modal approach for recognizing fake news and influential nodes in spreading them using deep learning and network analysis. Sci Rep 16, 9775 (2026). https://doi.org/10.1038/s41598-026-35342-7

Mots-clés: fake news, réseaux sociaux, propagation de rumeurs, apprentissage profond, utilisateurs influents