Clear Sky Science · fr

YOLOv11n amélioré pour la détection de petits objets dans les images UAV : plus de précision avec moins de paramètres

Pourquoi repérer des objets minimes depuis le ciel compte

Les petits robots volants s’intègrent rapidement dans la vie quotidienne, de la surveillance du trafic et la gestion de secours à la livraison de colis. Mais un problème persiste : quand un drone regarde vers le bas depuis plusieurs centaines de mètres, les personnes, voitures et bateaux se réduisent à quelques pixels. Les systèmes de vision standard manquent souvent ces taches ou les confondent avec le bruit de fond. Cet article présente une version plus intelligente et plus légère d’un système de détection populaire, YOLOv11n, spécialement ajustée pour repérer ces petits objets dans les images de drone tout en restant efficace sur des ordinateurs embarqués modestes.

Voir davantage dans les détails minuscules et flous

Les images de drone constituent un environnement difficile pour les algorithmes. La plupart des cibles mesurent moins de 32×32 pixels, et beaucoup moins de 16 pixels. Le mouvement, les vibrations, les variations d’éclairage, la brume et les arrière-plans urbains chargés rendent ces cibles encore plus difficiles à distinguer. Parallèlement, les drones dépendent souvent de processeurs modestes et d’une énergie limitée, rendant les modèles lourds impraticables. Les auteurs partent de YOLOv11n, un détecteur compact en temps réel, et repensent ses composants internes pour extraire davantage d’information utile des régions petites et peu contrastées sans alourdir le modèle. Leur objectif est simple mais exigeant : améliorer significativement la précision sur les petits objets, avec autant ou moins de paramètres entraînables et une vitesse acceptable sur du matériel edge.

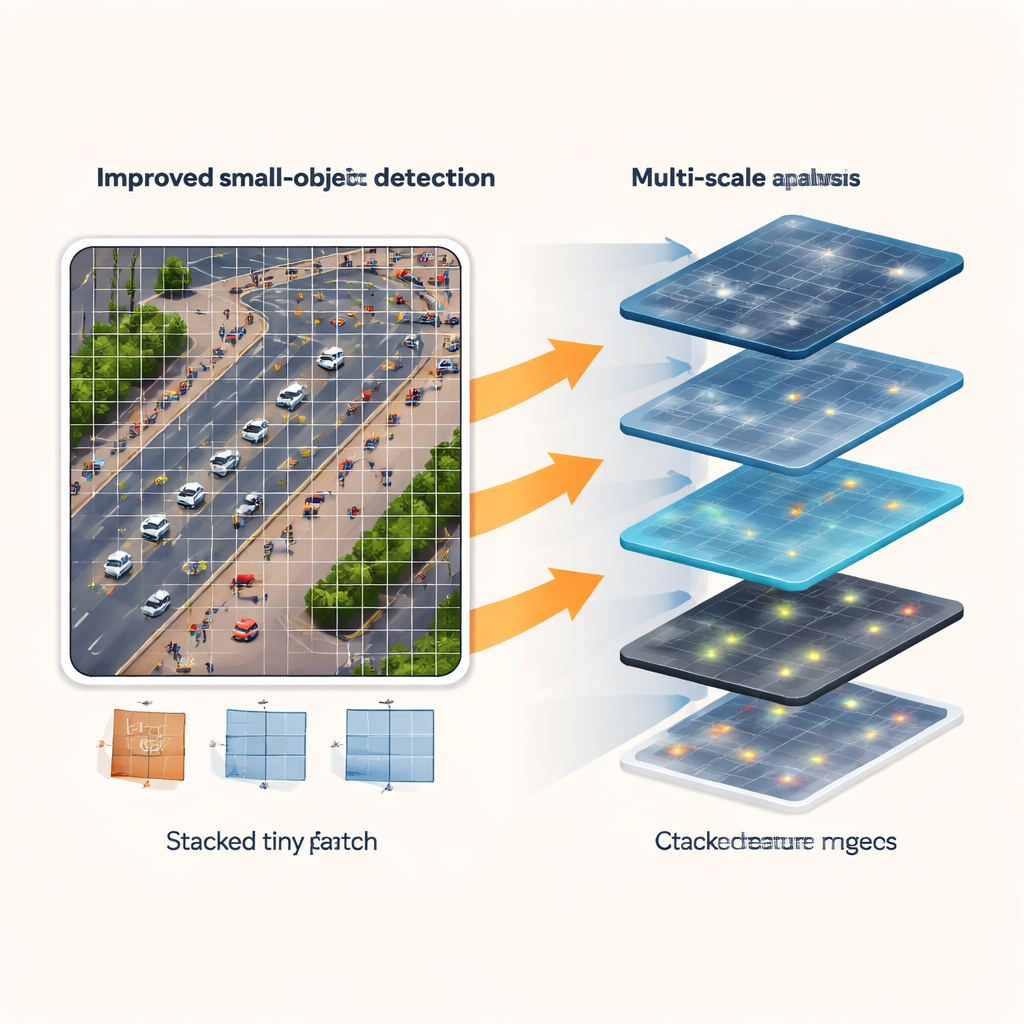

Apprendre la scène à plusieurs échelles

La première amélioration porte sur la manière dont le réseau « voit » la scène. Plutôt que d’examiner une fenêtre de taille fixe, le nouveau module Multiscale Edge-Feature Adaptive Selection (MSEAF) observe l’image simultanément à plusieurs échelles. Les vues grossières capturent l’agencement global des routes, bâtiments et foules, tandis que les vues fines suivent les voitures ou les personnes individuelles. Une étape de renforcement des contours met en avant les limites et formes que l’œil humain perçoit facilement mais qui sont souvent estompées dans de petits patchs d’image. Un mécanisme de fusion intelligent renforce ensuite les régions les plus informatives tout en supprimant le bruit d’arrière-plan. Cette représentation multi-échelle et sensible aux contours fournit au reste du réseau un point de départ plus riche pour détecter des objets difficiles à voir.

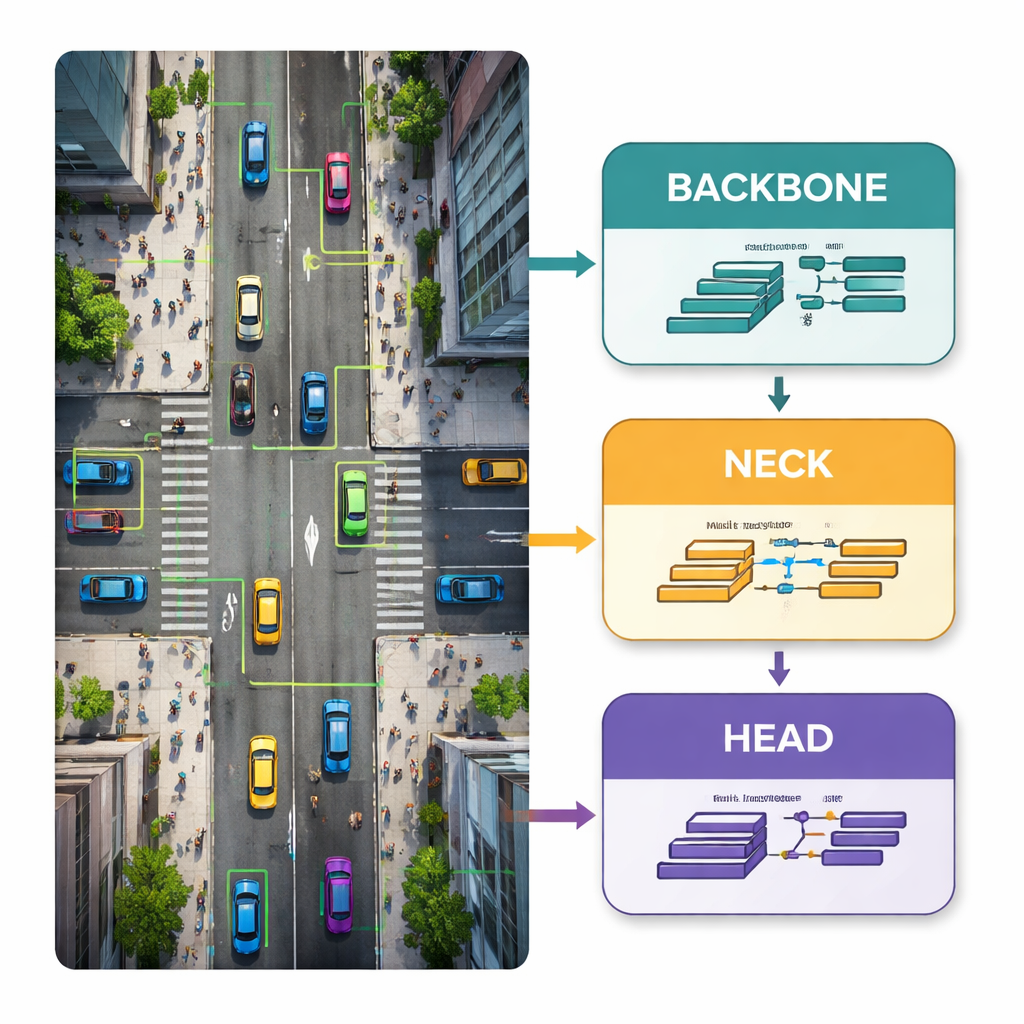

Préserver les petits objets tout au long du pipeline

Les réseaux YOLO traditionnels réduisent à plusieurs reprises les cartes de caractéristiques au fur et à mesure que l’information va de l’entrée à la sortie. Pour les objets de grande taille, cela fonctionne, mais pour les minuscules, c’est parfois fatal : après plusieurs sous-échantillonnages, un piéton peut occuper une ou deux pixels seulement sur une carte interne, voire disparaître. Pour l’éviter, les auteurs remodèlent la partie médiane « neck » du réseau et ajoutent une nouvelle tête de détection P2 qui opère sur des caractéristiques à plus haute résolution. Des modules personnalisés appelés ScalCat et Scal3DC combinent soigneusement l’information de différentes couches pour que les détails fins des couches peu profondes et le contexte plus riche des couches profondes se renforcent mutuellement. Le résultat est un détecteur qui suit petites voitures et piétons sur plusieurs échelles, au lieu de les sacrifier au profit de la vitesse.

Des décisions plus nettes avec moins de réglages

La dernière étape consiste à simplifier la phase de prédiction, connue sous le nom de tête de détection. Dans la conception d’origine, les couches profondes avec de nombreux canaux étaient surtout consacrées aux grands objets, relativement rares dans les scènes de drone. La nouvelle tête Shared Re-parameterized Detection (SRepD) égalise le nombre de canaux entre les échelles et utilise une astuce d’entraînement ingénieuse : pendant l’apprentissage, plusieurs branches convolutionnelles spécialisées explorent différentes manières de mettre en valeur les caractéristiques ; au moment de l’inférence, ces branches sont fusionnées mathématiquement en une seule convolution simple. Cette conception partagée et re-paramétrée améliore la fusion des caractéristiques tout en réduisant le nombre de paramètres et en gardant des calculs maîtrisables pour les dispositifs edge.

Ce que disent les chiffres dans des tests réels

Le modèle amélioré est évalué sur trois jeux de données publics difficiles : VisDrone2019 (scènes urbaines mixtes), TinyPerson (personnes extrêmement petites sur terre et mer) et HazyDet (véhicules dans une forte brume depuis la vue d’un drone). Sur VisDrone2019, la nouvelle conception augmente une mesure clé de précision (mAP50) et la précision de 4,6 points de pourcentage par rapport au YOLOv11n original, tout en réduisant les paramètres d’environ 8,5 %. Sur TinyPerson, les améliorations sont encore plus importantes : environ 5,9 points en mAP50 et 5,6 en précision, avec une réduction de paramètres similaire, et le modèle compact surpasse même un YOLOv11s beaucoup plus grand utilisant quatre fois plus de paramètres. En conditions brumeuses, le détecteur amélioré dépasse également la référence sur les mesures de précision et de robustesse, tout en maintenant des vitesses temps réel sur une carte edge basse consommation Huawei Atlas 200 DK.

Pourquoi c’est important pour l’usage courant des drones

Pour un public non spécialisé, la conclusion principale est que cette recherche montre qu’un drone peut devenir à la fois plus perspicace et plus économe en ressources. En repensant où et comment le réseau recherche des détails, en préservant l’information haute résolution pour les cibles minuscules et en simplifiant la mécanique de prédiction, les auteurs brisent le compromis habituel entre précision et taille. Le système obtenu détecte mieux les personnes et véhicules petits et éloignés dans des scènes encombrées, brumeuses ou complexes sans exiger de matériel volumineux. Ce type de progrès rapproche le déploiement quotidien d’une surveillance aérienne fiable et en temps réel pour la sécurité routière, la recherche et le sauvetage, et l’observation environnementale.

Citation: Zhu, H., Xie, X. Enhanced YOLOv11n for small object detection in UAV imagery: higher accuracy with fewer parameters. Sci Rep 16, 5536 (2026). https://doi.org/10.1038/s41598-026-35301-2

Mots-clés: détection d’objets par drone, reconnaissance de petits objets, réseau neuronal YOLO, analyse d’images aériennes, IA embarquée pour UAV