Clear Sky Science · fr

Modèles MobileNetV2 améliorés par attention pour une détection et une classification robustes des feux de forêt

Pourquoi des alertes incendie plus rapides comptent

Partout dans le monde, les feux de forêt deviennent plus chauds, plus étendus et plus coûteux à combattre. Quelques minutes peuvent faire la différence entre un incendie mineur contenable et une catastrophe régionale qui endommage les écosystèmes, enveloppe les villes de fumée et coûte des milliards de dollars. Cette étude explore comment des modèles compacts d’intelligence artificielle (IA) peuvent repérer les tout premiers signes de feux de forêt dans des images et des vidéos ordinaires, suffisamment vite pour fonctionner sur des drones, des caméras de surveillance et des capteurs basse consommation dispersés dans des zones vulnérables.

Surveiller les bois avec des caméras intelligentes

Les tours d’observation traditionnelles et les opérateurs humains qui scrutent des flux vidéo en direct peinent à couvrir de vastes zones forestières, surtout la nuit ou par temps de fumée et de brume. Les auteurs s’attaquent à ce problème en transformant la détection des feux de forêt en une simple question oui/non : cette image contient-elle du feu ou non ? Ils constituent un ensemble équilibré de 5 121 images montrant des scènes avec et sans feu, issues de forêts, de zones urbaines et de sites industriels, capturées de jour, de nuit et à travers la fumée ou le brouillard. En équilibrant soigneusement le jeu de données et en vérifiant manuellement les étiquettes, ils cherchent à apprendre aux systèmes d’IA à reconnaître les flammes réelles sur le terrain, et pas seulement dans des exemples idéaux de laboratoire.

Une IA légère conçue pour le terrain

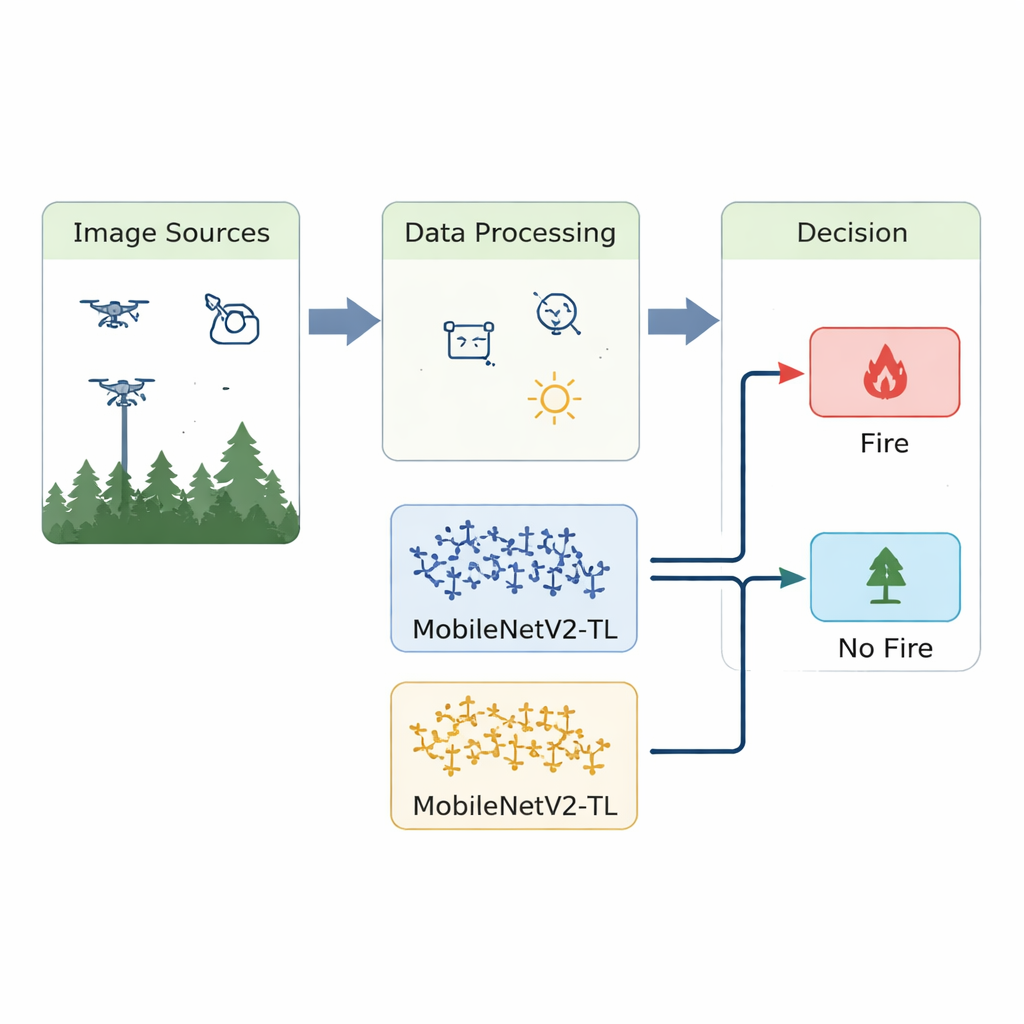

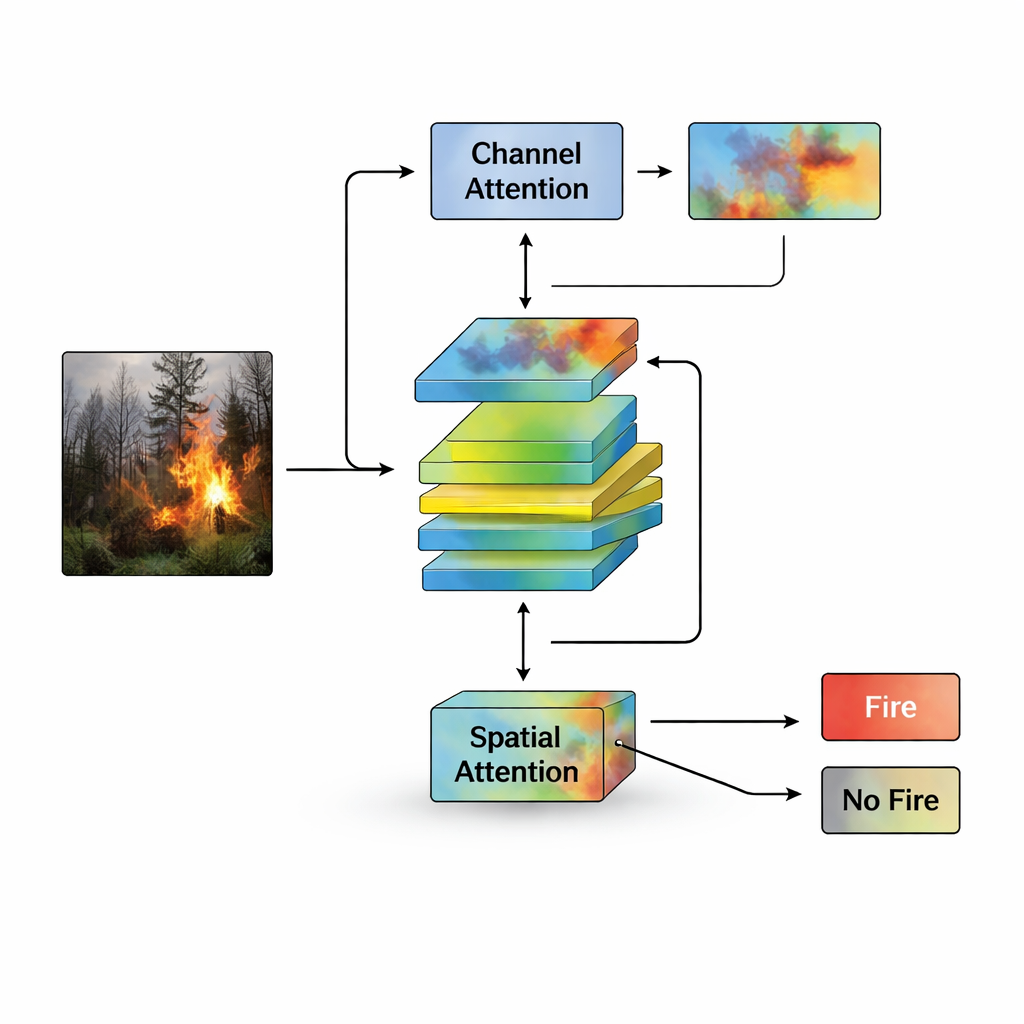

Nombreux sont les systèmes puissants de reconnaissance d’images qui sont trop lourds pour tourner sur les petits ordinateurs embarqués dans des drones ou des caméras de surveillance bon marché. Pour éviter ce problème, l’étude s’appuie sur MobileNetV2, une famille de réseaux neuronaux conçue pour être rapide et économe en mémoire. Le premier modèle, appelé Att-MobileNetV2, ajoute un mécanisme d’« attention » qui aide le réseau à se concentrer sur les couleurs, textures et contours caractéristiques des flammes tout en ignorant le désordre comme des nuages éclairés par le soleil ou des éclairages urbains intenses. Le second modèle, MobileNetV2-TL, mise sur le transfert d’apprentissage : il réutilise des compétences visuelles acquises à partir de millions de photos générales et n’entraîne qu’une petite tête spécifique à la tâche pour distinguer feu et non-feu, réduisant temps de traitement et consommation d’énergie.

Entraînement pour des conditions réelles difficiles

Pour reproduire les conditions chaotiques de la surveillance des incendies, les chercheurs ne se contentent pas de collecter des images variées. Ils appliquent aussi des ajustements contrôlés à chaque image d’entraînement — petites rotations, retournements, modifications de luminosité ou de contraste — pour simuler différents angles de caméra et éclairages. Les deux modèles sont ensuite entraînés et évalués selon les mêmes règles, en utilisant des mesures standards comme la précision (accuracy), la précision positive (precision) et le rappel (recall), et en vérifiant la fréquence des feux manqués ou des fausses alertes. Att-MobileNetV2 atteint une précision d’environ 99,6 %, tandis que MobileNetV2-TL atteint environ 98,4 %. Fait crucial, ces résultats sont obtenus avec seulement quelques millions de paramètres et une fraction d’un milliard d’opérations par image, permettant des décisions en seulement 10–12 millisecondes sur un seul processeur graphique.

Dépassement des systèmes plus volumineux avec moins de ressources

Les deux modèles compacts sont comparés à des méthodes classiques d’apprentissage automatique ainsi qu’à des réseaux profonds plus complexes. Dans des conditions d’entraînement et de test identiques, Att-MobileNetV2 offre le meilleur compromis global entre détection correcte des feux et décisions « tout clair » correctes, tandis que MobileNetV2-TL affiche un rappel particulièrement élevé, ce qui signifie qu’il néglige rarement des feux réels — une propriété importante pour des systèmes d’alerte précoce. Un ensemble combinant les deux modèles fait encore un peu mieux, suggérant que leurs manières « de voir » une scène sont complémentaires. Des tests sur un jeu de données public indépendant montrent que les modèles conservent de bonnes performances sur de nouvelles images, indiquant qu’ils généralisent au-delà des images spécifiques sur lesquelles ils ont été entraînés.

Ce que cela signifie pour la sécurité incendie future

En termes simples, ce travail montre que de petits modèles d’IA efficaces peuvent repérer les feux de forêt tôt et de manière fiable, même lorsqu’ils tournent sur du matériel modeste monté sur des drones, des tours ou des caméras routières. En utilisant l’attention pour se focaliser sur les bonnes parties d’une image et le transfert d’apprentissage pour réutiliser des connaissances visuelles antérieures, les systèmes proposés atteignent des niveaux de précision qui rivalisent avec, voire surpassent, des modèles beaucoup plus lourds. Bien que des défis subsistent dans la brume la plus dense, l’approche ouvre la voie à des réseaux de capteurs intelligents et abordables qui pourraient déclencher des alertes plus tôt, aidant les pompiers à intervenir plus vite et potentiellement empêchant de petites étincelles de devenir des feux dévastateurs.

Citation: Ul Haq, I., Husnain, G., Iqbal, A. et al. Attention-enhanced MobileNetV2 models for robust forest fire detection and classification. Sci Rep 16, 4805 (2026). https://doi.org/10.1038/s41598-026-35207-z

Mots-clés: détection des feux de forêt, surveillance des incendies, apprentissage profond, IA embarquée, vision par ordinateur