Clear Sky Science · fr

Suivi des communautés évolutives dans les cascades de fausses informations à l’aide de graphes temporels

Pourquoi les rumeurs en ligne se propagent au sein de groupes soudés

Lorsque des histoires fausses circulent rapidement sur les réseaux sociaux, elles voyagent rarement seules. Elles sont plutôt poussées, partagées et répétées par des grappes d’utilisateurs qui agissent de concert. Cette étude pose une question simple mais cruciale : peut-on suivre la formation et l’évolution de ces groupes en ligne au fil du temps, et utiliser ces connaissances pour ralentir la propagation des fausses informations — sans même lire le contenu des messages ?

Suivre les trajectoires des récits trompeurs

Les auteurs se concentrent sur les « cascades d’information » sur des plateformes comme Twitter — des chaînes de retweets et de réponses qui se déroulent après la diffusion d’une histoire. Plutôt que de considérer les utilisateurs comme des individus isolés, ils examinent comment les personnes se regroupent en communautés à mesure qu’une rumeur se propage. Ces communautés peuvent être des promoteurs dévoués de l’histoire fausse, des commentateurs sceptiques ou des observateurs ordinaires entraînés malgré eux. Le défi tient au fait que les foules en ligne changent constamment : des personnes entrent et sortent, les conversations se scindent et fusionnent, et la structure du réseau évolue d’heure en heure.

Un cadre étape par étape pour suivre les communautés

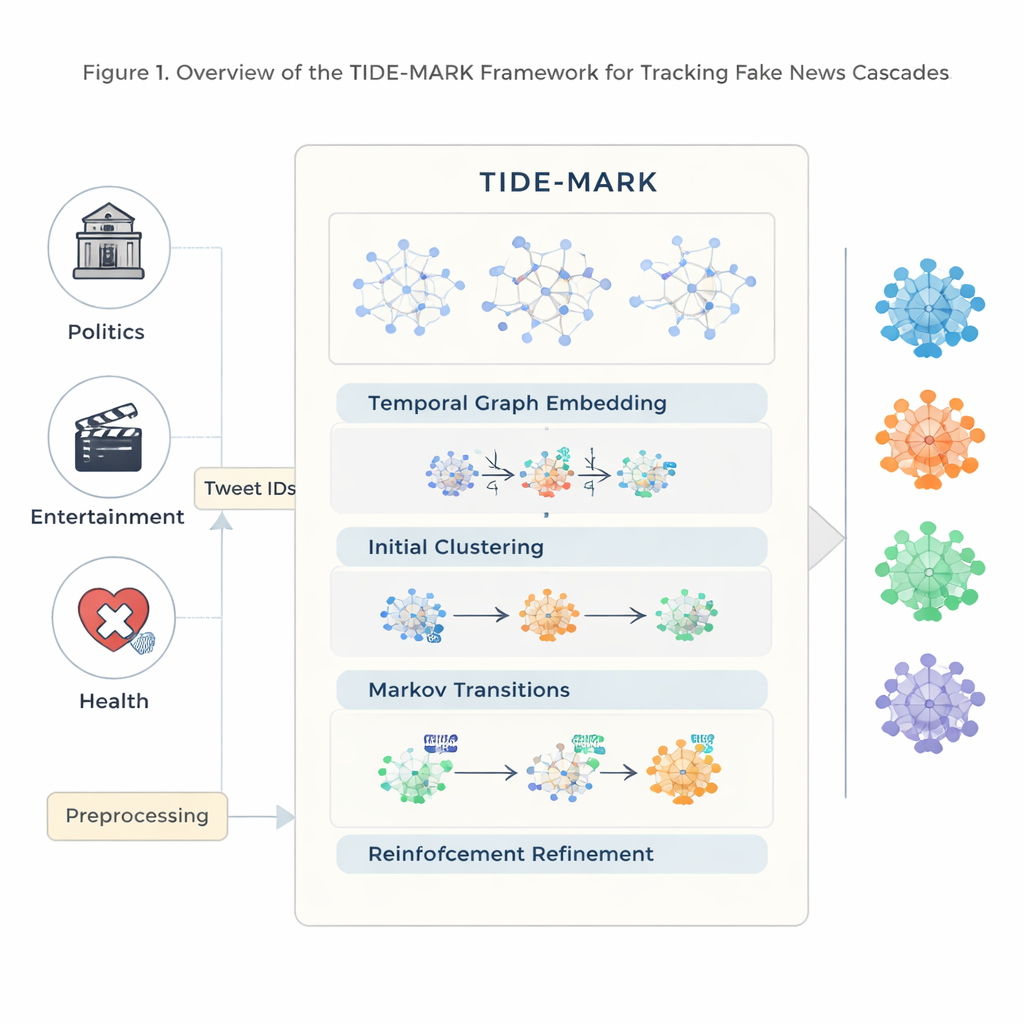

Pour répondre à ce défi, les auteurs présentent TIDE-MARK, un cadre en plusieurs étapes conçu pour suivre les communautés d’utilisateurs en évolution au fil du temps. D’abord, ils reconstruisent chaque cascade à partir des identifiants bruts de tweets, la transformant en une série d’instantanés horaires où les nœuds représentent des utilisateurs et les liens des retweets ou des réponses. Ils enrichissent chaque utilisateur par des informations de profil simples et un résumé numérique des tweets qu’il partage. Ensuite, un réseau neuronal prenant en compte le facteur temps apprend comment les connexions et le comportement de chaque utilisateur évoluent à travers les instantanés, produisant une « empreinte » compacte pour chaque utilisateur à chaque heure.

Des foules floues à des groupes stables

À partir de ces empreintes, TIDE-MARK regroupe les utilisateurs similaires en communautés préliminaires. Il modélise ensuite comment les communautés changent d’un instantané au suivant, estimant la probabilité que des membres d’un groupe restent ensemble, se scindent ou rejoignent un autre groupe. Enfin, un module d’apprentissage par renforcement affine les frontières floues entre communautés. Il teste de manière itérative de petits changements — déplacer des utilisateurs individuels d’une communauté à une autre — et conserve ceux qui rendent les groupes plus fortement connectés en interne tout en restant cohérents avec les étapes temporelles précédentes. Le résultat est une image plus claire et plus stable de qui se coordonne avec qui au fur et à mesure du déroulement de la cascade.

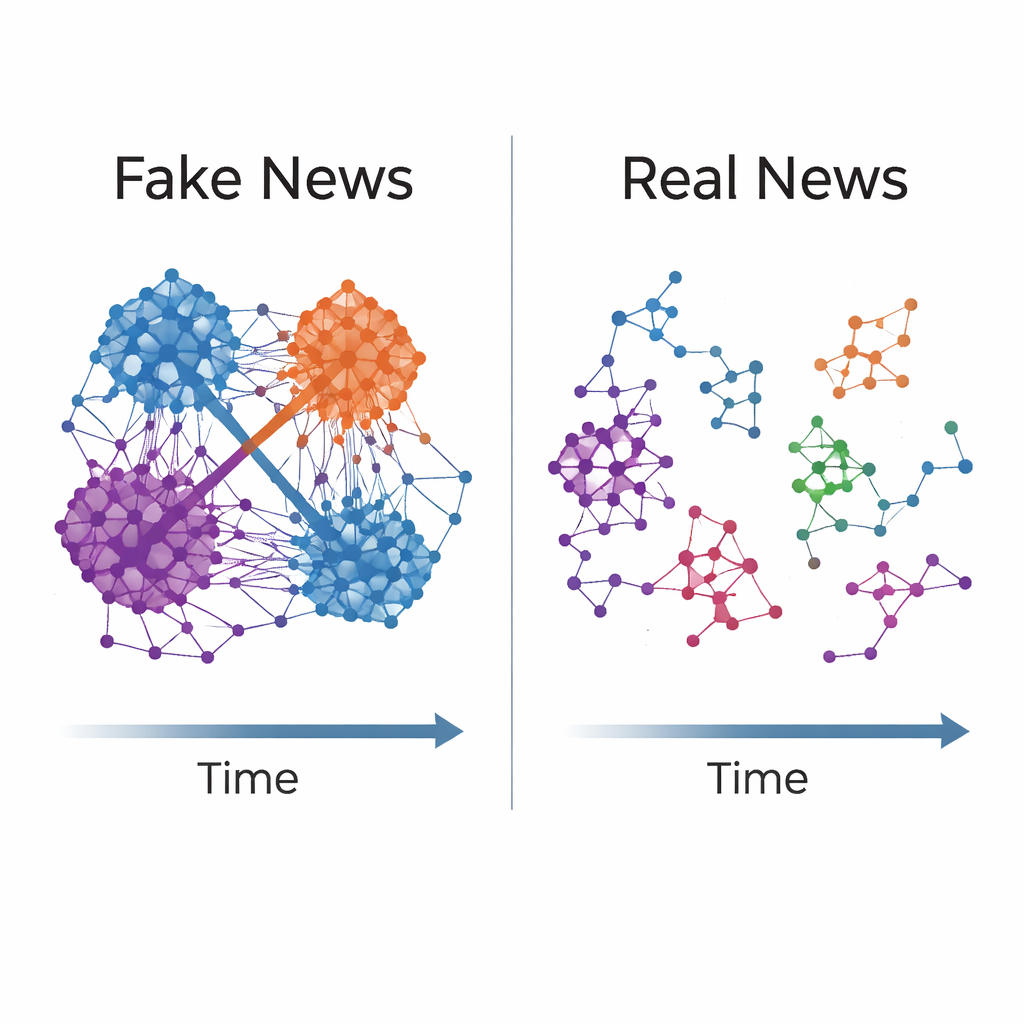

À quoi ressemblent les communautés de fausses et de vraies informations

L’équipe applique TIDE-MARK à trois grands ensembles de données de fausses informations couvrant la politique, les potins de célébrités et les informations sanitaires sur le COVID-19. Dans tous ces cas, ils observent le même schéma : les histoires fausses ont tendance à circuler au sein de communautés plus resserrées et plus persistantes que les histoires vraies. Ces groupes propageant de fausses nouvelles sont plus densément connectés en leur sein, présentent des frontières plus nettes avec le reste du réseau et conservent globalement la même composition au fil du temps. En revanche, les vraies informations se diffusent via des groupes plus lâches et plus dispersés qui se reconfigurent au fur et à mesure que les discussions évoluent. Fait notable, les caractéristiques structurelles extraites par TIDE-MARK — la cohésion et la stabilité des communautés — suffisent à aider de simples classifieurs à distinguer les cascades fausses des cascades vraies, même sans analyser le texte.

Tester des moyens de perturber les cascades nuisibles

Parce que TIDE-MARK fournit une vue au niveau des communautés, il peut aussi servir à simuler des interventions. Les chercheurs testent ce qui se passe si, tôt dans une cascade de fausses informations, on retire seulement quelques utilisateurs fortement connectés de la communauté la plus persistante — une représentation idéalisée de la suspension de comptes ou de la limitation de leur portée. Dans les simulations, cette suppression ciblée affaiblit nettement la structure de la cascade et réduit son plus grand composant connecté, ce qui suggère que des stratégies neutres vis-à-vis du contenu mais conscientes de la structure pourraient ralentir de manière significative la propagation de la désinformation.

Ce que cela implique pour la lutte contre la désinformation

Concrètement, ce travail montre que les fausses informations circulent souvent via des « fan-clubs » durables d’utilisateurs coordonnés, tandis que les vraies informations se déplacent dans des foules plus fluides. TIDE-MARK offre un moyen d’identifier et de suivre ces groupes en temps réel, sans lire ni juger le contenu lui-même. Cela en fait un outil prometteur pour les plateformes, les chercheurs et les décideurs qui souhaitent repérer des schémas risqués de coordination et concevoir des interventions ciblées et mesurées — potentiellement pour désamorcer des cascades nuisibles avant qu’elles ne prennent pleinement de l’ampleur.

Citation: Ma, Y., Qu, D. & Wang, Y. Tracking evolving communities in fake news cascades using temporal graphs. Sci Rep 16, 4952 (2026). https://doi.org/10.1038/s41598-026-35175-4

Mots-clés: fausses informations, réseaux sociaux, détection de communautés, propagation de la désinformation, modération des réseaux sociaux