Clear Sky Science · fr

Une étude sur la conception et l’évaluation multimodale d’interfaces intuitives pour des systèmes d’information complexes en coopération homme/robot

Pourquoi des écrans plus intelligents comptent dans les missions à haute pression

Les missions militaires modernes reposent de plus en plus sur des équipes d’aéronefs habités travaillant aux côtés d’essaims de drones. Les commandants doivent trier en quelques secondes des écrans radar et des panneaux d’état surchargés, où la confusion peut conduire à manquer une menace ou à commettre des frappes fratricides. Cette étude pose une question simple aux implications majeures : si nous repensons ces écrans complexes pour qu’ils paraissent plus « évidents » d’un coup d’œil — en utilisant des images, la couleur et le mouvement plutôt que des textes denses — les personnes peuvent‑elles penser plus vite, rester plus calmes et prendre néanmoins la bonne décision ?

Transformer les intuitions en conception d’écran

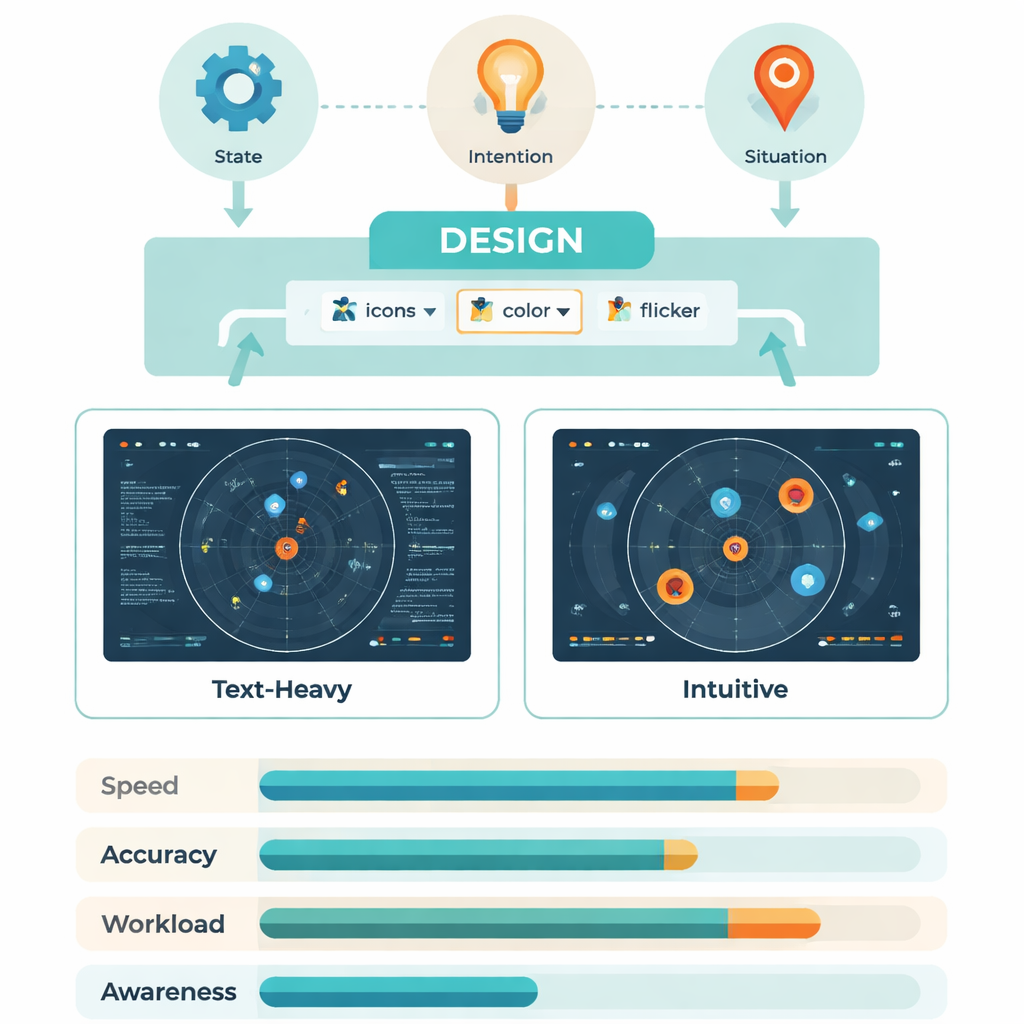

Les chercheurs s’appuient sur l’idée d’« interaction intuitive » : la manière dont nous comprenons automatiquement qu’un voyant rouge signifie danger ou qu’une chaîne rompue indique une connexion perdue. La psychologie et la recherche en facteurs humains suggèrent que ces schémas intégrés — réflexes corporels, symboles du quotidien et icônes familières — peuvent être exploités pour que les utilisateurs n’aient pas à décoder consciemment chaque information. Dans ce projet, ces principes sont appliqués à des écrans de gestion de bataille qui montrent trois types d’information principaux : quels cibles et armements sont présents (état), ce que les drones s’apprêtent à faire (intention) et comment le combat évolue globalement (situation). En mappant chacun de ces éléments sur des formes simples, des couleurs et du mouvement, l’équipe visait à créer des affichages qui « s’expliquent d’eux‑mêmes » dès leur apparition.

Des croquis d’experts aux écrans opérationnels

La conception d’une telle interface n’a pas été laissée au hasard. L’équipe a d’abord interrogé des opérateurs expérimentés et des concepteurs de système, demandant, par exemple, « Quel type de symbole vous permet de reconnaître un drone brouilleur sans y réfléchir ? » À partir de ces sessions, ils ont distillé des mots‑clés comme œil, vague, chaîne et zone, puis les ont transformés en jeux d’icônes grossiers. Un second groupe d’experts a ensuite testé ces prototypes en pensant à voix haute. Tout symbole mal compris par n’importe qui a été révisé jusqu’à ce que chaque élément puisse être lu instantanément. L’interface finale utilisait des silhouettes d’avions au lieu d’étiquettes textuelles, la luminosité pour indiquer le niveau de menace, des surlignages scintillants pour marquer la position future d’un drone, des réticules ou des lignes ondulées pour signaler des attaques ou du brouillage, et de petits marqueurs locaux sous chaque cible pour montrer si elle était entrée dans une plage critique.

Tester les écrans intuitifs

Pour vérifier si ces idées fonctionnaient en pratique, 30 membres du personnel de l’Armée de l’air formés se sont assis à une console de commandement simulée et ont parcouru des tâches de champ de bataille factices. Parfois ils utilisaient un affichage traditionnel chargé en texte ; d’autres fois ils utilisaient la nouvelle version intuitive, avec une mise en page et des couleurs soigneusement appariées de sorte que seule la façon dont l’information était codée différait. Pendant qu’ils cherchaient des drones spécifiques, des missiles, des niveaux de menace, des pertes de liaison ou des cibles à portée, le système enregistrait la rapidité et la précision de leurs réponses, où leurs yeux se déplaçaient et comment leur cerveau réagissait via des signaux EEG liés à la charge mentale. Ensuite, les participants ont évalué la difficulté perçue des tâches sur l’échelle de charge de travail bien connue NASA‑TLX.

Des yeux plus rapides, un cerveau plus léger

Les écrans intuitifs ont constamment aidé en charge d’information faible à modérée. Les opérateurs ont répondu plus rapidement — souvent des centaines de millisecondes de gagnées par requête — et ont eu besoin de moins de fixations et de sauts oculaires pour trouver l’élément approprié. Les indices dynamiques comme un léger scintillement se sont révélés particulièrement efficaces pour mettre en évidence la position future d’un drone, tandis que des symboles largement compris (comme des réticules pour l’attaque) ont surpassé des codes professionnels plus obscurs pour décrire des actions à venir. Les mesures d’ondes cérébrales racontent la même histoire : un signal clé appelé P300, qui augmente avec l’effort et le délai de traitement, était plus faible et survenait plus tôt avec les affichages intuitifs, montrant que le cerveau travaillait plus efficacement. Pour les tâches denses à charge élevée, l’avantage diminuait, ce qui suggère qu’aucune interface ne peut totalement annuler une complexité extrême.

Ce que cela signifie pour les personnes en boucle

Dans un test de suivi sur une version optimisée de l’interface intuitive, un nouveau groupe d’opérateurs a montré une meilleure conscience situationnelle, une efficacité supérieure et une fatigue mentale déclarée plus faible sur tous les plans par rapport à la mise en page traditionnelle. En termes simples, en transformant des chiffres et du jargon en images claires, codes couleur et mouvements alignés sur l’expérience quotidienne, le système a permis aux personnes de repérer plus rapidement les menaces et les opportunités avec moins de fatigue mentale. Bien que le travail ait été réalisé en laboratoire avec un groupe d’utilisateurs restreint, il offre une recette concrète pour concevoir les salles de contrôle futures — militaires ou civiles — où les opérateurs humains doivent suivre le rythme des machines intelligentes sans être submergés.

Citation: Qu, J., Chen, S., Dang, S. et al. A study on design and multimodal evaluation of intuitive interfaces for complex information systems in manned/unmanned cooperation. Sci Rep 16, 4746 (2026). https://doi.org/10.1038/s41598-026-35017-3

Mots-clés: interfaces intuitives, coopération homme‑machine, conscience situationnelle, suivi oculaire et EEG, coopération homme‑non‑habité