Clear Sky Science · fr

Développement et évaluation de systèmes de questions‑réponses agricoles basés sur de grands modèles de langage

Réponses intelligentes pour produire des aliments

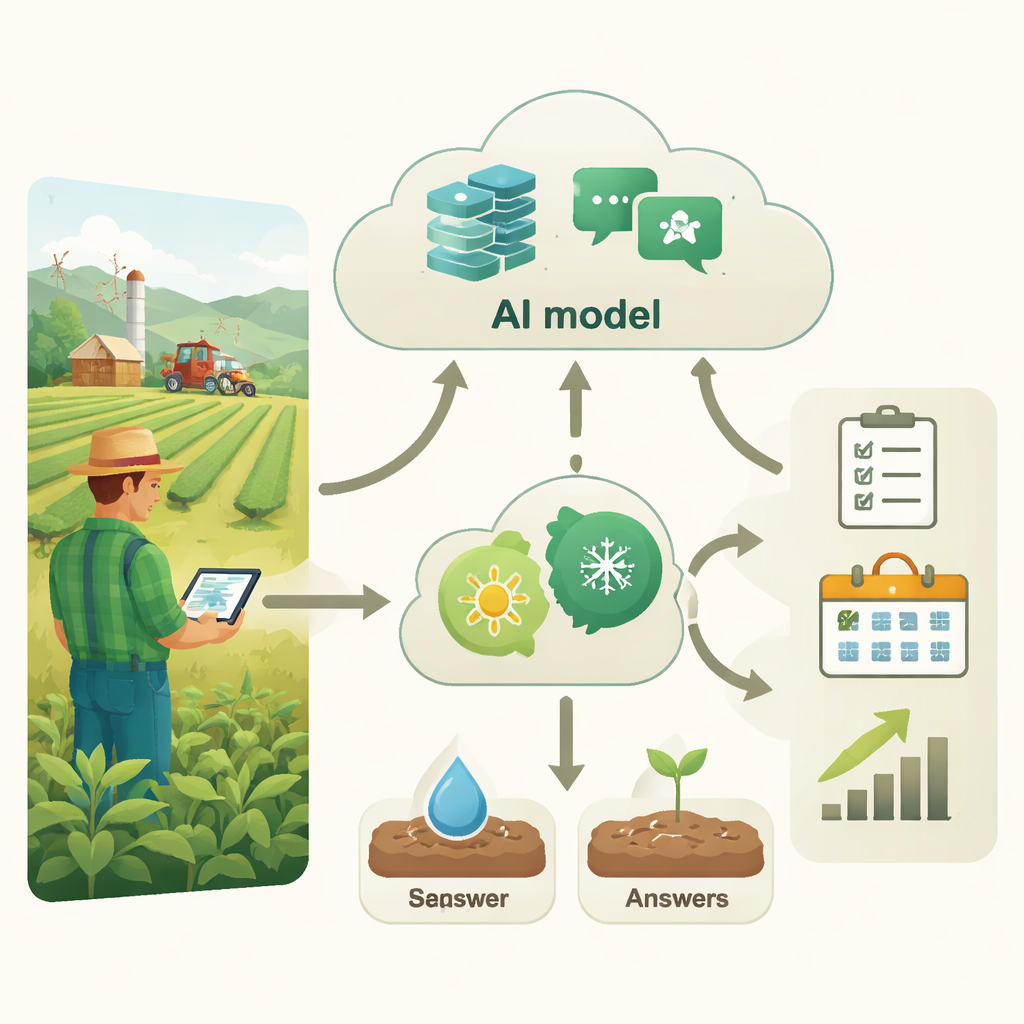

Les agriculteurs et les experts agricoles prennent chaque jour des décisions sur ce qu’il faut planter, comment irriguer et comment protéger les cultures. Obtenir rapidement de bons conseils peut faire la différence entre une récolte saine et un échec coûteux. Cet article explore comment des outils d’IA modernes, appelés grands modèles de langage, peuvent alimenter des systèmes de questions‑réponses pour l’agriculture, transformant des questions en langage courant en recommandations pratiques pour le terrain.

Pourquoi les exploitations ont besoin de meilleurs outils numériques

L’agriculture devient de plus en plus fondée sur les données, des images satellites aux capteurs de sol. Pourtant, de nombreux experts et techniciens peinent encore à accéder à des informations fiables et faciles à comprendre quand ils en ont besoin. Les systèmes d’IA traditionnels exigent souvent d’énormes jeux de données étiquetés, des ordinateurs puissants et des programmeurs spécialisés. En revanche, les grands modèles de langage — entraînés sur d’immenses collections de textes — peuvent répondre à des questions, résumer des informations et raisonner sur des problèmes avec bien moins de données spécifiques à la tâche. Cela en fait des outils attractifs pour les agriculteurs, les conseillers et les services de vulgarisation qui recherchent un soutien rapide et peu coûteux.

Construire une machine de réponses agricoles

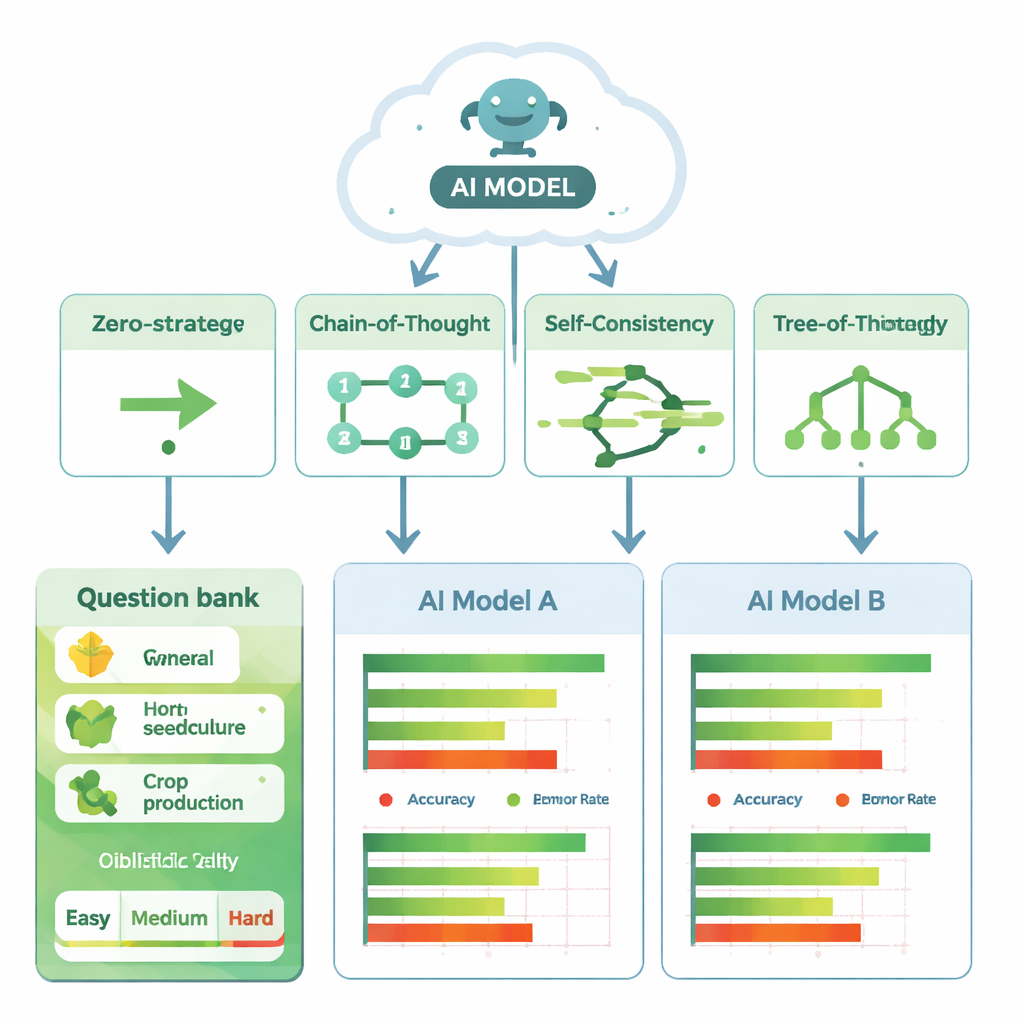

Pour évaluer l’efficacité de ces modèles en pratique, les auteurs ont créé un système de questions‑réponses agricoles baptisé AgriQAs. Ils ont rassemblé 90 questions à choix multiple provenant de sources agricoles fiables, couvrant trois domaines : agriculture générale, horticulture et production de cultures. Chaque thème comprenait des questions faciles, moyennes et difficiles, allant de définitions simples à des problèmes nécessitant plusieurs étapes de raisonnement. Deux modèles de langage de premier plan ont été testés : l’un d’OpenAI (GPT‑4o) et l’autre de Google (Gemini‑2.0‑flash). Pour chaque question, les deux modèles devaient choisir la bonne option parmi quatre réponses, comme le ferait un candidat à un examen.

Apprendre à l’IA à raisonner sur les problèmes agricoles

Poser simplement une question à un modèle ne produit pas toujours la meilleure réponse. La manière dont la question est formulée — le « prompt » — peut fortement influencer le résultat. Les chercheurs ont comparé quatre styles d’invite. Dans le plus simple, appelé Zero‑Shot, le modèle se voyait seulement présenter la question et invité à choisir une option. Dans Chain‑of‑Thought, on lui demandait de montrer un raisonnement étape par étape. Self‑Consistency faisait générer au modèle plusieurs raisonnements puis choisir la réponse la plus cohérente. Tree‑of‑Thought l’encourageait à explorer plusieurs pistes de solution avant de trancher. L’équipe a également utilisé un outil automatique de conception de prompts pour affiner la formulation des instructions, renforçant le « rôle » du modèle en tant qu’expert agricole et clarifiant la façon dont il devait raisonner.

Quelle performance pour ces conseillers IA ?

Sur l’ensemble des questions, les deux modèles ont obtenu des résultats surprenamment bons, mais les performances dépendaient fortement du style de prompt. GPT‑4o a atteint des précisions d’environ 85 % à 95 %, tandis que Gemini‑2.0‑flash variait entre environ 75 % et 88 %. Les résultats les plus faibles pour les deux modèles provenaient du style Zero‑Shot, qui offre peu d’orientation sur le raisonnement. Les meilleurs résultats reposaient sur des modes de pensée plus structurés : Self‑Consistency a donné à GPT‑4o ses meilleurs scores, et Tree‑of‑Thought a été le plus efficace pour Gemini‑2.0‑flash. Les erreurs étaient les plus fréquentes sur les questions les plus difficiles et dans la catégorie production de cultures, qui exige souvent des décisions détaillées en plusieurs étapes. Les auteurs sont allés au‑delà des moyennes simples en utilisant des tests statistiques formels pour confirmer que les différences entre méthodes de prompt et modèles étaient réelles et non dues au hasard.

Quelles implications pour l’agriculture de demain

Pour les non‑spécialistes, le message clé est que « comment on demande » compte presque autant que « à qui on demande » lorsqu’on travaille avec l’IA. Avec des prompts soigneusement conçus, les grands modèles de langage peuvent servir d’assistants puissants pour les ingénieurs et techniciens agricoles, offrant des conseils rapides et raisonnablement précis sans entraînement personnalisé pour chaque nouveau problème. Les auteurs soulignent toutefois que ces systèmes doivent être utilisés de manière responsable : des réponses biaisées ou incorrectes pourraient induire les agriculteurs en erreur et causer des pertes économiques. Au fur et à mesure que des travaux futurs intègreront des données régionales, des informations de capteurs et des orientations plus claires d’experts humains, des outils comme AgriQAs pourraient devenir des compagnons quotidiens dans une agriculture durable et high‑tech — aidant les producteurs à prendre de meilleures décisions tout en préservant les ressources.

Citation: Eldem, A., Eldem, H. The development and evaluation of agricultural question-answering systems based on large language models. Sci Rep 16, 5357 (2026). https://doi.org/10.1038/s41598-026-35003-9

Mots-clés: IA agricole, questions‑réponses, grands modèles de langage, conception de prompts, agriculture numérique