Clear Sky Science · fr

Segmentation précise d'objets sous‑marins en temps réel grâce à YOLOv11‑UOS dual‑domaine amélioré avec amélioration adaptative guidée par la physique et renforcement par attention

Plonger plus profond avec des yeux numériques plus nets

Nos océans sont explorés de plus en plus non seulement par des plongeurs et des sous‑marins, mais aussi par des caméras intelligentes embarquées sur des robots sous‑marins. Ces caméras aident à rechercher des épaves, inspecter des pipelines en mer et surveiller les récifs coralliens et les populations de poissons. Pourtant, les images sous‑marines sont souvent troubles, teintées de bleu‑vert et pleines d’éléments visuels parasites, ce qui rend difficile, même pour des humains — et a fortiori pour des ordinateurs — l’identification des objets. Cet article présente un nouveau système de vision par ordinateur qui nettoie les images sous‑marines puis détecte et trace les objets qu’elles contiennent, assez rapidement pour guider des missions robotiques en temps réel.

Pourquoi voir sous l'eau est si difficile

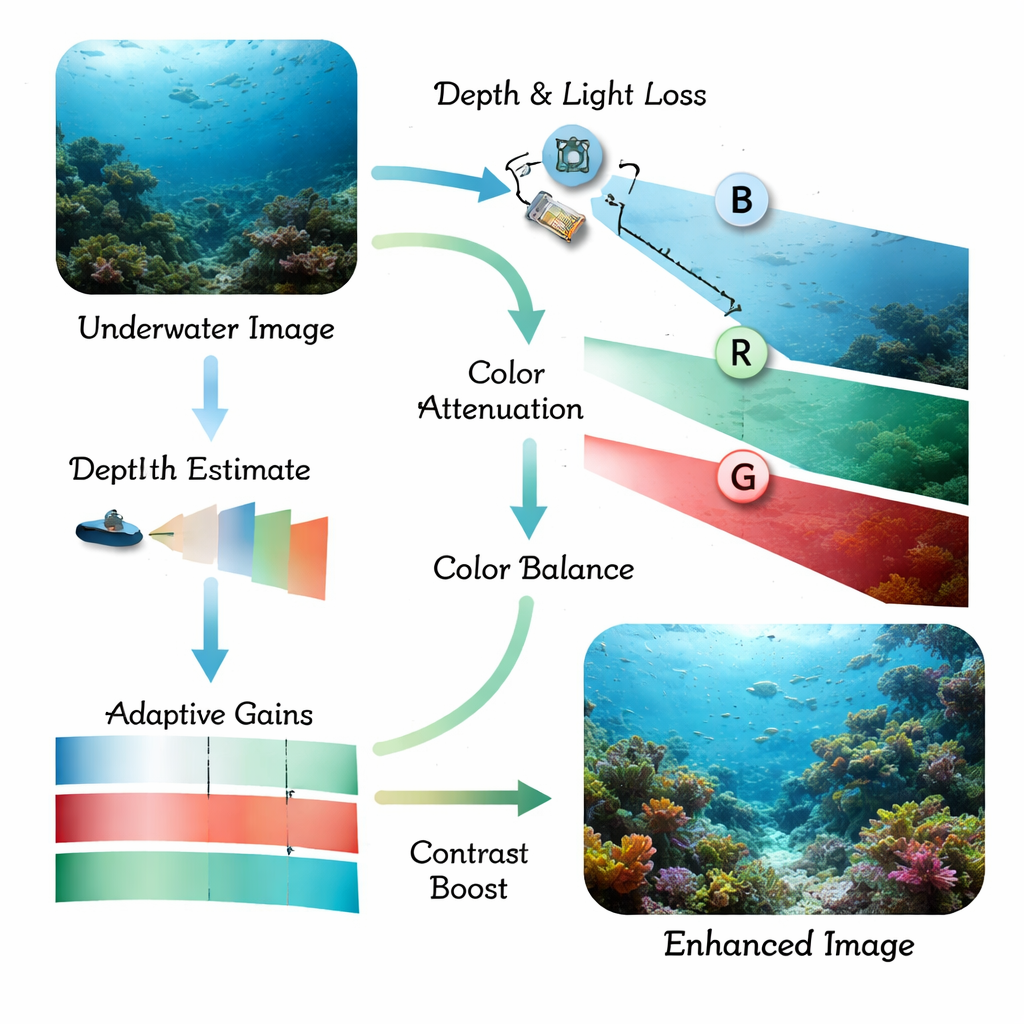

La lumière se comporte très différemment dans l’eau que dans l’air. À mesure que la lumière du soleil pénètre, les tons rouges disparaissent en premier, puis les verts, laissant une dominante bleutée et des scènes peu contrastées. De minuscules particules en suspension diffusent la lumière, créant une brume qui floute les contours et cache les petits détails. Les programmes classiques de détection d’objets, et même les modèles modernes d’apprentissage profond, peinent avec ces images déformées : les poissons se confondent avec le corail, les structures artificielles s’effacent dans l’arrière‑plan et les scènes peu éclairées deviennent presque illisibles. Les travaux antérieurs traitaient généralement soit l’amélioration d’image, soit la détection d’objets, ce qui rendait souvent le système final trop lent, trop fragile ou encore aveugle dans des eaux particulièrement troubles.

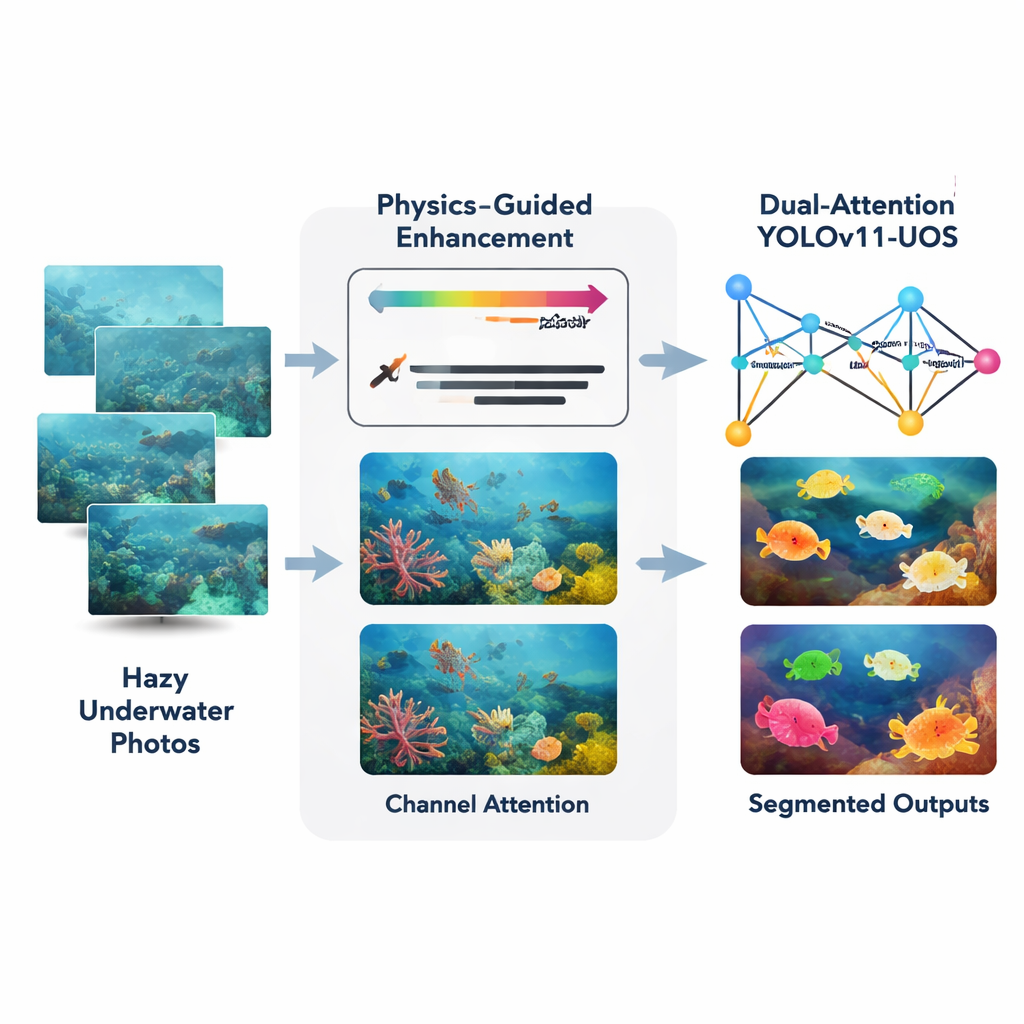

Une stratégie en deux étapes : nettoyer puis se concentrer

Les auteurs proposent une approche combinée centrée sur un détecteur temps réel récent nommé YOLOv11, adapté ici aux scènes sous‑marines et à la segmentation d’instances (traçage précis du contour de chaque objet). D’abord, un module frontal appelé Amélioration Adaptative Guidée par la Physique prend les photos brutes sous‑marines et les corrige à l’aide d’un modèle physique simplifié de l’absorption et de la diffusion de la lumière dans l’eau. Il estime la distance de chaque zone de la scène par rapport à la caméra, puis compense la perte plus forte du rouge comparée au vert et au bleu. Cela restaure des couleurs plus naturelles et augmente le contraste local, tandis qu’une étape soignée basée sur l’histogramme aiguise les contours sans amplifier le bruit, même dans les zones sombres ou turbides.

Apprendre au réseau où regarder

Une fois l’image nettoyée, elle est transmise à une architecture YOLOv11 améliorée, équipée de mécanismes d’attention. Ces modules supplémentaires agissent un peu comme un projecteur et un filtre de couleur. L’attention spatiale indique au réseau de prêter davantage attention aux régions importantes — comme le contour d’un poisson ou le bord d’un artefact immergé — et d’ignorer les arrière‑plans distrayants tels que le sable ou les plantes qui bougent. L’attention par canal ajuste la pondération des différents motifs de couleur et de texture, de sorte que les indices visuels utiles sont mis en valeur tandis que les éléments non pertinents sont atténués. Ensemble, ces deux étapes d’attention aident le réseau à construire des représentations internes plus nettes avant de décider où se trouvent les objets et ce qu’ils sont.

Tests en océans réels et conditions difficiles

Pour évaluer les performances du système en conditions réelles, les chercheurs l’ont entraîné et testé sur plusieurs collections d’images sous‑marines publiques ainsi que sur un nouveau jeu de données personnalisé de plus de 7 000 photos annotées provenant d’eaux côtières de profondeurs et de turbidités variées. Ils ont mesuré les scores standards de détection et de segmentation et comparé leur méthode à des modèles largement utilisés tels que U‑Net, DeepLab, des segmentateurs basés sur des transformeurs et une version de référence de YOLOv11 dépourvue des nouveaux modules. La conception combinée amélioration‑plus‑attention a amélioré la précision moyenne de détection d’environ 6,5 points de pourcentage par rapport au YOLOv11 de base, avec des contours d’objets visiblement plus propres et moins d’objets manqués ou faussement détectés. Fait important, le système fonctionne toujours à environ 38 images par seconde sur un processeur graphique moderne, assez rapide pour un usage quasi temps réel sur des plateformes robotiques.

Ce que cela signifie pour les robots océaniques et la recherche

Concrètement, l’étude montre qu’un prétraitement intelligent et une attention ciblée permettent aux ordinateurs de « voir » bien mieux sous l’eau. En annulant d’abord certains effets physiques qui dégradent les photos sous‑marines, puis en guidant le réseau de détection pour qu’il se concentre sur les régions et les couleurs les plus informatives, la méthode fournit des contours plus nets et plus fiables pour les poissons, le corail et les structures artificielles. Cela peut aider les véhicules autonomes sous‑marins à naviguer en sécurité, surveiller des écosystèmes marins fragiles et inspecter des infrastructures sous‑marines critiques sans supervision humaine. Des défis subsistent dans des eaux extrêmement boueuses ou en très grande profondeur, où la lumière rouge fait presque totalement défaut, mais le cadre proposé constitue une avancée pratique vers une vision sous‑marine robuste et temps réel, capable de soutenir de futures cartographies 3D et des explorations multi‑capteurs de l’océan.

Citation: Deluxni, N., Sudhakaran, P., Alroobaea, R. et al. An accurate realtime underwater object segmentation using improved dual-domain YOLOv11-UOS with physics guided adaptive enhancement and attention-boosting. Sci Rep 16, 4804 (2026). https://doi.org/10.1038/s41598-026-35001-x

Mots-clés: vision sous‑marine, robotique marine, amélioration d'image, segmentation d'objets, vision par ordinateur