Clear Sky Science · fr

Examiner la dépendance humaine à l’intelligence artificielle dans la prise de décision

Pourquoi notre confiance dans les machines intelligentes compte

Des recommandations de films au tri des candidatures en passant par la justice pénale, l’intelligence artificielle (IA) aide de plus en plus les humains à prendre des décisions. Beaucoup supposent que les ordinateurs sont moins biaisés et plus précis que les personnes. Mais que se passe-t-il réellement lorsque des gens reçoivent un conseil émanant d’un système d’IA : l’utilisent-ils judicieusement ou s’y fient-ils trop ? Cette étude explore la manière dont les gens réagissent aux recommandations d’une IA comparativement à celles d’autres humains, et ce que cela implique pour le rôle croissant de l’IA dans les décisions quotidiennes.

Tester de vraies personnes avec des visages vrais et faux

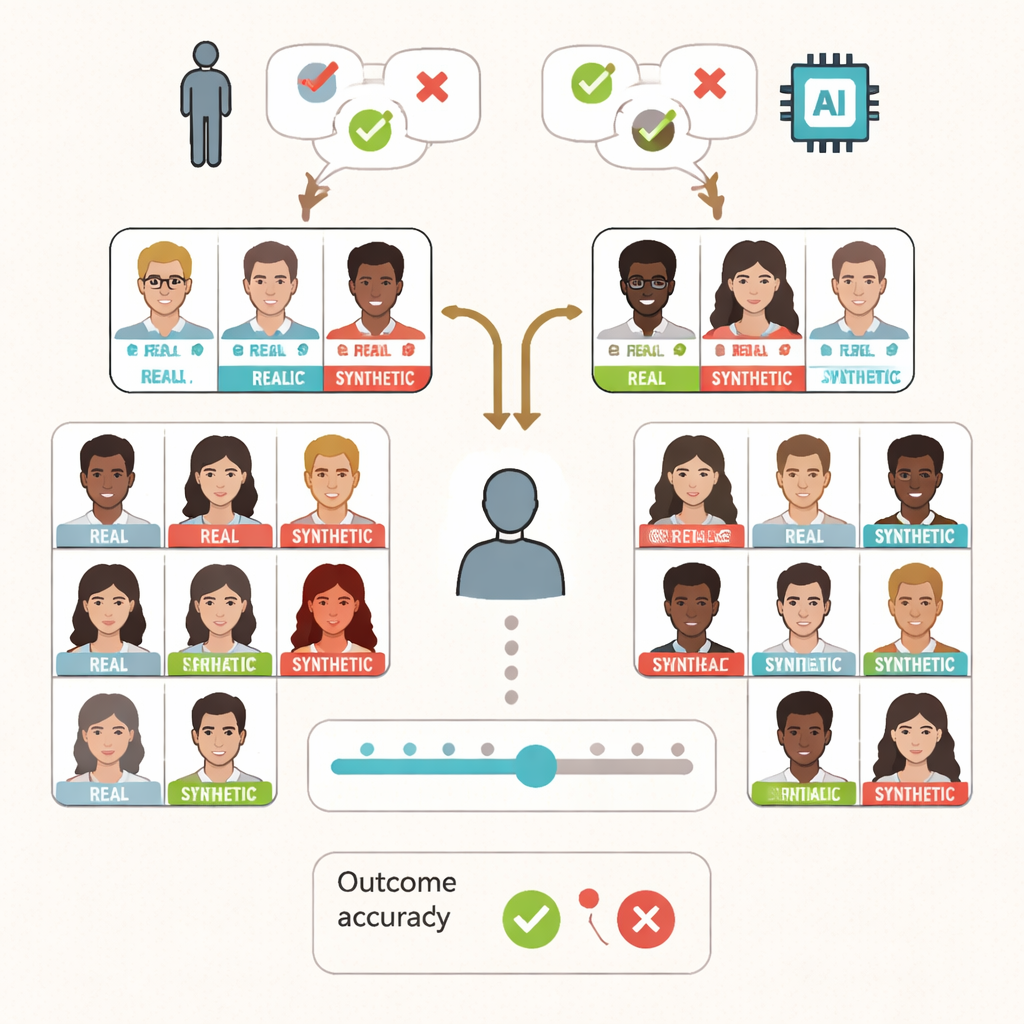

Les chercheurs ont demandé à 295 adultes d’exécuter une tâche apparemment simple : décider si un visage affiché à l’écran était la photographie d’une vraie personne ou un faux généré par IA. Chaque participant a vu 80 visages — la moitié réels, la moitié synthétiques — sélectionnés avec soin d’après des travaux antérieurs de sorte que la plupart des gens puissent les classer correctement dans l’ensemble, mais pas parfaitement. Aux côtés de chaque visage, les participants voyaient un court avis indiquant si le visage était « réel » ou « synthétique ». On leur a dit que ce conseil provenait soit d’un groupe d’experts humains, soit d’un système d’IA, alors qu’en réalité tous les conseils étaient préprogrammés et corrects seulement la moitié du temps.

Utiliser le conseil, mais pas aveuglément

La question centrale était de savoir si les gens suivraient simplement le conseil ou réfléchiraient par eux-mêmes. Les résultats montrent que les participants ne se sont pas comportés comme des presse-boutons passifs. Ils suivaient beaucoup plus le conseil lorsqu’il avait la bonne réponse et avaient davantage tendance à l’ignorer lorsqu’il était erroné, quel que soit le prétendu auteur, humain ou IA. La précision globale pour repérer les visages réels versus synthétiques est restée autour de deux tiers de bonnes réponses — très proche d’un groupe distinct d’une étude antérieure qui avait effectué la même tâche sans aucun conseil. Autrement dit, la présence d’un « assistant » IA n’améliorait ni ne ruinait de manière drastique la performance en moyenne.

Quand une attitude positive envers l’IA se retourne contre nous

Toutefois, sous ces moyennes se dessine un schéma plus subtil. Les participants ont aussi complété des enquêtes sur leur niveau de confiance général envers les autres et sur leur opinion de l’IA. Ceux qui entretenaient des attitudes plus positives envers l’IA se sont en réalité montrés moins performants pour distinguer le vrai du faux lorsqu’ils recevaient des conseils d’une IA. Ils étaient moins capables de différencier les visages authentiques des synthétiques que les participants aux vues plus prudentes ou négatives vis‑à‑vis de l’IA. Cet effet n’apparaissait pas lorsque les participants croyaient que les conseils venaient d’humains, ce qui suggère que les recommandations d’IA peuvent façonner — et parfois déformer — notre prise de décision de manière spécifique. L’étude a aussi montré que les personnes affirmant toujours se fier aux conseils réussissaient moins bien que celles déclarant les utiliser parfois ou pas du tout.

Les humains conservent néanmoins le rôle décisif

Les chercheurs ont approfondi la façon dont les personnes faisaient le lien entre leur propre jugement et le conseil. En moyenne, les participants montraient un biais à étiqueter les visages comme « réels », et ce biais augmentait légèrement chez ceux qui déclaraient avoir tendance à faire davantage confiance aux autres humains. Pourtant, la manière dont les gens utilisaient le conseil semblait « stratégique » : ils semblaient y recourir particulièrement lorsqu’ils se sentaient moins sûrs. Les évaluations de confiance correspondaient assez bien à la performance — lorsque les gens se sentaient plus confiants, ils étaient généralement plus précis — indiquant que les participants avaient une appréciation raisonnable de leurs chances d’avoir raison ou tort, même avec l’IA en jeu.

Que signifie cela pour les outils d’IA du quotidien ?

Pour un lecteur non spécialiste, le message clé est que l’IA n’élimine pas magiquement les biais humains, et n’écrase pas non plus automatiquement notre jugement. Les gens traitent souvent les conseils d’IA de manière similaire à ceux d’un humain et peuvent les ignorer lorsqu’ils semblent peu utiles. Mais lorsqu’une personne a déjà une opinion très positive de l’IA, elle peut être plus susceptible de s’y appuyer d’une façon qui réduit sa précision. À mesure que les systèmes d’IA se diffusent dans des domaines critiques comme la santé, la sécurité et la justice, les concepteurs et les décideurs devront comprendre ces tendances humaines. Cette étude suggère qu’une utilisation efficace de l’IA dépend non seulement de meilleurs algorithmes, mais aussi de personnes informées qui savent quand faire confiance à la machine — et quand se faire confiance.»

Citation: Pearson, J., Dror, I., Jayes, E. et al. Examining human reliance on artificial intelligence in decision making. Sci Rep 16, 5345 (2026). https://doi.org/10.1038/s41598-026-34983-y

Mots-clés: intelligence artificielle, prise de décision humaine, confiance dans l’IA, biais d’automatisation, visages deepfake