Clear Sky Science · fr

Une méthode d'étalonnage extrinsèque LiDAR‑caméra longue portée pour le transport ferroviaire

Protéger les trains à distance

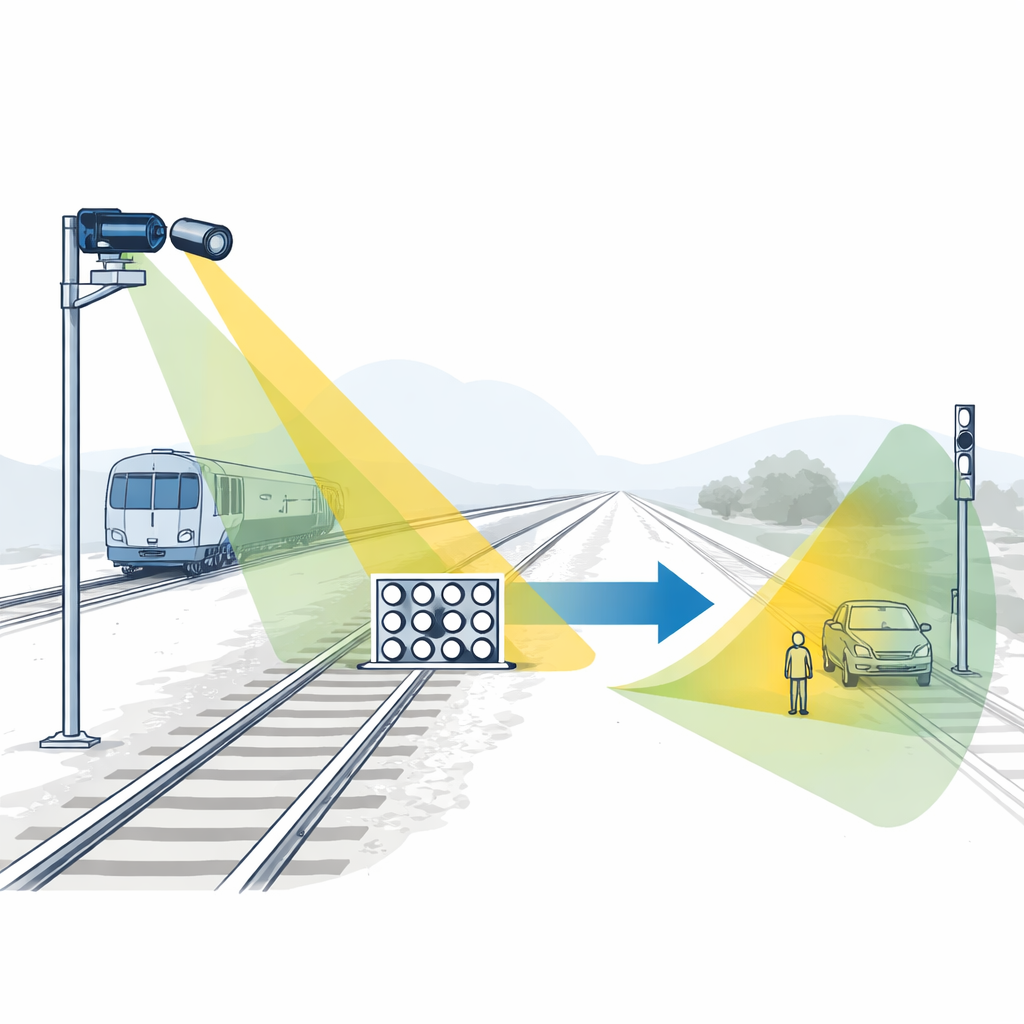

Les trains sans conducteur modernes s'appuient sur des « yeux » électroniques pour surveiller les voies et détecter des obstacles bien avant qu'un humain ne puisse les voir. Deux des principaux capteurs sont les caméras et des scanners laser appelés LiDAR, qui perçoivent chacun le monde de façon différente. Pour fonctionner conjointement, ils doivent être alignés avec une grande précision, une tâche qui devient étonnamment difficile lorsque l'on observe des voies à des centaines de mètres. Cette étude présente une nouvelle façon d'aligner ces capteurs afin qu'ils puissent protéger de manière fiable les systèmes ferroviaires à longue distance.

Pourquoi l'alignement des capteurs est important

Sur un train autonome, les caméras capturent des images couleur détaillées tandis que le LiDAR mesure la distance en émettant des impulsions lumineuses et en chronométrant leur retour. La fusion de ces deux vues permet au système de détecter et de suivre des objets susceptibles d'envahir l'emprise de la voie, d'une voiture arrêtée à un passage à niveau à des débris sur les rails. Mais la fusion ne fonctionne que si le système connaît précisément la position relative de la caméra et du LiDAR. Un petit désalignement peut déplacer un obstacle détecté de plusieurs centimètres — voire mètres — à longue distance, ce qui peut rendre les systèmes de protection automatiques plus lents ou moins fiables.

Le défi de voir loin sur la voie

Pour les applications ferroviaires, les ingénieurs utilisent souvent des objectifs téléobjectifs afin que la caméra puisse distinguer clairement des objets à plusieurs centaines de mètres. À ces distances, toutefois, les retours LiDAR sur toute cible d'étalonnage deviennent très clairsemés : seuls quelques points laser atteignent la planche utilisée pour aligner les capteurs. La plupart des techniques d'alignement existantes supposent un nuage de points LiDAR dense ou des arêtes riches dans la scène, conditions qui ne sont tout simplement pas réunies à longue portée. Il devient donc difficile de trouver des caractéristiques correspondantes entre l'image 2D et le nuage de points 3D avec une précision suffisante pour assurer un contrôle sûr du train.

Une planche d'étalonnage plus intelligente

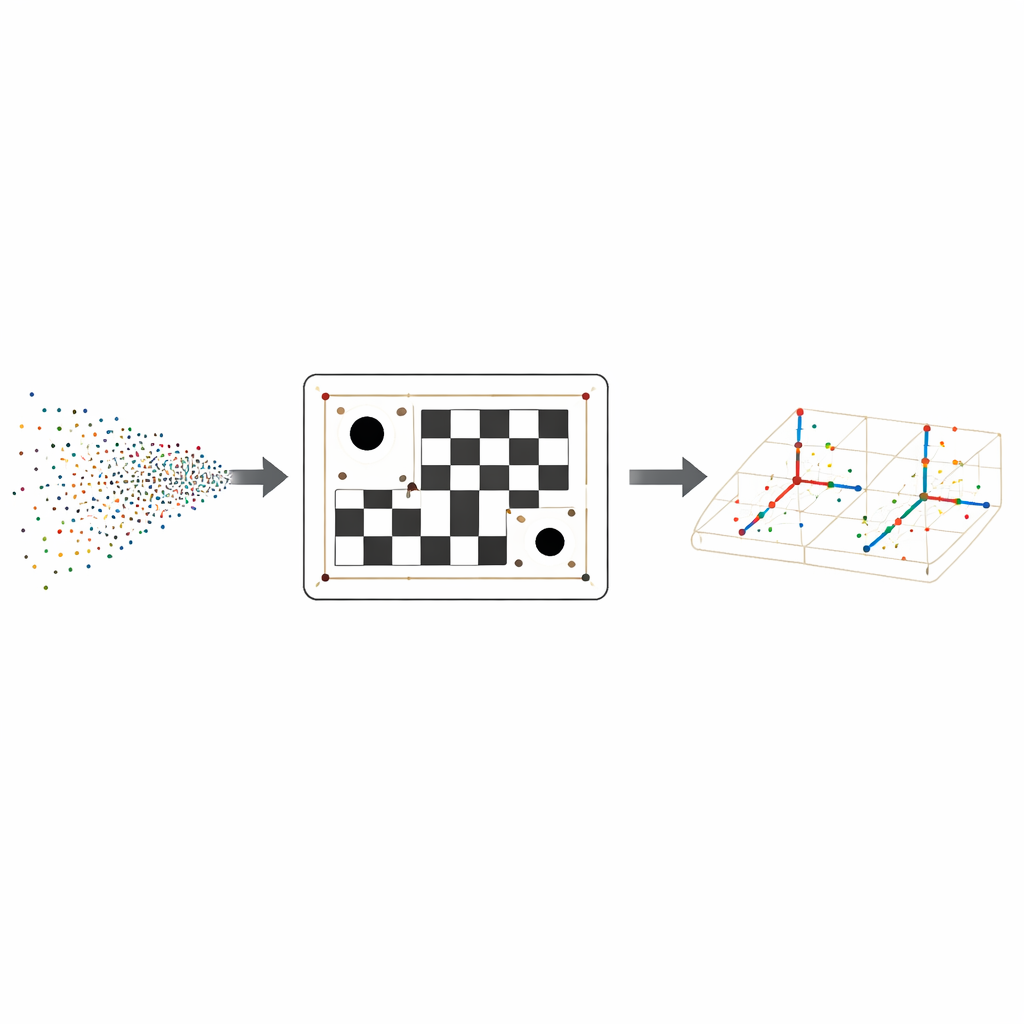

Pour surmonter ce problème, les auteurs conçoivent une planche d'étalonnage spéciale qui combine un motif à damier noir et blanc familier avec trois trous circulaires dont les centres forment un triangle irrégulier. Le motif à damier fournit de nombreux points d'angle précis dans l'image de la caméra, tandis que les trous créent de forts indices géométriques pour le LiDAR, qui peut détecter facilement leurs bords ronds même de loin. Parce que les trois trous sont placés en triangle asymétrique, l'orientation de la planche dans l'espace peut être déterminée sans ambiguïté, évitant la confusion liée aux vues en miroir ou aux rotations.

Transformer des points clairsemés en correspondances fiables

Côté LiDAR, la méthode commence par nettoyer le nuage de points et ajuster un plan plat représentant la planche. Elle projette ensuite les points sur ce plan et utilise une procédure robuste d'ajustement de cercles pour trouver le centre de chaque trou, affinant leurs positions en imposant les distances physiques connues entre les trous. Une fois le triangle des centres des trous établi, l'algorithme construit une grille de coordonnées locale à travers la planche, prédit où doit se situer chaque coin du damier en 3D, et vérifie les points LiDAR voisins pour leurs bonnes valeurs de luminosité, ou réflectivité. Cette combinaison de géométrie et de réflectivité transforme une poignée de retours épars en un ensemble fiable de positions 3D de coins correspondant aux coins 2D de la caméra.

Raffiner la relation entre les capteurs

Une fois que les mêmes coins physiques sont identifiés à la fois dans l'image de la caméra et dans le nuage LiDAR, les auteurs résolvent la rotation et la translation exactes qui relient les deux capteurs. Ils utilisent une technique d'optimisation itérative qui ajuste de façon répétée cette relation pour réduire l'écart entre l'endroit où les points LiDAR se projettent dans l'image et l'endroit où la caméra voit réellement les coins. Des tests sur une plateforme ferroviaire réelle, utilisant des objectifs de caméra de focales modérées à très longues, montrent que la nouvelle méthode maintient systématiquement les erreurs de projection à environ un pixel ou moins, et qu'elle surpasse plusieurs alternatives bien connues, en particulier aux plus longues focales où les données sont les plus rares.

Ce que cela signifie pour la sécurité ferroviaire

En termes concrets, l'étude propose une manière plus fiable de dire à la caméra et au LiDAR d'un train autonome « vous êtes ici et vous regardez exactement dans cette direction ». En repensant la planche d'étalonnage et en ajoutant un traitement intelligent des données LiDAR clairsemées, la méthode conserve une grande précision même lorsque les capteurs observent des scènes à plusieurs centaines de mètres. Cet alignement plus serré permet au système fusionné de positionner les obstacles avec plus de précision en 3D, renforçant la base technologique d'un transport ferroviaire plus sûr et d'une perception multisenseur plus fiable dans le monde réel.

Citation: Liu, X., Wang, H., Ruan, S. et al. A long-range LiDAR–camera extrinsic calibration method for rail transit. Sci Rep 16, 8018 (2026). https://doi.org/10.1038/s41598-025-34547-6

Mots-clés: sécurité du transport ferroviaire, fusion LiDAR et caméra, calibrage des capteurs, trains autonomes, perception longue portée