Clear Sky Science · fr

Évaluation de l’efficacité de la carte de contrôle ZICOMP‑Shewhart pour la surveillance de processus à inflation de zéros

Pourquoi de nombreux zéros comptent encore

Les usines modernes, les hôpitaux et les systèmes informatiques exécutent souvent leurs tâches si bien que les problèmes deviennent rares. Les journaux de qualité peuvent montrer de longues périodes d’unités parfaites — zéro défaut — interrompues par des épisodes ponctuels de dysfonctionnement. À première vue, cela semble une bonne nouvelle, mais cela rend en réalité plus difficile la détection d’un glissement discret du processus hors de contrôle. Cet article aborde ce défi en développant et en testant un outil statistique spécialisé — la carte de contrôle ZICOMP‑Shewhart — conçue pour surveiller des processus où « il ne se passe rien » la plupart du temps, mais pas toujours.

Suivre la qualité dans le temps

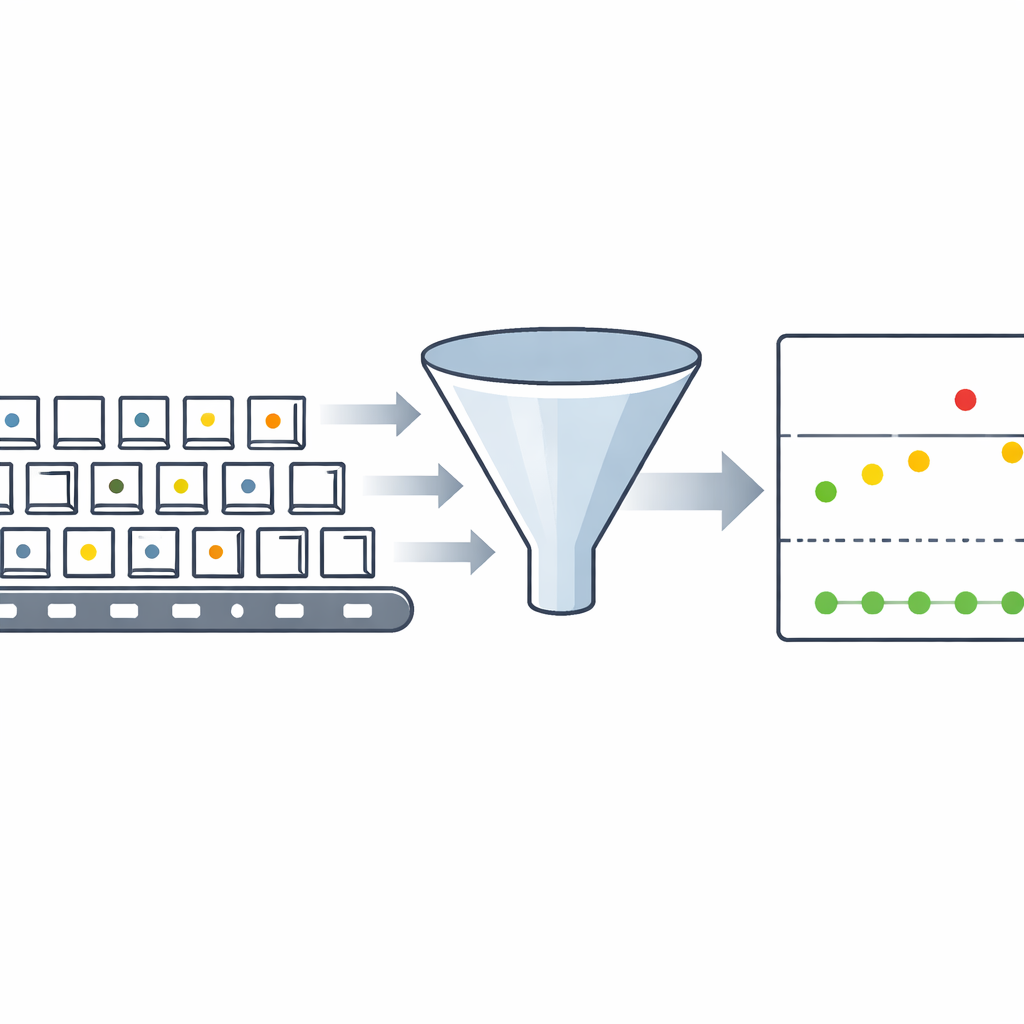

En contrôle qualité, les ingénieurs utilisent des cartes de contrôle pour suivre le comportement d’un processus au fil du temps. Chaque nouveau lot, article ou période est résumé par un point sur la carte. Tant que les points restent à l’intérieur des limites attendues, le processus est considéré comme stable ; lorsqu’ils dépassent une limite, une alarme est déclenchée et le processus est examiné. Les cartes traditionnelles fonctionnent bien lorsque le nombre de défauts suit des schémas simples, comme la distribution de Poisson familière. Cependant, dans de nombreux processus « à haut rendement » modernes — par exemple la fabrication de disques durs ou la surveillance d’erreurs dans les centres de données — la plupart des observations sont exactement nulles, avec seulement quelques comptages non nuls. Les modèles standard sous‑estiment cet excès de zéros et évaluent souvent mal l’ampleur de la variation, ce qui peut retarder ou masquer des avertissements importants.

Donner un modèle aux zéros

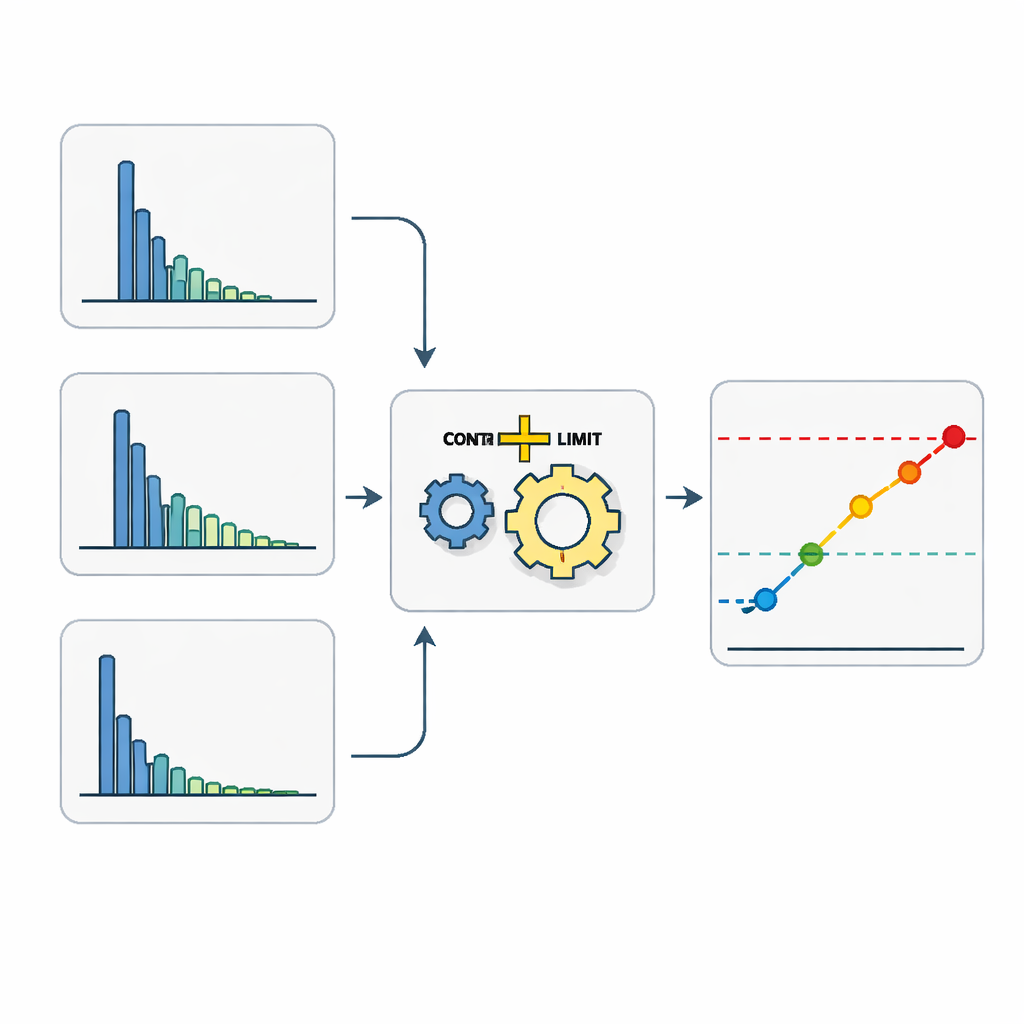

Les auteurs s’appuient sur une famille flexible de modèles appelée distribution Conway–Maxwell–Poisson (COMP), qui peut traiter des données plus variables ou moins variables que le cas Poisson classique. Ils l’étendent à la distribution ZICOMP (zero‑inflated COMP), qui sépare explicitement deux composantes : la probabilité qu’un résultat soit zéro, et le motif des comptages non nuls lorsque des problèmes surviennent. Cela permet au modèle de s’adapter à trois situations courantes : des données très variables avec de longues queues à droite, des données à variabilité modérée, et des données fortement concentrées avec peu d’étalement. La carte de contrôle ZICOMP‑Shewhart utilise cette description enrichie pour fixer une limite supérieure unique adaptée aux processus où les zéros sont particulièrement fréquents.

Concevoir des limites d’alerte plus intelligentes

Une question centrale en pratique est de savoir à quelle hauteur placer la ligne d’alerte. Si elle est trop basse, la carte hurle au loup ; si elle est trop haute, de vrais problèmes sont manqués. Les auteurs utilisent des expériences numériques à grande échelle pour explorer comment un « coefficient de limite » contrôle ce compromis. Ils étudient deux mesures de performance clés. L’une est la longueur moyenne de marche (average run length), c’est‑à‑dire le nombre attendu d’échantillons avant que la carte ne signale ; elle reflète la fréquence des fausses alertes lorsque le processus est sain. L’autre est l’erreur de type II, la probabilité que la carte ne signale pas alors que le processus a réellement changé. En parcourant de nombreuses combinaisons de paramètres de modèle — pour différents niveaux de variabilité et d’inflation de zéros — ils montrent comment choisir le coefficient de limite pour obtenir une longueur moyenne de marche souhaitée tout en maintenant le taux de signaux manqués à un niveau acceptable, même lorsque la nature discrète des données rend un réglage parfait impossible.

Mettre la méthode à l’épreuve

Pour évaluer le comportement de leur carte dans des contextes réalistes, les auteurs la comparent à une conception concurrente qui ne traite pas spécialement les zéros et n’utilise que la distribution COMP. À travers de multiples scénarios simulés, ils constatent systématiquement que la carte ZICOMP‑Shewhart détecte les changements du taux de défauts plus tôt et plus souvent, que les données soient très variables, modérément variables ou fortement concentrées. Dans une étude de cas sur des données réelles d’erreurs de lecture‑écriture de disques durs — où de longues périodes sans erreur sont ponctuées d’épisodes de pannes — la nouvelle carte détecte avec succès un changement après une suite de zéros suivie de comptages plus élevés, montrant comment elle peut servir de système d’alerte précoce dans des environnements à haute fiabilité.

Ce que cela signifie en pratique

Pour les praticiens, le message est qu’ignorer le rôle particulier des zéros peut masquer des signaux importants sur la santé d’un processus. En construisant une carte de contrôle autour d’un modèle qui reconnaît à la fois des zéros en excès et des motifs de variation inhabituels, la carte ZICOMP‑Shewhart donne une image plus fiable du moment où un processus s’écarte réellement de son comportement attendu. Bien que ses performances dépendent encore de la qualité des estimations des paramètres sous‑jacents, et que des travaux futurs puissent affiner ces estimations, cette étude démontre que l’adaptation des outils statistiques aux particularités des données réelles peut rendre la surveillance de la qualité plus sensible, plus fiable et, en fin de compte, plus efficace pour prévenir des défaillances coûteuses.

Citation: Sattar, A., Raza, M.A., AL-Essa, L.A. et al. Assessing the effectiveness of the ZICOMP-Shewhart control chart for monitoring zero-inflated processes. Sci Rep 16, 8269 (2026). https://doi.org/10.1038/s41598-025-32581-y

Mots-clés: données de comptage à inflation de zéros, contrôle statistique des procédés, cartes de contrôle qualité, Conway‑Maxwell‑Poisson, défauts de fabrication