Clear Sky Science · fr

Multi-TPC : un jeu de données multimodal pour des conversations à trois avec parole, mouvement et regard

Pourquoi la façon dont nous bougeons et regardons en parlant importe

Lorsque des personnes parlent en face à face, elles font bien plus qu�échanger des mots. On se penche en avant, on hoche la t�te, on se jette des regards, et on marque des pauses aux endroits appropriés. Ces gestes subtils prennent encore plus d�importance quand trois personnes conversent ensemble, car l�attention et les tours de parole changent constamment. Pourtant, jusqu�ici, scientifiques et ingénieurs disposaient de très peu de donn�es de haute qualit� montrant comment la parole, le mouvement du corps et le regard s�entrelacent dans des conversations en petit groupe. Cet article pr�sente un nouveau jeu de donn�es con�u pour combler cette lacune et aider �concevoir des assistants virtuels, des robots sociaux et des outils d��tude des interactions humaines quotidiennes plus naturels.

Une nouvelle fen�tre sur les conversations �trois personnes

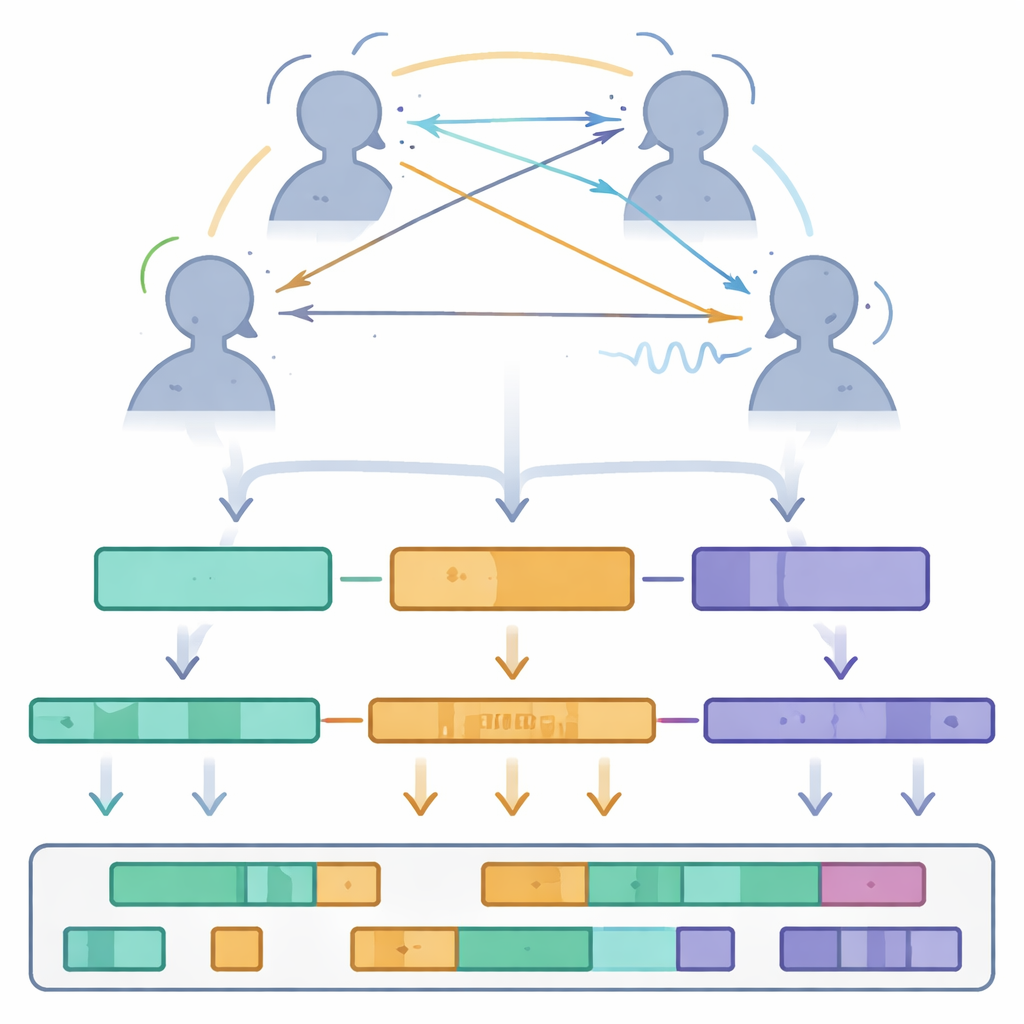

Les auteur·rice·s pr�sentent Multi-TPC, une collection publique de conversations �trois personnes enregistr�es en laboratoire �l�aide de capture de mouvement, de traceurs oculaires et de microphones individuels. Contrairement �de nombreuses ressources ant�rieures centr�es sur un seul locuteur ou sur des conversations entre deux personnes, Multi-TPC saisit des discussions spontan�es entre trois inconnu·e·s qui se tiennent en triangle et parlent du sujet de leur choix. Plus de 5,3 heures d�enregistrements provenant de 21 jeunes adultes sont incluses, réparties en 24 sessions. Pour chaque instant de ces conversations, le jeu de donn�es fournit des informations d�taill�es sur la fa�on dont chaque personne parle, bouge son corps et dirige son regard.

Comment les conversations ont �t� captur�es

Pour cr�er ce jeu de donn�es, l��quipe a mis au point un dispositif d�enregistrement hybride. Chaque participant portait une combinaison de capture de mouvement int�grale par�e9e de marqueurs r�fl�chissants afin qu�un r�seau de huit cam�ras puisse suivre leur posture, les mouvements de t�te et les gestes en trois dimensions. Des lunettes légères de suivi oculaire, proches en sensation de lunettes ordinaires, mesuraient o� chaque personne regardait dans son champ visuel. Des micros sans fil fix�s pr�s du cou enregistraient la voix de chaque locuteur sur une piste audio s�par�ee. Avant l�enregistrement, les participant·e·s �taient calibr�s dans le syst�me et pri�s de rester aux emplacements fixes formant un triangle �quilat�ral d�environ un m�tre de c�t�. Une claquette, visible des cam�ras, des traceurs oculaires et des micros, fournissait un rep�re temporel pr�cis pour aligner tous les appareils, garantissant que mouvement, regard et parole puissent �tre appari�s image par image.

Nettoyage, organisation et enrichissement des donn�es

La collecte des signaux bruts n�tait que la premi�re �tape. Les chercheur·euse·s ont soigneusement trait� les donn�es de mouvement, �tiquetant tous les marqueurs et comblant de petites interruptions par interpolation math�matique tout en v�rifiant les positions des marqueurs voisins. Les enregistrements audio ont �t� nettoy�s � l�aide de m�thodes de r�duction du bruit, puis transmis �un logiciel de reconnaissance vocale pour produire des transcriptions mot � mot, ensuite corrig�es manuellement. Les points de regard mesur�s en pixels de cam�ra ont �t� convertis en angles 3D indiquant o� chaque personne regardait dans l�espace. Tous les signaux ont �t� r�echantillonn�s � 60 images par seconde et synchronis�s, puis stock�s dans des formats ouverts et simples. Le jeu de donn�es final est organis� par modalit�—mouvement, regard, audio, mots et caractéristiques prosodiques telles que l�intensit� et la hauteur—avec des r�gles claires de nommage des fichiers afin que les chercheur·euse·s puissent facilement retrouver n�importe quel instant dans le temps pour les trois participant·e·s.

Ce que le jeu de donn�es r�v�le sur la conversation de groupe

Avec Multi-TPC, les auteur·rice·s ont effectu� un premier tour statistique de la mani�re dont se d�roulent les conversations �trois personnes. Ils ont mesur� les tours de parole et les silences, constatant qu�un tour de parole typique dure environ 2,7 secondes, s�par� d� pauses d�un peu plus d�une seconde. Ils ont �galement examin� les hochements et mouvements de t�te comme formes de r�troaction de l�auditeur, d�tectant en moyenne environ un quart de hochement ou de secousse par seconde—preuve que les auditeur·rice·s signalent constamment attention et attitude sans prononcer un mot. L�analyse du regard a montr� que les personnes fixent rarement directement le visage d�un autre longtemps. Elles regardent souvent un peu �c�t�, et leurs patrons de regard varient selon qui parle, s�il y a une pause ou si plusieurs personnes parlent en m�me temps. Lors de chevauchements de parole, les regards des participant·e·s deviennent plus �quitablement r�partis ou s�loignent des deux partenaires, sugg�rant une incertitude quant �qui tient la parole.

Pourquoi cette ressource compte pour la technologie future

En regroupant toutes ces couches d�information dans un jeu de donn�es bien document� et partageable, Multi-TPC offre une nouvelle base pour �tudier comment les petits groupes g�rent la prise de parole, l�attention et la r�troaction � travers les mots et le mouvement. Pour le grand public, la le�on est que la danse de la conversation—qui parle quand, qui regarde o�, et comment de subtils hochements structurent le flux—est maintenant captur�e en d�tails fins. Pour les scientifiques et d�veloppeur·euse·s, cela ouvre la porte �la cr�ation de personnages virtuels et de robots sociaux qui r�pondent davantage comme de vraies personnes en contexte de groupe, ainsi qu�� des �tudes plus approfondies sur la fa�on dont nous nous coordonnons par la voix, le corps et le regard.

Citation: Lee, MC., Deng, Z. Multi-TPC: A Multimodal Dataset for Three-Party Conversations with Speech, Motion, and Gaze. Sci Data 13, 429 (2026). https://doi.org/10.1038/s41597-026-06819-x

Mots-clés: conversation multimodale, gestes et regard, jeu de données d�interaction sociale, prise de parole, agents virtuels