Clear Sky Science · fr

Un jeu de données de super-résolution vidéo pour l’opéra traditionnel chinois basé sur la fusion de dégradations « réelles+ »

Redonner vie aux vieux films d’opéra

De nombreux enregistrements d’opéra traditionnel chinois existent seulement sous forme de vidéos fragiles et de faible qualité. Le temps, la poussière et les copies successives ont estompé les visages, terni les costumes et rempli les scènes de bruit visuel. Cet article présente une nouvelle façon de « nettoyer » et d’aiguiser numériquement ces vidéos, non pas en réparant chaque film manuellement, mais en constituant une collection d’entraînement spécialisée pour l’intelligence artificielle. L’objectif est d’apprendre aux ordinateurs à transformer des images floues et vieillies en images plus nettes et plus vivantes, préservant ainsi une part importante de la mémoire culturelle mondiale.

Pourquoi les vieilles vidéos d’opéra sont si dégradées

L’opéra traditionnel chinois, incluant des styles célèbres comme l’opéra de Pékin et le Kunqu, est reconnu par l’UNESCO comme faisant partie du patrimoine culturel immatériel de l’humanité. Pourtant, nombre des vidéos survivantes de ces représentations ont subi un long et rude parcours. D’abord, le matériel de tournage d’origine introduit du flou et du bruit de caméra. Ensuite, le stockage sur pellicule, bande ou disque engendre rayures, déformations et perte de données. Enfin, les copies répétées, la compression pour Internet et les transmissions réseau instables ajoutent des artefacts en blocs, des scintillements et des pertes d’images. Le résultat n’est pas un simple flou, mais un entrelacs de différents types d’altérations, rendant très difficile pour les méthodes de restauration de reconstituer l’apparence originale d’une scène.

Construire des paires d’images floues et nettes

Les méthodes modernes de « super-résolution » vidéo entraînent des ordinateurs à prédire une image nette et détaillée à partir d’une image de basse qualité. Pour acquérir cette compétence, elles ont besoin de nombreux exemples où une image floue correspond exactement à la même scène en haute qualité. Les jeux de données existants reposent généralement soit sur des dégradations artificielles simplifiées, soit sur des séquences réelles qui ne sont pas précisément alignées entre versions basse et haute qualité. Les auteurs ont créé une nouvelle ressource, CTOVSR, à partir de quatre films d’opéra traditionnel restaurés professionnellement à partir de bobines originales, atteignant une très haute résolution. Ils ont ensuite retrouvé des versions en définition standard des mêmes représentations publiées en ligne. Ces copies de moindre qualité avaient subi l’intégralité du vieillissement réel, ce qui en fait des images « avant » idéales.

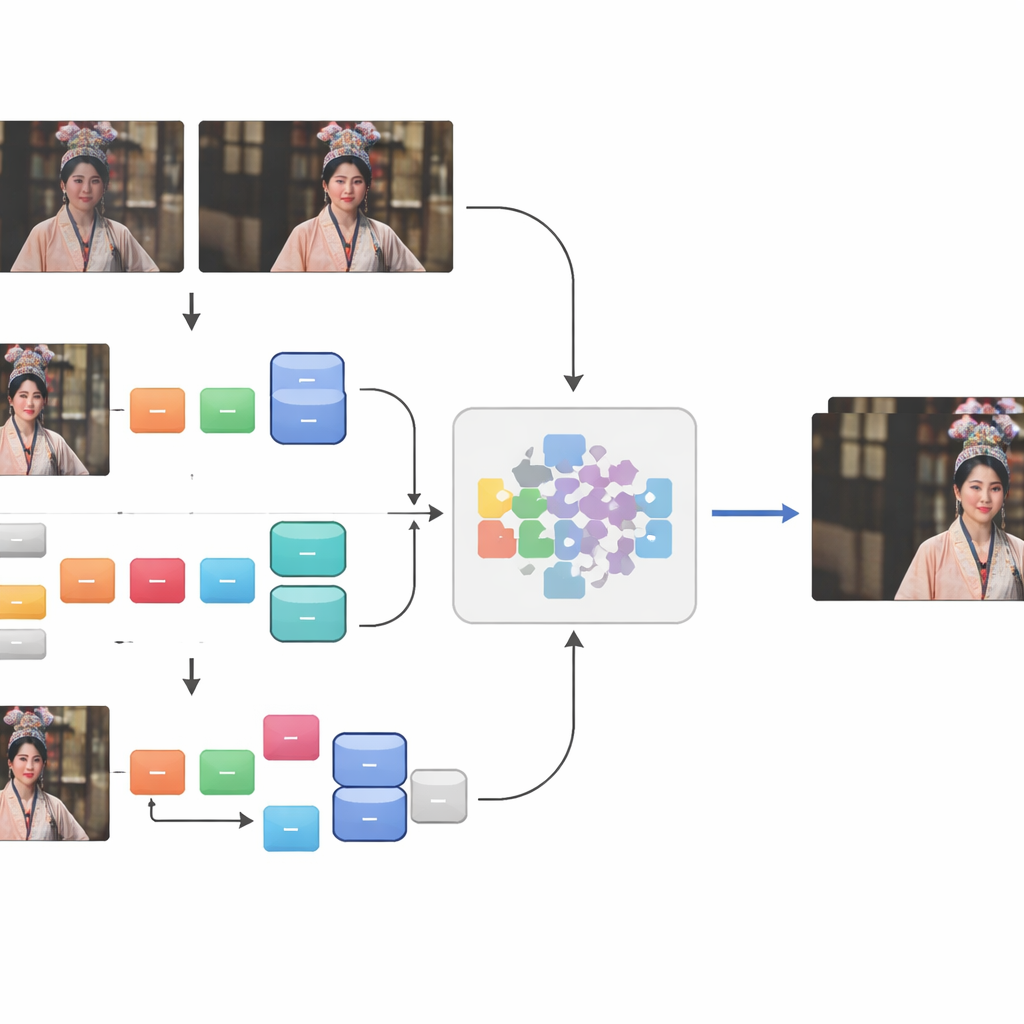

Aligner chaque image avec soin

Aligner les vidéos restaurées et vieillies n’a pas été simple. Des différences de fréquence d’images, des plans manquants, des filigranes ajoutés, des bandes noires et des rapports d’aspect décalés faisaient échouer les méthodes automatiques simples. L’équipe a extrait des segments exploitables puis effectué un alignement minutieux en trois étapes. D’abord, ils ont utilisé un outil personnalisé, eye_comparer, pour corriger manuellement des problèmes de synchronisation tels que pertes de trames, trames hors d’ordre et trames « fantômes » aux transitions de scène. Ensuite, ils ont géré les décalages spatiaux en superposant les images dans un logiciel d’édition, alignant précisément le contenu et recadrant les bordures, logos et sous-titres tout en préservant le plus possible de la scène. Enfin, ils ont effectué une vérification automatique via une mesure de similarité, ne conservant que les paires d’images presque identiques en structure. Ce processus a produit 250 paires de séquences réelles de haute qualité couvrant des centaines de milliers d’images.

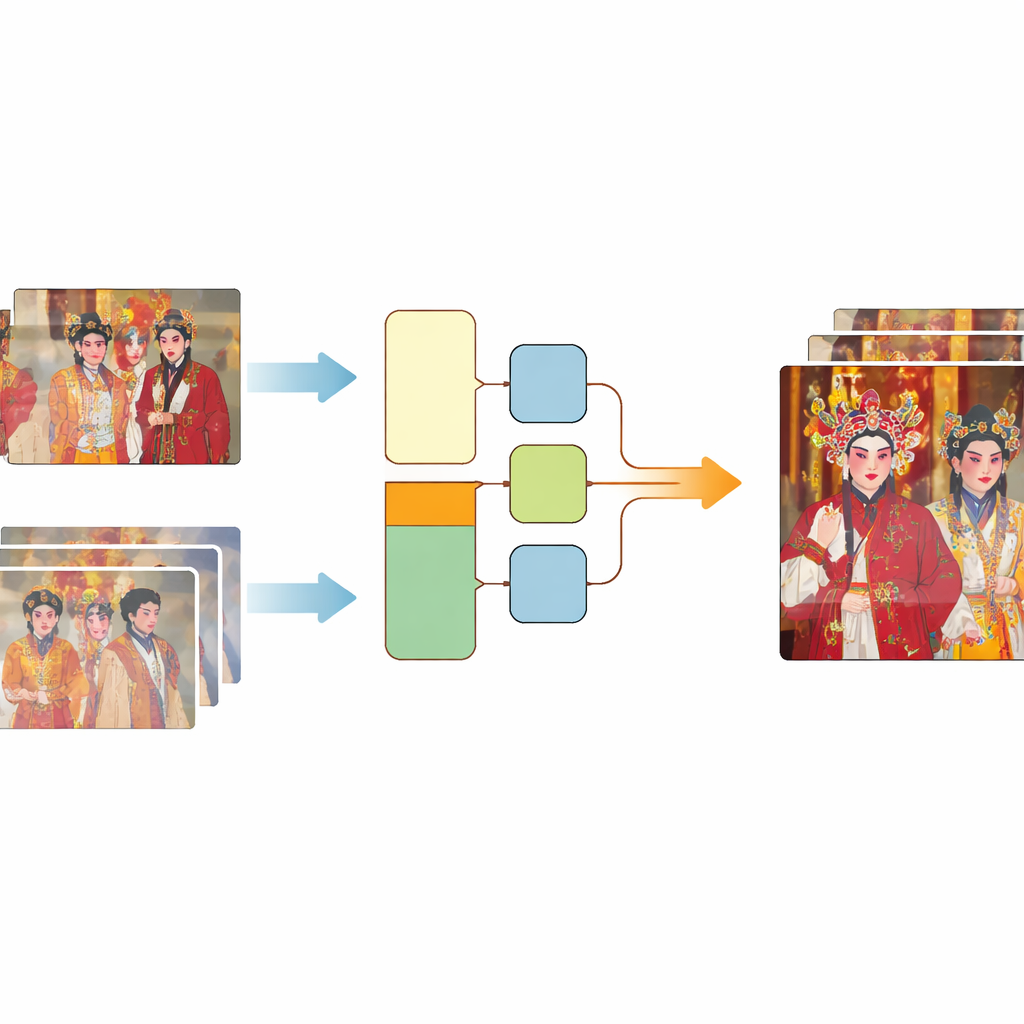

Mêler dégradations réelles et usure simulée

Bien que ces paires soigneusement alignées capturent une véritable dégradation du monde réel, elles restaient insuffisantes pour couvrir la diversité complète des façons dont une vidéo peut se dégrader. Pour élargir le matériau d’entraînement, les auteurs ont ajouté un deuxième ingrédient : des dégradations synthétiques appliquées à 41 vidéos d’opéra haute définition supplémentaires. Ils ont simulé des dommages spatiaux — comme le flou et le bruit — via une chaîne de dégradation en deux étapes, et des dommages temporels en compressant les vidéos avec une norme ancienne largement utilisée, reflétant l’encodage historique de nombreux clips en ligne. En fusionnant cette portion synthétique avec les paires « Real-world+ », ils ont assemblé le jeu de données CTOVSR, qui contient 900 paires vidéo basse–haute qualité strictement alignées, chacune durant 100 images et présentant une large variété d’opéras, de scènes et de conditions d’éclairage.

Montrer la valeur de la nouvelle collection

Pour vérifier que CTOVSR aide réellement les modèles à restaurer de vieilles vidéos, les auteurs ont entraîné plusieurs modèles de super-résolution à la pointe en n’utilisant que ce jeu de données. Ils ont comparé les sorties à de simples méthodes de redimensionnement et constaté que les modèles entraînés produisaient des images bien plus nettes, avec des détails de costume plus précis, un maquillage facial plus lisible et moins d’artefacts visibles. Une étude d’ablation a montré que la combinaison de dommages réels et synthétiques dépassait nettement l’utilisation de l’un ou l’autre isolément. Les chercheurs ont également testé leurs modèles sur des séquences complètement nouvelles : des extraits d’opéra vieillissants trouvés en ligne et même des vidéos de spectacles d’autres cultures, comme l’opéra italien et la danse classique indienne. Des observateurs humains ont jugé les images améliorées significativement supérieures aux originaux ou aux versions simplement agrandies, ce qui suggère que les modèles entraînés sur CTOVSR peuvent se généraliser au-delà du matériau spécifique qu’il contient.

Préserver le patrimoine grâce à de meilleures données

En termes simples, ce travail n’introduit pas un nouvel algorithme de restauration ; il propose plutôt le « matériel d’entraînement » soigneusement préparé dont ces algorithmes ont besoin pour apprendre. En associant laborieusement versions dégradées et versions haute qualité d’archives d’opéra traditionnel puis en les enrichissant d’usure simulée réaliste, le jeu de données CTOVSR offre à l’intelligence artificielle une bien meilleure compréhension de la façon dont les vieilles vidéos se détériorent et de leur apparence restaurée. Cette approche fournit une voie pratique non seulement pour redonner une nouvelle vie visuelle à l’opéra traditionnel chinois, mais aussi pour protéger de nombreuses autres formes de vidéos historiques irremplaçables de l’oubli numérique.

Citation: Xi, W., Qin, B., Zhang, Y. et al. A Chinese Traditional Opera Video Super-Resolution Dataset Based on the “Real-world+” Degradation Fusion. Sci Data 13, 387 (2026). https://doi.org/10.1038/s41597-026-06776-5

Mots-clés: super-résolution vidéo, préservation du patrimoine numérique, opéra traditionnel chinois, restauration d’image, jeux de données vidéo dégradés