Clear Sky Science · fr

Un jeu de données de questions de sciences pour l'école primaire chinoise dans la génération de processus de résolution

Aider les enfants à apprendre les sciences avec une IA plus intelligente

Parents et enseignants voient de plus en plus l'intelligence artificielle comme un partenaire d'étude potentiel, mais les chatbots actuels fournissent souvent des explications soit trop superficielles, soit beaucoup trop avancées pour les enfants. Cet article présente un nouveau jeu de données, Chinese Elementary Science Question (CSQ), conçu pour apprendre aux grands modèles de langage à expliquer les sciences comme le ferait un bon enseignant du primaire : étape par étape, au niveau de difficulté approprié et en étroite adéquation avec ce que les enfants apprennent réellement en classe.

Une nouvelle banque de questions pour les jeunes apprenants en sciences

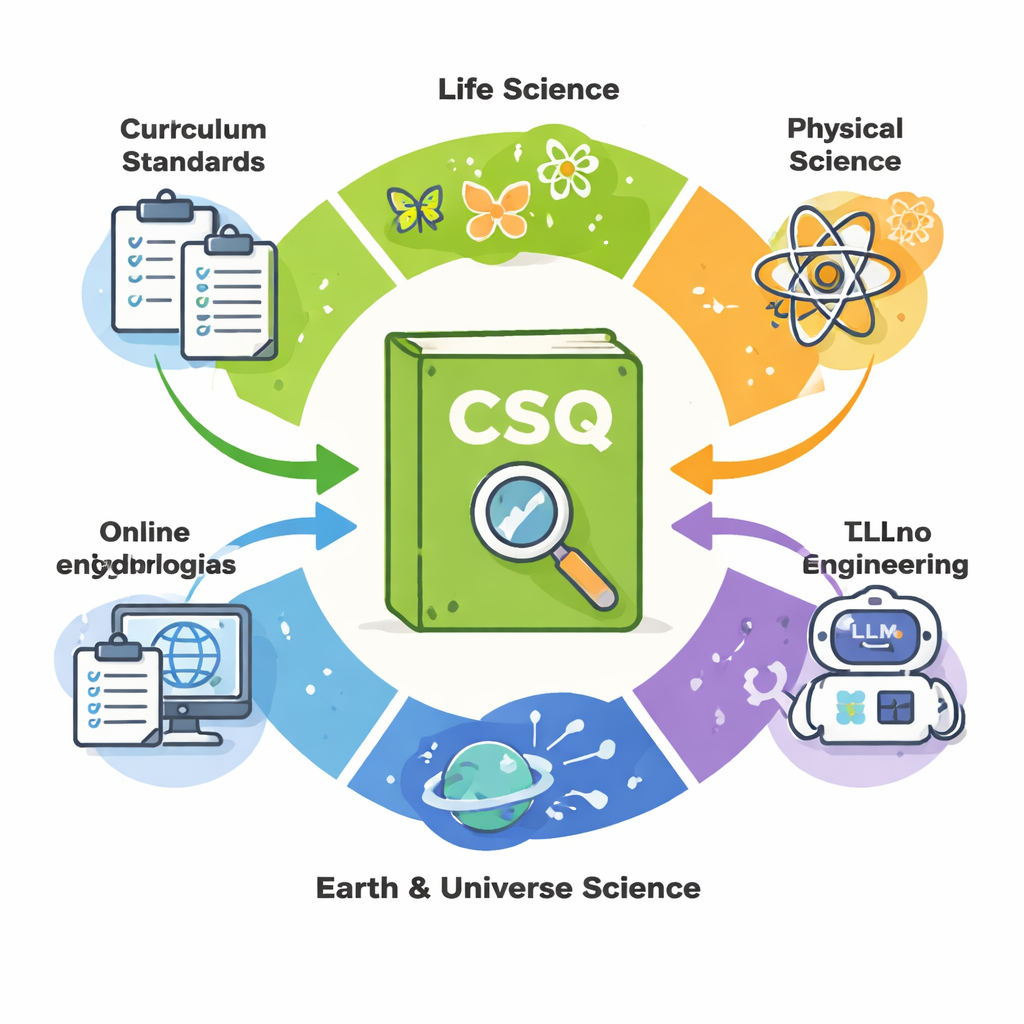

Le jeu de données CSQ est une collection de 12 000 questions de sciences soigneusement élaborées, issues du programme scolaire chinois, d'examens scolaires et de ressources en ligne fiables. Les questions couvrent quatre grands domaines — sciences de la vie, sciences physiques, terre et espace, et technologie et ingénierie — pour les classes de la 1re à la 6e année. Contrairement à de nombreuses banques de questions existantes qui se contentent d'indiquer une question et sa bonne réponse, chaque élément du CSQ comprend aussi des informations sur le niveau scolaire, le thème et les compétences scientifiques évaluées, ainsi qu'une explication complète de la solution adaptée à l'âge.

Capturer la façon de penser réelle des enfants

Une innovation clé du CSQ est son attention portée à la « pensée de résolution » derrière chaque réponse. Pour chaque question, des experts détaillent le processus de raisonnement dans un langage et avec un niveau de détail appropriés au niveau visé. Pour les plus jeunes, les explications restent concrètes et basées sur l'observation — par exemple en décrivant ce que l'on peut voir ou ressentir. Pour les élèves plus âgés, elles introduisent progressivement des idées plus abstraites, comme les systèmes, les relations de cause à effet ou des modèles simples. Chaque élément identifie également les compétences centrales impliquées, telles que l'observation d'un phénomène, la comparaison de deux objets ou l'identification de la fonction d'un outil. Cette structure permet aux modèles d'IA non seulement de donner la bonne réponse, mais aussi de s'entraîner à dérouler le type de pensée que les élèves sont censés apprendre.

Construire le jeu de données avec le réalisme de la classe en tête

La création du CSQ a nécessité un processus structuré et centré sur l'humain. Une équipe de 19 chercheurs expérimentés en éducation scientifique et en IA a divisé le travail en plusieurs étapes. Les membres seniors ont rassemblé des questions à partir des programmes officiels, des sujets d'examen et des encyclopédies, en veillant à ce qu'elles soient légalement réutilisables. Des étudiants de troisième cycle ont ensuite adapté et annoté les questions pour les faire correspondre aux formats à choix multiple ou vrai/faux et aux Normes du programme de sciences pour l'enseignement obligatoire (2022). Leur formation insistait sur le maintien d'un vocabulaire et d'une profondeur cognitive adaptés au niveau scolaire. Chaque élément de données — question, propriétés disciplinaires et solution — a été revu par un autre annotateur, et les désaccords sur les compétences appropriées ou le degré d'explication ont été résolus en s'appuyant sur les normes nationales.

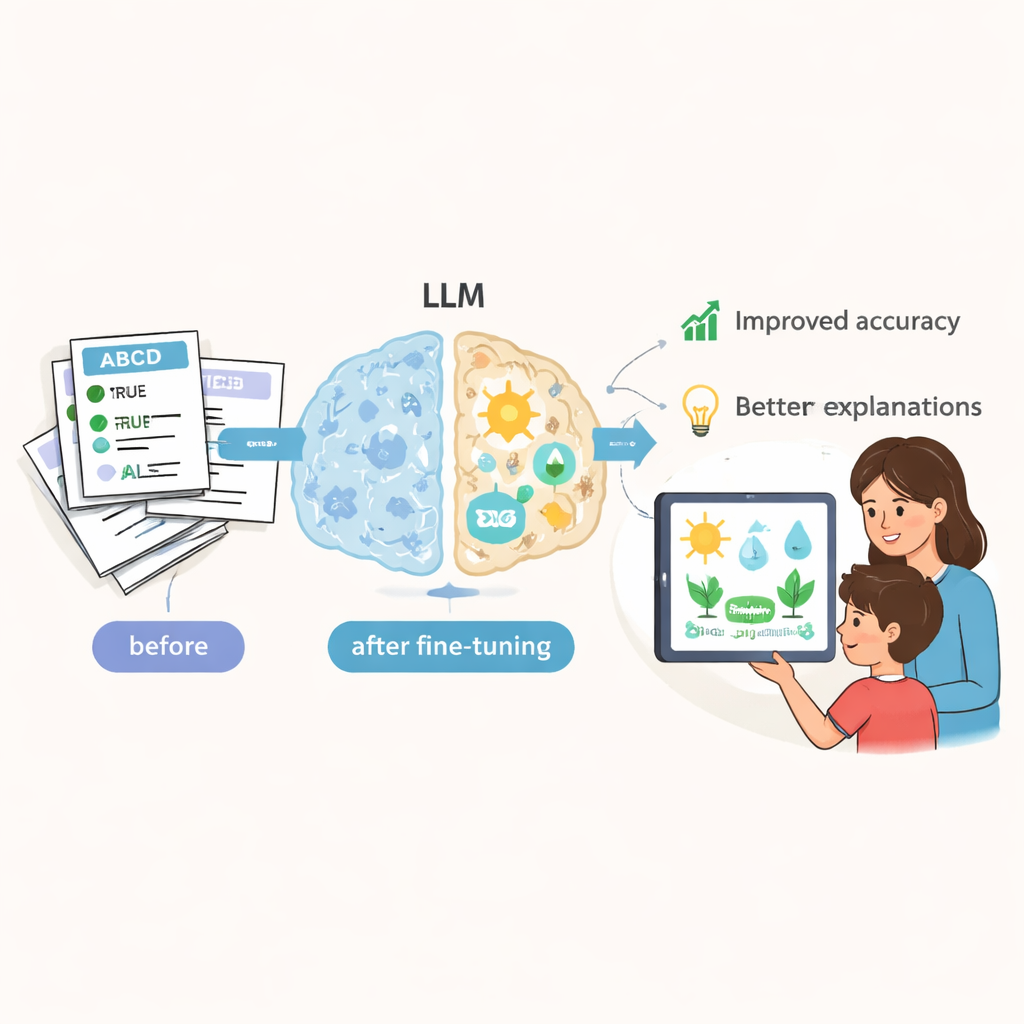

Apprendre à l'IA à montrer son raisonnement

Pour évaluer la valeur du CSQ, les chercheurs ont ajusté finement plusieurs modèles de langage open source, et ont également évalué un modèle commercial de premier plan, sur ce jeu de données. Ils n'ont pas seulement mesuré si les modèles choisissaient la bonne réponse à choix multiple. Ils ont aussi évalué la qualité du raisonnement généré en utilisant à la fois des métriques textuelles automatiques et des évaluations d'experts humains. Après entraînement sur le CSQ, les modèles open source ont montré des gains nets en précision ainsi qu'en clarté et exhaustivité de leurs explications. Par exemple, un modèle qui répondait auparavant à une question élémentaire sur le son en utilisant la théorie avancée des ondes s'est orienté, après ajustement, vers une description plus simple et adaptée à l'âge. Les juges humains ont constaté que les modèles ajustés restaient beaucoup mieux dans le niveau scolaire de l'enfant, évitant le « débordement de connaissances » où des idées trop techniques embrouillent plutôt qu'elles n'aident.

Des limites aujourd'hui, un modèle pour demain

Les auteurs reconnaissent que le CSQ reflète la structure du programme scientifique chinois et se concentre uniquement sur des formats de questions comme le choix multiple et le vrai/faux, et non sur des expériences pratiques ou des projets ouverts. Les explications ont été rédigées par des étudiants diplômés formés, et non par des enseignants en classe ou par les enfants eux-mêmes, donc il reste du travail pour correspondre pleinement au langage réel de la classe. Malgré cela, le cadre du CSQ — lier chaque question à la discipline, au thème, au niveau, aux compétences spécifiques et à un raisonnement étape par étape — est suffisamment général pour inspirer des ressources similaires pour d'autres langues et systèmes scolaires. En termes simples, ce travail montre comment des ensembles de questions soigneusement conçus peuvent aider l'IA à devenir un tuteur de sciences plus fiable et sensible à l'âge pour les jeunes apprenants.

Citation: Li, D., Liu, Z., Wen, C. et al. A Chinese Elementary Science Question Dataset in Problem-Solving Process Generation. Sci Data 13, 291 (2026). https://doi.org/10.1038/s41597-026-06618-4

Mots-clés: enseignement scientifique élémentaire, grands modèles de langage, jeu de données de questions et réponses, tutorat personnalisé, programme scolaire chinois