Clear Sky Science · fr

CNeuroMod-THINGS, un jeu de données IRMf à échantillonnage dense pour les neurosciences visuelles

Pourquoi regarder des images peut révéler le fonctionnement de notre esprit

Chaque jour, nos yeux captent des milliers d'images — des tasses de café et smartphones aux chiens, arbres et rues animées. En coulisses, notre cerveau reconnaît rapidement ce que nous voyons et s'en souvient souvent ensuite. Le projet CNeuroMod-THINGS s'est donné pour objectif de saisir cette activité cachée avec un niveau de détail exceptionnel, créant l'un des jeux de données cérébrales les plus profondément mesurés jamais collectés pendant que des personnes regardent des images du monde réel. Cette ressource vise à alimenter la prochaine génération de recherches en neurosciences et en intelligence artificielle.

Constituer une riche bibliothèque de réponses cérébrales

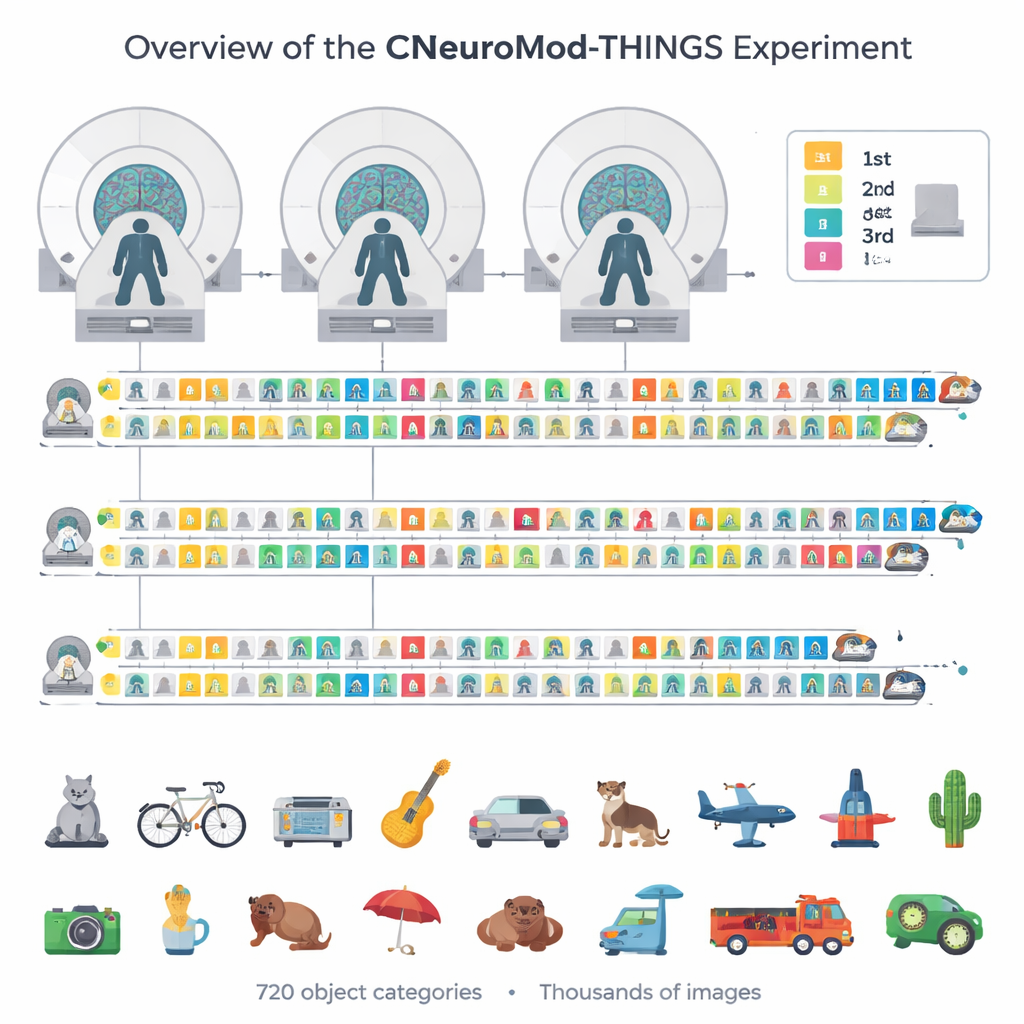

Plutôt que de scanner des centaines de volontaires une ou deux fois, l'équipe a scanné à plusieurs reprises seulement quatre participants très impliqués. Chaque personne est revenue pour 33 à 36 visites, totalisant environ 200 heures d'imagerie cérébrale dans le cadre plus large du projet CNeuroMod et des dizaines d'heures consacrées uniquement aux images. Lors de ces sessions, les volontaires ont vu jusqu'à 4 320 photographies distinctes tirées de la collection d'images THINGS, qui couvre 720 catégories d'objets du quotidien telles que outils, animaux, véhicules et meubles. Ce choix d'images soigneux garantit que de nombreux aspects de notre monde visuel sont représentés, et pas seulement quelques objets populaires.

Un jeu de mémoire à l'intérieur de l'IRM

Pour maintenir l'attention des participants et sonder la mémoire, les chercheurs ont transformé la visualisation des images en un jeu continu de reconnaissance. À chaque essai, une image unique apparaissait au centre de l'écran pendant que la personne était allongée dans l'IRM. À l'aide d'une manette personnalisée de type jeu vidéo, les participants indiquaient s'ils jugeaient l'image nouvelle ou déjà vue, et leur degré de confiance dans ce jugement. La plupart des images ont été présentées trois fois : une première rencontre, une nouvelle présentation quelques minutes plus tard lors de la même visite, et une troisième fois lors d'une visite ultérieure, souvent environ une semaine plus tard. Ce dispositif a permis à l'équipe de comparer la mémoire à court terme et à plus long terme pour exactement les mêmes images tout en suivant les changements correspondants de l'activité cérébrale.

Capturer des signaux détaillés de la vision et de la mémoire

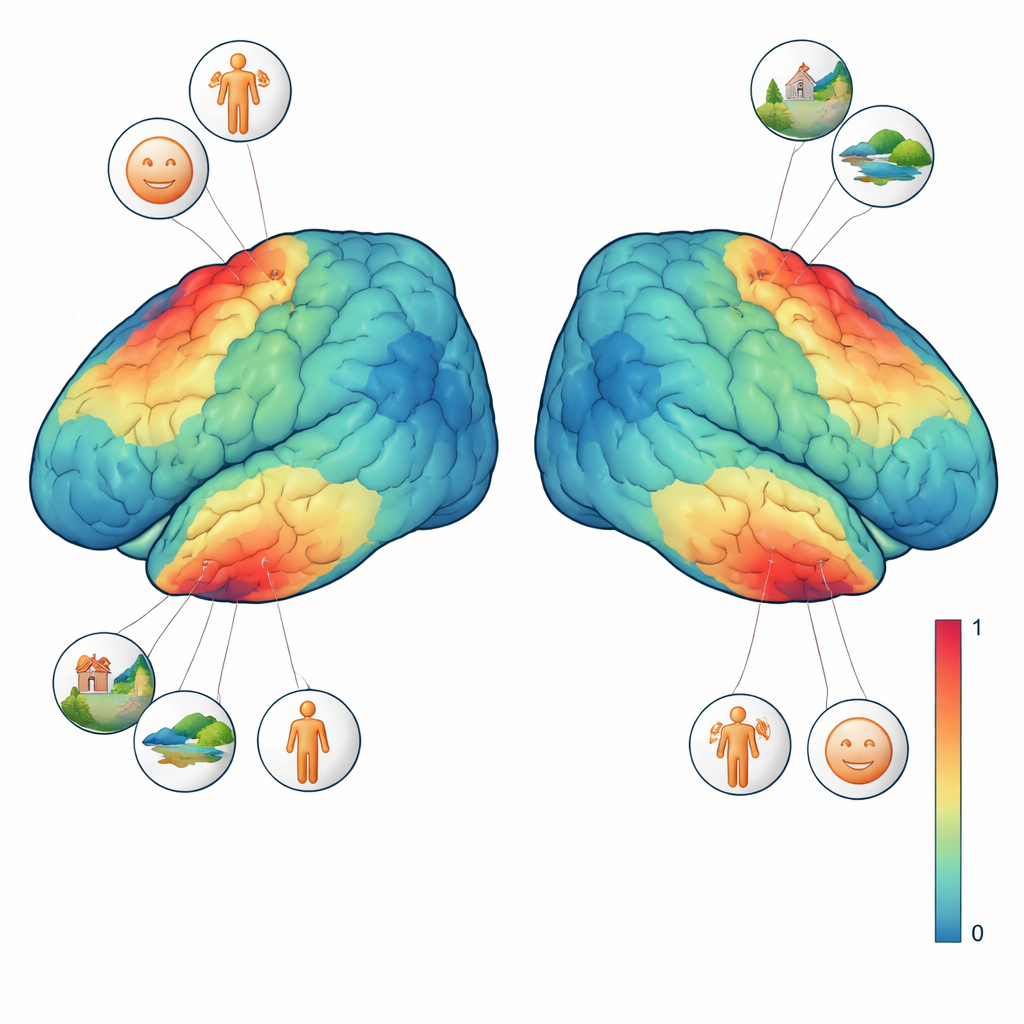

Le jeu de données va bien au-delà de simples mesures « marche/arrêt » de l'activité cérébrale. Les auteurs ont utilisé des méthodes d'analyse avancées pour estimer une réponse séparée pour chaque essai et chaque image dans chaque petit pixel tridimensionnel du scan cérébral. Ils ont aussi enregistré les mouvements oculaires à l'aide de caméras de suivi du regard, surveillé la respiration et le rythme cardiaque, et mesuré le mouvement de la tête. Les contrôles de qualité montrent que les signaux sont remarquablement stables : les participants ont répondu à presque tous les essais, ont maintenu leur regard près du centre de l'écran et ont peu bougé. Dans des zones visuelles clés — régions connues pour répondre fortement aux visages, aux corps ou aux scènes — la même image produisait des motifs d'activité très cohérents à chaque apparition. Ces motifs étaient suffisamment puissants pour que, lorsque les réponses étaient tracées dans une carte bidimensionnelle simplifiée, les images de sens similaire (par exemple animaux ou véhicules) aient tendance à se regrouper.

Cartographier ce qui importe dans différentes régions cérébrales

Pour mieux interpréter ces signaux, trois des quatre participants ont réalisé des tests visuels supplémentaires. Dans l'un d'eux, des formes balayantes se déplaçaient sur un fond texturé pour révéler quelle partie du champ visuel chaque région cérébrale « voit ». Dans un autre, de courts blocs de visages, de lieux, de parties du corps, de personnages et d'objets génériques étaient présentés pour localiser précisément les régions qui préfèrent un type d'image plutôt qu'un autre. En combinant ces tâches de localisation avec l'expérience principale, l'équipe a pu poser des questions précises telles que : un seul voxel répond‑il davantage lorsqu'un visage est présent, ou lorsque l'ensemble de la scène est visible ? Ils ont trouvé que les régions sélectives aux visages répondaient le plus fortement chaque fois qu'un visage apparaissait, tandis qu'une région sélective aux scènes préférait les images avec des arrière‑plans riches comme des pièces, des rues ou des paysages, même lorsqu'aucune personne n'était visible. Ces préférences fines sont apparues au niveau des images individuelles et même au niveau de voxels isolés.

Une base pour des modèles de vision plus performants

Au cœur de CNeuroMod-THINGS se trouve une ressource publique soigneusement organisée plutôt qu'un résultat ponctuel. Toutes les données cérébrales, le suivi oculaire, les réponses comportementales, les annotations d'images et le code d'analyse sont partagés librement sous une licence ouverte. Parce que les mêmes quatre personnes ont été scannées dans de nombreuses autres tâches — regarder des films, jouer à des jeux vidéo, écouter des histoires — les chercheurs peuvent désormais construire des modèles détaillés et spécifiques à chaque personne qui relient des expériences contrôlées à des expériences plus naturelles. Pour les non‑spécialistes, l'idée principale est que nous disposons désormais d'une « table de correspondance » à haute résolution montrant comment un vrai cerveau humain répond à des milliers d'images du quotidien. Cela aidera les scientifiques à tester des hypothèses sur la perception visuelle et la mémoire et à guider la conception de systèmes de vision artificielle qui perçoivent le monde un peu plus comme nous le faisons.

Citation: St-Laurent, M., Pinsard, B., Contier, O. et al. CNeuroMod-THINGS, a densely-sampled fMRI dataset for visual neuroscience. Sci Data 13, 141 (2026). https://doi.org/10.1038/s41597-026-06591-y

Mots-clés: IRMf, perception visuelle, reconnaissance d'objets, données cérébrales, mémoire