Clear Sky Science · fr

Vers l'automatisation de bout en bout de la recherche en IA

Pourquoi un scientifique robotisé importe

Imaginez un chercheur numérique infatigable capable d'imaginer des idées, d'écrire du code, de mener des expériences, de tracer des graphiques et même de rédiger et d'évaluer des articles scientifiques avec presque aucune aide humaine. Cet article décrit un tel système, appelé « Le Scientifique IA ». Il montre que l'intelligence artificielle moderne peut désormais prendre en charge presque toutes les étapes d'un projet de recherche en apprentissage automatique, laissant entrevoir un avenir où les découvertes surviennent plus vite — tout en soulevant de sérieuses questions sur la confiance, l'emploi et la santé même de la science.

De l'idée à l'article fini

Le Scientifique IA est conçu pour parcourir le cycle de vie complet d'une étude, un peu comme le ferait un doctorant. D'abord, il propose des axes de recherche dans un domaine d'apprentissage automatique choisi, explique pourquoi chaque idée peut être intéressante et décrit un plan pour la tester. Il vérifie ensuite ces idées dans des bases de données de recherche en ligne pour éviter de reproduire bêtement des travaux existants. Seules les idées qui semblent véritablement nouvelles avancent. Ensuite, le système écrit et édite le code nécessaire pour exécuter les expériences, corrige une grande partie de ses propres bugs et tient un « carnet de laboratoire » continu de ce qu'il a testé et de ce qui s'est passé.

Deux manières de laisser le système explorer

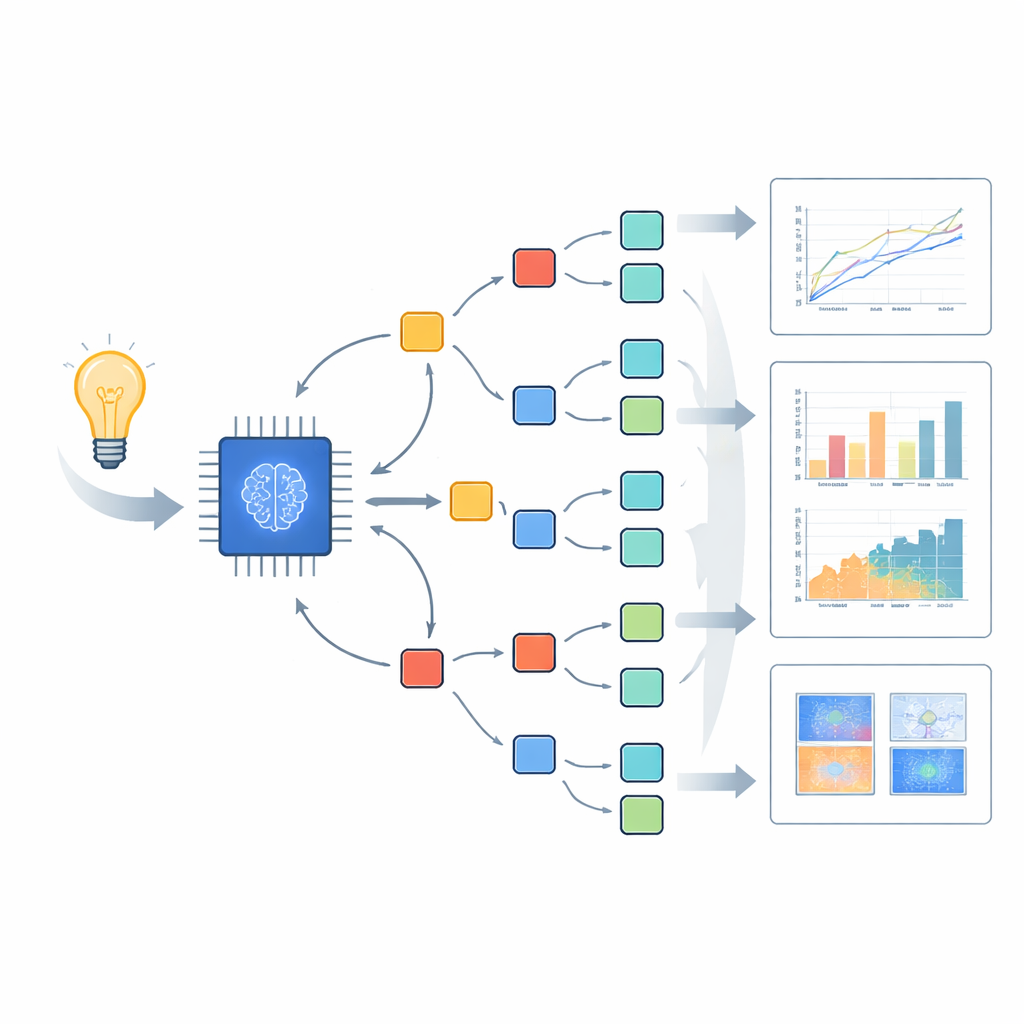

Les chercheurs ont construit deux versions de ce scientifique numérique. En mode « basé sur des modèles », des humains fournissent un programme de départ simple, et le système le modifie progressivement pour explorer des questions voisines. En mode « sans modèle », l'IA part presque de zéro : elle invente des idées, conçoit des expériences et écrit du code de manière autonome, guidée seulement par des instructions générales comme le thème d'un atelier de conférence. Cette version ouverte utilise une recherche en branches à travers de nombreux « chemins » d'expérimentation parallèles, favorisant les plus prometteurs et élaguant ceux qui se plantent ou donnent de mauvais résultats. Plus de puissance de calcul lui permet d'explorer davantage de branches et tend à produire des études finales plus solides.

Apprendre à une IA à agir comme un évaluateur par les pairs

Juger la qualité d'un flux infini d'articles rédigés par l'IA est un défi, aussi l'équipe a-t-elle développé un Évaluateur Automatisé. Cet outil lit les articles de recherche, les note en termes de solidité et d'apport, liste les forces et les faiblesses, et formule une recommandation d'acceptation ou de rejet en utilisant les mêmes directives qu'une grande conférence en apprentissage automatique. Testé sur des milliers d'articles réels dont les décisions étaient connues, les jugements de l'Évaluateur Automatisé correspondaient aux avis humains à peu près aussi bien que les humains se comparent entre eux. Il a donné des performances similaires même sur des articles récents qui n'étaient pas dans ses données d'entraînement, ce qui suggère qu'il a réellement appris la tâche d'évaluation plutôt que d'avoir mémorisé des décisions.

Mettre le Scientifique IA à l'épreuve

Pour évaluer ses performances en conditions réelles, les auteurs lui ont demandé de générer des articles complets pour un atelier d'une grande conférence en apprentissage automatique. Avec l'approbation éthique et la coopération des organisateurs, trois manuscrits générés par l'IA ont été soumis aux côtés d'articles écrits par des humains. Les évaluateurs ont été informés que certaines soumissions pouvaient être rédigées par une IA, sans savoir lesquelles. L'un des trois articles créés par l'IA a obtenu des notes de revue qui auraient suffi pour être acceptées à l'atelier ; les auteurs l'ont retiré ensuite selon un protocole préalablement convenu. Les deux autres articles n'ont pas atteint le niveau requis. Globalement, le système a produit des travaux qui ne sont pas encore au niveau des meilleures recherches humaines, mais qui suffisent déjà à franchir occasionnellement l'évaluation par les pairs réelle.

Promesses, écueils et perspectives

Bien que Le Scientifique IA fasse encore des erreurs — comme des idées superficielles, des erreurs de codage et des citations trompeuses — l'étude suggère que, à mesure que les modèles d'IA sous-jacents et les ressources de calcul s'amélioreront, de tels systèmes deviendront probablement bien meilleurs. Cela pourrait accélérer de manière spectaculaire la découverte dans des domaines où les expériences peuvent être exécutées sur des ordinateurs ou dans des laboratoires automatisés. Dans le même temps, la génération facile d'articles pourrait inonder les revues de travaux de faible qualité, brouiller les frontières autour de la paternité et du crédit, et permettre des expériences risquées ou contraires à l'éthique. Les auteurs soutiennent que la communauté scientifique a besoin de règles claires et de garde-fous dès maintenant, tant que la technologie est encore en émergence, afin que les chercheurs automatisés renforcent la science plutôt que de l'affaiblir.

Citation: Lu, C., Lu, C., Lange, R.T. et al. Towards end-to-end automation of AI research. Nature 651, 914–919 (2026). https://doi.org/10.1038/s41586-026-10265-5

Mots-clés: recherche scientifique automatisée, scientifique IA, expériences en apprentissage automatique, automatisation de l'évaluation par les pairs, intégrité scientifique