Clear Sky Science · fr

Un capteur d’imagerie 4D cohérent à grande échelle

Voir le monde en quatre dimensions

Les voitures autonomes, les drones de livraison et les casques de réalité augmentée reposent tous sur des machines capables de comprendre en temps réel le monde 3D qui les entoure. Aujourd’hui, ce type de vision est souvent volumineux, coûteux ou énergivore. Cet article rapporte une avancée majeure vers une « caméra 4D » — un capteur de la taille d’une puce qui non seulement cartographie la forme d’une scène en 3D mais mesure aussi les mouvements, ouvrant la voie à une vision machine compacte pour tout, des robots aux smartphones.

Des photos plates aux cartes vivantes

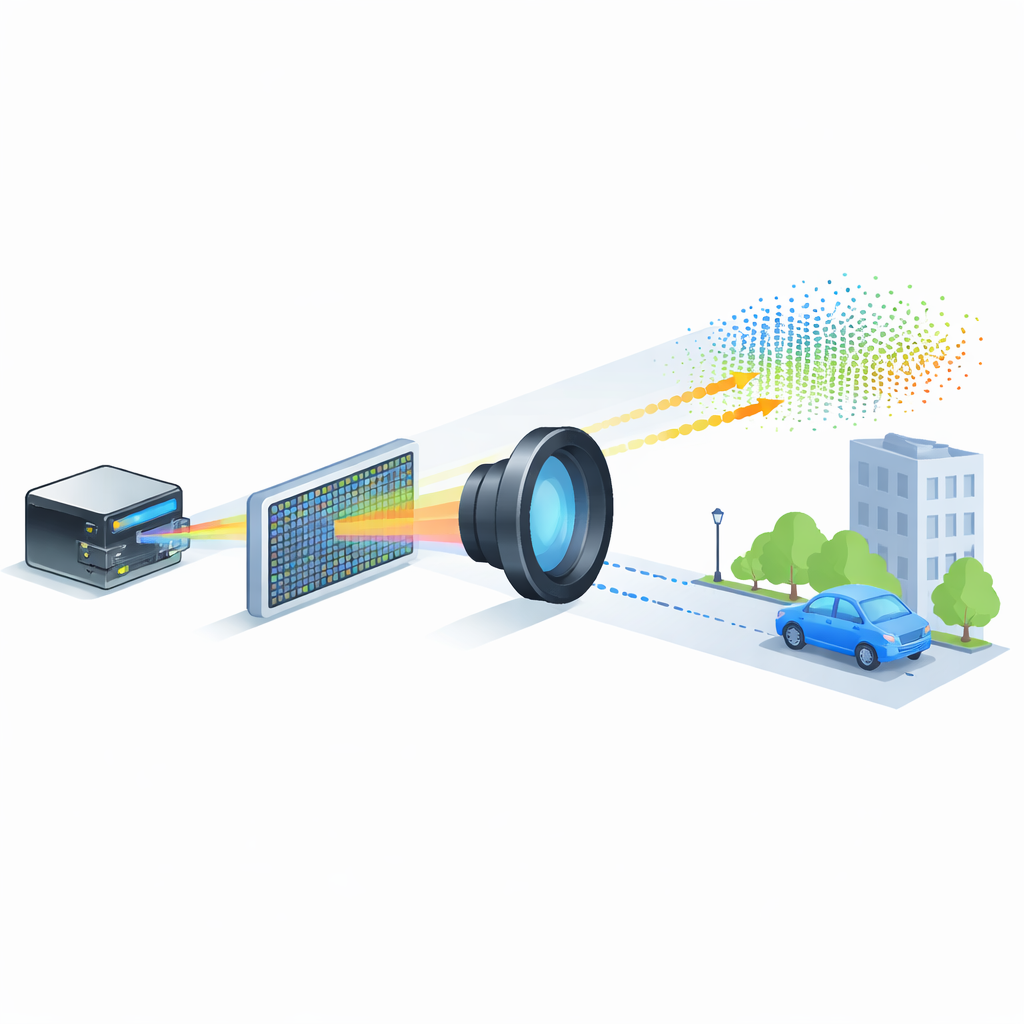

Les appareils photo classiques captent l’intensité lumineuse sur une surface plane, produisant de belles images 2D mais sans information directe sur la distance. En revanche, les systèmes de détection et télémétrie par la lumière (LiDAR) émettent des impulsions laser et mesurent le temps qu’elles mettent à revenir, construisant une carte 3D de leur environnement. Les approches existantes voient loin et avec beaucoup de détails, mais elles nécessitent souvent des pièces mobiles, de grandes optiques ou une forte énergie par point mesuré. Cela complique la fabrication d’un dispositif aussi petit, bon marché et robuste qu’un appareil photo de smartphone, tout en étant capable de scanner en toute sécurité des rues, des sites industriels ou des pièces bondées avec une grande précision.

Une puce qui mesure distance et mouvement

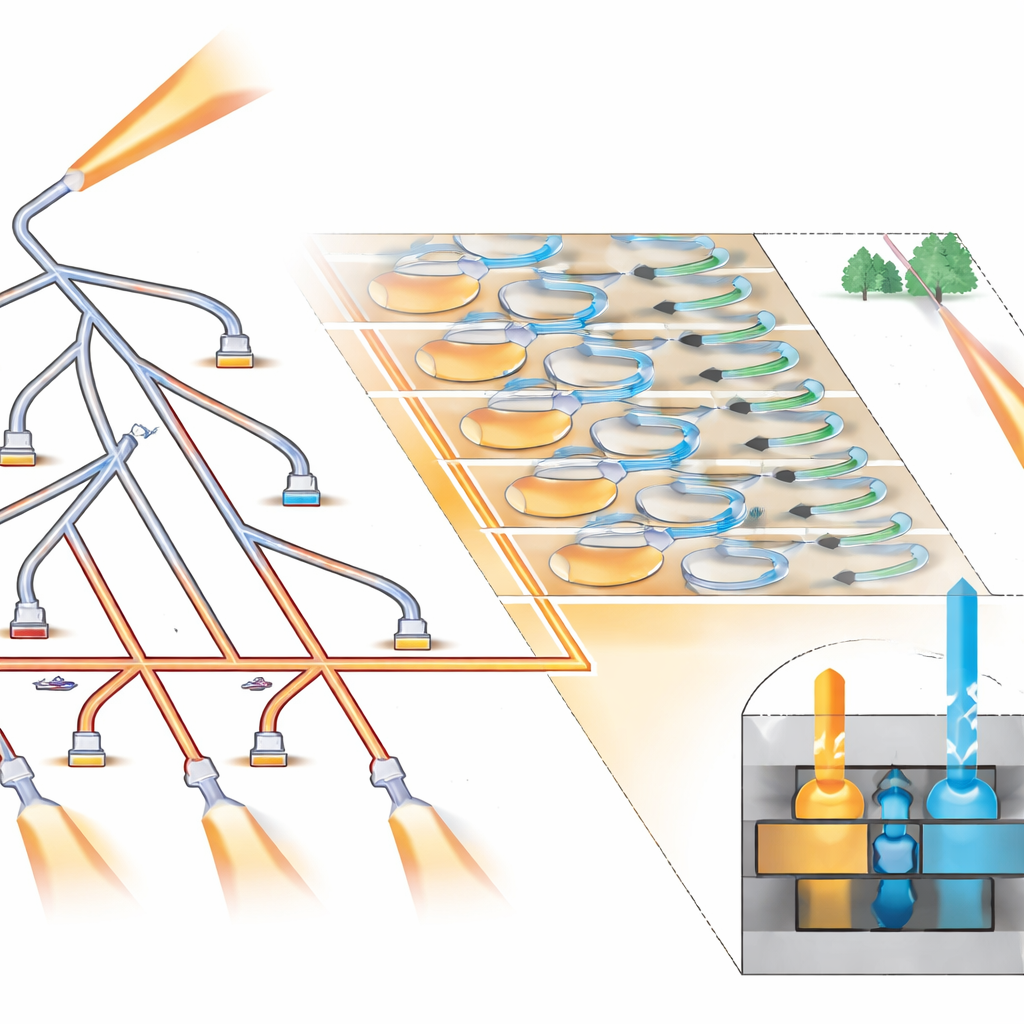

Les chercheurs présentent un nouveau type de matrice focalisée LiDAR — essentiellement une version LiDAR de la puce d’imagerie d’un appareil photo numérique. Leur dispositif contient 352 par 176 pixels, soit plus de 60 000 sites de détection, tous intégrés sur une seule puce de photonique sur silicium avec son électronique de contrôle. Au lieu d’utiliser de courtes impulsions laser, le système repose sur une lumière continue modulée en fréquence (FMCW), dans laquelle la « couleur » du laser est balayée selon un « chirp » contrôlé. Quand la lumière rebondit sur des objets et revient à la puce, elle est combinée de manière cohérente avec un faisceau de référence. De minuscules différences de fréquence révèlent à la fois la distance de chaque point et sa vitesse relative vers ou depuis le capteur, ajoutant la vélocité comme quatrième dimension mesurée.

Comment fonctionne la petite grille lumineuse

Pour couvrir de nombreux pixels sans gaspiller d’énergie, la puce achemine la lumière chirpée via un arbre de mini-interrupteurs optiques, la dirigeant séquentiellement vers des groupes de huit pixels voisins. Au sein de chaque groupe, la lumière est divisée équitablement de sorte que les huit agissent simultanément comme émetteurs et récepteurs. Chaque pixel utilise une paire de coupleurs à réseau pour émettre et collecter la lumière, ainsi qu’une paire de photodétecteurs équilibrés et un amplificateur sur pixel pour extraire le signal de battement qui encode la distance et la vitesse. Des microlentilles conçues spécialement et déposées directement sur la puce aident à canaliser davantage de lumière, améliorant l’efficacité. Parce que la même ouverture émet et reçoit la lumière (conception « monostatique »), le système évite les couplages parasites entre pixels et n’a besoin que d’une lentille d’imagerie externe unique, à l’instar d’un appareil photo ordinaire.

Mettre la caméra 4D à l’épreuve

En utilisant des lentilles infrarouges à ondes courtes disponibles dans le commerce, l’équipe a construit un module semblable à une caméra autour de la puce et a capturé des nuages de points 3D détaillés d’intérieurs et d’extérieurs. Avec une lentille, le capteur a atteint un champ de vision d’environ 33 par 19 degrés et une résolution angulaire pouvant atteindre 0,06 degré — suffisant pour distinguer des meubles dans un bureau et des éléments architecturaux sur des bâtiments à des dizaines de mètres. Le système a mesuré des objets situés entre 4 et 65 mètres en n’utilisant que quelques dizaines de nanojoules d’énergie optique par point et une puissance moyenne ciblée d’environ 178 microwatts par pixel, respectant des limites strictes de sécurité oculaire. Il a aussi suivi le mouvement : dans une expérience, il a mesuré la variation de la vitesse radiale d’un disque en rotation avec une précision de millimètres par seconde.

Performances, limites et perspectives

Des mesures soignées montrent que les performances du capteur se rapprochent des limites physiques fondamentales imposées par la nature quantique de la lumière, sans encore les atteindre entièrement. Aujourd’hui, la principale limitation est le bruit électronique des amplificateurs dans chaque pixel, qui réduit légèrement le rapport signal/bruit par rapport à un détecteur idéal limité uniquement par les photons. Les auteurs décrivent des ajustements de conception simples — principalement l’augmentation du niveau de lumière de référence interne et le raffinement de l’agencement optique, éventuellement en utilisant des alliages silicium–nitrure de silicium — qui pourraient amener le système dans un régime véritablement limité par le bruit de photon et étendre la portée utile au-delà de 200 mètres. Déplacer certains interrupteurs intégrés hors de la matrice de pixels supprimerait également de petites lacunes dans la couverture en champ lointain, produisant des nuages de points plus propres.

Vers une vision 4D quotidienne

Ce travail démontre un capteur d’imagerie 4D compact et entièrement intégré qui rivalise en nombre de pixels et en portée avec les exigences de nombreuses applications réelles, tout en maîtrisant la consommation d’énergie et l’encombrement. En réunissant émetteurs lumineux, récepteurs, pilotage du faisceau et électronique de contrôle sur une seule puce de silicium, le dispositif joue un rôle similaire pour la détection 3D et de mouvement à celui que le capteur CMOS a joué pour la photographie numérique. Avec des raffinements supplémentaires, de tels capteurs pourraient devenir assez bon marché et robustes pour être intégrés dans les voitures, robots, téléphones et casques, offrant aux machines une compréhension précise et en temps réel du monde 3D et de son évolution d’un instant à l’autre.

Citation: Settembrini, F.F., Gungor, A.C., Forrer, A. et al. A large-scale coherent 4D imaging sensor. Nature 651, 364–370 (2026). https://doi.org/10.1038/s41586-026-10183-6

Mots-clés: LiDAR, imagerie 4D, photonique sur silicium, systèmes autonomes, détection de profondeur