Clear Sky Science · fr

Surmonter les limites de la factorisation dimensionnelle dans les modèles de diffusion discrets par l’apprentissage de la distribution conjointe quantique

Pourquoi cette nouvelle approche mêlant IA et quantique est importante

Les systèmes d’IA modernes excellent à générer du texte, des images et d’autres données, mais ils peinent encore lorsque de nombreuses parties des données sont fortement liées entre elles. Cet article montre qu’une classe majeure de modèles génératifs, appelés modèles de diffusion discrets, possède une limitation intrinsèque : à mesure que les données deviennent plus hautement dimensionnelles et plus corrélées, leurs erreurs peuvent croître rapidement. Les auteurs proposent une nouvelle approche qui utilise les ordinateurs quantiques pour apprendre ces relations complexes de manière plus fidèle, ce qui pourrait permettre d’obtenir des modèles génératifs plus rapides et plus flexibles que les techniques classiques actuelles.

Quand décomposer détruit l’essentiel

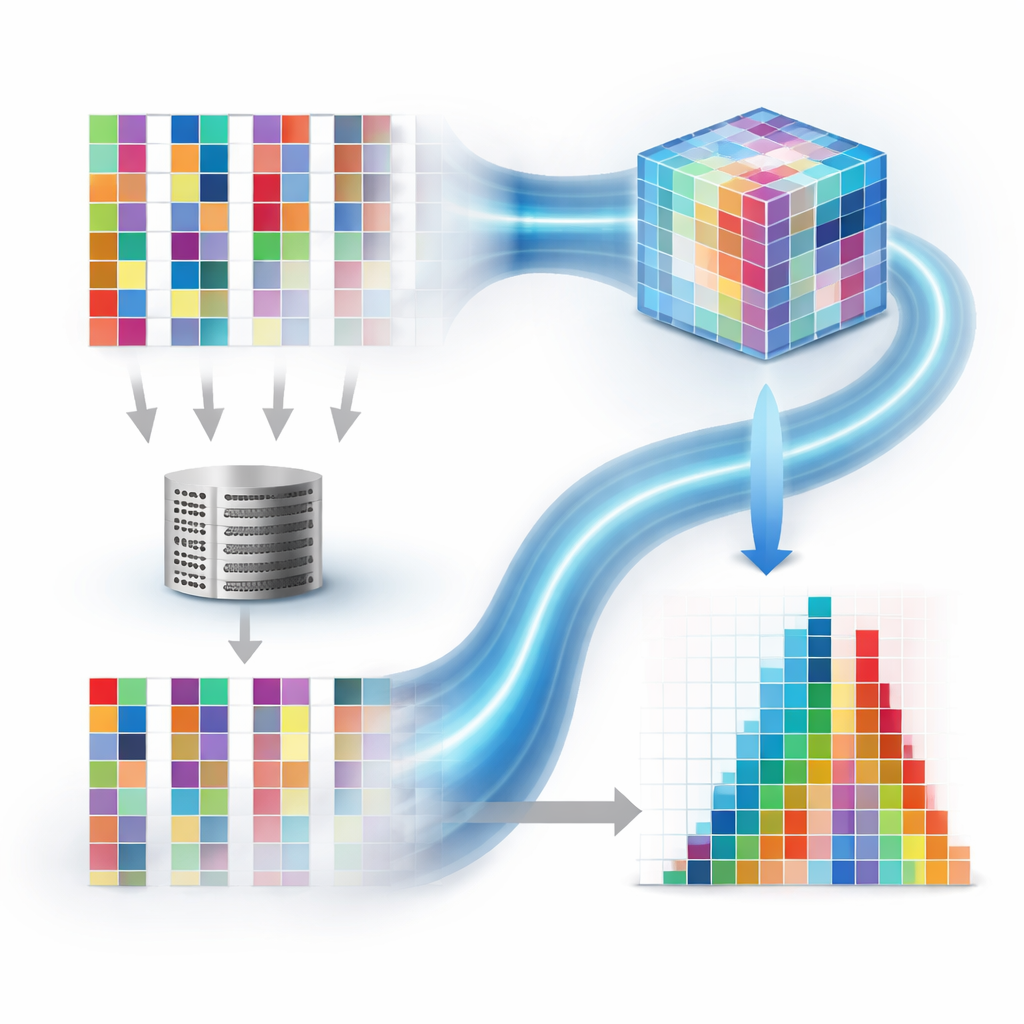

Les modèles de diffusion discrets classiques fonctionnent en corrompant progressivement les données par du bruit puis en apprenant à inverser ce processus, étape par étape, pour générer de nouveaux échantillons. Pour que les calculs restent gérables, ils traitent chaque dimension — comme chaque pixel d’une image ou chaque symbole d’une séquence — comme si elle évoluait indépendamment. Cette « factorisation » évite une explosion exponentielle de la complexité, mais elle ignore aussi les corrélations entre dimensions. Les auteurs analysent un scénario pessimiste où chaque partie des données est fortement liée à toutes les autres. Ils prouvent que, pour de telles données, le décalage entre la vraie distribution et ce qu’un modèle factorisé peut apprendre peut croître approximativement en proportion du nombre de dimensions. En d’autres termes, à mesure que les données grandissent et se structurent, les modèles de diffusion discrets classiques peuvent fondamentalement ne pas réussir à capturer la dépendance entre les éléments d’information.

Utiliser des états quantiques pour préserver les corrélations

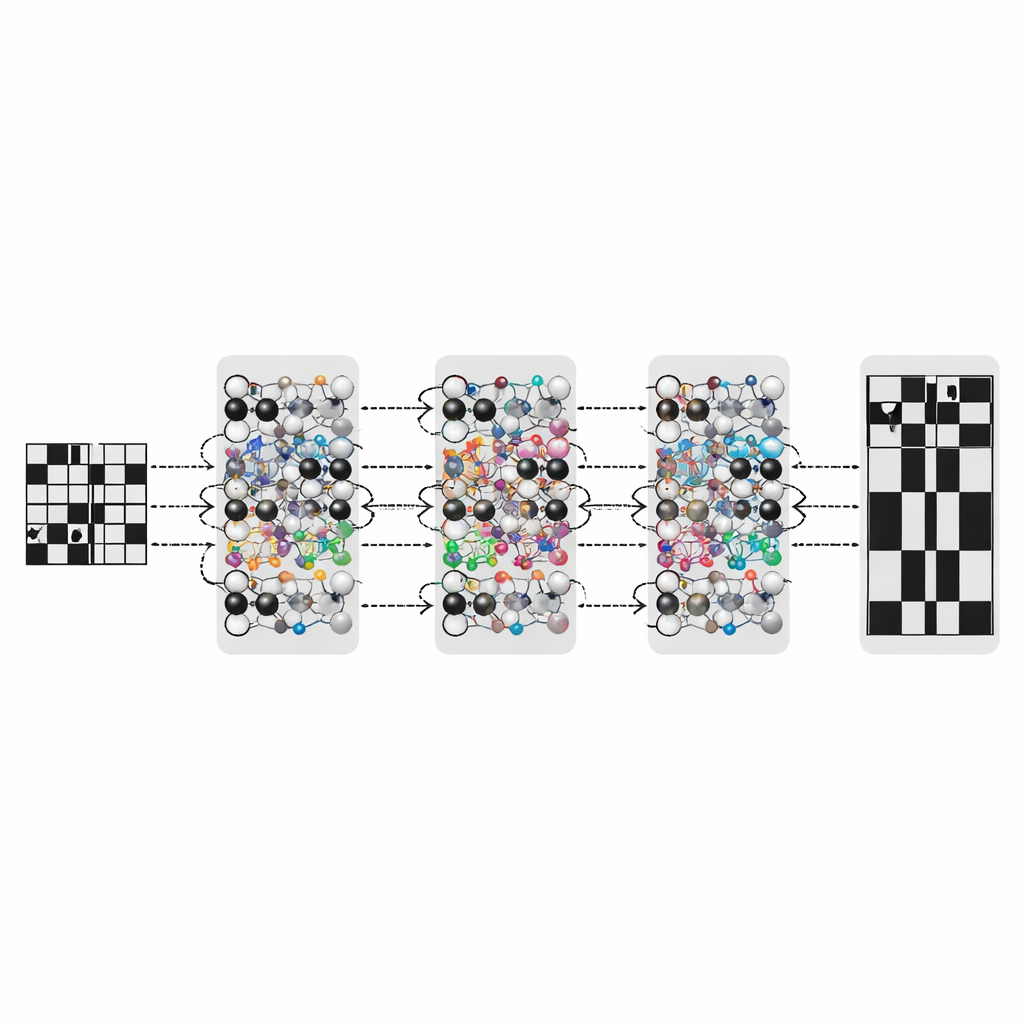

Le modèle quantique de diffusion débruitante discrète proposé (QD3PM) s’attaque à ce problème en représentant les données comme des états quantiques plutôt que comme des variables classiques séparées. Dans un système quantique, un ensemble de qubits vit naturellement dans un très grand espace combiné où les configurations conjointes et les corrélations sont stockées ensemble. QD3PM encode les données discrètes dans cet espace, applique un processus de « diffusion » contrôlé qui ajoute du bruit via des canaux quantiques, puis apprend à inverser ce processus avec un circuit quantique entraînable. Crucialement, le modèle opère sur l’état conjoint complet, de sorte que l’interdépendance entre les dimensions est préservée tout au long de la diffusion et du débruitage. En utilisant une version de la règle de Bayes adaptée à la théorie quantique, les auteurs dérivent comment calculer l’état quantique « postérieur » exact qui doit guider l’entraînement, et conçoivent des circuits qui implémentent physiquement cette mise à jour.

De nombreuses étapes lentes à un saut quantique unique

Les modèles de diffusion classiques ont généralement besoin de nombreuses itérations de débruitage progressif pour transformer du bruit pur en un échantillon réaliste, ce qui les rend coûteux en calcul. QD3PM est d’abord décrit de cette manière itérative familière, mais les auteurs montrent ensuite comment entraîner la même architecture quantique pour passer directement du bruit aux données propres en une seule étape. Ils procèdent en faisant apprendre au circuit quantique la distribution des données d’origine conditionnée par une entrée bruitée, puis en composant soigneusement cette transformation apprise avec les règles de diffusion et de mise à jour quantiques. Grâce aux propriétés des opérations et des mesures quantiques, l’échantillonnage final ne dépend que de certains éléments diagonaux de l’état quantique, ce qui permet de simplifier la procédure sans changer les résultats observables. Cela donne un générateur « one‑shot » qui, en principe, peut être bien plus rapide que la diffusion classique en plusieurs étapes tout en modélisant la distribution conjointe complète.

Combler les vides sans repartir de zéro

Un avantage pratique de QD3PM est la façon dont il gère naturellement les tâches conditionnelles telles que l’inpainting — remplir des parties manquantes d’une image à partir de la région visible. Parce que le modèle décrit la distribution conjointe complète sur toutes les dimensions, les auteurs peuvent conditionner sur des valeurs connues simplement en réinitialisant à plusieurs reprises ces parties des données pendant les étapes de débruitage tout en laissant varier les parties inconnues. Cela oriente en douceur le processus d’échantillonnage vers la distribution conditionnelle correcte, sans changer le circuit ni le réentraîner. Dans des simulations sur des jeux de données synthétiques comprenant des motifs fortement structurés de « barres et rayures », QD3PM non seulement ajuste la distribution globale plus précisément que les modèles de diffusion classiques et que les modèles quantiques reposant sur la factorisation, mais il fonctionne également de façon robuste sous des niveaux réalistes de bruit matériel quantique et gère bien la génération conditionnelle.

Ce que ces résultats impliquent pour l’avenir

Dans l’ensemble, l’analyse et les expériences montrent que traiter les dimensions indépendamment constitue un goulot d’étranglement sérieux pour les modèles de diffusion discrets lorsque les données sont fortement corrélées. En utilisant plutôt des états quantiques pour apprendre directement les distributions conjointes, QD3PM évite cette limitation et peut, en théorie, reproduire parfaitement des distributions cibles complexes dans des cas où les approches factorisées classiques ne le peuvent pas. Le travail démontre aussi comment les modèles génératifs quantiques peuvent offrir non seulement une puissance d’expression brute, mais aussi des avantages pratiques comme un échantillonnage rapide en une étape et une inférence conditionnelle flexible sans réapprentissage. Bien que les démonstrations actuelles soient limitées à des systèmes relativement petits pouvant être simulés sur des ordinateurs classiques, le cadre fournit une feuille de route concrète pour la manière dont le matériel quantique émergent pourrait un jour enrichir les mécanismes centraux de l’IA générative.

Citation: Chen, C., Zhao, Q., Zhou, M. et al. Overcoming Dimensional Factorization Limits in Discrete Diffusion Models through Quantum Joint Distribution Learning. npj Quantum Inf 12, 49 (2026). https://doi.org/10.1038/s41534-026-01188-0

Mots-clés: modèles génératifs quantiques, modèles de diffusion, apprentissage de distribution conjointe, corrélations en haute dimension, génération conditionnelle