Clear Sky Science · fr

Représentation alignée des directions de mouvement visuel et tactile dans hMT+/V5 et les régions fronto-pariétales

Pourquoi cela compte dans la vie de tous les jours

Chasser un moustique sur votre bras semble intuitif, mais votre cerveau résout en silence un problème difficile : il doit combiner ce que vous voyez avec ce que vous sentez pour déterminer dans quelle direction quelque chose se déplace sur votre peau et comment réagir. Cette étude interroge où, dans le cerveau humain, la vue et le toucher sont mises en correspondance, et comment le cerveau transforme des types de signaux très différents — la lumière sur les yeux et la pression sur la peau — en une perception unique et partagée du mouvement dans le monde qui nous entoure.

Deux façons de savoir où bougent les choses

La vision et le toucher commencent par « parler » deux « langages spatiaux » distincts. Le mouvement visuel est d’abord codé par rapport aux yeux : quelle partie de la rétine est stimulée. Le mouvement tactile est codé par rapport à la peau : quelle partie de la main est effleurée. Pourtant, nos actions dépendent de la position des objets dans le monde extérieur, pas seulement de leur position sur nos yeux ou notre peau. Le cerveau doit donc traduire ces cartes centrées sur le corps en un référentiel commun, centré sur le monde, afin qu’un objet vu près de la main et une sensation correspondante sur la peau soient traités comme le même événement.

Un test astucieux avec des points en mouvement et des brosses qui glissent

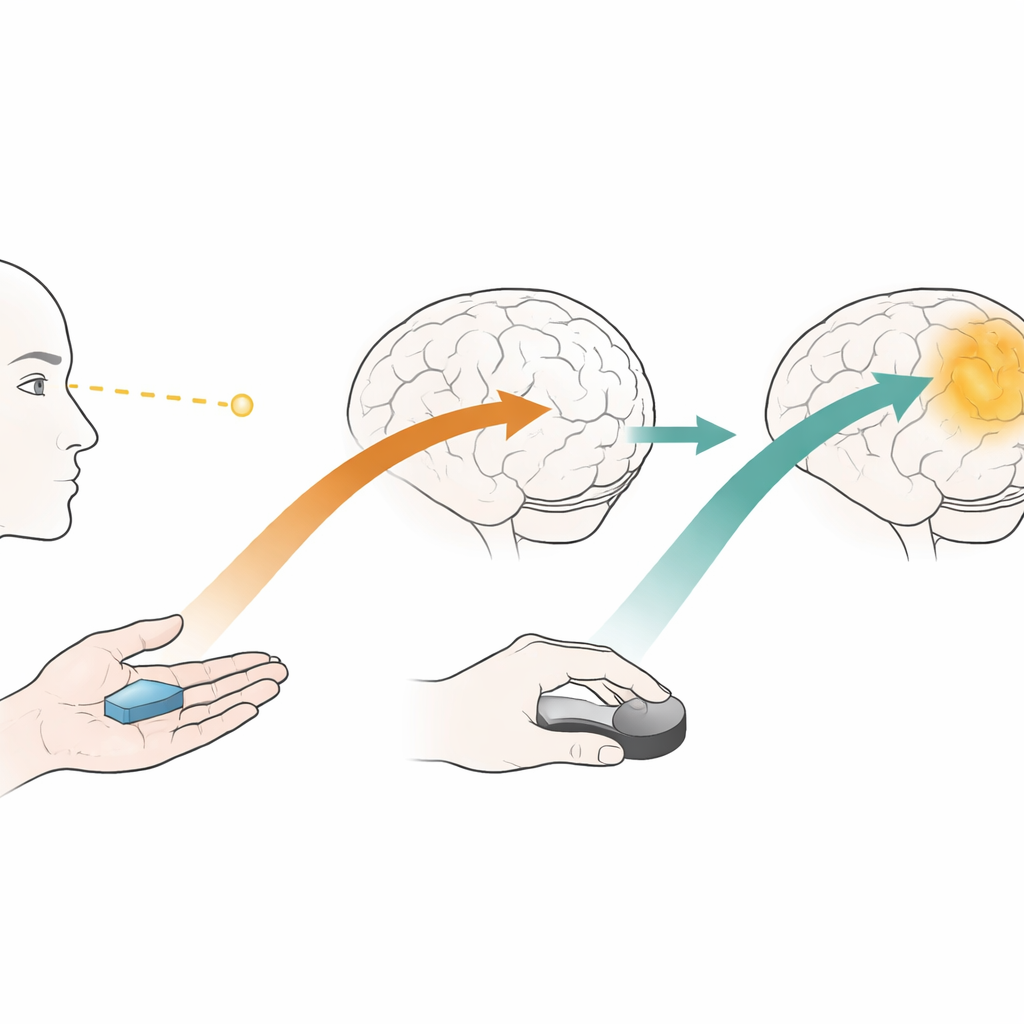

Les chercheurs ont utilisé l’IRMf pour suivre l’activité cérébrale pendant que des participants regardaient des motifs de points en mouvement et ressentaient une brosse balayer leur main droite. Ils ont modifié la posture de la main — parfois paume vers le haut, parfois tournée — de sorte qu’un même mouvement physique sur la peau puisse correspondre à des directions différentes dans l’espace externe. En comparant des motifs d’activité cérébrale à travers de nombreux points de mesure, ils ont testé si une région pouvait distinguer des directions de mouvement, et si son « code » de direction restait stable quand le mouvement était défini sur la peau ou dans l’espace.

Un centre du mouvement visuel qui perçoit aussi le mouvement

Une cible centrale était hMT+/V5, un patch du cortex visuel connu de longue date pour traiter le mouvement. L’équipe a d’abord confirmé que cette aire s’activait non seulement pour des points visuels en mouvement, mais aussi lorsque la main était brossée, et qu’elle pouvait distinguer des directions de mouvement pour les deux modalités. Cela valait aussi pour des sous-régions connues comme MT et MST. En revanche, les aires tactiles primaires du côté gauche du cerveau répondaient fortement au mouvement tactile mais pas au mouvement visuel, cohérent avec leur rôle classique comme carte détaillée de la surface corporelle.

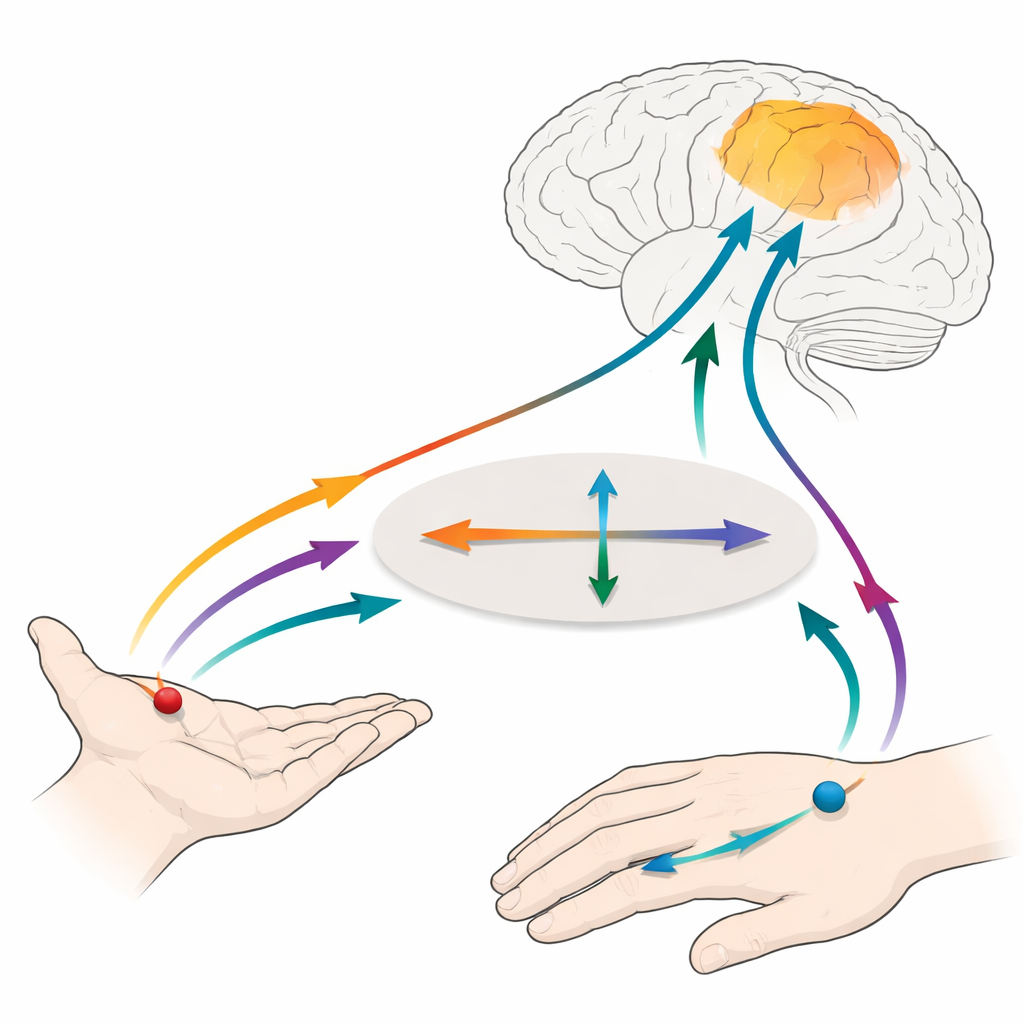

Du mouvement centré sur la peau au mouvement centré sur le monde

La question clé portait sur la manière dont ces aires traitaient différents « référentiels ». Dans le cortex tactile primaire, le mouvement selon l’axe petit doigt-vers-le-pouce et le mouvement selon l’axe doigts-vers-poignet étaient le mieux séparés lorsque définis purement sur la peau, montrant un code dominant centré sur le corps. Dans le hMT+/V5 droit, en revanche, les directions tactiles étaient mieux distinguées lorsqu’elles étaient définies par rapport au monde extérieur — horizontal versus vertical dans l’espace — indépendamment de la posture de la main. De façon cruciale, ce n’est que dans le hMT+/V5 droit qu’un algorithme entraîné sur des motifs de mouvement visuel pouvait correctement deviner des directions de mouvement tactiles, et ce décodage inter-modal ne fonctionnait que lorsque le toucher était décrit dans des coordonnées externes. Des analyses à l’échelle du cerveau ont montré que mettre en correspondance le mouvement visuel et tactile de cette façon mobilisait aussi un réseau de régions pariétales et frontales droites liées à l’attention spatiale et à la planification des mouvements.

Une carte partagée qui garde néanmoins la mémoire de la modalité

Même si le hMT+/V5 droit portait suffisamment d’informations partagées pour aligner les directions de mouvement entre la vue et le toucher, il n’effaçait pas complètement la différence entre les modalités : les motifs pour le mouvement visuel et tactile restaient distinguables. Les auteurs soutiennent que cette région, avec ses partenaires fronto-pariétaux, fonctionne comme un hub multisensoriel du mouvement. Elle convertit les entrées centrées sur la peau et les entrées centrées sur les yeux en une carte externe partiellement commune des directions de mouvement tout en préservant l’information sur la modalité d’origine. Ce codage flexible pourrait aider le cerveau à suivre les événements en mouvement lorsque nos yeux et nos membres se déplacent, nous permettant de coordonner perception et action de manière fluide dans un monde animé et chargé.

Citation: Shahzad, I., Battal, C., Cerpelloni, F. et al. Aligned representation of visual and tactile motion directions in hMT+/V5 and fronto-parietal regions. Nat Commun 17, 2625 (2026). https://doi.org/10.1038/s41467-026-70537-6

Mots-clés: mouvement multisensoriel, hMT+/V5, intégration vision-toucher, référentiels spatiaux, imagerie cérébrale