Clear Sky Science · fr

Combler le fossé de latence avec un cadre d’évaluation en flux continu pour la perception événementielle

Pourquoi une vision robotique plus rapide compte

Imaginez une voiture autonome détectant un obstacle soudain ou un robot tentant de renvoyer une balle de ping-pong filante. Dans ces situations où chaque fraction de seconde compte, voir vite est tout aussi important que voir clairement. Cet article explore une nouvelle façon d’évaluer la rapidité et la fiabilité des « caméras événementielles » de pointe lorsqu’elles suivent des objets en mouvement, et montre que les tests de laboratoire habituels peuvent fortement surestimer les performances réelles de ces systèmes sur le terrain.

Du mode instantané au mode flux

La plupart des systèmes de vision actuels considèrent le monde comme un diaporama. Les caméras classiques capturent des images à intervalles fixes, et les algorithmes traitent image par image. Même lorsqu’on utilise des caméras neuromorphiques, ou à base d’événements, qui détectent des variations de luminosité à la résolution des microsecondes, on reconvertit souvent ce flot riche et continu en images grossières. Cette pensée axée sur des images masquant un problème crucial : le délai. À chaque fois que le système attend la prochaine image puis la traite, des millisecondes précieuses s’écoulent. Pour des tâches à grande vitesse comme la conduite autonome ou l’interaction homme–robot, ce délai signifie que le système réagit toujours au passé récent plutôt qu’au présent.

Une nouvelle façon de noter la vision en temps réel

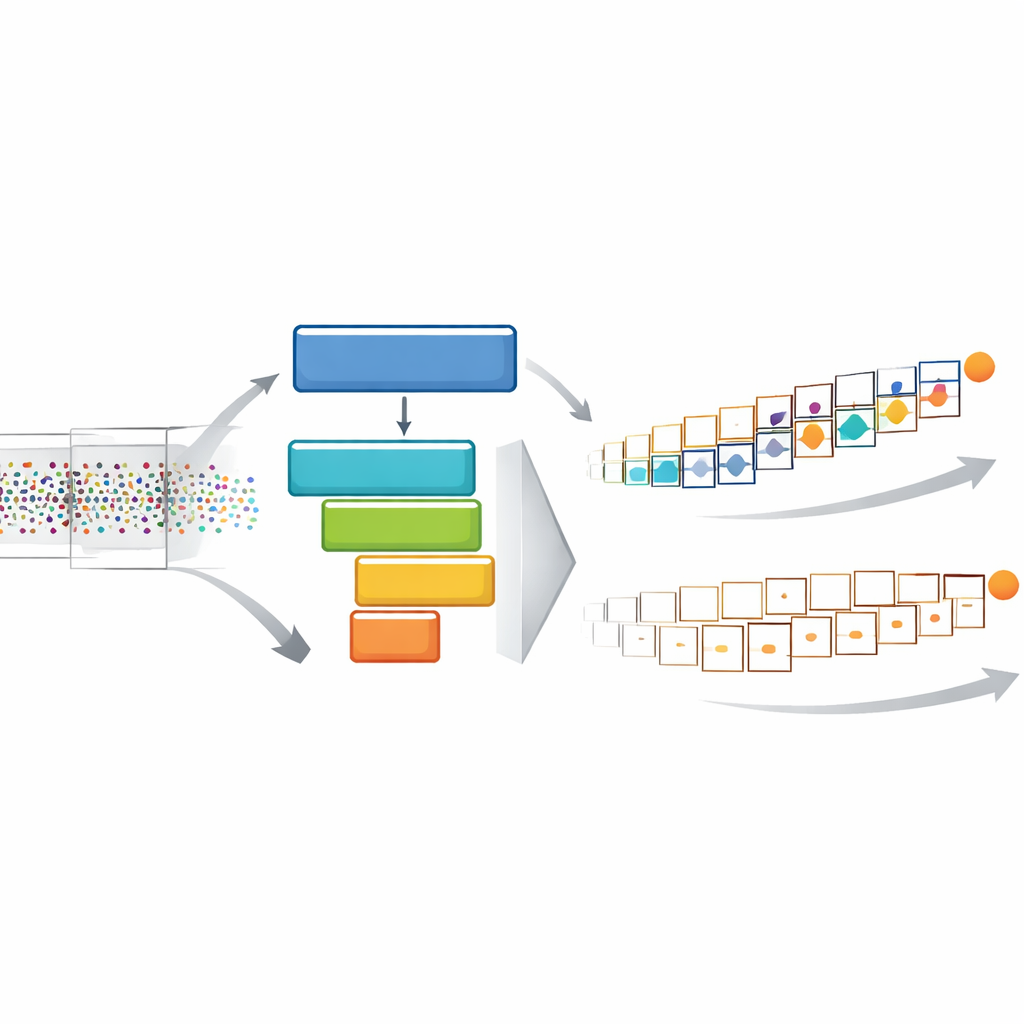

Pour réduire l’écart entre les scores de laboratoire et les besoins réels, les auteurs présentent un cadre nommé STream-based lAtency-awaRe Evaluation, ou STARE. Plutôt que de forcer les données d’événements dans des images fixes, STARE alimente le modèle avec les événements les plus récents dès qu’il a terminé sa dernière prédiction. Cet « échantillonnage continu » maintient le modèle occupé et pousse son taux de sortie aussi haut que le permet le matériel. En parallèle, STARE juge la précision d’une nouvelle manière : chaque position de référence d’un objet en mouvement est appariée à la prédiction la plus récente disponible à cet instant. Si le modèle est lent, la même prédiction périmée est réutilisée sur de nombreux instants, et sa précision apparente chute. Cela intègre directement le coût du délai dans le score final.

Construire une plateforme de test haute vitesse

Mesurer des temporisations aussi fines exige des données tout aussi fines, ce que les jeux de données existants pour caméras événementielles n’offrent pas. Ils enregistrent généralement la position d’un objet seulement quelques dizaines de fois par seconde. Les auteurs ont donc créé ESOT500, un nouveau jeu de données où les objets sont annotés 500 fois par seconde, à la fois sur des caméras événementielles basse et haute résolution, et dans des scènes variées comme des ventilateurs en rotation, des oiseaux en vol et des véhicules en mouvement. À cette densité, la vérité terrain suit de près des mouvements rapides et complexes, évitant l’« aliasing temporel » où un échantillonnage lent fait paraître une trajectoire sinueuse et rapide trompeusement simple. ESOT500 sert ainsi de banc d’essai exigeant pour toute méthode prétendant gérer des dynamiques rapides et imprévisibles.

Ce qui se passe vraiment quand la latence compte

Armés de STARE et d’ESOT500, les auteurs ont réévalué une gamme de suiveurs d’objets à l’état de l’art. Lorsqu’ils sont jugés selon les tests traditionnels basés sur des images, des modèles lourds et complexes paraissent souvent les meilleurs. Sous STARE, cependant, nombre de ces systèmes à haute précision mais lents perdent plus de la moitié de leur précision effective une fois le délai pris en compte. Des modèles plus légers et plus rapides montent soudainement en tête, car ils fournissent des prédictions plus fréquentes et à jour. L’équipe l’a confirmé dans une expérience de ping-pong robotique : un robot a utilisé une caméra événementielle et un suiveur pour renvoyer des balles entrantes. Une perception modérément plus rapide a presque doublé le taux de réussite, tandis qu’un modèle plus lent mais performant hors ligne a donné de piètres résultats. Autrement dit, en temps réel, la vitesse et la fraîcheur de l’information peuvent l’emporter sur la précision brute.

Une utilisation plus intelligente des flux continus

Au-delà de l’évaluation, les auteurs examinent comment concevoir de meilleurs systèmes pour la vision continue. Une stratégie, le « suivi asynchrone », associe un modèle de base lent mais soigneux à un compagnon plus petit et agile qui met à jour la position de l’objet entre les passages complets du modèle de base. Cette configuration double réutilise des caractéristiques partagées et exploite le flux constant d’événements, augmentant le taux de sortie d’environ 80 % et améliorant la précision consciente de la latence d’environ 60 %. Une seconde stratégie, l’« échantillonnage contextuel », surveille le nombre d’événements autour de l’objet suivi. Lorsque la scène est calme et que peu de choses changent, le suiveur réutilise temporairement sa dernière bonne estimation au lieu de recalculer, réduisant le travail inutile. Il se réactive ensuite lorsque le mouvement reprend, ce qui aide notamment dans des conditions de faible activité ou d’événements rares.

Réduire l’écart entre le laboratoire et la vie réelle

Pour les non-spécialistes, le message principal est simple : dans des situations à mouvement rapide, la vitesse à laquelle un système de vision peut mettre à jour sa représentation du monde compte autant que la précision de chaque prédiction individuelle. En traitant la sortie de la caméra comme un vrai flux et en intégrant directement le délai dans le score, STARE révèle des faiblesses que les tests conventionnels manquent et met en lumière des conceptions qui fonctionnent réellement sous pression. Avec le jeu de données ESOT500 et les stratégies de suivi proposées, ce travail oriente vers des robots, véhicules et systèmes interactifs du futur qui non seulement voient bien, mais voient en temps utile.

Citation: Chu, J., Zhang, R., Yang, C. et al. Bridging the latency gap with a continuous stream evaluation framework in event-driven perception. Nat Commun 17, 2441 (2026). https://doi.org/10.1038/s41467-026-70240-6

Mots-clés: caméras événementielles, suivi en temps réel, vision robotique, évaluation consciente de la latence, perception neuromorphique