Clear Sky Science · fr

Estimations fiables d'incertitude en apprentissage profond avec des algorithmes Metropolis-Hastings efficaces

Pourquoi une incertitude plus intelligente compte

Des scans médicaux aux voitures autonomes, l'intelligence artificielle moderne prend souvent des décisions pour lesquelles se tromper avec assurance peut être dangereux. Les systèmes d'apprentissage profond classiques excellent à reconnaître des motifs, mais ils sont notoirement mauvais pour indiquer à quel point ils sont incertains. Cet article comble cette lacune : il présente de nouvelles façons d'équiper les réseaux de neurones profonds de mesures d'incertitude fiables, tout en maîtrisant le coût computationnel élevé des méthodes bayésiennes traditionnelles.

Du bricolage à la confiance mesurée

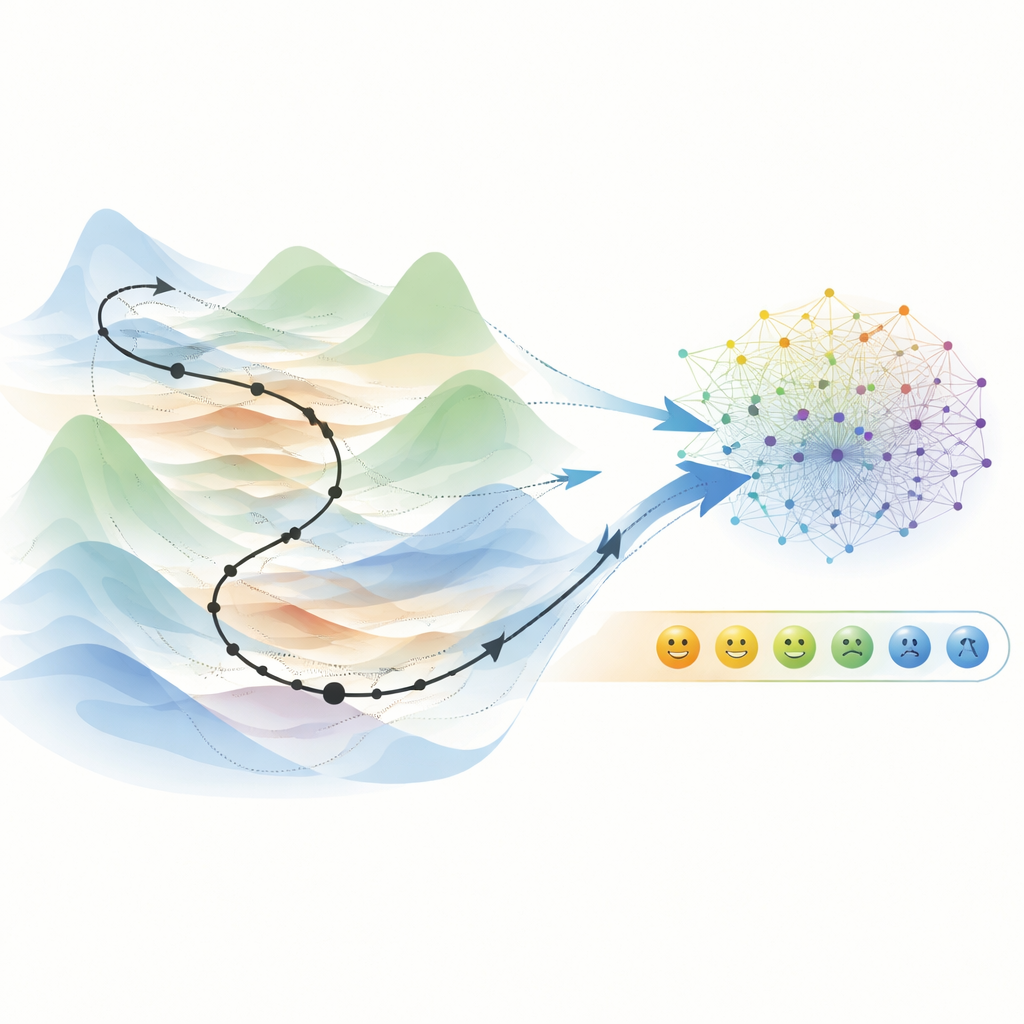

Dans l'apprentissage profond courant, un modèle est entraîné une fois puis utilisé tel quel. Il fournit une seule meilleure estimation, mais donne peu d'information sur la fiabilité de cette estimation. Les réseaux de neurones bayésiens empruntent une autre voie : plutôt que de fixer un seul jeu de paramètres, ils traitent les paramètres comme aléatoires et cherchent à capturer une distribution entière de modèles plausibles. Moyenniser les prédictions sur cet ensemble peut révéler à la fois la réponse la plus probable et le degré de confiance du modèle. Le défi est que prélever précisément des échantillons de cette distribution avec des méthodes de référence comme Hamiltonian Monte Carlo coûte extrêmement cher pour les réseaux et jeux de données actuels.

Échantillonnage plus rapide sans perdre la vue d'ensemble

Les auteurs se concentrent sur une famille de méthodes appelées Hamiltonian Monte Carlo à gradient stochastique, qui réutilisent déjà des idées de l'entraînement standard — mini-lots et gradients bruités — pour accélérer l'échantillonnage. L'ingrédient manquant est un « filtre » fiable qui décide quelles mises à jour potentielles des paramètres conserver. Dans le Hamiltonian Monte Carlo classique, ce rôle est tenu par une étape d'acceptation Metropolis-Hastings qui corrige les erreurs numériques et empêche l'échantillonneur de dériver vers de mauvaises régions. Introduire cette étape d'acceptation dans le monde bruité et basé sur mini-lots de l'apprentissage profond est difficile, car elle exige généralement des évaluations sur l'ensemble du jeu de données et peut stagner si les taux d'acceptation sont trop faibles.

Deux nouvelles manières de parcourir le paysage

L'article présente deux stratégies complémentaires. La première, appelée Hamiltonian Monte Carlo à gradient stochastique généralisé (GSGHMC), conçoit un test d'acceptation qui s'exécute sur des mini-lots tout en préservant la propriété importante selon laquelle les véritables optimums du problème complet sont toujours correctement reconnus. Elle utilise un intégrateur numérique soigneusement choisi pour que l'acceptation pas à pas reste stable, même s'il ne voit qu'une tranche des données à la fois. Cela donne un échantillonneur efficace qui reste proche du portrait bayésien réel et produit des ensembles de modèles avec des scores de confiance particulièrement bien calibrés.

Parcourir de longues trajectoires pour de meilleures prédictions

La seconde méthode, l'Ensemble de Trajectoires Hamiltoniennes (HTE), accepte un compromis délibéré : au lieu d'insister sur un comportement bayésien exact, elle favorise de longues marches portées par l'élan dans l'espace des paramètres qui ressemblent à des sessions d'entraînement agressives. À la fin de chaque trajectoire, un test de type Metropolis décide s'il faut conserver l'instantané de modèle obtenu. Parce que ces chemins tendent à s'établir dans des vallées larges et généralisables du paysage de perte, les modèles collectés forment un ensemble diversifié mais ciblé. Sur des benchmarks de classification d'images tels que EMNIST et CIFAR-10, HTE améliore la précision jusqu'à environ six points de pourcentage par rapport à de solides baselines bayésiennes, et de plusieurs points par rapport à un entraînement déterministe ordinaire, tout en fournissant des informations d'incertitude utiles et une bonne détection des entrées hors distribution.

Des ensembles plus petits, une utilisation plus intelligente

Échantillonner des centaines ou des milliers de modèles paraît coûteux au moment du test, aussi les auteurs étudient-ils combien de membres d'ensemble sont réellement nécessaires. En écartant de manière gourmande les modèles qui ont peu d'impact sur la performance, ils constatent qu'environ un tiers de l'ensemble peut souvent être conservé sans nuire à la précision, bien que préserver une calibration très précise nécessite typiquement plus de membres. Sur des tâches d'image et un problème chaotique de prévision de séries temporelles, leurs méthodes surpassent ou égalent constamment des alternatives populaires telles que l'inférence variationnelle, le Monte Carlo dropout et des ensembles profonds plus simples, bien que cela exige un coût d'entraînement supérieur à celui d'un apprentissage déterministe pur.

Ce que cela signifie pour l'IA du monde réel

Pour un non-spécialiste, le message central est que nous pouvons rendre l'apprentissage profond non seulement précis mais aussi honnête sur ce qu'il ne sait pas, sans nécessiter des ressources de l'échelle des supercalculateurs. En tissant soigneusement des idées classiques d'échantillonnage dans l'entraînement moderne basé sur les mini-lots, les deux approches proposées offrent de meilleures prédictions et des estimations de confiance plus crédibles que nombre de techniques existantes. Cette combinaison d'efficacité, de robustesse et d'incertitude calibrée est une étape clé vers le déploiement sûr de l'apprentissage profond dans des domaines sensibles où le coût de la surconfiance se compte en vies et pas seulement en points de pourcentage.

Citation: Schmal, M., Mäder, P. Reliable uncertainty estimates in deep learning with efficient Metropolis-Hastings algorithms. Nat Commun 17, 2531 (2026). https://doi.org/10.1038/s41467-026-70015-z

Mots-clés: Réseaux de neurones bayésiens, estimation de l'incertitude, Hamiltonian Monte Carlo, ensembles en apprentissage profond, MCMC à gradient stochastique